为什么回归问题用 MSE?

来源:机器学习算法那些事 本文约1700字,建议阅读9分钟 很多时候,一些基础知识可能会影响你对一个模型结果表现的理解。

极大似然估计MLE

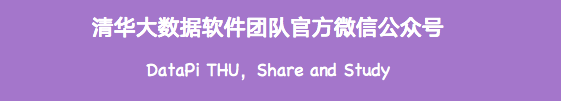

胡乱猜测的正态分布

对于这个正态分布,我们可以计算每个点出现的概率: 。其中 和 是这个正态分布的均值和方差, 是第 条数据,我们把每条数据出现的概率相乘,得到了“在这套正态分布的均值方差下,我们观测到这批数据的概率”。

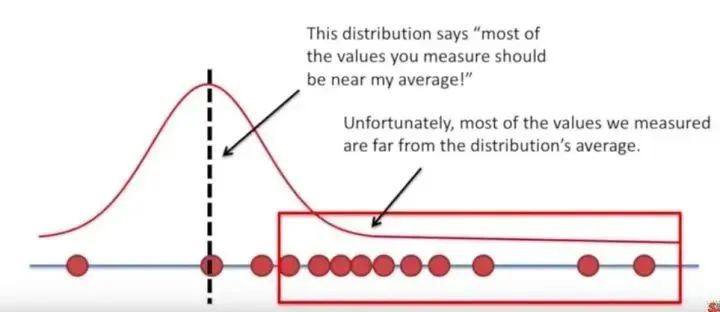

同样的,我们可以猜测另一种正态分布:

另一种猜测的正态分布

同样的,我们可以计算“在这套正态分布的均值方差下,我们观测到这批数据的概率”。

最后,我们在这群待选的均值和方差中,选出那个能使我们观测到这批数据的概率最大的均值和方差。也就是我们在做

回归问题

现在我们再看回归问题,对于回归问题来说,我们的目标不是去找一个x的正态分布了。对于一个回归问题,我们以最简单的线性回归举例。对于一个回归问题,我们的目标是 ,其中 和 是模型的参数,而 是噪声,我们假设噪声符合正态分布 。

那么我们的 其实也可以看成符合正态分布(并不是严谨的写法) ,其中 其实就是模型的预测值,也就是说 。

正态分布的probability density function是 ,带入得到

那么也就是说,如果我们想最大化我们观测到的 的情况的话,我们应该最大化上面这个pdf的连乘结果。注意到这个值由一个常数乘上一个 的次方项,优化的时候常数项可以忽略。

于是我们的目标变成了

于是我们就证明了,我们在做线性回归的时候,我们如果假设我们的噪声符合高斯分布,那么我们的目标函数就是MSE。

总结

[1] CC思SS:回归模型中的代价函数应该用MSE还是MAE

https://zhuanlan.zhihu.com/p/45790146

[2] 在回归问题中,为何对MSE损失的最小化等效于最大似然估计?

https://www.zhihu.com/question/426901520

[3] https://link.zhihu.com/?target=https%3A//towardsdatascience.com/where-does-mean-squared-error-mse-come-from-2002bbbd7806

[4] https://link.zhihu.com/?target=https%3A//towardsdatascience.com/mse-is-cross-entropy-at-heart-maximum-likelihood-estimation-explained-181a29450a0b

编辑:黄继彦

评论