一文看懂从 RNN 到 LSTM

仅作学术交流,如有侵权,请联系后台删除

这是在看了台大李宏毅教授的深度学习视频之后的一点总结和感想。看完介绍的第一部分 RNN 尤其 LSTM 的介绍之后,整个人醍醐灌顶。本篇博客就是对视频的一些记录加上了一些个人的思考。

0. 从 RNN 说起

循环神经网络(Recurrent Neural Network,RNN)是一种用于处理序列数据的神经网络。相比一般的神经网络来说,他能够处理序列变化的数据。比如某个单词的意思会因为上文提到的内容不同而有不同的含义,RNN 就能够很好地解决这类问题。

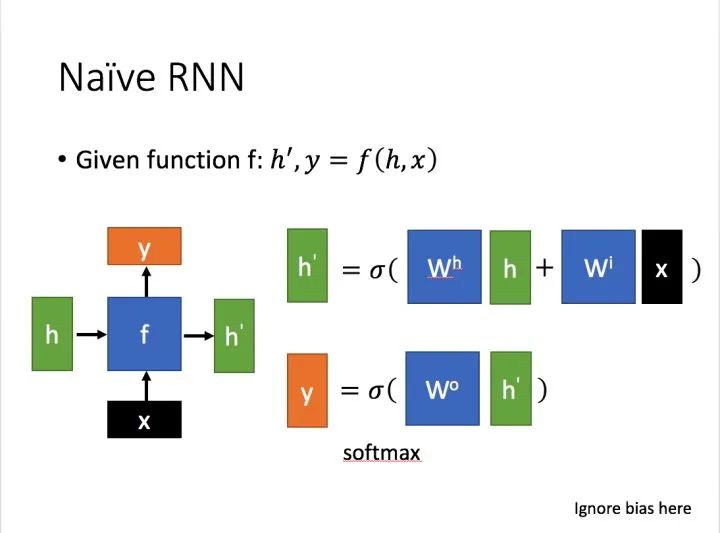

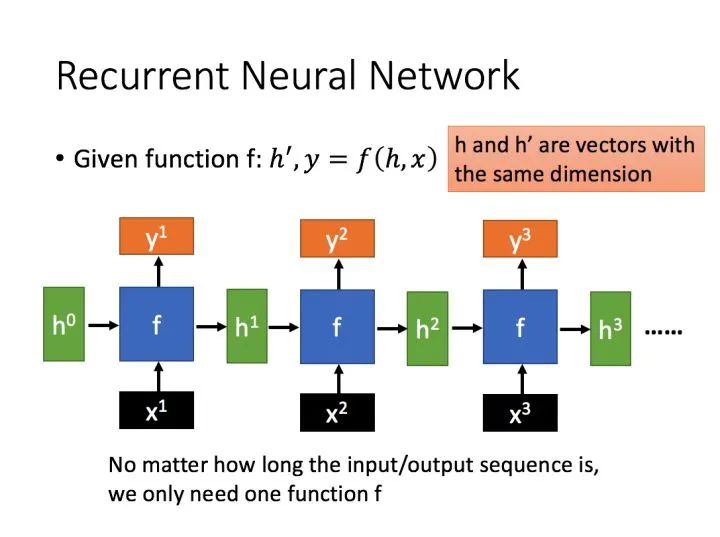

1. 普通 RNN

为当前状态下数据的输入,

为当前状态下数据的输入,  表示接收到的上一个节点的输入。

表示接收到的上一个节点的输入。 为当前节点状态下的输出,而

为当前节点状态下的输出,而  为传递到下一个节点的输出。

为传递到下一个节点的输出。

对这里的 y 如何通过 h' 计算得到往往看具体模型的使用方式。通过序列形式的输入,我们能够得到如下形式的 RNN。

2. LSTM

2.1 什么是 LSTM

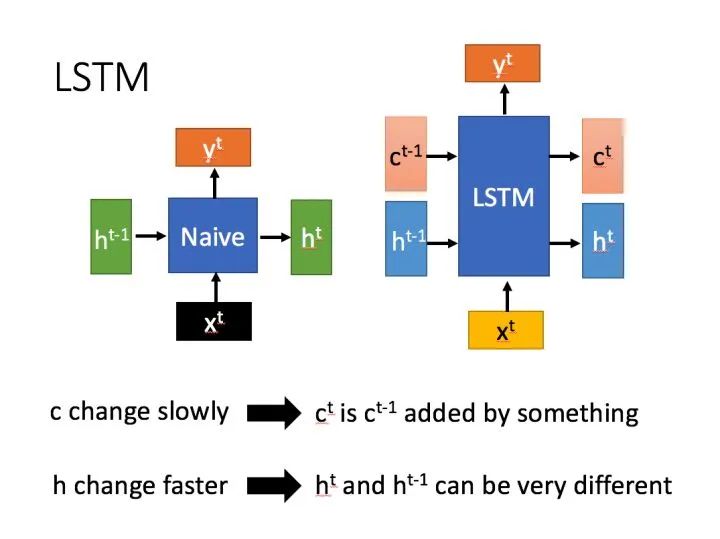

LSTM 结构(图右)和普通 RNN 的主要输入输出区别如下所示。

,LSTM有两个传输状态,一个

,LSTM有两个传输状态,一个  (cell state),和一个

(cell state),和一个  (hidden state)。(Tips:RNN 中的

(hidden state)。(Tips:RNN 中的  对于 LSTM 中的

对于 LSTM 中的  )

) 改变得很慢,通常输出的

改变得很慢,通常输出的  是上一个状态传过来的

是上一个状态传过来的  加上一些数值。

加上一些数值。 则在不同节点下往往会有很大的区别。

则在不同节点下往往会有很大的区别。2.2 深入 LSTM 结构

下面具体对 LSTM 的内部结构来进行剖析。

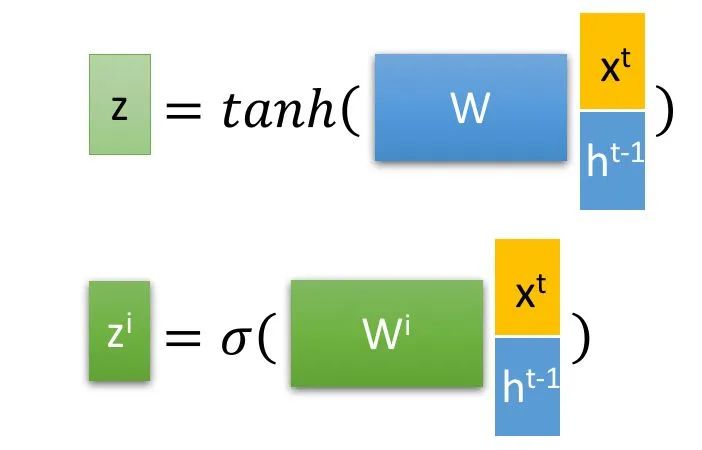

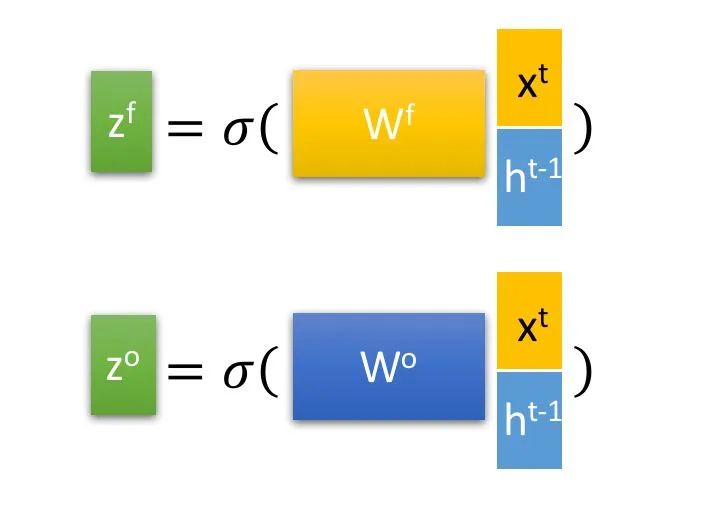

首先使用 LSTM 的当前输入  和上一个状态传递下来的

和上一个状态传递下来的  拼接训练得到四个状态。

拼接训练得到四个状态。

其中,  ,

,  ,

, 是由拼接向量乘以权重矩阵之后,再通过一个

是由拼接向量乘以权重矩阵之后,再通过一个  激活函数转换成0到1之间的数值,来作为一种门控状态。而

激活函数转换成0到1之间的数值,来作为一种门控状态。而  则是将结果通过一个

则是将结果通过一个  激活函数将转换成-1到1之间的值(这里使用

激活函数将转换成-1到1之间的值(这里使用  是因为这里是将其做为输入数据,而不是门控信号)。

是因为这里是将其做为输入数据,而不是门控信号)。

下面开始进一步介绍这四个状态在 LSTM 内部的使用。(敲黑板)

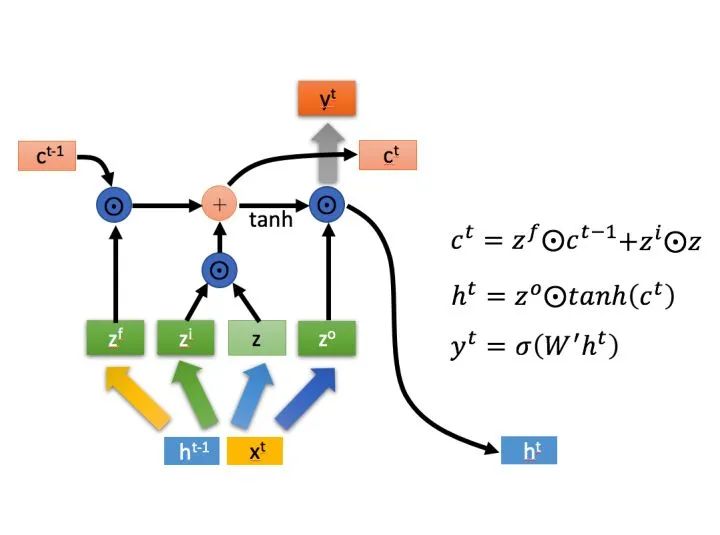

是 Hadamard Product,也就是操作矩阵中对应的元素相乘,因此要求两个相乘矩阵是同型的。

是 Hadamard Product,也就是操作矩阵中对应的元素相乘,因此要求两个相乘矩阵是同型的。  则代表进行矩阵加法。

则代表进行矩阵加法。

LSTM 内部主要有三个阶段:

1. 忘记阶段。这个阶段主要是对上一个节点传进来的输入进行选择性忘记。简单来说就是会 “忘记不重要的,记住重要的”。

具体来说是通过计算得到的  (f表示forget)来作为忘记门控,来控制上一个状态的

(f表示forget)来作为忘记门控,来控制上一个状态的  哪些需要留哪些需要忘。

哪些需要留哪些需要忘。

进行选择记忆。哪些重要则着重记录下来,哪些不重要,则少记一些。当前的输入内容由前面计算得到的

进行选择记忆。哪些重要则着重记录下来,哪些不重要,则少记一些。当前的输入内容由前面计算得到的  表示。而选择的门控信号则是由

表示。而选择的门控信号则是由  (i 代表 information)来进行控制。

(i 代表 information)来进行控制。将上面两步得到的结果相加,即可得到传输给下一个状态的。也就是上图中的第一个公式。

3. 输出阶段。这个阶段将决定哪些将会被当成当前状态的输出。主要是通过  来进行控制的。并且还对上一阶段得到的

来进行控制的。并且还对上一阶段得到的  进行了放缩(通过一个 tanh 激活函数进行变化)。

进行了放缩(通过一个 tanh 激活函数进行变化)。

与普通 RNN 类似,输出  往往最终也是通过

往往最终也是通过  变化得到。

变化得到。