基于几何距离分解的单目三维目标检测

摘要

不同于大多数现有的方法将距离回归为单一变量,作者提出了一种新的基于几何的距离分解,通过其因子恢复距离信息。将物体的距离分解为最具代表性和最稳定的变量,即物体的物理高度和投影在图像平面上的视觉高度。此外,分解保持了两个高度之间的自一致性,从而在两个高度预测都不准确的情况下实现鲁棒距离预测。分解还使作者能够追踪不同场景下距离不确定性的原因。这种分解使得距离预测具有可解释性、准确性和鲁棒性。作者的方法直接从RGB图像中预测三维边界框,结构紧凑,使训练和推理简单高效。实验结果表明,该方法在单目三维目标检测和KITTI数据集上的鸟瞰图任务中都达到了最先进的性能,并且可以推广到具有不同相机特性的图像。

作者的方法的贡献总结如下:

1. 一种新的基于几何的距离分解方法使距离预测具有可解释性、准确性和鲁棒性。

2. 在分解的基础上,作者的方法最初追踪了距离不确定性的原因。

3.作者的方法直接从RGB图像中预测三维边界框,结构紧凑,使训练和推理简单高效。

4. 作者的方法在单目三维目标检测和KITTI数据集[9]的鸟瞰任务上达到了最先进的(SOTA)性能,并且可以适应不同相机特性的图像。

框架结构

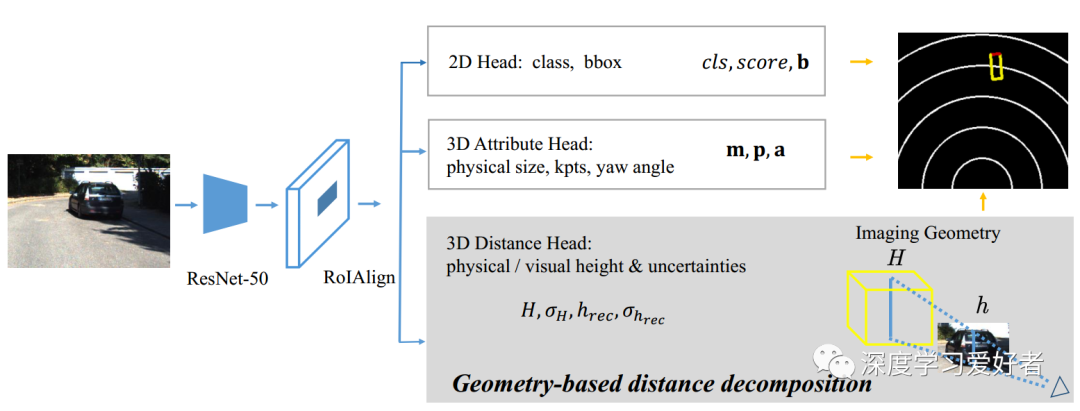

MonoRCNN的主要架构

MonoRCNN是建立在Faster R-CNN[32]之上,并添加了精心设计的3D距离头。3D距离头是基于作者的基于几何的距离分解。具体来说,作者的方法回归H, hrec = h1和它们的不确定性,然后恢复距离Z = fHhrec。蓝色箭头表示训练和推理过程中网络中的操作,橙色箭头表示推理过程中恢复三维边界框的操作。

实验结果

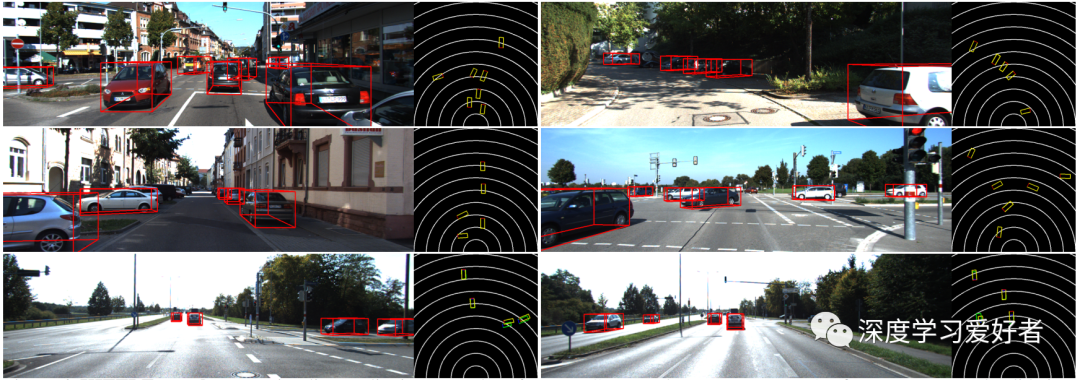

KITTI例子

作者在KITTI测试集[9](前两行)和验证拆分[5](第三行)上可视化MonoRCNN的定性示例。鸟瞰图结果中的黄/绿框分别表示预测和地面情况,红/蓝线表示汽车的偏航角。相邻两个白圆的半径差为5米。

nuScenes交叉测试的例子

作者在nuScenes[3]交叉测试集上可视化MonoRCNN的定性例子。鸟瞰结果如上图所示。作者的模型只使用KITTI val分裂的[5]进行训练,可以推广到具有不同相机固有特性的nuScenes[3]交叉测试集中的图像。

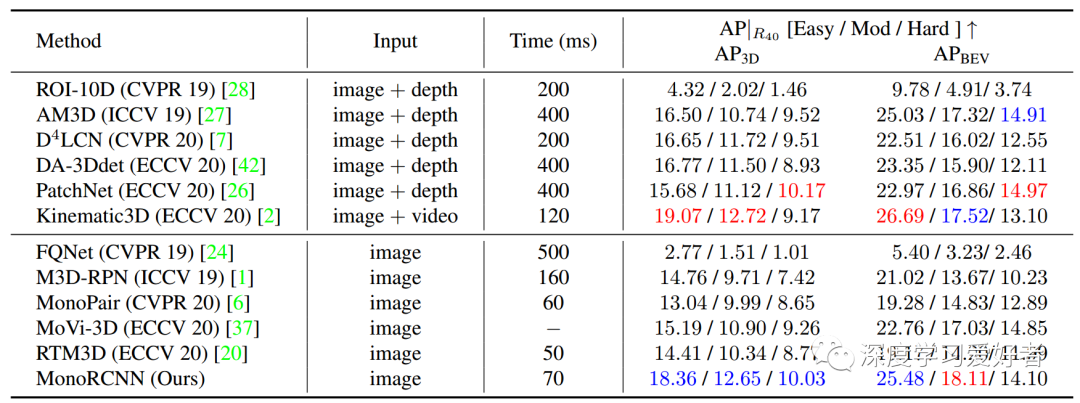

在KITTI基准[9]上进行比较

输入是指训练和推理过程中使用的输入数据。推断时间是根据官方排行榜报告的,与硬件略有差异。红色/蓝色表示最佳/秒。

结论

结论

提出了一种新的基于几何的距离分解方法,将物体的距离分解为最具代表性和最稳定的变量,即物理高度和投影视觉高度,并利用它们恢复距离。这种分解使得距离预测具有可解释性、准确性和鲁棒性。该方法直接从RGB图像中预测三维边界框,结构紧凑,简单高效。实验结果表明,该方法在单目三维目标检测和KITTI数据集上的鸟瞰任务中都达到了SOTA性能,并且可以推广到具有不同相机特性的图像。

论文链接:https://arxiv.org/pdf/2104.03775.pdf

双一流高校研究生团队创建 ↓

专注于计算机视觉原创并分享相关知识 ☞

整理不易,点赞三连!