YOLO-v4目标检测、换脸、视频上色全部实时手机端实现,美国东北大学等提出全自动实时移动端AI框架

极市导读

来自美国东北大学等机构的研究者提出了一种全自动模式化稀疏度感知训练框架,助力深度神经网络在移动端“看得更清,跑得更快”。>>>极市七夕粉丝福利活动:炼丹师们,七夕这道算法题,你会解吗?

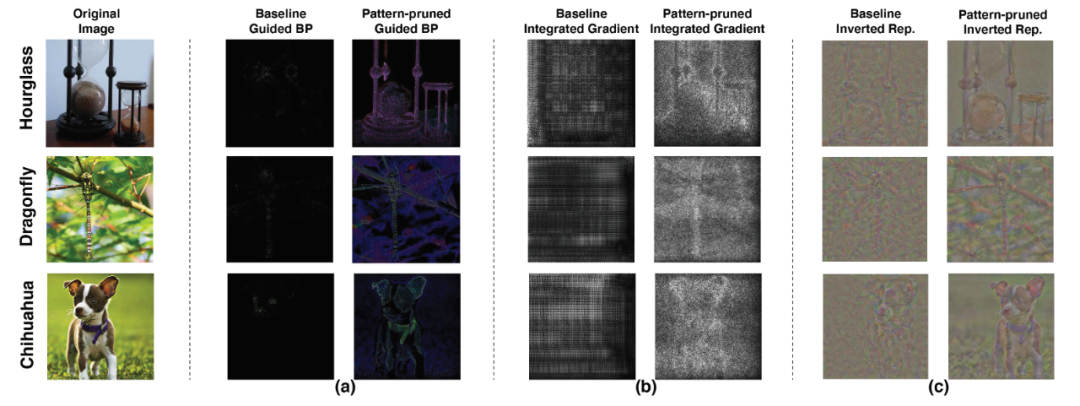

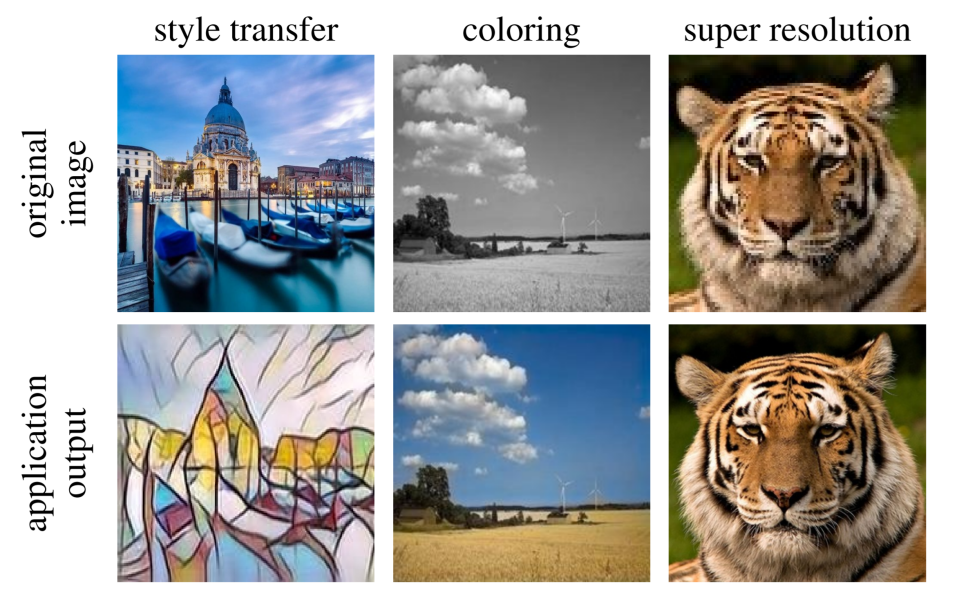

基于模式化稀疏度的剪枝方法能够使深度神经网络在图像识别任务中「看得」更清楚,同时减小了模型尺寸,使模型在移动端「跑得」更快,实现实时推理。

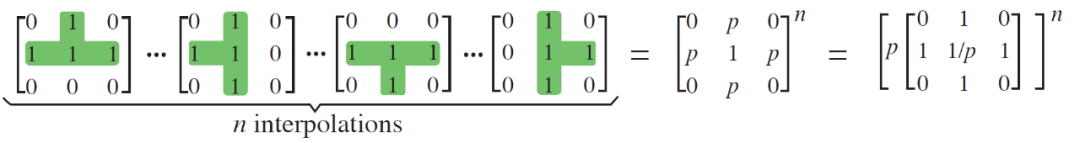

由美国东北大学王言治教授研究团队与美国威廉玛丽学院任彬教授研究团队共同提出,IBM、清华等共同研究的模式化稀疏度感知训练框架,不仅能够同时实现卷积核稀疏模式的全自动提取、模式化稀疏度的自动选择与模型训练,还证明了所提取的模式化稀疏度与理论最佳模式化稀疏度相匹配,并进一步设计了能够利用模型特点实现编译器优化的移动端推理框架,实现了大规模深度神经网络在手机移动端上的实时推理。目前,这篇文章已被 ECCV 2020 会议收录,该文章同时入选 ECCV 2020 demonstration track。

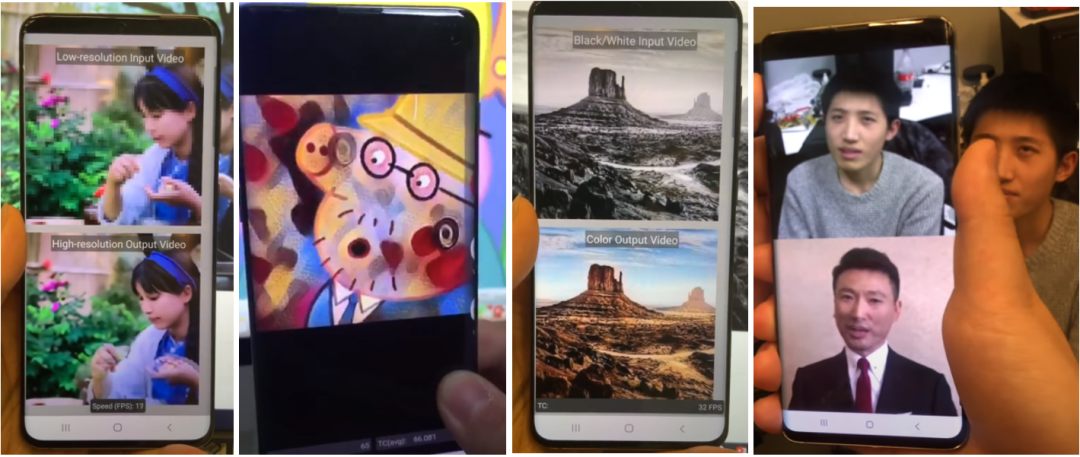

目前,这项技术已经广泛应用在多种类型的人工智能(AI)任务中,包括但不限于:Yolo-v4 目标检测、实时相机风格迁移、AI 实时换脸、相机超分辨率拍摄、视频实时上色等,并且成功落地。以上任务全部在手机端上实现。

官方网站:https://www.cocopie.ai/

B 站:https://space.bilibili.com/573588276

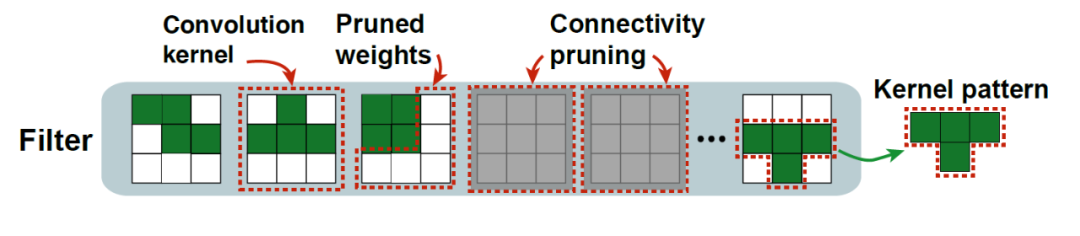

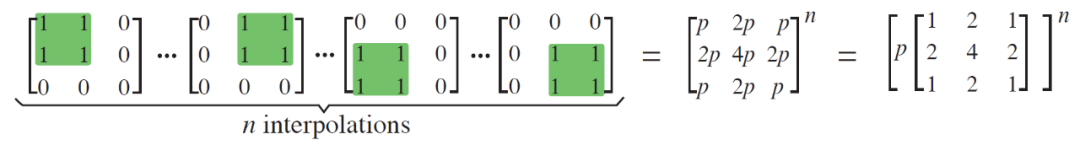

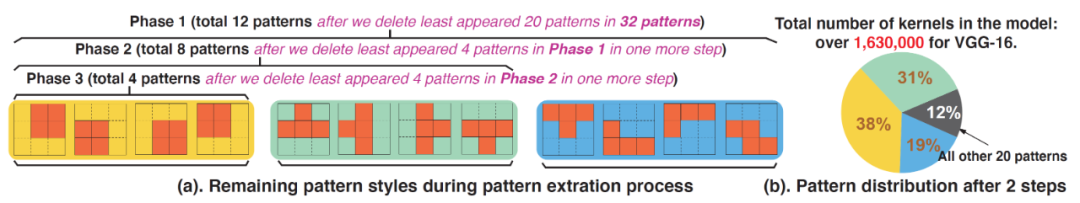

理论层面

算法实现层面

移动端硬件与编译器优化层面

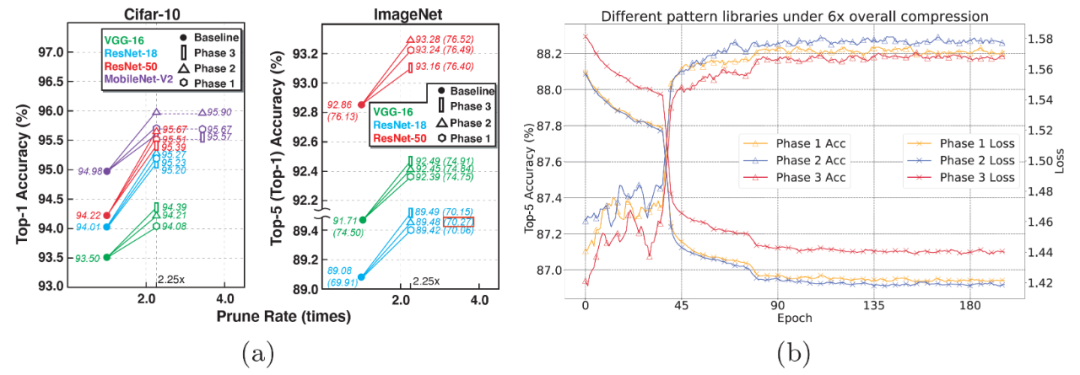

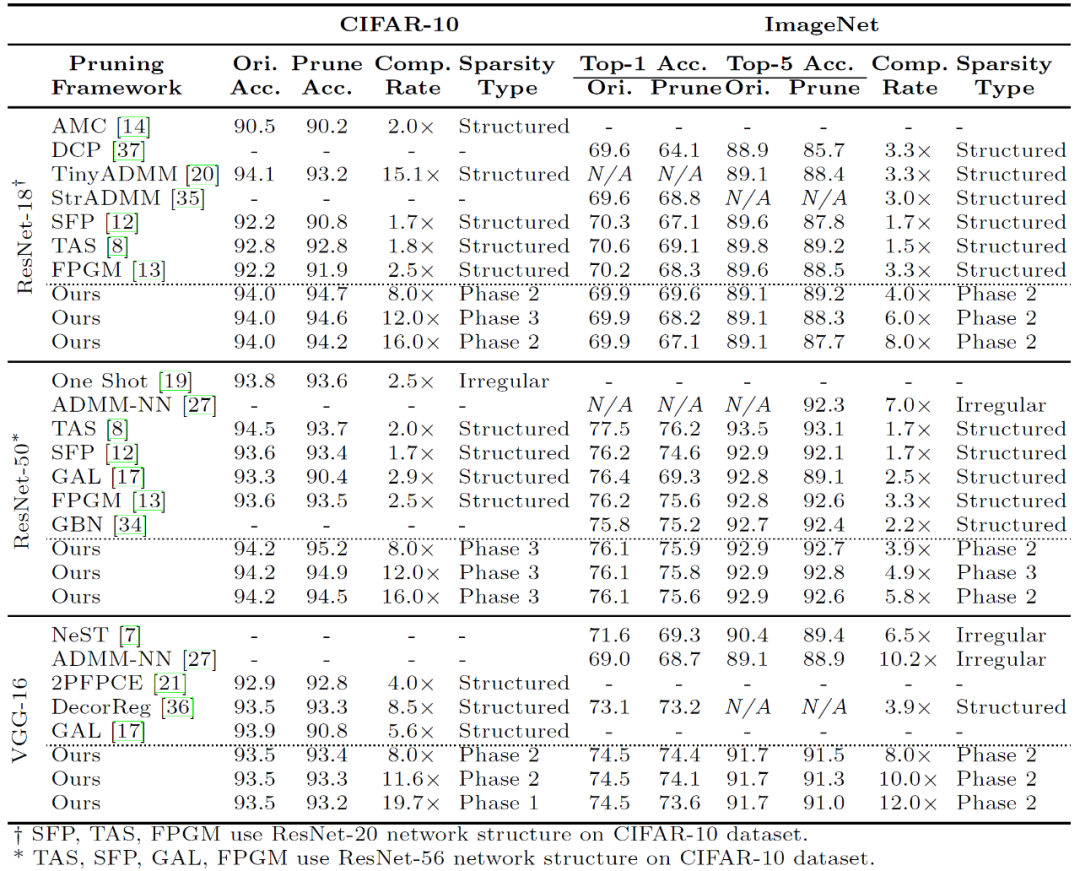

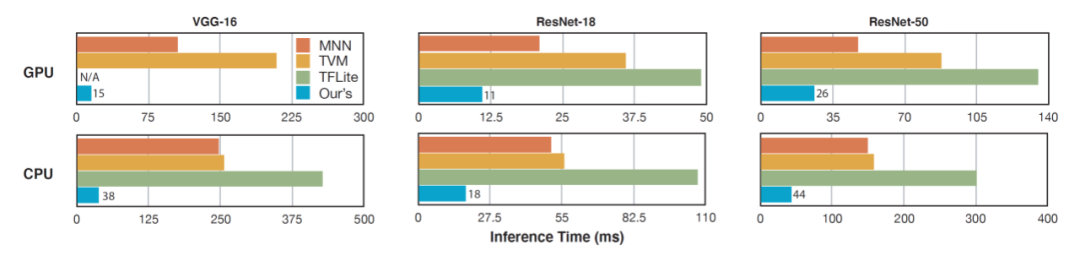

实验结果

推荐阅读

评论