1.75万亿,世界第一!智源发布「悟道2.0」巨模型,中国首个万亿模型参数为GPT-3的10倍

新智元报道

新智元报道

编辑:小匀、亚新

【新智元导读】6月1日,第三届北京智源大会正式开幕。智源副院⻓、清华唐杰教授重磅发布了1.75万亿巨模型「悟道2.0」,是全球最大的预训练模型。

这个初登场的小女孩,火了!

她叫「华智冰」,可以创作音乐,写诗作画。就在刚刚,她已经被清华唐杰实验室录取,成为了唐杰教授的学生。

未来,她将在清华不断成长,变成一个真正的智能人。而她变成智能人的关键就在于她的内核——悟道。

在今天被誉为「AI内行顶级盛会」的2021北京智源大会开幕式上,悟道2.0震撼发布。它在模型规模上爆发级增长,达到1.75万亿参数,创下全球最大预训练模型纪录。

从1750 亿参数量的 GPT-3,到万亿级别的Switch Transformer,参数量的记录在不断刷新。但是,中文作为世界语言的最大使用语言,却没有以其为核心的超大规模预训练模型。今年3月,中国首个超大规模预训练模型「悟道」诞生,中文 PTM 跻身「炼大模型」列队。而悟道2.0的发布,更标志着多项相关记录被刷新!

作为一个万亿模型,悟道强调「最大」、「通用」、「国产」、「知识」。北京智源研究院理事长张宏江指出:人工智能的大模型时代正在到来!超大数据+超大算力+超大模型,将如「电网」一般,成为变革性产业基础建设设施,与驱动信息产业应用发展的核心动力。

除了悟道2.0的发布,智源研究院院长黄铁军还对智源过去一年的研究进展做总体汇报。来自人工智能领域的Yoshua Bengio、朱民、鄂维南等专家讲进行主旨演讲。从真正内行的视角,分享了真正内行认可的重大成果与真知灼见。

1.75万亿!世界最大「悟道2.0」,瞄向世界顶尖水平

人工智能的发展已经进入了「数据+知识」双轮驱动的第三代人工智能。大模型+大算力才是通向通用人工智能一条可行的路径。

智源副院⻓、清华大学教授唐杰表示,「悟道现在虽然是2.0了,但是还是一个小孩子,大家不要指望悟道2.0,智商到达一个成人的水平。我们还再继续努力。」

「悟道」的定位,从一开始就不⽌要做「中国第⼀」,而是瞄向世界顶尖水平。

「我们希望让『悟道』像人⼀样思考,在多项任务中超越图灵测试,迈向通用⼈工智能。」

悟道2.0从原来的文本为主逐渐往更强大,更通用的方向上发力,并可以根据文字生成高精度的图片,根据图像去检索文字,实现图像和文字的互相检索。

目前,悟道2.0在问答、作诗、配文案、视频、绘画、菜谱多项任务中正逼近图灵测试。

智源研究院自 2020 年 10 月正式启动超大规模智能模型「悟道」项目,3月2号就发布了中国首个超大规模的智能模型「悟道1.0」,取得了多项领域的领先突破。

悟道2.0继续大力推动了在大规模预训练模型方面的研发,在文源、文汇、文澜和文溯上分别实现了多项技术突破。

悟道·文源 | 以中文为核心的超大规模预训练语言模型

悟道·文澜 | 超大规模多模态预训练模型

悟道·⽂溯 | 超⼤规模蛋⽩质序列预测预训练模型

悟道·⽂汇 | 面向认知的超大规模新型预训练模型

参数越大,意味着越强的通用人工智能潜能。悟道2.0巨模型打破了之前由OpenAI的GPT-3预训练模型创造的1750亿参数规模,是GPT-3的十倍,再次突破了人们对大模型的想象。

「除了参数规模之外,悟道2.0还可以同时支撑更多的应用,实现更加通用的智能。另外,我们首次在100%的国产超算平台上训练了万亿模型。」

悟道2.0万亿模型在共4.9TB已清洗高质量数据上训练,包含 WuDaoCorpora中文文本数据1.2T、Pile英文文本数据1.2T和WuDaoCorpora图文数据2.5T,实现了中英双语,也一统文本和视觉2大任务领域。

那么,悟道是如何实现这一突破的呢?

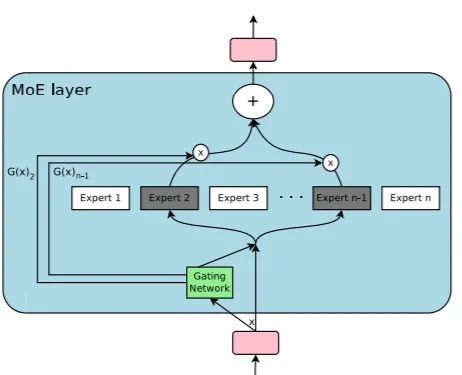

这要归功于开创性的FastMoE技术。它是打破国外技术瓶颈,实现「万亿模型」基⽯的关键。

「过往,谷歌万亿模型的核心技术 MoE (Mixture of Experts) 和其昂贵的硬件强绑定,绝⼤多数人⽆法得到使用与研究机会。」唐杰说道。

MoE是一个在神经网络中引入「若干专家网络 (Expert Network) 」的技术,能直接推动预训练模型经从亿级参数到万亿级参数的跨越,但离不开对谷歌分布式训练框架 mesh-tensorflow 和谷歌定制硬件TPU的依赖。

FastMoE 打破了这⼀限制:作为⾸个⽀持PyTorch框架的MoE系统,它简单易用、灵活、高性能,并且支持大规模并行训练。

新⼀代FastMoE,则为这一万亿模型实现方案补上了最后一块短板,让梦想终成现实。它支持Switch,GShard等复杂均衡策略,⽀持不同专家不同模型。

目前已基于阿里 PAI 平台,探索在支付宝智能化服务体系中的应用,也在国产神威众核超算平台成功部署,100%实现了Transformer的一个核心代码,从底层的Transformer到上层的FastMoE。

那么,悟道2.0如何证明其已接近世界最尖端的人工智能?

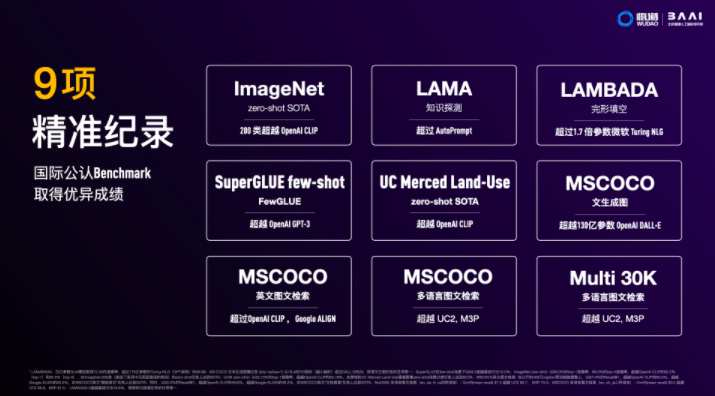

目前,悟道2.0 已经在世界公认的9项 Benchmark 上交出了成绩单,包括ImageNet、LAMA、LAMBADA、SuperGLUE、MSCOCO等项目上超越数个国外智能模型,并在多项任务上获得SOTA。

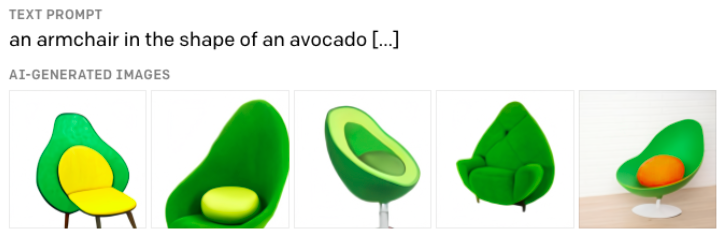

此前,OpenAI的GPT-3成功跨界,摇身一变成为「AI设计师」—— DALL·E,可以按照文字描述准确生成图片。

不久前,唐杰团队发布的CogView,号称「中文版的DALL·E」,而且还能做的更多。

除字生图外,悟道2.0还可直接实现类似 OpenAI CLIP 模型的自评分功能,并且画风多元——国画,油画,卡通画,轮廓画,样样都不在话下!

「文澜团队正式对标的是OPEN AI CLIP。」

实际上,悟道的多项用,都已突破图灵测试,在诗词创作、做对联、文本摘要、 人设问道、绘画等方面,与人类一较高下。

同时,悟道数据团队还构建了全球最大中文语料数据库WuDaoCorpora,这次WuDaoCorpora2.0扩展了多模态和对话两大全新元素,再次升级创造3项全球最大:最大中⽂文本数据集(3TB)、多模态数据集(90TB)与中⽂对话数据集(181G)。

该数据库不仅为悟道项目提供了数据支撑,由于来源广泛及多样性,可广泛用于中文 NLP 领域中多种任务的模型训练,并使模型具有更好的泛化性。

数据经过了专门的清洗,确保隐私和安全及保密问题。

正如智源人工智能研究院理事长张宏江所说,「大模型类似发电厂,把数据(燃料)转换成驱动智能的能力,是下一个AI基础平台。」

图灵奖得主Bengio:从深度学习圣经「花书」开讲

在大会上,智源院长黄铁军回顾了智源的愿景,「分四个层次,聚焦原始创新和核心技术,建立自由探索与目标导向相结合的科研体制,支持科学家勇闯人工智能科技前沿「无人区」,营造全球最佳的学术和技术创新生态,推动北京率先成为国际领先的人工智能创新中心。」

「一年来,智源创新中心建设取得重大进展,例如视网膜芯片技术创新中心,已研制出超高速脉冲视觉芯片,用于高速场景、弱小目标、全时检测等机器视觉应用;安全人工智能创新中心,研发出RealSafe人工智能安全平台、DeepReal深度伪造内容检测平台等,并在金融、能源等行业进行应用等等。」

在主题演讲环节,2018年图灵奖得主、深度学习三巨头之一, 加拿大蒙特利尔大学教授Yoshua Bengio以远程的方式为大家带来了深度学习的讲座。

Bengio以深度学习「圣经」花书Deep learning为题材,介绍了机器学习的基础知识,以及从学术观点出发的学习深度学习所必需的应用数学知识。

人类社会正在从信息时代走向智能时代,智能时代是以数据为基础和出发点的科技,或者说社会过程。

大会上,清华大学国家金融研究院院长朱民博士带来了「数据资产的时代」主题演讲。

自2011年世界经济论坛提出「数据是资产」这一特别的资产类别,到今天已经成为行业共识。

朱民博士提到,「在今天的法律下数字所有权是模糊的,因为数据的非经济学特征决定了所有权不易交易,但是因为他可复用,所有权也没有必要交易。」

数据从资源走向资产,需要构建安全可交易有效率的数据资产生态,所以这个生态必须有科技,必须要有市场,有激励机制,必须有政府,有监管和法律框架,必须有国际社会。

北京大学院士鄂维南则带来了「科学与智能」的演讲,他表示,「科学研究的两项基本主题:寻求基本原理与解决实际问题。」

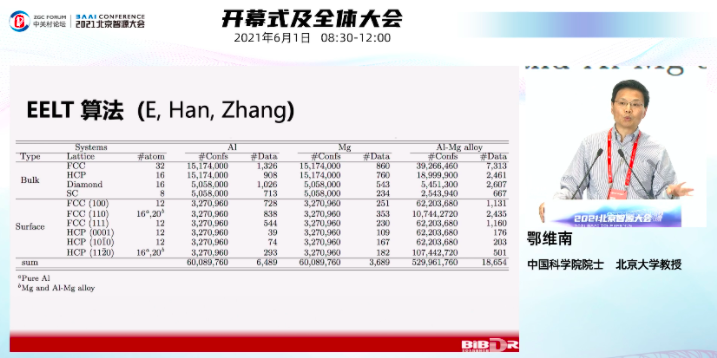

「我们做机器学习,跟大家讲这个图像的学习,跟别人不一样的地方是什么?我们并没有别人给我们准备好数据,而是自己学习。」鄂维南讲道,「这里有一个算法,EELT算法,大家看到这个效果,最右边试图从这种办法来产生一个与镁可靠的物理模型和分子中文学模型。如果你不用这个算法,可以发现对差不多5亿多个构型来做量子力学计算,这5个亿多构型做量子力学计算基本不可替代。用到这个算法可以用不到2亿多个构型做量子力学计算。」

「第二个模型,我们的机器学习模型基于物理原理来的,从量子力学的方式,到方程,到运动的范围。它有一个CGMG,CGMG是什么呢?是数列化的方程。比如做生物、做化工的,那个时候就不能再单独列原子了,它太复杂了,必须对原子体系做数列化。这个应该说是化工生物里面的一个基本。」

国内最高境界AI盛会,还有无数大咖等你解锁

2021年第三届北京智源大会会期自6月1日至6月3日,持续三天,共将举行13场主旨报告/重磅对话,29场由各领域领军学者主导的专题论坛,4场讲习班。

更有图灵奖获得者David Patterson在内的两百余位国内外人工智能领域顶尖学术和产业领袖,将齐聚一堂,共同见证AI大模型时代的启航,探索人工智能发展的美好明天。

访问大会官网,查看很多精彩👇

https://2021.baai.ac.cn/