CVPR 2021 | 基于模型的图像风格迁移

作者:侯云钟 知乎

https://zhuanlan.zhihu.com/p/371101640

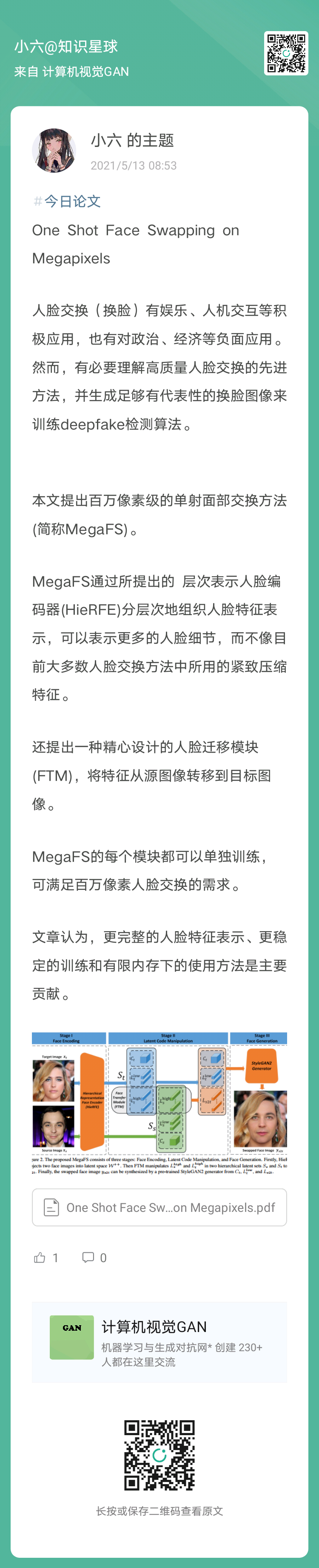

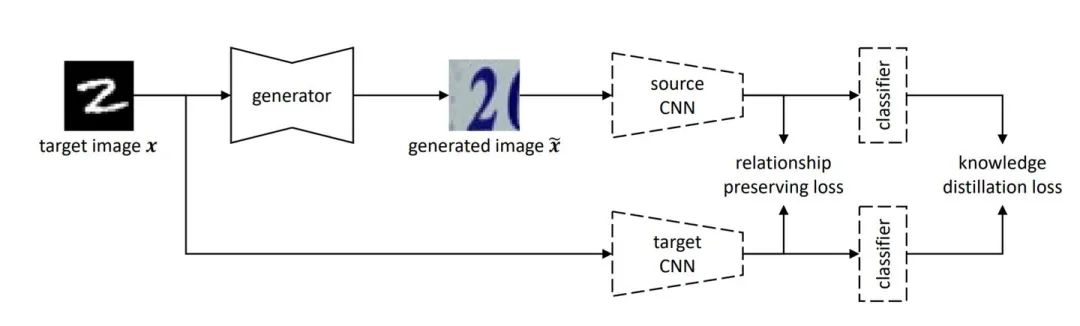

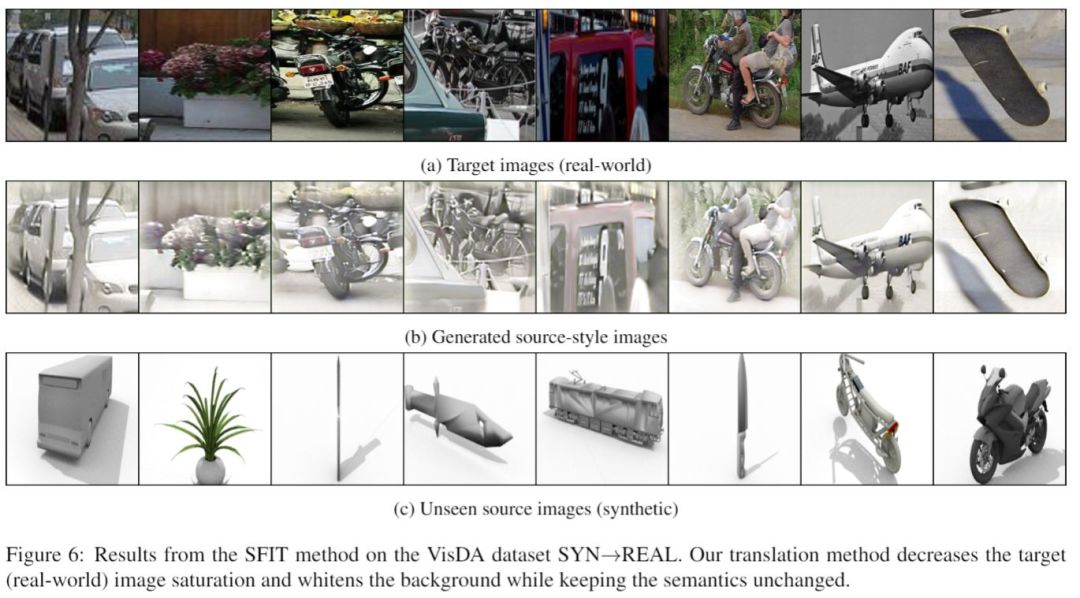

本文从另外一个角度解读,澳洲国立大学郑良老师实验室CVPR 2021新工作《Visualizing Adapted Knowledge in Domain Transfer》。一般而言,我们需要同时利用 两张图片 完成图像的风格迁移(style transfer):一张图片指导内容(content);一张图片指导风格(style)。在本文中, 我们探寻如何在仅利用一张图片作为内容指导的情况下,通过训练好的模型作为指导,将该图片迁移至一种未曾见过的风格。我们首先展示一些示例结果,如下图,在只利用目标(target)图片的情况下,我们可以将其有效迁移至未曾见过的源(source)图片风格。

基于模型的图像风格迁移。在没有利用源图片(c)作为图像风格指导的情况下,我们仅利用目标图片(a),即可将其迁移至源域风格(b)。

题目:Visualizing Adapted Knowledge in Domain Transfer

论文地址:https://arxiv.org/abs/2104.10602

作者:Yunzhong Hou, Liang Zheng

代码:https://github.com/hou-yz/DA_visualization

基于图片的图像风格迁移

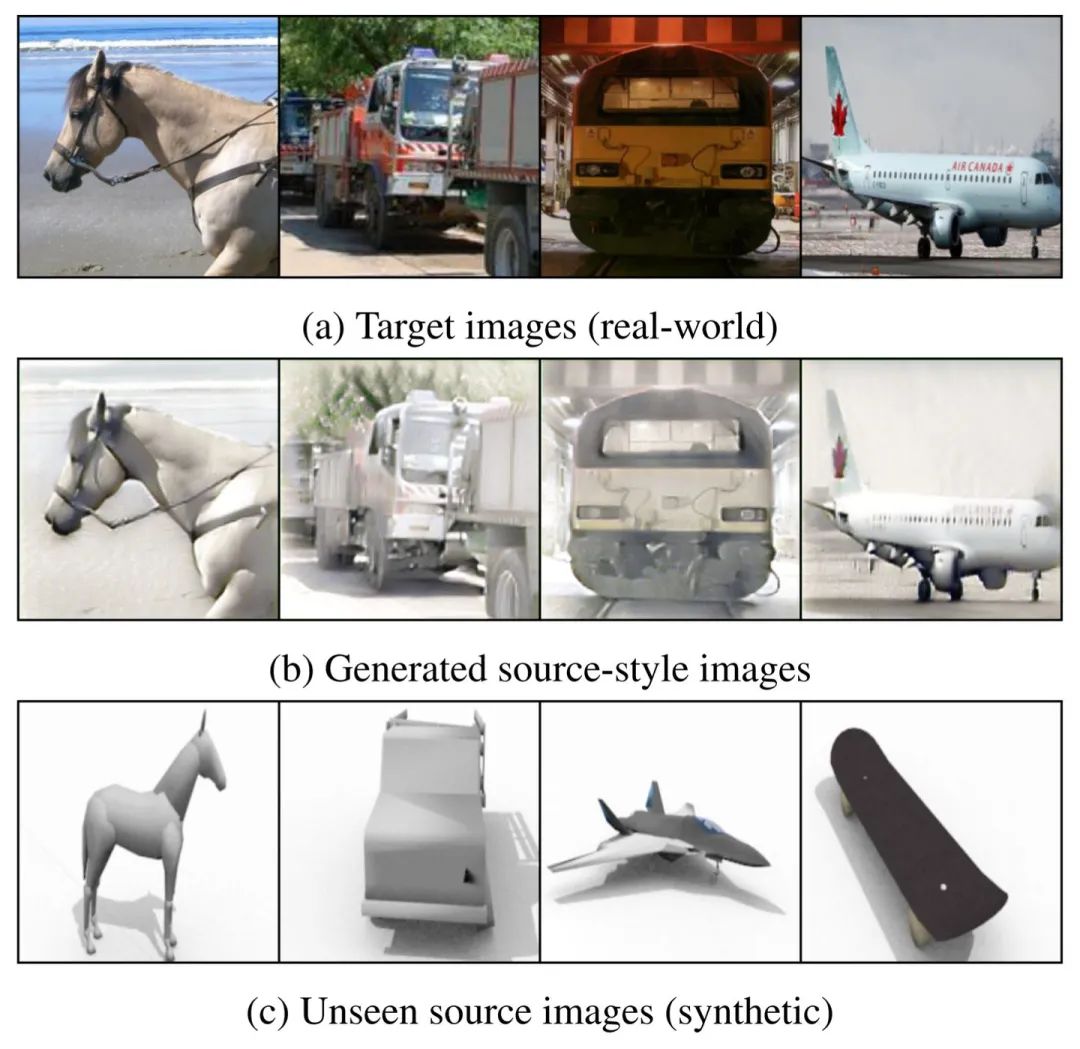

不论是风格迁移(style transfer)还是图像变换(image translation)工作,想要在保持图片内容的条件下变换图像的风格,都需要同时利用两张图片:一张图片  指示内容;一张图片

指示内容;一张图片  指示风格。此外,它们还需要一个特定的评价网络

指示风格。此外,它们还需要一个特定的评价网络  ,来推动图像风格的变换。在风格迁移中(如neural style transfer [1]),

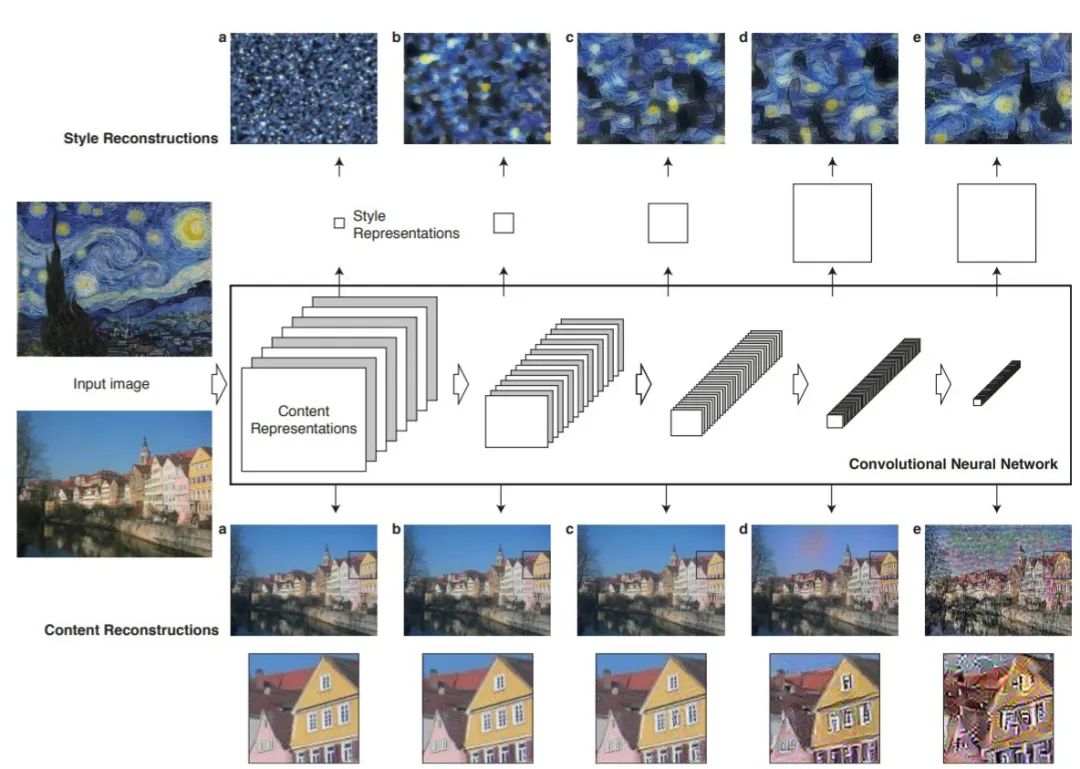

,来推动图像风格的变换。在风格迁移中(如neural style transfer [1]),  可能是ImageNet预训练VGG的特征分布;在图像变化中(如cyclegan [2]),

可能是ImageNet预训练VGG的特征分布;在图像变化中(如cyclegan [2]),  可能是两个域分别对应的判别器网络(discriminator)。

可能是两个域分别对应的判别器网络(discriminator)。

neural style transfer [1] 利用内容图像、风格图像、和基于ImageNet预训练的VGG的评价网络

cyclegan [2] 利用内容图像数据集、风格图像数据集(两者互易)、和判别器形式的评价网络

对于传统的风格迁移,可以形式化的记为  ,其中

,其中  为生成图片,

为生成图片,  分别代表风格图像和内容图像,

分别代表风格图像和内容图像,  代表某一特定评价网络。

代表某一特定评价网络。

基于模型的图像风格迁移

在本文中,不同于两张图片,我们利用训练好的两个模型,来指导图像的风格迁移。特别的,我们考虑域迁移(domain adaptation)的任务情景:给定源域(source domain)和目标域(target domain),以及训练好的适用于源域的网络  和适用于目标域的网络

和适用于目标域的网络  ,且默认这两个网络共享分类层

,且默认这两个网络共享分类层  (域迁移中常见设置)。

(域迁移中常见设置)。

域迁移:可以得到分别适用于源域和目标域的两个神经网络模型,以此推动图像风格迁移

基于这两个网络,我们探寻能否将目标域图像直接迁移至源域风格。我们可以进一步给出任务目标的形式化定义  ,其中图片

,其中图片  指导生成图片

指导生成图片  的内容。对比传统的图像风格迁移

的内容。对比传统的图像风格迁移  ,基于模型的风格迁移存在以下区别:

,基于模型的风格迁移存在以下区别:

不能基于 内容-风格 图像对  训练,而是凭借源域模型

训练,而是凭借源域模型  和目标域模型

和目标域模型  指导图像风格差异;

指导图像风格差异;风格迁移的标准不依赖于特定的评价网络  ,而仍是依赖源域模型

,而仍是依赖源域模型  和目标域模型

和目标域模型  。

。

Source-Free Image Translation 方法

,我们设计了一套方法,完成基于模型的图像风格迁移任务。特别的,我们只利用目标域图片

,我们设计了一套方法,完成基于模型的图像风格迁移任务。特别的,我们只利用目标域图片  作为内容指导(即作为

作为内容指导(即作为  ),而完全避免在图像迁移的过程中利用源域图片

),而完全避免在图像迁移的过程中利用源域图片  。由此,我们的方法也得名source-free image translation(SFIT),即不依赖源域数据的图像风格迁移。

。由此,我们的方法也得名source-free image translation(SFIT),即不依赖源域数据的图像风格迁移。

,我们训练一个生成器

,我们训练一个生成器  来将其迁移至(源域)风格,生成图片

来将其迁移至(源域)风格,生成图片  。面对原始的内容图片

。面对原始的内容图片  和生成的风格化图片

和生成的风格化图片  ,传统的基于图像的风格迁移和本文中提出的基于模型的风格迁移存在以下区别:

,传统的基于图像的风格迁移和本文中提出的基于模型的风格迁移存在以下区别:基于图片的风格迁移(neural style transfer)约束生成图片  内容上接近

内容上接近  (content loss: 评价网络

(content loss: 评价网络  特征图之差),风格上接近

特征图之差),风格上接近  (style loss: 评价网络

(style loss: 评价网络  特征图分布的区别)

特征图分布的区别)基于模型的风格迁移(SFIT)约束这内容图片  和生成的风格化图片

和生成的风格化图片  在经过(预训练且固定的)目标域模型

在经过(预训练且固定的)目标域模型  和源域模型

和源域模型  后,能获得相似的输出。我们通过约束最终输出的相似和特征图的分布相似,完成对生成图片内容和风格上的约束。

后,能获得相似的输出。我们通过约束最终输出的相似和特征图的分布相似,完成对生成图片内容和风格上的约束。

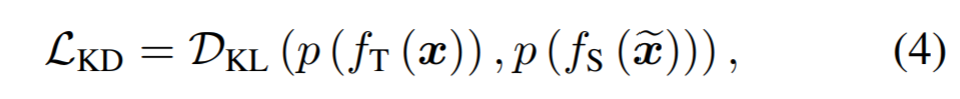

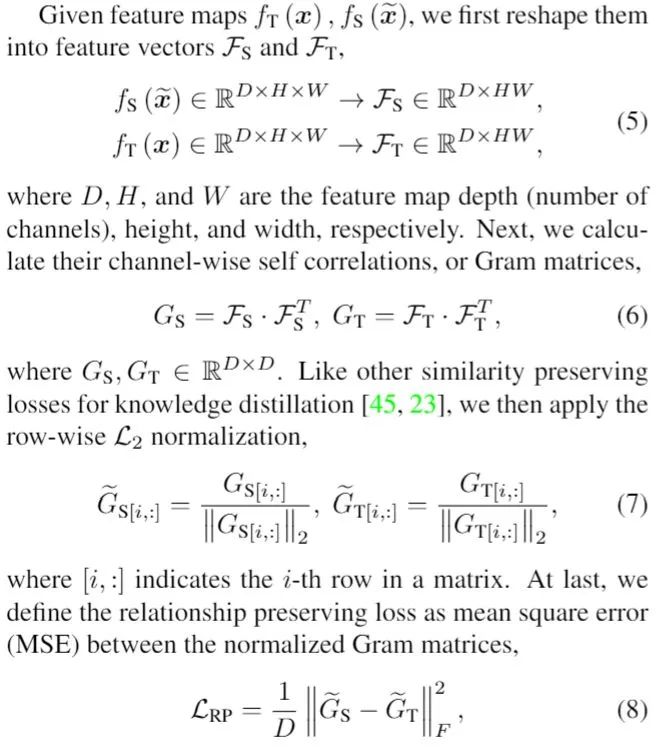

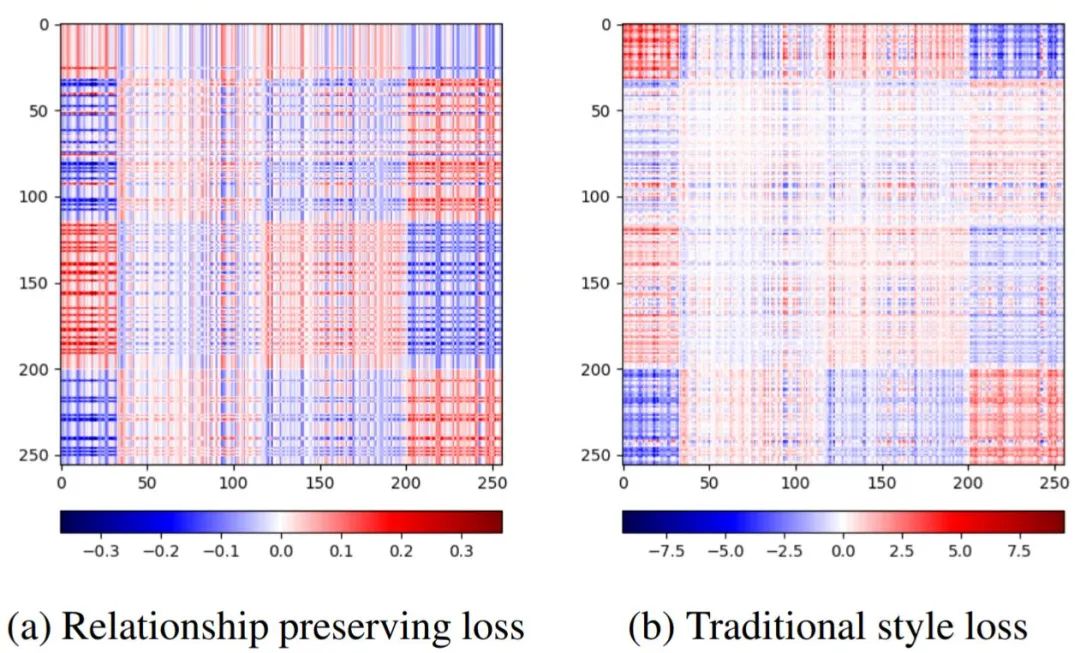

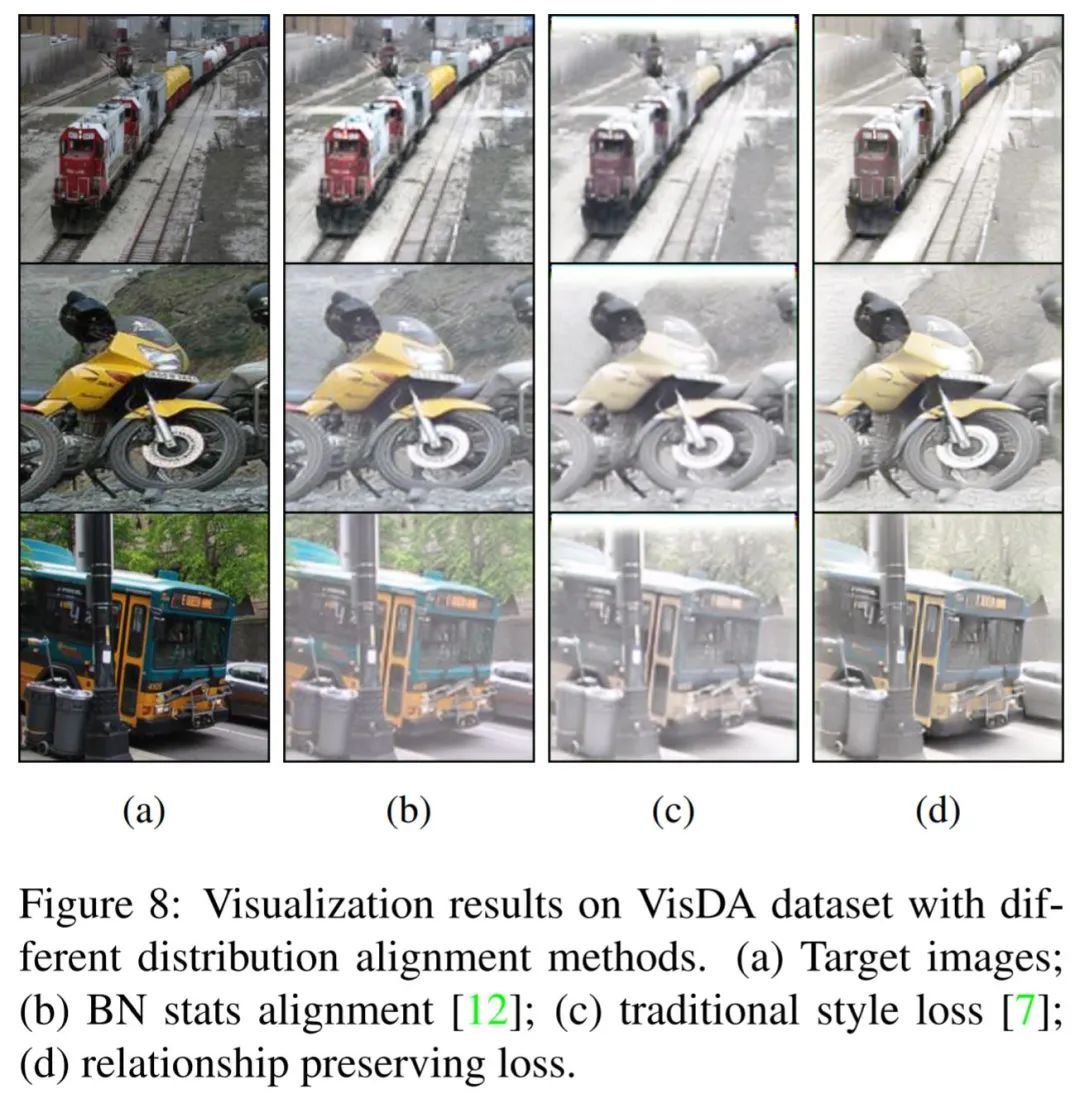

损失函数设计

传统的style loss约束两张图片在同一个评价网络  上特征图分布相似;

上特征图分布相似;relationship preserving loss约束两张图片分别经过源域模型  和目标域模型

和目标域模型  后,得到的特征图归一化分布相似。

后,得到的特征图归一化分布相似。

为何约束不同网络的特征图分布可以迁移风格?

和一个适用于目标域的网络

和一个适用于目标域的网络  共享分类层

共享分类层  (域迁移中常见设置),我们可以认为这两个网络在通道维度上语义是相对对齐的(共享分类层,需要global average pooling之后的特征向量在通道上对齐,才能在两个不同的域上都获得较好的结果)。鉴于此,我们可以认为,

(域迁移中常见设置),我们可以认为这两个网络在通道维度上语义是相对对齐的(共享分类层,需要global average pooling之后的特征向量在通道上对齐,才能在两个不同的域上都获得较好的结果)。鉴于此,我们可以认为, 和

和  这两个网络以一种松散的方式,保持着类似于同一网络的特性,即通道维度语义对齐。

这两个网络以一种松散的方式,保持着类似于同一网络的特性,即通道维度语义对齐。

实验结果

Reference

[1]. Gatys, L. A., Ecker, A. S., & Bethge, M. (2016). Image style transfer using convolutional neural networks. InProceedings of the IEEE conference on computer vision and pattern recognition(pp. 2414-2423).

[2]. Zhu, J. Y., Park, T., Isola, P., & Efros, A. A. (2017). Unpaired image-to-image translation using cycle-consistent adversarial networks. InProceedings of the IEEE international conference on computer vision(pp. 2223-2232).

[3]. Li, Y., Wang, N., Liu, J., & Hou, X. (2017, August). Demystifying neural style transfer. InProceedings of the 26th International Joint Conference on Artificial Intelligence(pp. 2230-2236).

文仅交流,侵删

猜您喜欢:

附下载 |《TensorFlow 2.0 深度学习算法实战》