一个算法统治一切!DeepMind提出神经算法推理,深度学习和传统算法融合再现奇迹?

新智元报道

新智元报道

来源:VB

编辑:David、霜叶

【新智元导读】一个算法统治一切!DeepMind提出神经算法推理(NAR),用深度学习模型模仿任何经典算法,同时实现传统算法的泛化性和神经网络的最优解的完美结合。

雄心勃勃的DeepMind,要在深度学习网络和传统算法之间架桥了!

众所周知,经典算法是使软件能够风行世界的原因,但这些算法所使用的数据并不总是能反映真实世界。

而深度学习是当今AI应用的源动力,但深度学习模型需要重新训练,才能应用于最初设计的领域。

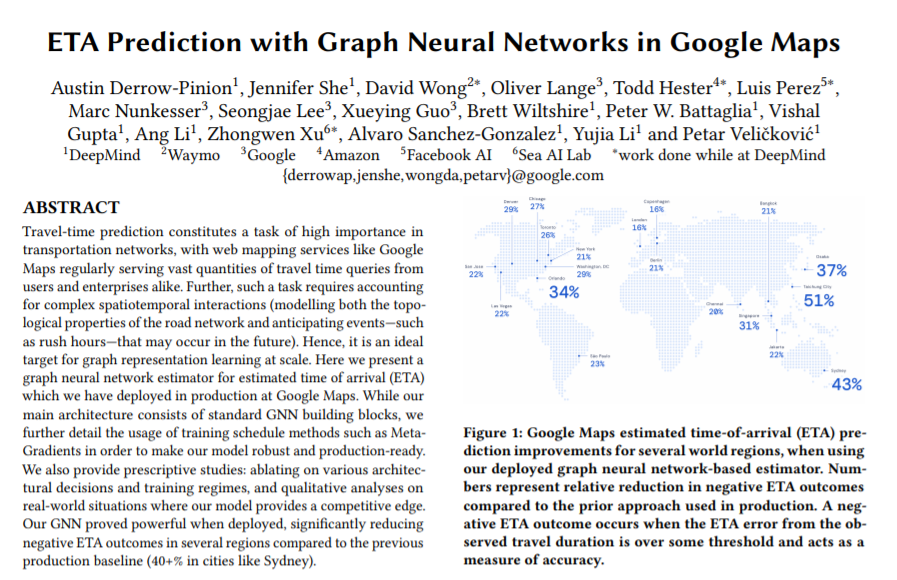

现在,DeepMind想开创一条新路,他们要找到一种深度学习模型,模仿任何经典算法,并在现实世界实现功能。

只用一个算法,统治一切!

近年来,DeepMind因AI领域的一些标志性成就而屡上头条。AlphaGo打破人类选手对围棋的统治,AlphaFold解决了生物学领域50年来的大难题。

现在,DeepMind将目光投向另一个重大挑战:将深度学习与计算机科学经典算法联系起来。

经典算法和深度学习网络的本质不同

要实现这个目标,首先要理解二者的主要区别。即:经典算法和深度学习网络的性质有什么不同?

DeepMind的两位研究人员Charles Blundell和Petar Veličković专门谈了这个问题。他们都在DeepMind担任高级研究职位。

他们认为,二者之间的主要区别在于「泛化性」和「最优解」问题。

Blundell表示,第一,算法在大多数情况下不会改变。算法由一组固定的规则组成,这些规则在某些输入上执行。对于算法获得的任何类型的输入,算法都会在合理的时间内给出合理的输出。更改输入的大小,算法会继续工作。

第二,算法可以串连在一起。算法的性质决定了:给定某种输入,只产生某种输出。我们可以把一个算法输出作为其他算法的输入,构建一个完整的堆栈。

即使是简单任务,要用深度学习来完成算法的工作也很困难。比如一个最简单的任务:复制文本。输出为输入的本文复制。

这么简单的任务,要深度学习完成就很麻烦。如果只在1-10个字符长度上进行训练,那么当任务字符长度超出时,输出就会出问题,因为它学不会算法中的核心思想。

如果任务再复杂一点,比如涉及排序,训练神经网络的性能会更差。而这对于传统意义上的算法来说根本不是问题。

总结一下就是:

深度学习网络的泛化性能很差,但在充分训练的特定问题上,往往比算法产生更优化的结果。

传统算法是可泛化的。改变输入数据的大小和类型,原来可用的算法程序依然可用。但算法有时产生的结果可能不是最优的。

怎么同时解决这两个问题,同时获得算法和深度学习的优势?

神经算法推理:一个算法,统治一切!