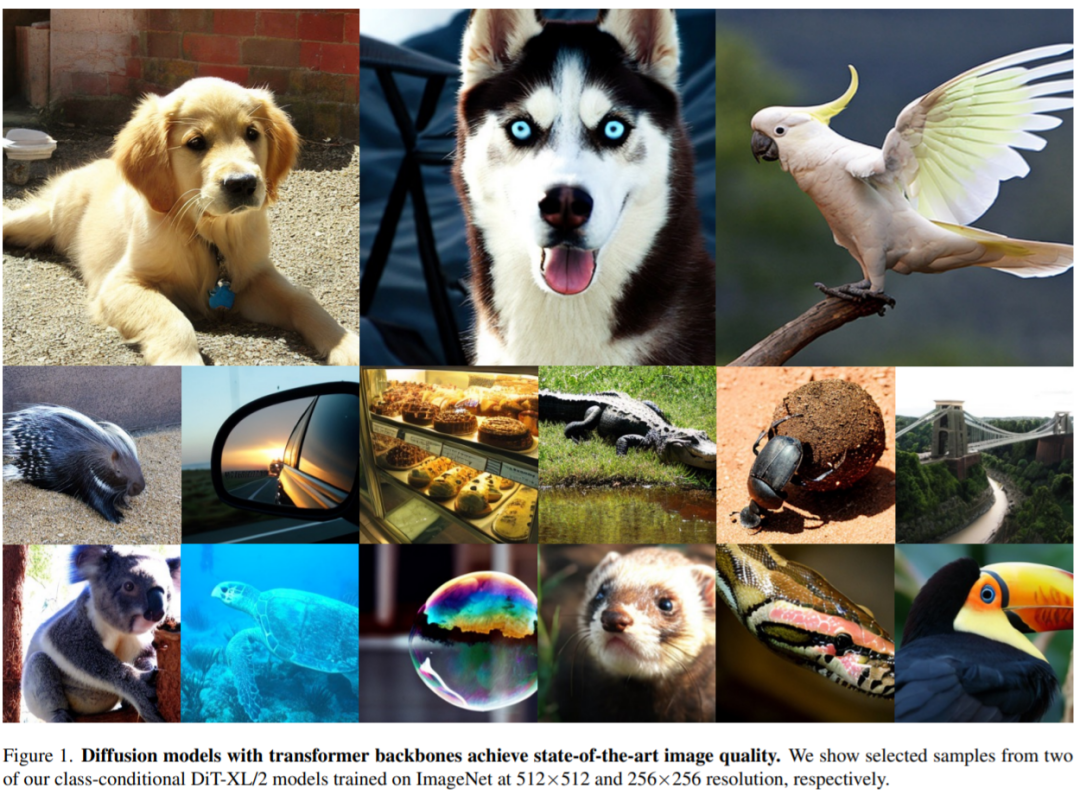

统治扩散模型的U-Net要被取代了,谢赛宁等引入Transformer提出DiT

Python学习与数据挖掘

共 3167字,需浏览 7分钟

· 2023-01-03

↓推荐关注↓

近几年,在 Transformer 的推动下,机器学习正在经历复兴。过去五年中,用于自然语言处理、计算机视觉以及其他领域的神经架构在很大程度上已被 transformer 所占据。

论文地址:https://arxiv.org/pdf/2212.09748.pdf 项目地址:https://github.com/facebookresearch/DiT 论文主页:https://www.wpeebles.com/DiT

长按或扫描下方二维码,后台回复:加群,即可申请入群。一定要备注:来源+研究方向+学校/公司,否则不拉入群中,见谅!

(长按三秒,进入后台)

推荐阅读

评论

扩散模型之DDIM:为扩散模型的生成过程提速!

点蓝色字关注 “机器学习算法工程师 ” 设为 星标 ,干货直达! “What I cannot create, I do not understand.” -- Richard Feynman 上一篇文章扩散模型之DDPM带你深入理解扩散模型DDPM介绍了经典扩散模型DDPM的原理和...

机器学习算法工程师

1

扩散模型的原理及实现(Pytorch)

来源:机器学习算法那些事本文约6500字,建议阅读13分钟本文完整的介绍了有关扩散模型的必要知识,并且使用Pytorch进行了完整的实现。扩散模型的导火索,是始于2020 年所提出的DDPM(Denoising Diffusion Probabilis...

数据派THU

0