FloydHub 2020年最佳机器学习书籍之一《可解释机器学习》中文版来啦!

说到机器学习,想必大家都不陌生。

机器学习是计算机基于数据做出和改进预测或行为的一套方法。

那什么是可解释机器学习呢?

比如,我们通过机器学习的算法得到了某个结果,那这个结果是否是可信的呢?我们希望理解这个结果背后的原因。这就是可解释机器学习要研究的问题。

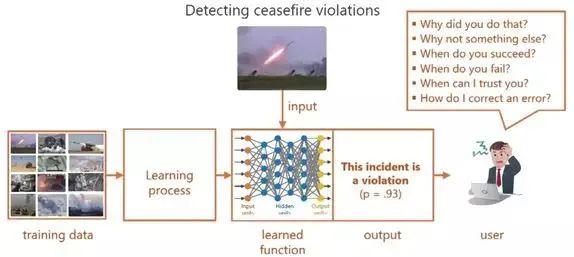

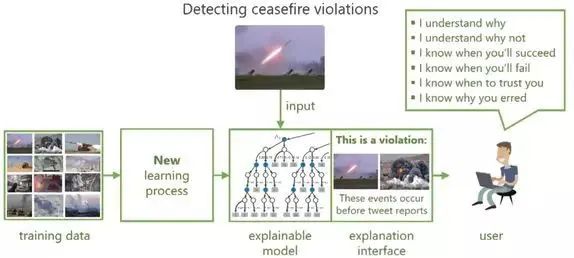

如下图所示,根据一般网络给出的决策时,缺乏可解释性的结果让使用者感到困惑,严重限制了其在现实任务中的广泛应用。

虽然机器学习与人工智能的研究不断取得了突破性进展,然而高性能的复杂算法、模型及系统普遍缺乏决策逻辑的透明度和结果的可解释性,导致在涉及需要做出关键决策判断的国防、金融、医疗、法律、网络安全等领域或要求决策合规的应用中,机器学习技术及系统难以大范围应用。

比如,医生不能仅根据模型的分类置信度进行诊断,金融机构不能仅凭借模型的输出轻易判断违约风险,军方不能仅依赖自动的图像识别执行打击任务,安全公司也不能仅通过模型检测结果完全自动化威胁响应。

而可解释机器学习主要研究如何使得机器学习系统的行为对人类更透明、更易懂、更可信,因此近年来逐渐成为研究热点。

Gartner已将可解释人工智能(XAI)技术列为数据和分析技术领域的TOP 10重要趋势之一。

KDD、ICML、NIPS、AAAI及IJCAI等著名国际性会议都有覆盖可解释机器学习话题的Workshop。

由美国国防部资助的美国国防高级研究计划局(DARPA)于2017年发起了XAI计划,全面开展了对可解释机器学习的研究。

2018年,欧洲委员会向欧洲议会、欧洲理事会等欧洲官方机构发布的有关欧洲人工智能的函件中强调对可解释机器学习的需求。

工业界方面,包括微软、谷歌、Oracle等诸多科技巨头,都在开展可解释机器学习相关技术的研发。

《可解释机器学习》(Interpretable Machine Learning)正是在这样的背景下撰写和出版的。

本书的作者Christoph Molnar是数据科学家和可解释机器学习博士。

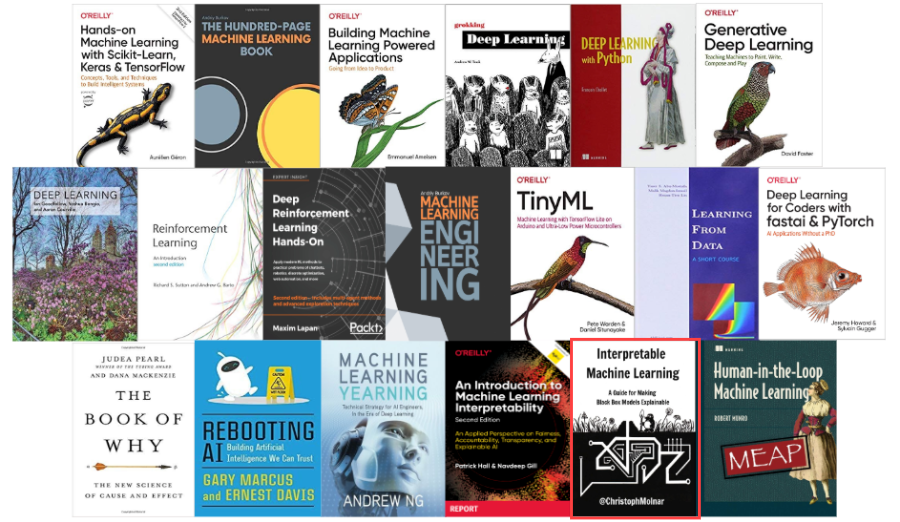

他用两年时间完成本书第一版,随机引起业界轰动,被FloydHub评定为2020年最佳机器学习书籍之一。

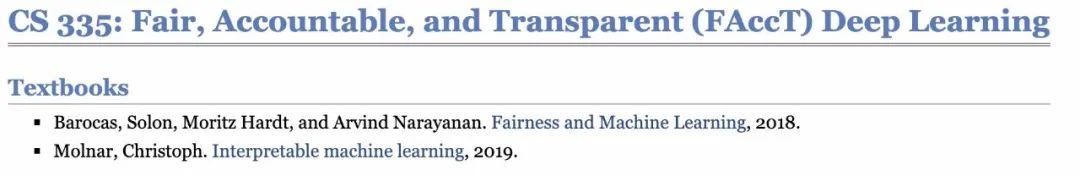

此外,本书还入选了美国斯坦福大学CS335课程教材。

该书作为可解释机器学习领域的第一本著作,对可解释机器学习的思想进行了解剖,并对可解释机器学习的核心概念进行了清晰简明的描述。同时,该书将可解释机器学习算法的直观描述、理论描述、实战使用过程和优缺点结合起来,从多维度帮助读者理解算法,具有极强的实用价值。

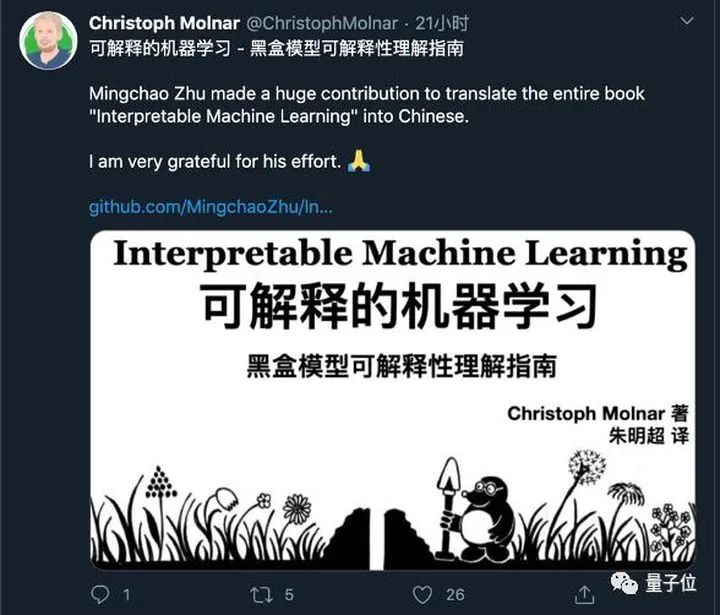

在国内,该书延续了在国际上的热度和口碑。复旦大学朱明超对该书的初步翻译译本登上GitHub热搜榜首,引起众多关注。

朱明超在翻译过程中和原作者进行了多次讨论,经过多次修改和打磨,已经将该著作的思想和内容以符合中国人理解的思维方式进行了高质量的翻译!中文版还得到了Christoph Molnar本人在Twiter上的推荐。

如今,本书中文版已经上市,并受到读者好评!

▼

希望这本书可以帮你获得打开黑盒模型的魔法哦!

▊《可解释机器学习:黑盒模型可解释性理解指南》

[德] 克里斯托夫·莫尔纳(Christoph Molnar) 著

朱明超 译

打开AI黑盒,揭秘机器学习模型内部机制

8种模型+13种方法,带你跨入模型可解释之门!

本书探索了可解释性的概念,介绍了简单的、可解释的模型,例如决策树、决策规则和线性回归,重点介绍了解释黑盒模型的、与模型无关的方法,如特征重要性和累积局部效应,以及用Shapley值和LIME解释单个实例预测。

本书对所有的解释方法进行了深入说明和批判性讨论,例如它们如何在黑盒下工作、它们的优缺点是什么、如何解释它们的输出。本书将解答如何选择并正确应用解释方法。本书的重点是介绍表格式数据的机器学习模型,较少涉及计算机视觉和自然语言处理任务。

(扫码了解本书详情)

如果喜欢本文

欢迎 在看丨留言丨分享至朋友圈 三连

热文推荐

▼点击阅读原文,获取本书详情~