【NLP】新分类!全总结!最新Awesome-SLU-Survey资源库开源!

作者:哈工大SCIR 覃立波、谢天宝等

指导老师:哈工大SCIR 车万翔教授

简介

口语语言理解(Spoken Language Understanding,SLU)作为任务型对话系统的核心组件,目的是为了获取用户询问语句的框架语义表示(semantics frame)信息,进而将这些信息为对话状态追踪模块(DST)以及自然语言生成模块(NLG)所使用。

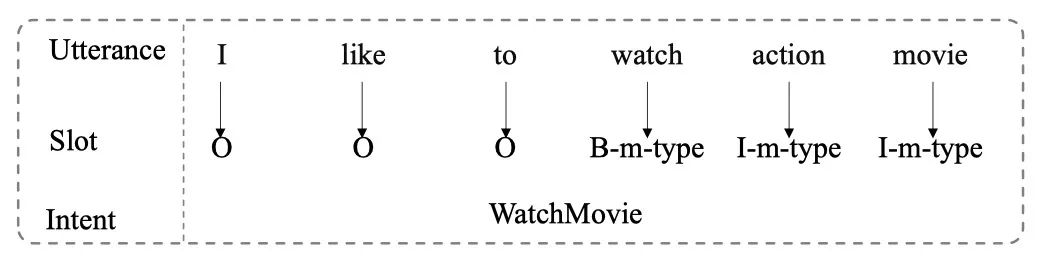

SLU任务通常包含以下两个任务:意图识别任务(intent detection)和槽位填充任务(slot filling),以下图的句子“I like to watch action movie”为例,这两个任务的输出对应分别为WatchMovie和O、O、O、B-movie-type、I-movie-type、I-movie-type。

近年来,SLU领域获得了巨大的突破,在经典数据集ATIS和SNIPS上的指标也做到了97%、99%以上。那么该方向的未来如何,目前进展又是如何呢?

我们最近整理了一个仓库,包含了SLU领域最新工作的总结,还涵盖了一些前沿方向的讨论,并且也包括了一些开源资源总结,希望能对这个领域的发展有一点帮助,值得对SLU感兴趣的同学了解、关注。

资源地址:https://github.com/yizhen20133868/Awesome-SLU-Survey

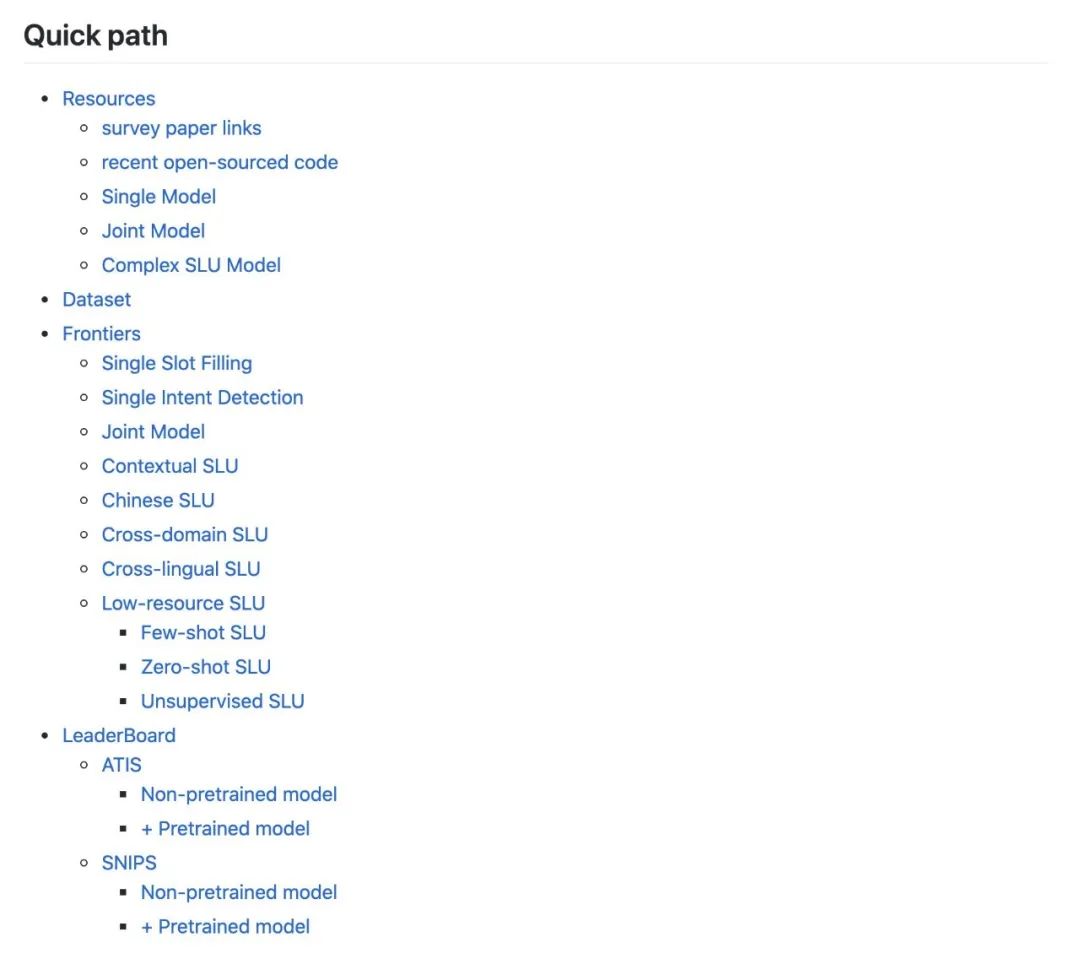

下面简单介绍一下这个仓库,总体目录如下。

一、新分类,全总结

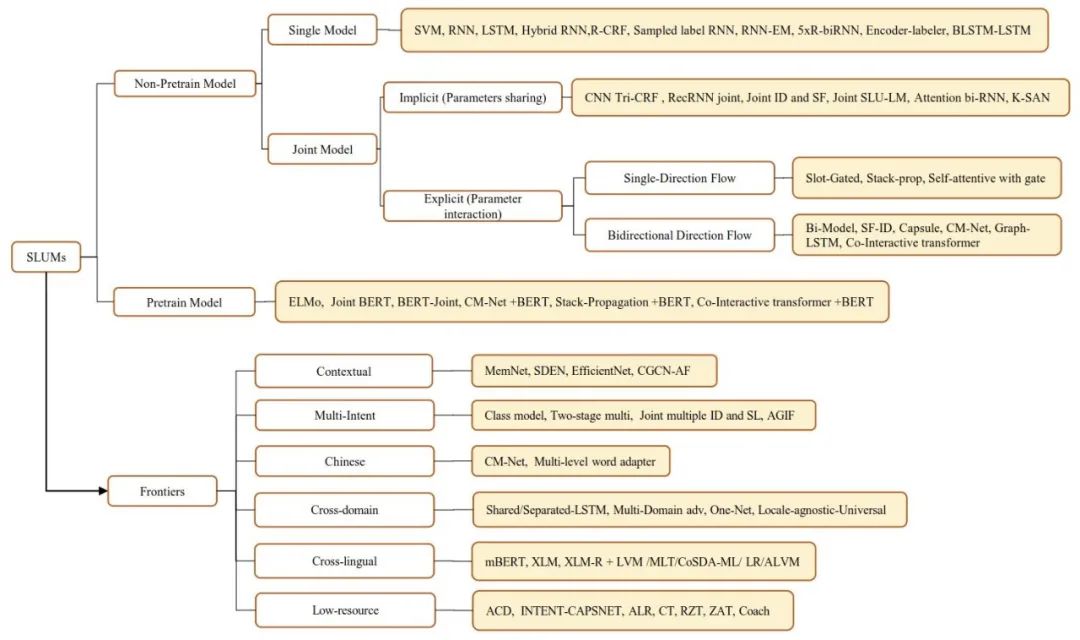

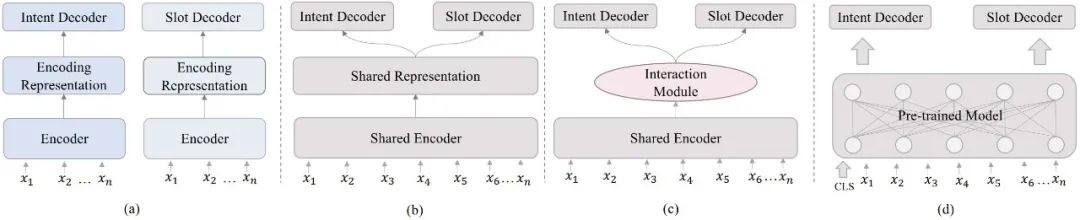

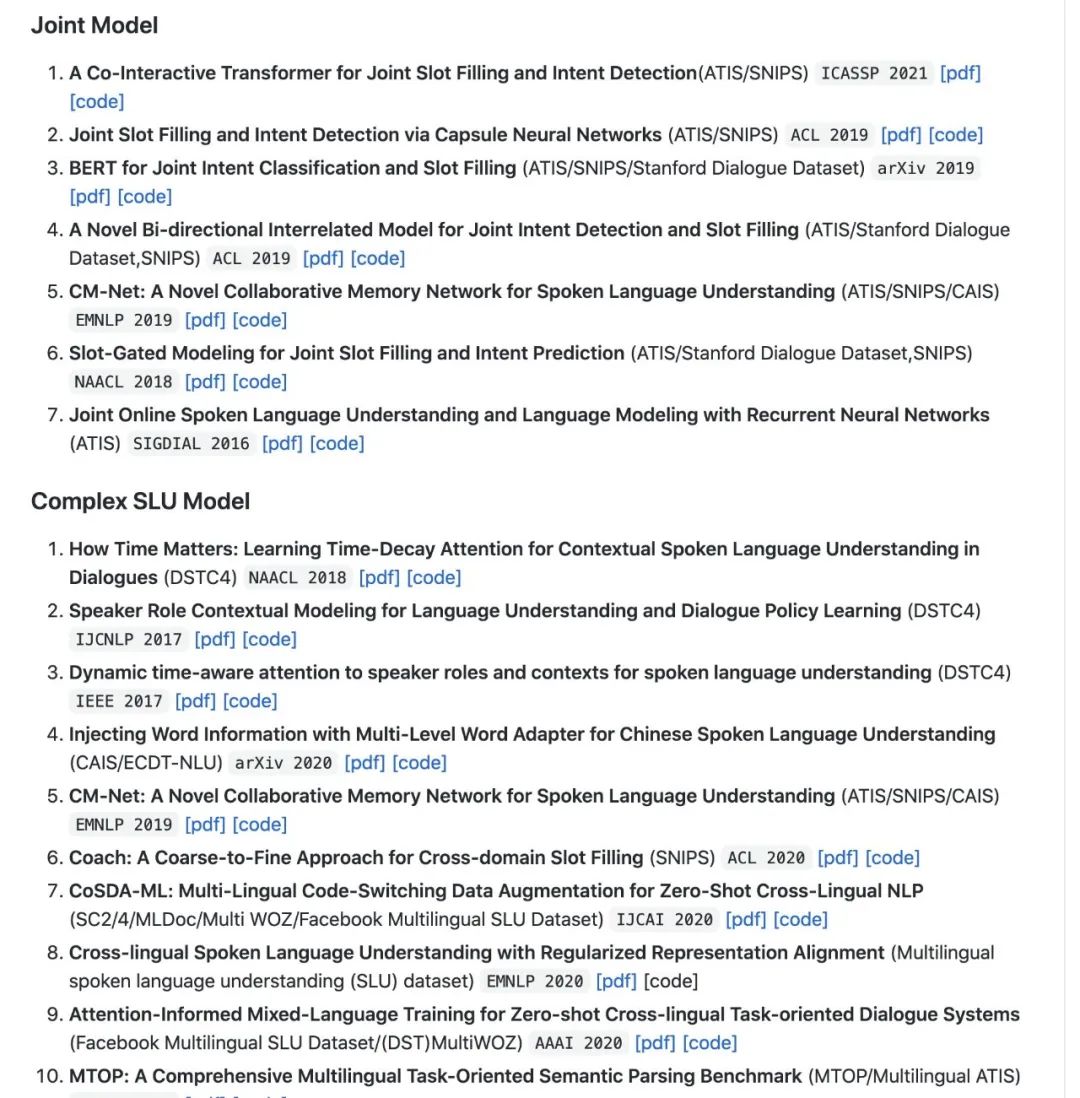

作者将目前的这个SLU仓库的资源按照single models、joint models、pre-trained models、frontiers for SLU来进行归纳整理。

其中对于联合模型作者还分为了隐式和显式建模,值得了解。

二、目前SLU的相关资源

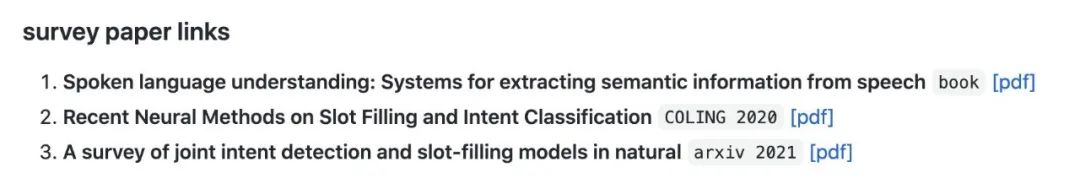

包括一些survey paper,来帮助大家快速了解这个领域。

三、开源的SLU论文仓库整理

然后还介绍了目前已经开源的SLU论文仓库,可以帮助大家利用代码进行学习。

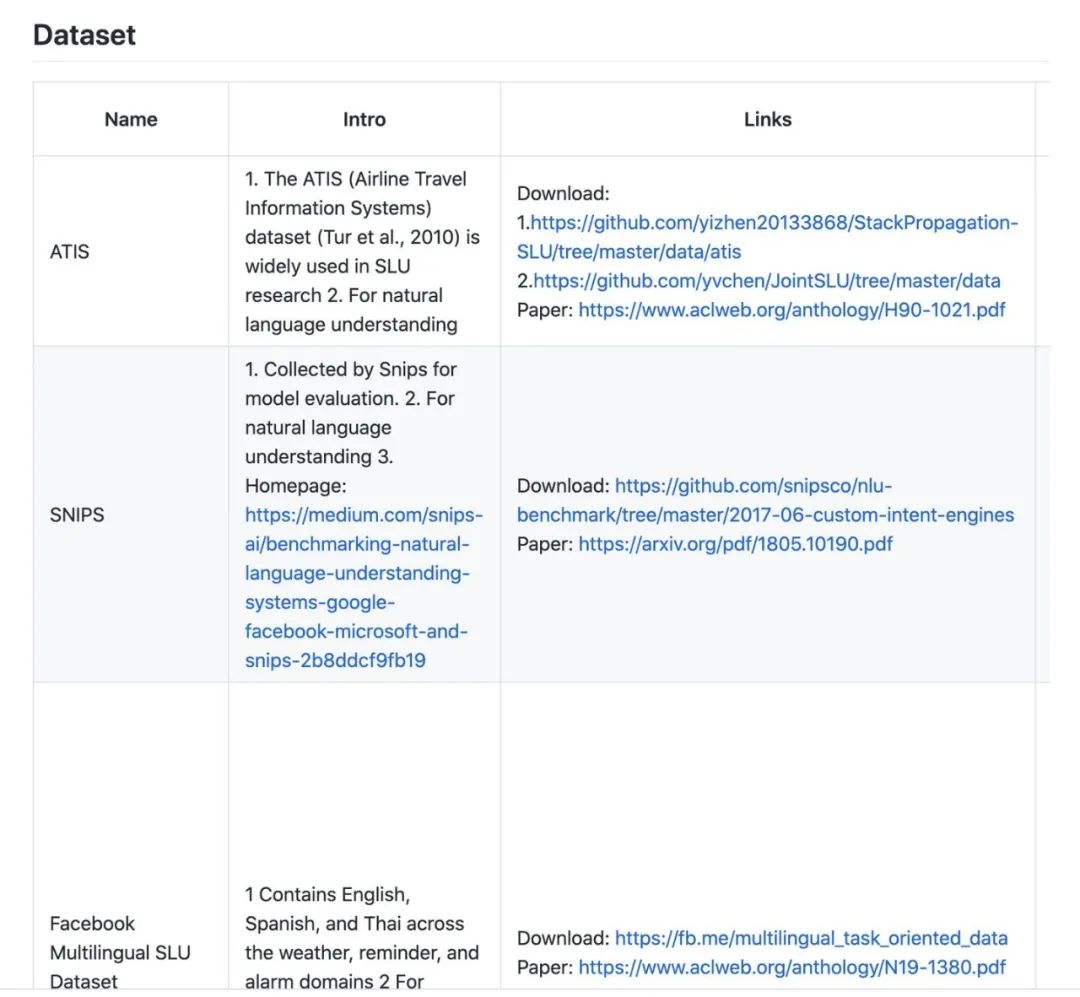

四、数据集整理及下载地址

对于SLU用到的经典数据集,我们不仅提供了数据集的描述、简介,还有对应的下载地址,极大的方便大家找到相关的数据集。

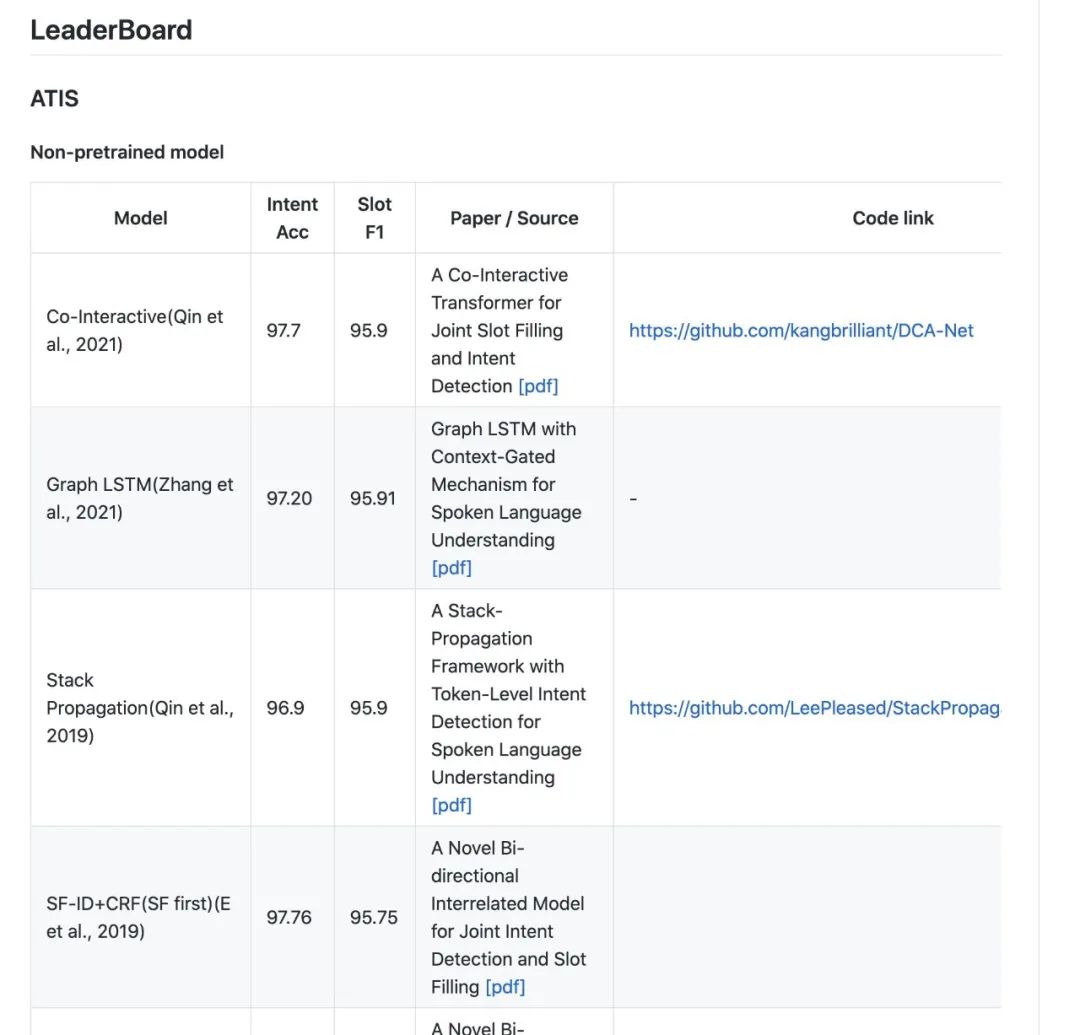

五、Leaderboard整理

对于主流数据集,我们还提供了leaderboard,方便大家跟踪进展。

六、未来挑战方向及相关工作整理

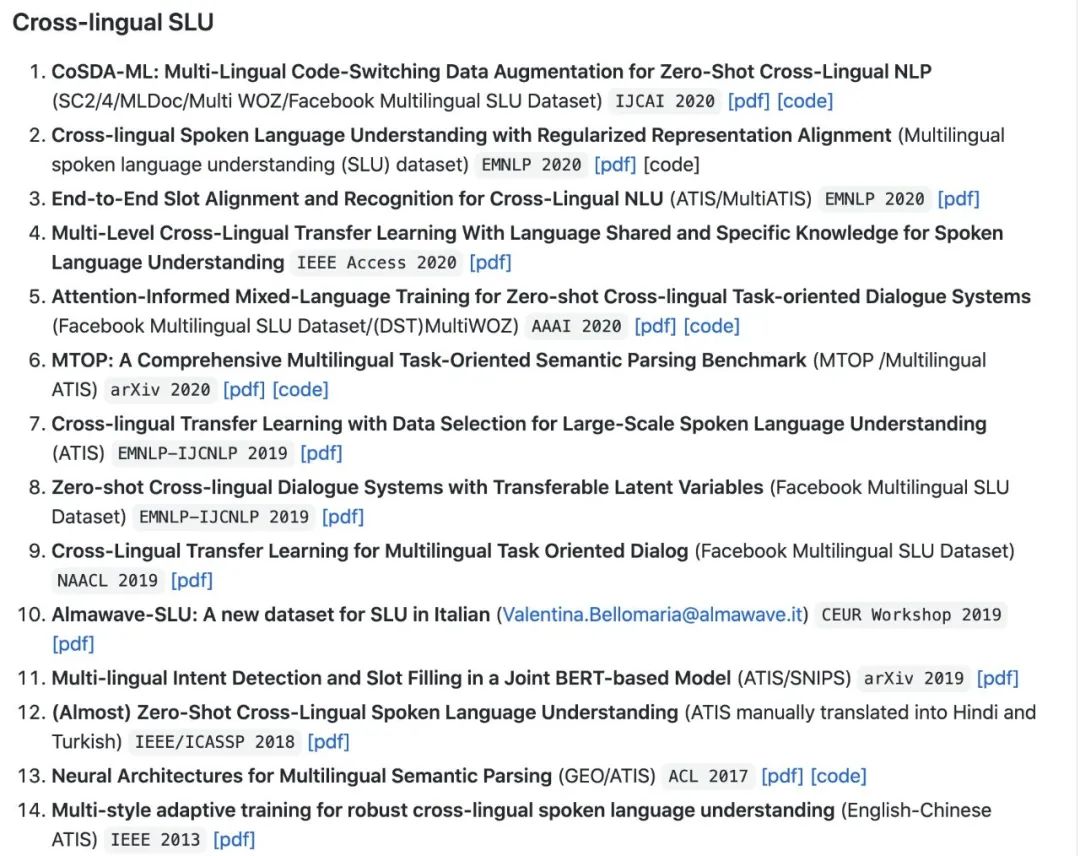

而且对于提到的几个未来方向,整理了目前为止的发表的顶会工作,如跨语言SLU。

希望这个仓库能帮助大家快速了解SLU领域,并进行一些自己的探索,欢迎大家PR以及Star!点击“阅读原文”直达仓库地址。

往期精彩回顾

本站qq群851320808,加入微信群请扫码: