PIoU Loss:倾斜目标检测专用损失函数,公开超难倾斜目标数据集Retail50K丨ECCV 2020 Spotlight

↑ 点击蓝字 关注极市平台

来源丨晓飞的算法工程笔记

编辑|极市平台

极市导读

PIoU损失函数能有效提高倾斜目标检测场景下的旋转角度预测和IoU效果,对anchor-based和anchor-free均适用。另外,论文还提供了Retail50K数据集,有助于评估算法的性能。

PIoU Loss: Towards Accurate Oriented Object Detection in Complex Environments

论文地址:

https://arxiv.org/abs/2007.09584

代码链接:

https://github.com/clobotics/piou

Introduction

当前的目标检测方法由于BB(bounding boxes)的特性,对倾斜和密集物体的检测存在一定的局限性。为了解决这个问题,研究者扩展出了带旋转参数的OBB(oriented bounding boxes),即从BB(

)扩展为OBB(

),其中

旋转角度,这样OBB就能更紧凑地包围目标,可以更好地检测旋转和密集的物体。

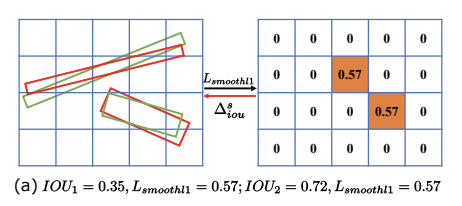

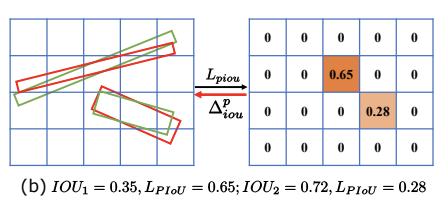

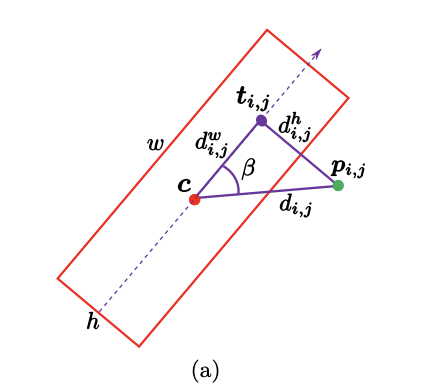

目前的OBB-based方法大多数在anchor-based架构上采用距离损失来优化上述的5个参数,并且在航空图片的目标检测上已经有一些应用。但其检测性能在更复杂的场景中依然存在局限性,主要原因在于距离损失更多地是优化旋转角度误差,而不是优化全局IoU,特别是对长条形物体很不敏感。如图a所示,两个IoU相差很大的情景下,距离损失的结果却是一样的。

为了解决这个问题,论文提出PIoU(Pixels-IOU)损失来同时提高旋转角度和IoU的准确率。如图b所示,PIoU损失能直接反映物体间的IoU,但由于OBB间的相交区域可能是多边形,OBB的IoU比BB的IoU要难算得多,所以PIoU损失以逐像素判断的方式进行IoU计算并且是连续可微的。另外论文还提供了包含高长宽比倾斜目标的检测数据集Retail50K,方便OBB-based检测算法的研究。

论文的贡献如下:

提出新的损失函数PIoU损失,能够提升倾斜目标的检测效果。

提供新的数据集Retail50K,可以更好的进行OBB-based算法的评估。

通过实验证明PIoU损失的有效性,能够运用于anchor-based和anchor-free方法。

Pixels-IoU (PIoU) Loss

对于OBB

(

),理想的损失函数能够引导网络最大化IoU,降低

的错误率。为了到达这个目的,需要准确且高效地计算OBB间的IoU,论文采用了像素计数的方式来计算IoU。

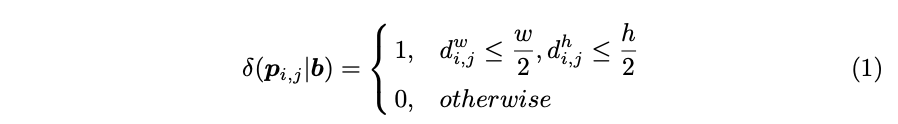

对于点

和OBB

,根据其到中线的距离

和中线交点到中点的距离

来判断点是否在OBB内:

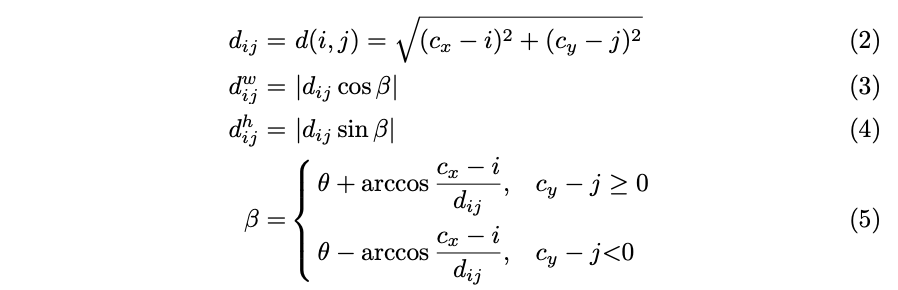

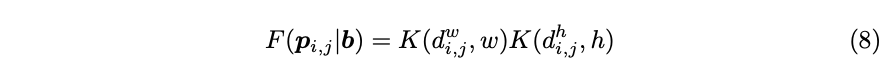

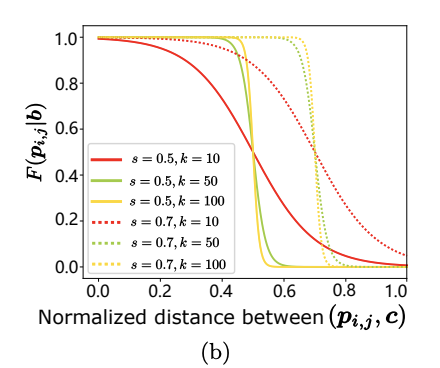

定义

为包围

和

的最小正方形,可以通过判断

中的所有像素来计算

和

间的交集区域和并集区域:

最后通过

除以

计算IoU,但公式1并不是连续可微函数,导致不能进行反向传播训练。为了解决这个问题,将公式1转换为两个核的乘积

:

其中

用于控制对目标像素

的敏感程度,由于公式9使用了相对位置信息(图a的点距离和三角形的角度),所以

和

均是对OBB的旋转角度和大小敏感的。

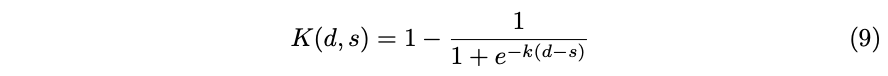

如图b所示,

是连续可微的,且与公式1类似。当

在

内时,

接近于1,反之则接近于0。为此,

和

的交并集区域计算变为:

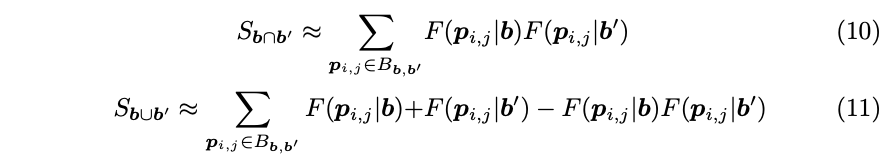

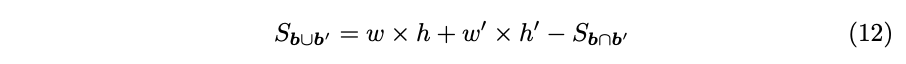

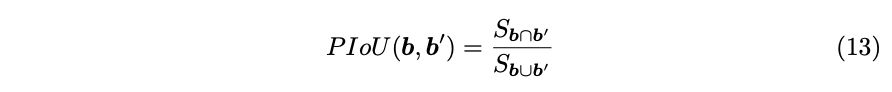

为了降低公式11的计算量,简化为:

基于公式10和公式12,PIoU的计算为:

定义

为所有正样本对,PIoU损失的计算为:

PIoU损失也可用于无交集的OBB,因为PIoU始终大于零,梯度依然可以计算,另外PIoU损失也可以用于正常的BB场景中。

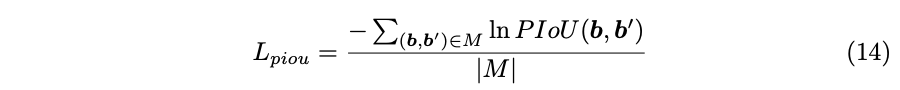

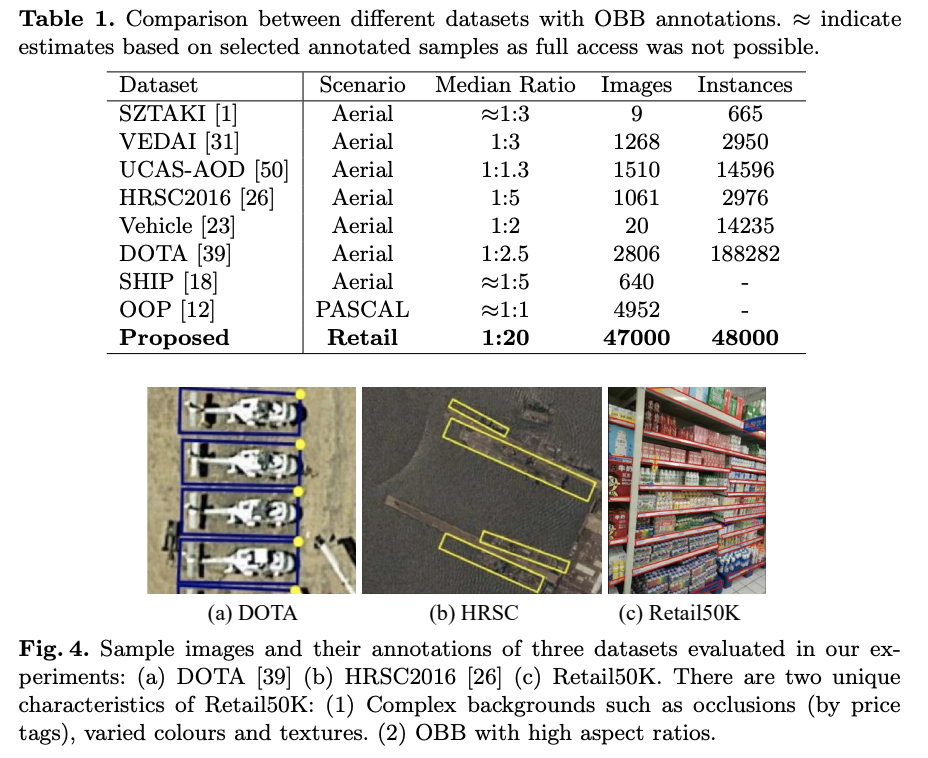

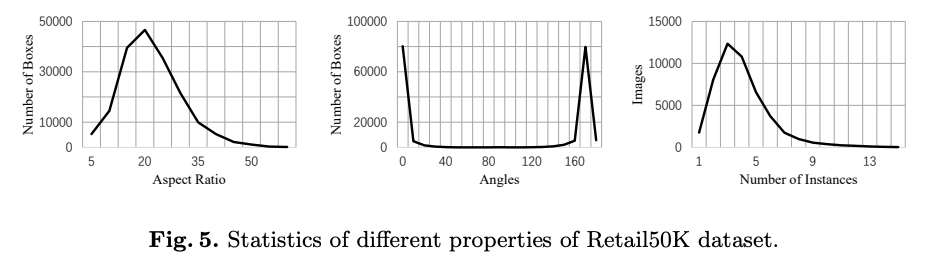

Retail50K Dataset

之前的大多数OBB数据集都是航空图片,少部分数据集对MSCOCO等数据集进行重新标注。据统计,航空图片数据集中大多数OBB的长宽比都在1:4内,而主流数据集则集中在1:1,不能够很好地评价OBB-based方法的性能。为此,论文提供了Retail50K数据集,由47000张不同的超市图片构成,标注对象为货架的层架边。数据集包含复杂的背景和高长宽比目标,并且具有实际使用意义。

Experiments

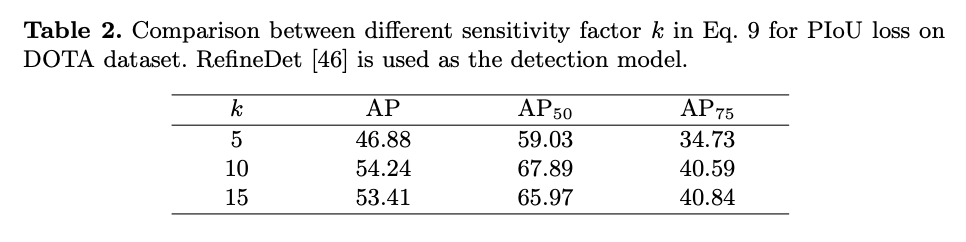

不同

下对比实验。

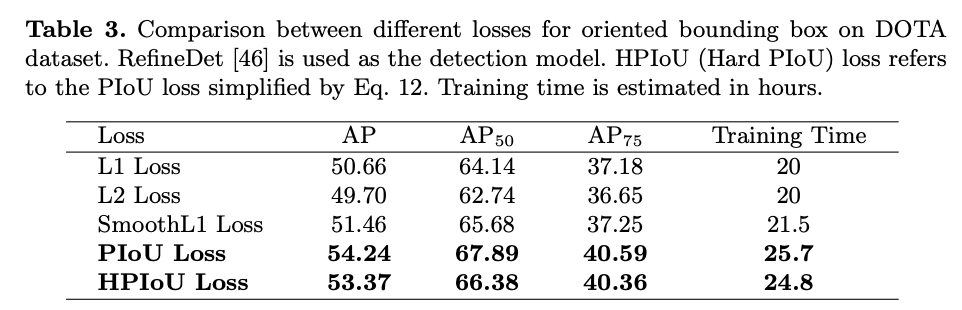

对比其它损失函数在OBB场景下的性能。

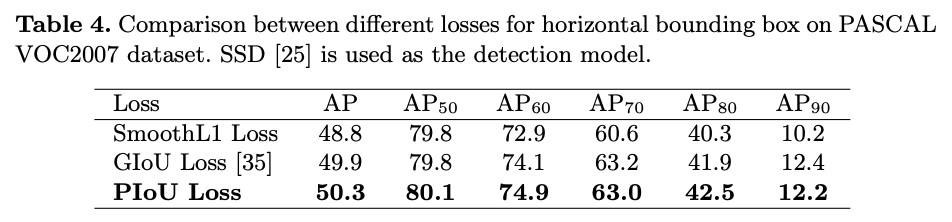

对比其它损失函数在BB场景下的性能。

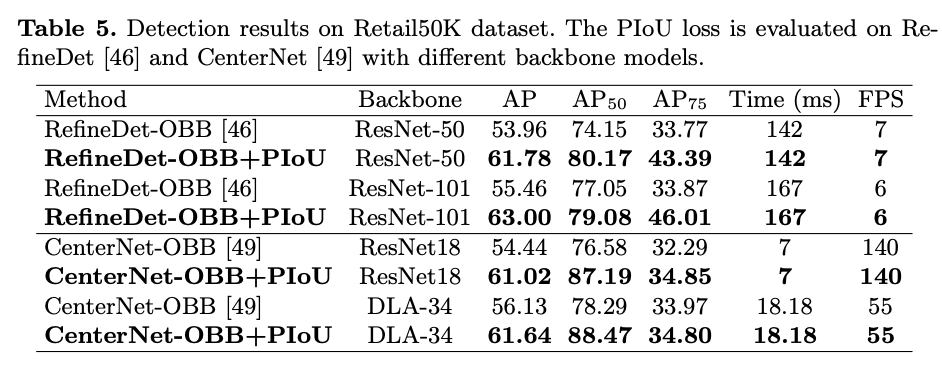

Retail50K数据集上的性能对比。

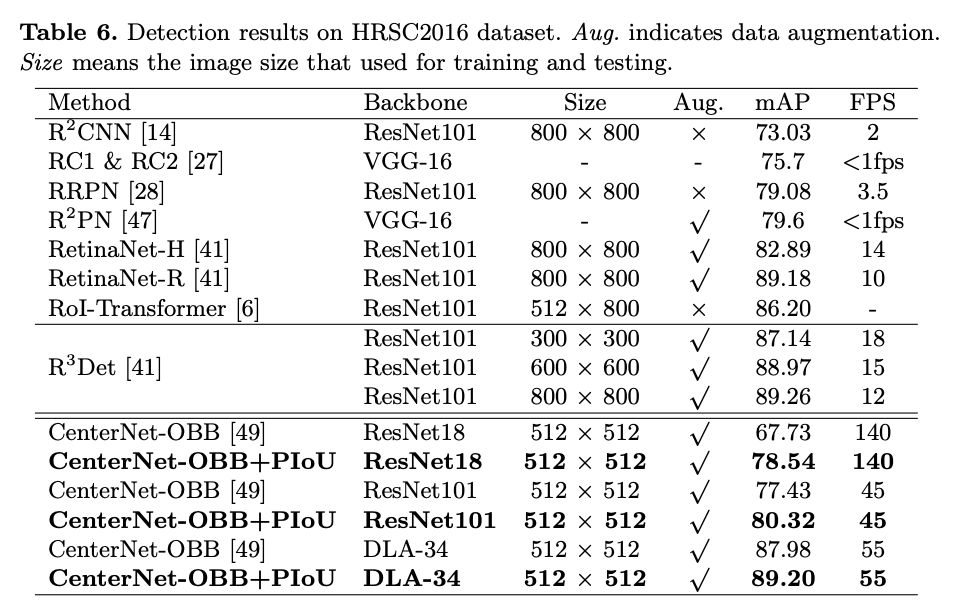

HRSC2016数据上的性能对比。

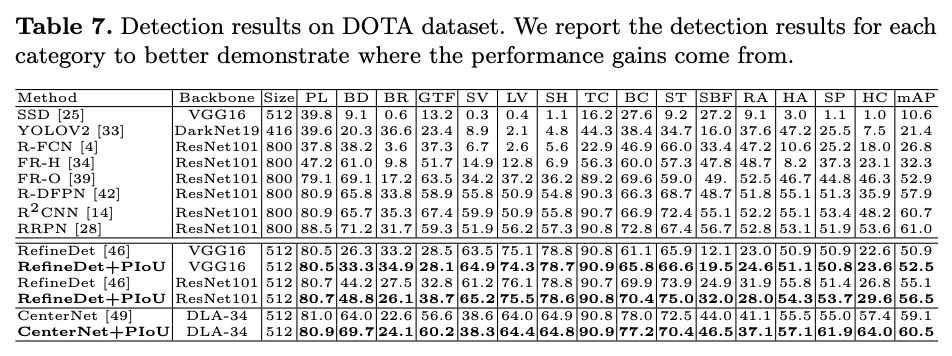

DOTA数据上的性能对比。

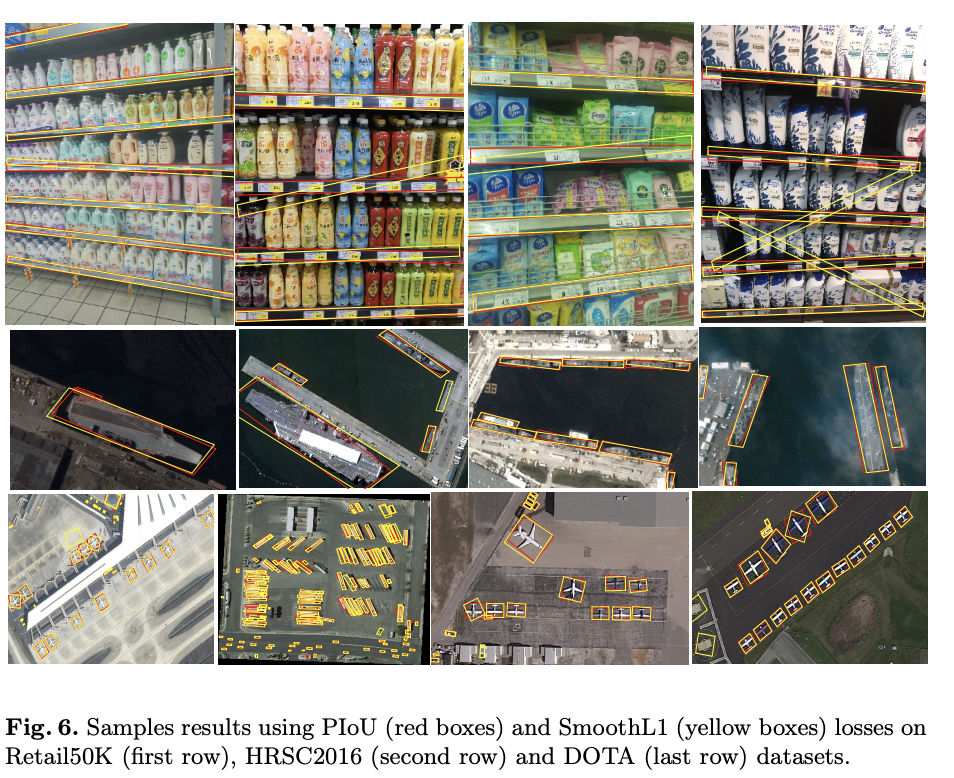

结果可视化对比。

Conclustion

论文提出从IoU指标延伸来的PIoU损失函数,能够有效地提高倾斜目标检测场景下的旋转角度预测和IoU效果,对anchor-based方法和anchor-free方法均适用。从结果来看,PIoU损失的效果还是十分明显的。另外论文提供了Retail50K数据集,能够很好地用于评估倾斜目标检测算法的性能。

推荐阅读

极市七夕"CV侠侣"征稿活动

极市征集了大家关于陪伴的故事

投票通道现已开启

快来为你喜爱的TA加油吧!

极市平台公众号回复“七夕”即可获取投票链接

每人每天有3次投票机会哦~

目前,活动还在进行中

大家可添加极小东微信(ID:cvmart3)投稿~

△ 扫码添加极小东微信

添加极市小助手微信(ID : cvmart2),备注:姓名-学校/公司-研究方向-城市(如:小极-北大-目标检测-深圳),即可申请加入极市目标检测/图像分割/工业检测/人脸/医学影像/3D/SLAM/自动驾驶/超分辨率/姿态估计/ReID/GAN/图像增强/OCR/视频理解等技术交流群:每月大咖直播分享、真实项目需求对接、求职内推、算法竞赛、干货资讯汇总、与 10000+来自港科大、北大、清华、中科院、CMU、腾讯、百度等名校名企视觉开发者互动交流~

△长按添加极市小助手

觉得有用麻烦给个在看啦~

评论