三维点云数据集

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

1

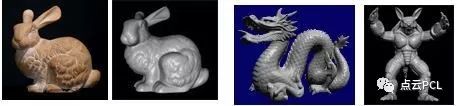

The Stanford 3D Scanning Repository(斯坦福大学的3 d扫描存储库)

链接:http://graphics.stanford.edu/data/3Dscanrep/

这应该是做点云数据最初大家用最多的数据集,其中包含最开始做配准的Bunny、Happy Buddha、Dragon等模型。

2

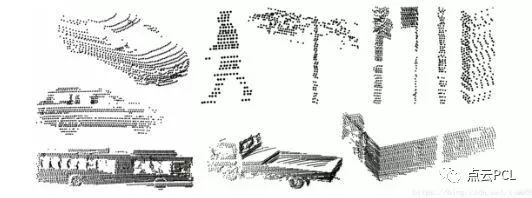

Sydney Urban Objects Dataset(悉尼城市目标数据集)

链接:http://www.acfr.usyd.edu.au/papers/SydneyUrbanObjectsDataset.shtml

这个数据集包含用Velodyne HDL-64E LIDAR扫描的各种常见城市道路对象,收集于澳大利亚悉尼CBD。含有631个单独的扫描物体,包括车辆、行人、广告标志和树木等。可以用来测试匹配和分类算法。

3

ASL Datasets Repository

链接:https://projects.asl.ethz.ch/datasets/doku.php?id=home

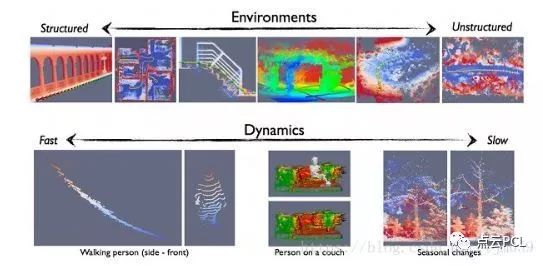

这个数据集包含的数据比较多类,由Automonous Systems Lab提供的数据,一般数据集都有对应发表的论文成果。下边只列出一些下载过,用过的。

(1)IORS2018:目标检测和匹配

(2)IJRR2012:测试点云配准算法

(3)ISER2016:可用作点云配准(有源码)

源码链接:https://github.com/ethz-asl/robust_point_cloud_registration

4

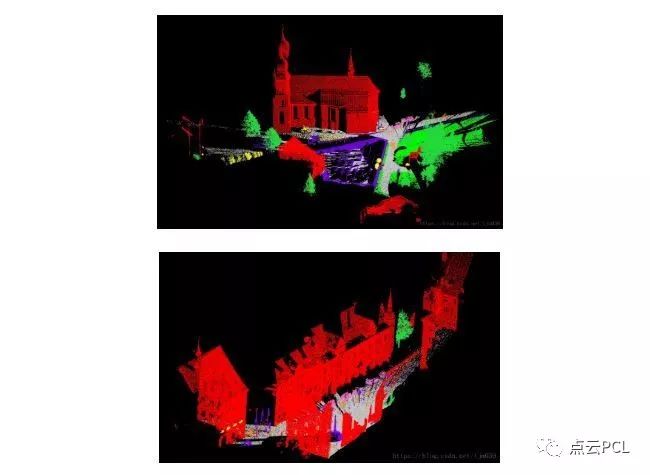

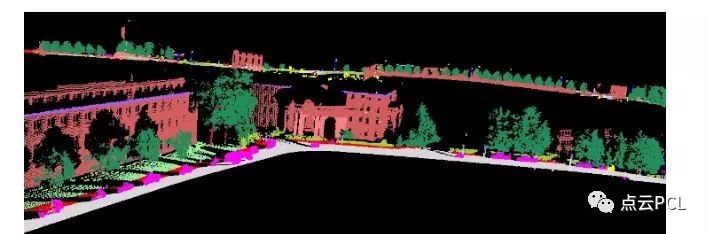

Large-Scale Point Cloud Classification Benchmark(大规模点云分类基准)

链接:http://www.semantic3d.net/

这个数据库是做大规模点云分类的,提供了一个大的自然场景标记的3D点云数据集,总计超过40亿点。涵盖了各种各样的城市场景:教堂、街道、铁路轨道、广场、村庄、足球场、城堡等等。

5

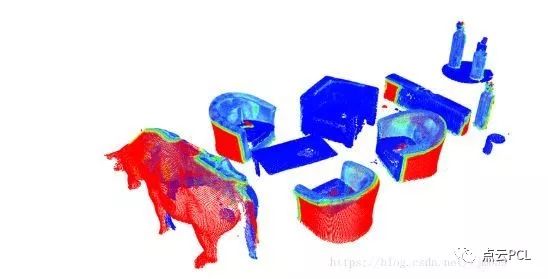

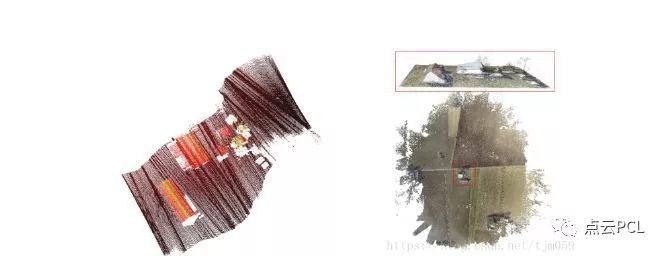

RGB-D Object Dataset(RGB-D对象数据集)

链接:http://rgbd-dataset.cs.washington.edu/index.html

RGB-D对象数据集是300个常见的家庭对象的大数据集。该数据集是使用Kinect风格的3D相机记录的,该相机以30Hz记录同步和对齐的640x480RGB和深度图像。对于每个物体,有3个视频序列,每个视频序列用安装在不同高度的照相机记录,以便从与地平线的不同角度观察物体。除了300个对象的孤立视图之外,RGB-D对象数据集还包括22个带有注释的自然场景视频序列,其中包含来自数据集的对象。这些场景覆盖了常见的室内环境,包括办公室工作区、会议室和厨房区域。

6

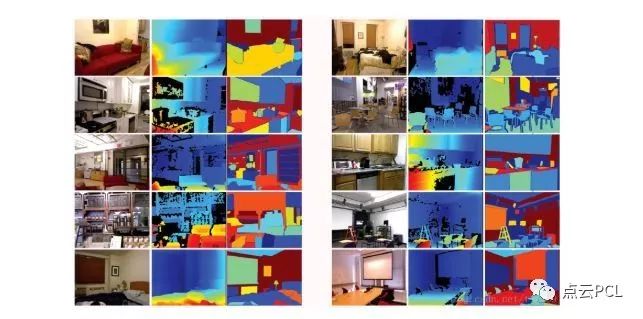

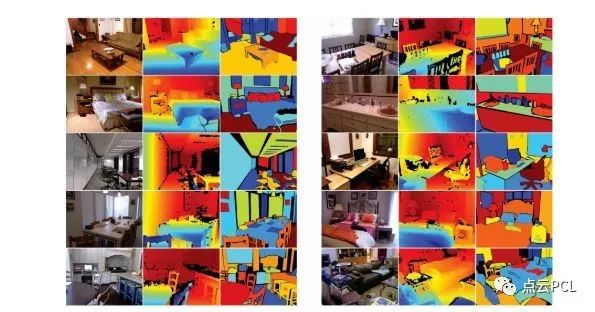

NYU-Depth(纽约大学深度数据集)

链接:https://cs.nyu.edu/~silberman/datasets/

这个数据集应该也是大家比较熟悉的,包括NYU-Depth V1数据集和NYU-Depth V2数据集,都是由来自各种室内场景的视频序列组成,这些视频序列由来自Microsoft Kinect的RGB和Depth摄像机记录。

NYU-Depth V1数据集包含有64种不同的室内场景、7种场景类型、108617无标记帧和2347密集标记帧以及1000多种标记类型。

NYU-Depth V2数据集包含了1449个密集标记的对齐RGB和深度图像对、来自3个城市的464个新场景,以及407024个新的无标记帧。

7

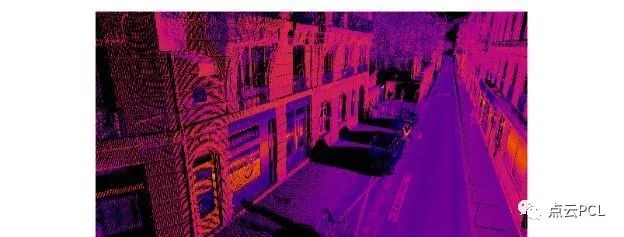

IQmulus & TerraMobilita Contest

链接:http://data.ign.fr/benchmarks/UrbanAnalysis/#

该数据库包含来自巴黎(法国)密集城市环境的3DMLS数据,由3亿点组成。在该数据库中,对整个3D点云进行分割和分类,即每个点包含一个标签和一个类。因此,对检测-分割-分类方法进行逐点评估成为可能。这个数据库是在iQmulus和TerraMobilita项目的框架内产生的。它被法国国家制图局(IGN)开发的MLS系统“ Stereopolis II”收购。注释将由IGN的MATIS实验室手动辅助进行。

8

Oakland 3-D Point Cloud Dataset(奥克兰 )

链接:http://www.cs.cmu.edu/~vmr/datasets/oakland_3d/cvpr09/doc/

这个数据库的采集地点是在美国卡耐基梅隆大学周围,数据采集使用Navlab11,配备侧视SICK LMS激光扫描仪,用于推扫。其中包含了完整数据集、测试集、训练集和验证集。

9

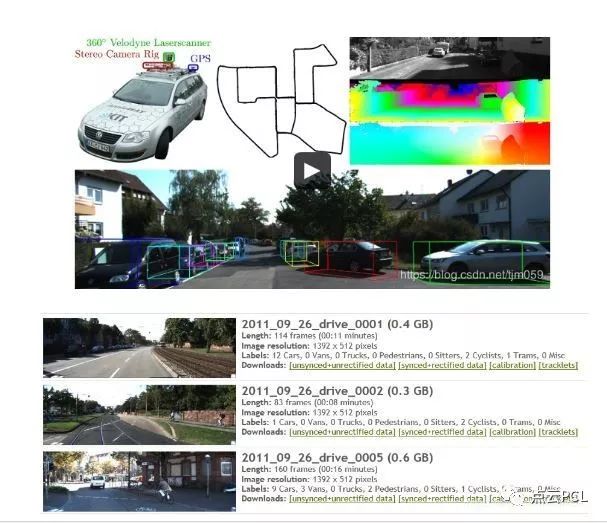

The KITTI Vision Benchmark Suite

链接:http://www.cvlibs.net/datasets/kitti/

这个数据集来自德国卡尔斯鲁厄理工学院的一个项目,其中包含了利用KIT的无人车平台采集的大量城市环境的点云数据集(KITTI),这个数据集不仅有雷达、图像、GPS、INS的数据,而且有经过人工标记的分割跟踪结果,可以用来客观的评价大范围三维建模和精细分类的效果和性能。

其中,该团队还介绍了一些相关的数据集,可以参考:

10

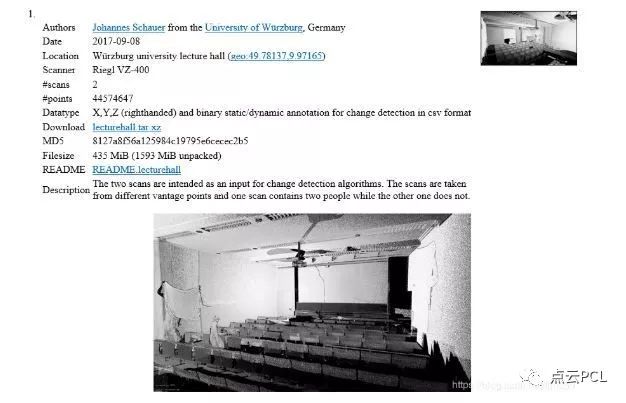

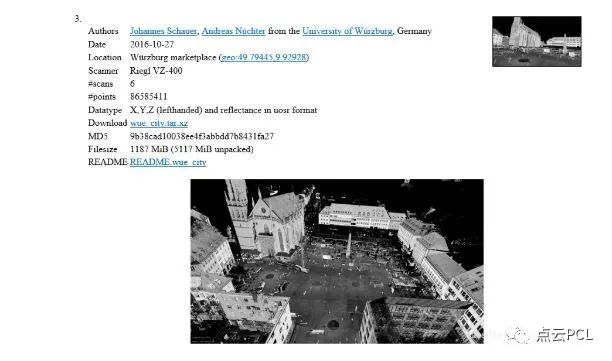

Robotic 3D Scan Repository

链接:http://kos.informatik.uni-osnabrueck.de/3Dscans/

这个数据集比较适合做SLAM研究,包含了大量的Riegl和Velodyne雷达数据。

下载1:OpenCV-Contrib扩展模块中文版教程 在「小白学视觉」公众号后台回复:扩展模块中文教程,即可下载全网第一份OpenCV扩展模块教程中文版,涵盖扩展模块安装、SFM算法、立体视觉、目标跟踪、生物视觉、超分辨率处理等二十多章内容。 下载2:Python视觉实战项目52讲 在「小白学视觉」公众号后台回复:Python视觉实战项目,即可下载包括图像分割、口罩检测、车道线检测、车辆计数、添加眼线、车牌识别、字符识别、情绪检测、文本内容提取、面部识别等31个视觉实战项目,助力快速学校计算机视觉。 下载3:OpenCV实战项目20讲 在「小白学视觉」公众号后台回复:OpenCV实战项目20讲,即可下载含有20个基于OpenCV实现20个实战项目,实现OpenCV学习进阶。 交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~