论文:NBNet: Noise Basis Learning for Image Denoising with Subspace Projection

链接:https://arxiv.org/abs/2012.15028代码:https://github.com/pminhtam/NBNet

01

Abstact

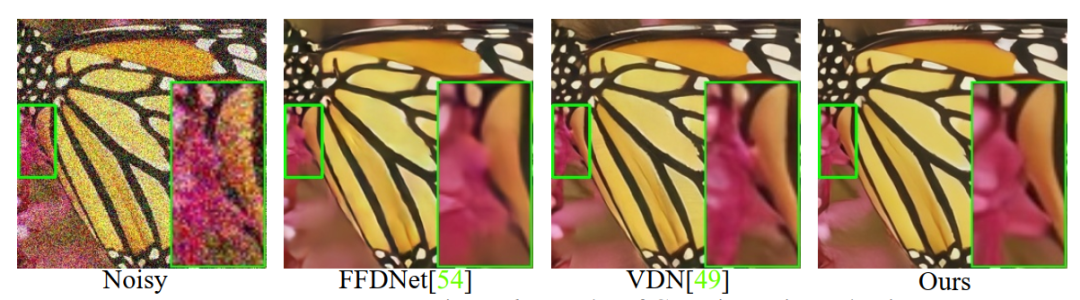

该文提出一种新颖的框架NBNet用于图像降噪,它从新的角度出发设计:通过图像自适应投影进行降噪。具体来说,NBNet通过训练这样的网络进行信号与噪声的分离:在特征空间学习一组重建基;然后,图像降噪可以通过将输入图像映射到特征空间并选择合适的重建基进行噪声重建。

该文的关键洞察在于:投影可以自然的保持输入信号的局部结构信息。这种特性尤其适合于low-light区域/弱纹理区域。为此,作者提出了一种新颖的子空间注意力模块(SubSpace Attention, SSA)显示的进行重建基生成、子空间投影。与此同时,作者进一步将SSA与NBNet(一种UNet改进)相结合进行端到端图像降噪。

02

Image denoising

图像去噪是一项具有挑战性的任务,需要从包含噪声 的噪声图片 中还原成没有噪声的清晰图片 ,其可以总结成一个数学公式:

大多数情况下,图像降噪都是ill-posed的问题。因为通过有噪音的观察,总是无法逆向求得唯一正确的干净图片。就好像让你解一个超越方程一样,不借助其他额外的条件信息,是没有唯一解的。许多去噪方法利用图像前导和噪声模型来估计来自嘈杂观察的图像或噪声。降噪的本质,是要从观测值中分离噪音,保留图像。

2.1 传统方法

去噪的传统方法通常利用图像的局部相似性和噪声的独立性过滤噪声,如NLM和BM3D,通过设计滤波器对图像进行处理。特点是速度往往比较快,很多卷积滤波可以借助快速傅里叶变化来加速。

2.2 深度学习方法

基于深度神经网络的去噪方法通常隐含地利用从大量配对训练数据中学习的图像前望和噪声分布。如果说解决逆问题的关键,是寻找一个好的图像约束器(regularizer),那么我们为什么不用一个最好的约束器?深度学习方法的精髓,就在于通过大量的数据,学习得到一个高复杂度(多层网络结构)的图片约束器,从而将学习外部先验条件这一途径推到极限。

尽管以前的基于CNN的方法已经取得了巨大的成功,但是要在困难的场景(例如弱纹理或高频细节)中恢复高质量图像仍然具有挑战性。作者发现,卷积网络通常取决于局部滤波器对分离的噪声和信号的响应。在低信噪比(SNR)的情况下,无附加全局结构信息,就很容易混淆本地响应。

03

Method

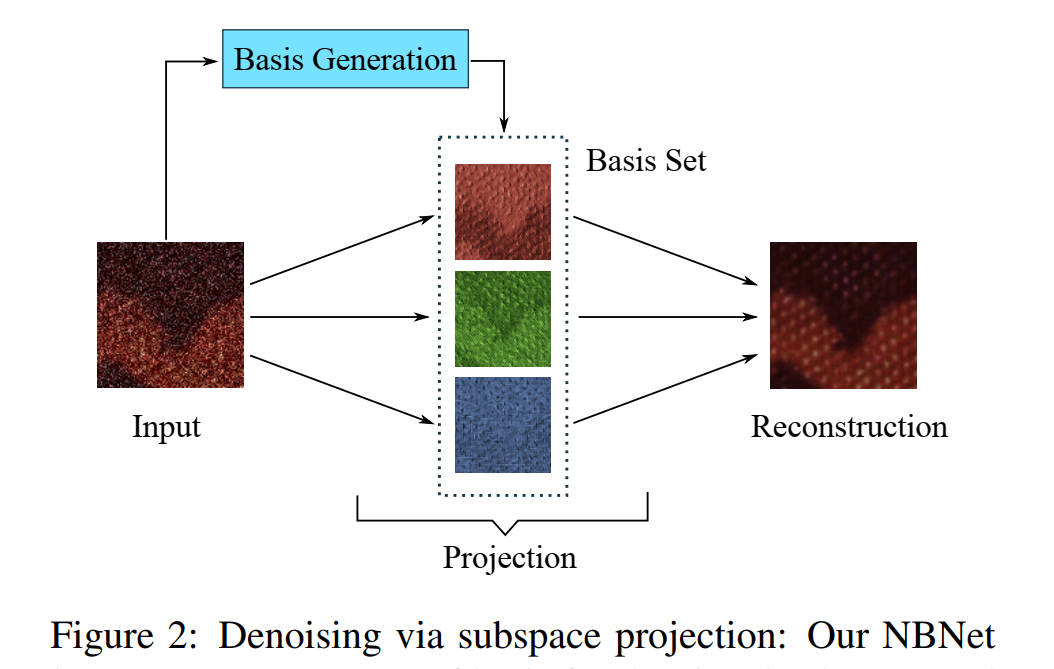

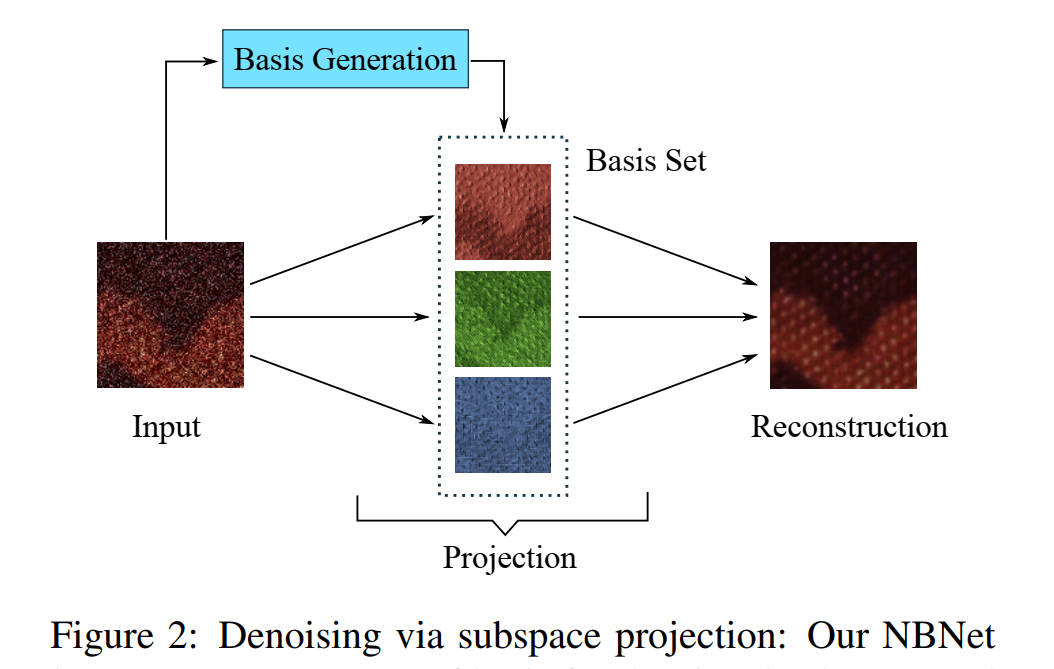

3.1 Subspace Projection with Neural Network如图2所示,NBNet的投影方法有两个主要步骤:

a)Basis generation:从图像特征映射生成子空间基向量(Basis Set);

b)Projection:将特征映射转换为信号子空间。

定义 是从单张图片获取的两个特征图,它们是CNN的中间激活,它们可以在不同的层中,但具有相同的尺寸。首先基于特征图 和 估计 个基础向量 ,并且每个vi 都是信号子空间的基础矢量,其中 , 然后将 投影到上述子空间

Basis generation

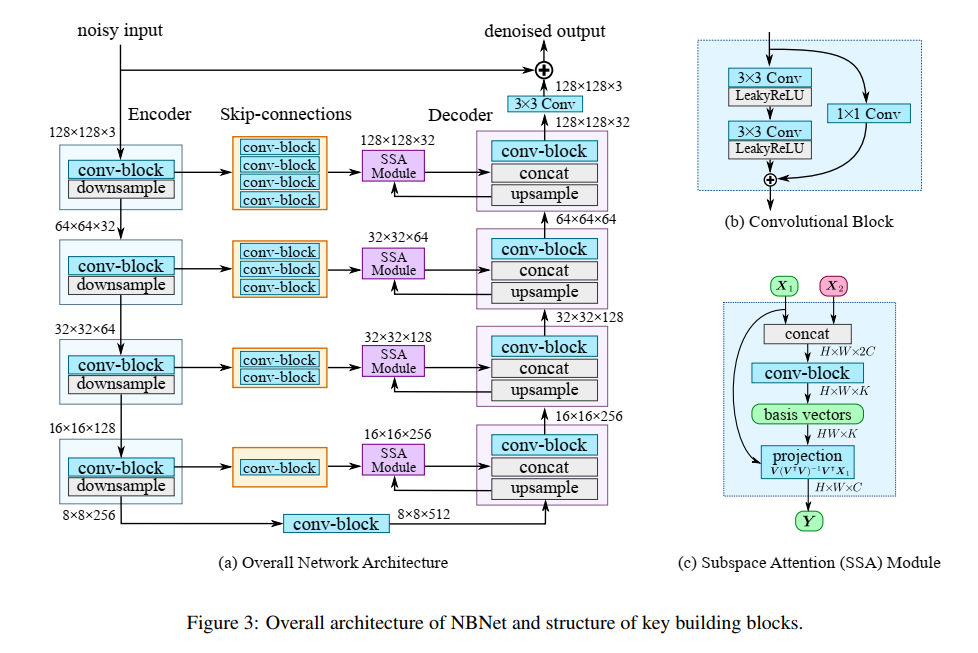

是 的函数,Basis generation的过程可以写成: 其中 和 是特征图,由 是由基础向量 组成的矩阵,NBNet用一个小的卷积网络实现函数 的工作,首先,对 和 在通道的维度上进行拼接成 然后将其反馈入具有K个输出通道的浅层残差卷积模块,如图3(b)所示,其输出可以很容易重塑为 。在训练过程中以端对端的方式更新基础生成模块的权重和偏差。Projection

通过 获得的矩阵 ,其列是 维信号子空间 的基向量,然后可以通过正交线性投影将图像特征图 投影到 上。 是信号子空间的正交投影矩阵, 可以由 计算得到,公式如下:

由于Basis generation的过程不能确保基向量彼此正交,因此需要归一化项 。最后,图像特征图 可以在信号子空间中重构为 ,公式如下: 基础生成和子空间投影相结合形成NBNet的SSA模块,其结构如图3(c)所示。

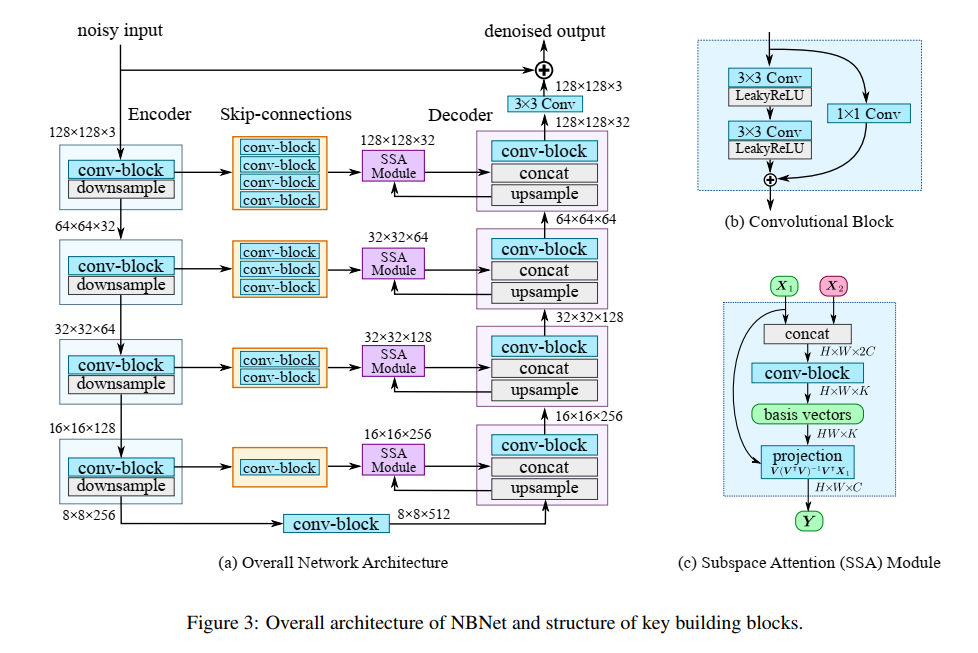

3.2 NBNet Architecture and Loss Function

NBNet的网络结构如图3(a)所示,其整体结构基于经典的UNET结构,NBNet由4个编码器和4个相应的解码器组成,编码器的下采样操作由步长为2的 卷积,每经过一个编码器特征图尺寸缩小一半,解码器的上采样操作由 的反卷积实现。Skip connection 将尺寸大的低特征图从每个编码器传递到其相应的解码器。编码器,解码器和Skip connection中的基本卷积模块遵循图3(b)中所示的相同残差卷积结构。 并且使用LeakyReLU作为每个卷积层的激活函数。NBNet的SSA模块放置在每个skip connection中。由于低级特征图包含更详细的原始图像信息,因此NBNet将低级特征图作为 ,将高级特征图作为 ,并将其输入到SSA模块中。换句话说,来自skip connection的低级特征图被投影到由上采样的高级特征引导的信号子空间中。然后将投影所得特征进一步与原始的高级特征融合并送入下一个解码器。与传统的类似UNet的架构(在每个解码器阶段直接融合低级和高级特征图)相比,NBNet的主要区别在于,低级特征是在融合之前由SSA模块投影形成的。

最后一个解码器的输出通过线性3×3卷积层作为噪声输入的全局残差,并输出去噪结果。

网络是用成对的干净和嘈杂的图像训练的,NBNet使用干净图像和去噪结果之间的简单 距离作为损失函数,写为: 其中 代表NBNet,x代表清晰的图片,y代表噪声图片。

04

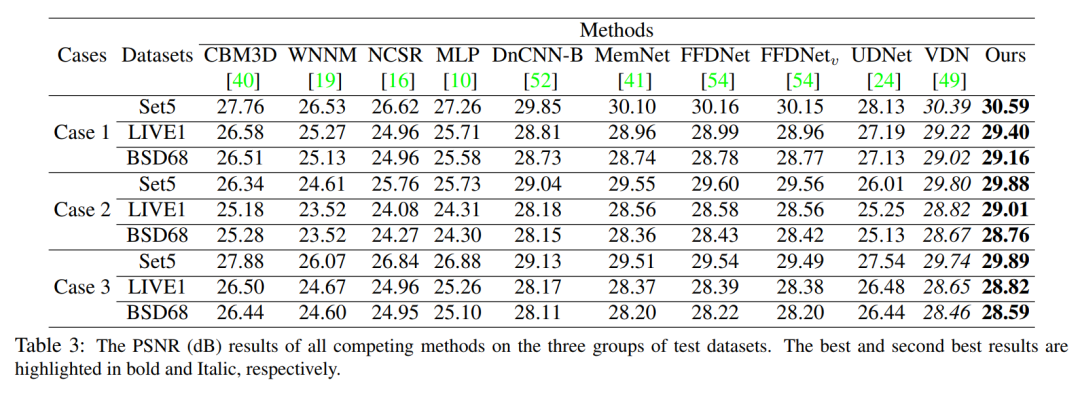

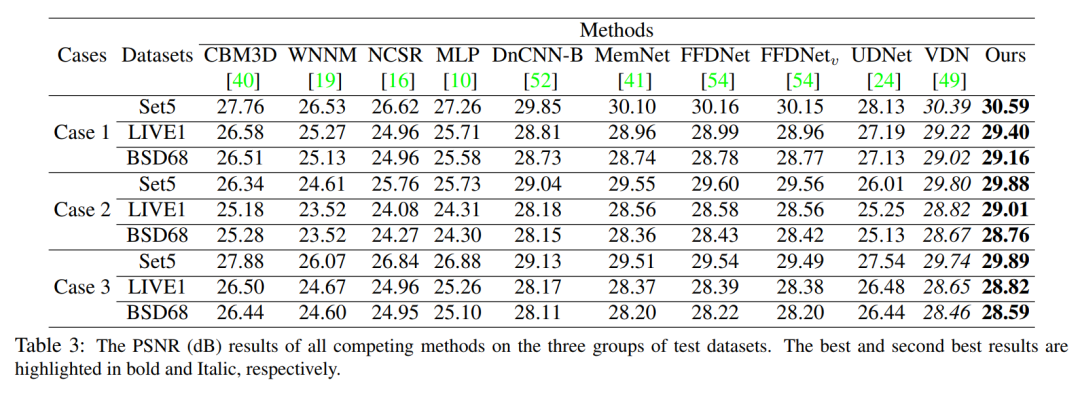

实验结果

---------------------------End---------------------------

10000+人已加入矩阵司南

非常感谢对我们的支持!

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()