经典回顾!LeCun展示了首个CNN

来自于点击下方卡片,关注“新机器视觉”公众号

视觉/图像重磅干货,第一时间送达

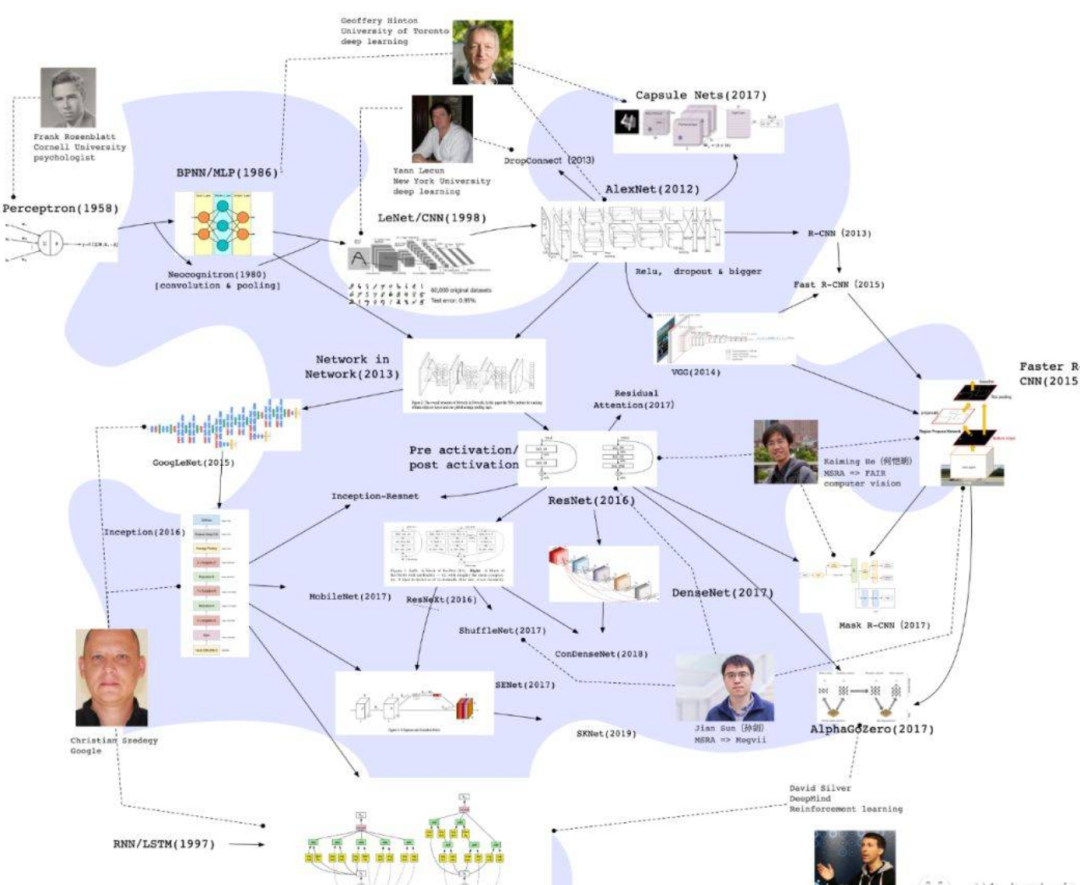

随着AI的发展,卷积神经网络(Convolutional Neural Network,CNN)已经成为从业者使用的最经典,也是最高效的神经网络架构之一。

1980年,日本科学家福岛邦彦在论文《Neocognitron: A self-organizing neural network model for a mechanism of pattern recognition unaffected by shift in position》提出了一个包含卷积层、池化层的神经网络结构。

1998年,Yann LeCun等人发表论文《Gradient-Based Learning Applied to Document Recognition》,在其中提出了LeNet-5,将BP算法应用到神经网络结构的训练上,就形成了当代卷积神经网络的雏形。

随着之后的不断改进和发展,CNN的框架和结构趋向成熟,性能逐渐进一步上升,从而渐渐演变为了我们现在看到的经典结构。

研究者和工业界从业者,也早已经将CNN作为再自然不过的框架,在此基础上进行改进和创新。当然,Yann LeCun也早已成为大家心目中的“深度学习三巨头”之一。

至今,CNN已经在图像分类、物体检测、物体追踪、姿态预估、文本检测识别、场景标记、目标定位、物体分割等等领域得到了广泛的应用,为人们的日常生活提供了极大的便利。

都知道,想到并创造出一个新事物,远远比接受和掌握它要困难百倍。

那大家有没有想象过,CNN刚诞生的时候,场景是怎么样的?

今日,Reddit上一则帖子曝光了一段视频:

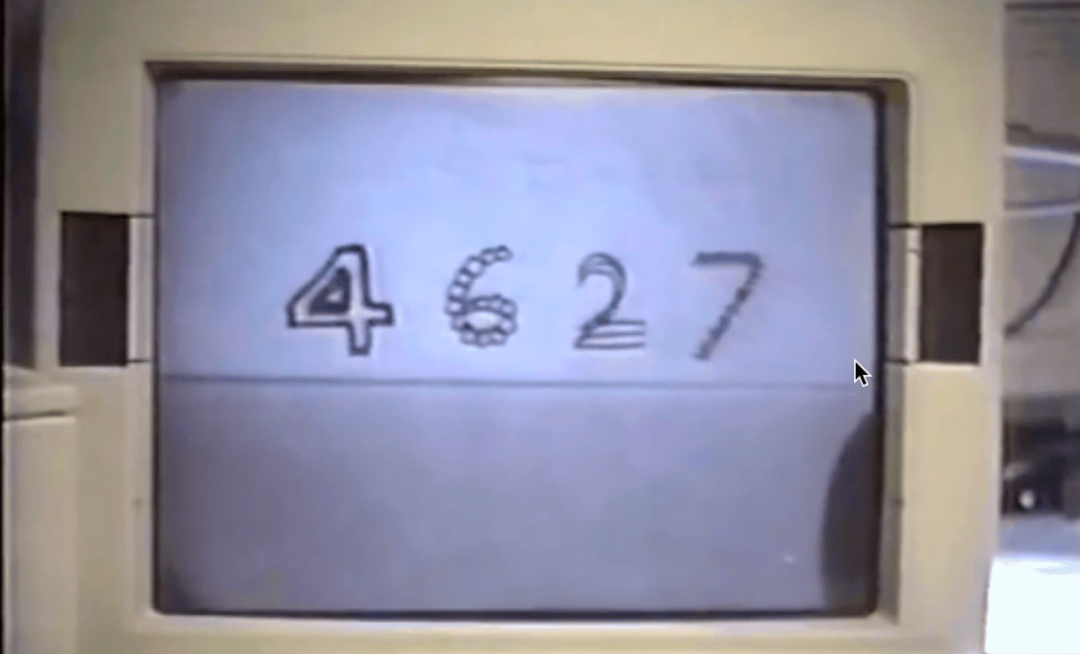

视频上记录了1993年32岁Yann LeCun展示的,用于文本识别的世界上第一个卷积网络。

注意,这是《Gradient-Based Learning Applied to Document Recognition》发布的五年以前。

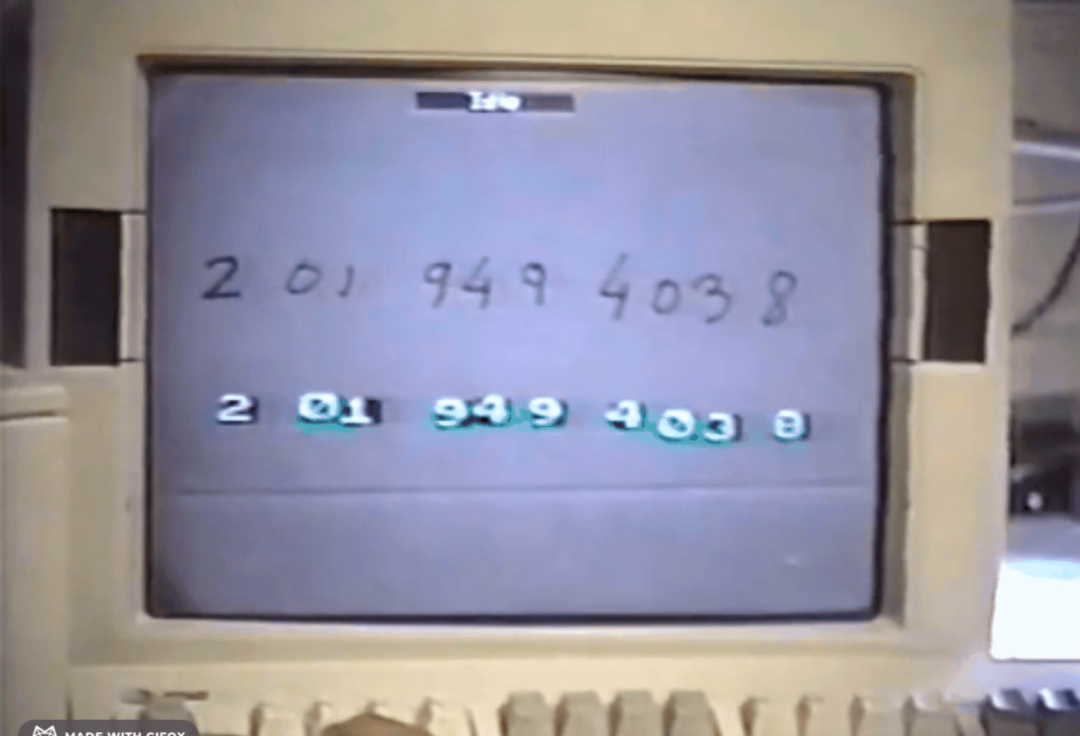

视频中详细展现了当时Lecun等人在手动数字数据集上的实验结果。

毫无例外,当时的CNN已经可以以强大的准确率,正确对应输入,表现了完美的结果:

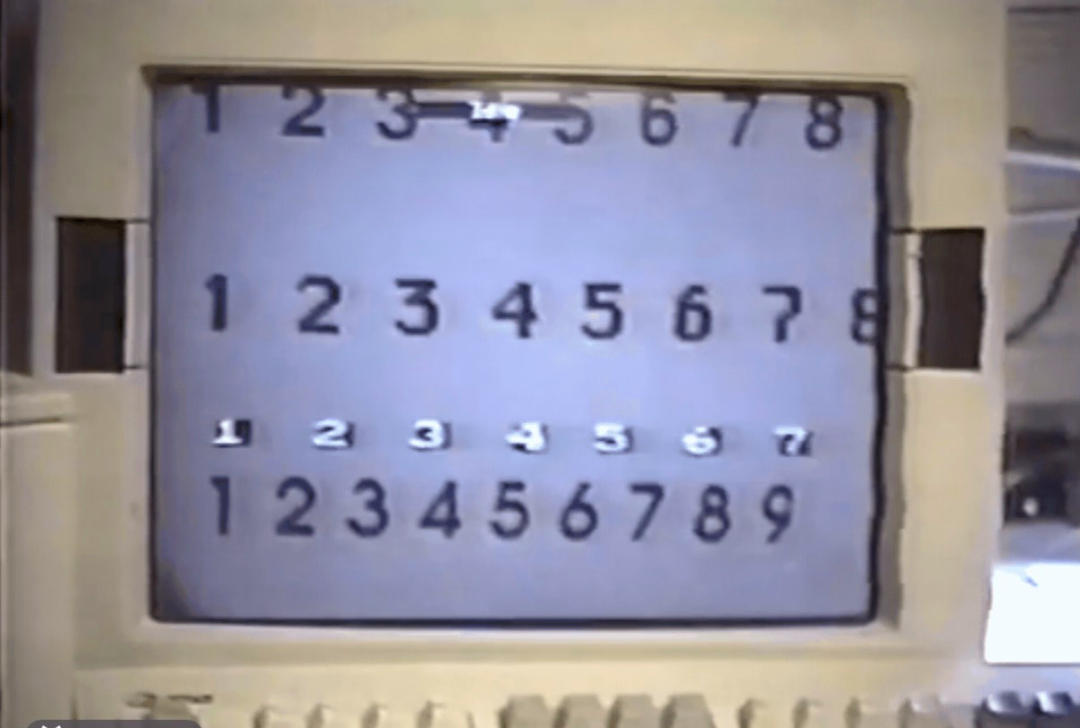

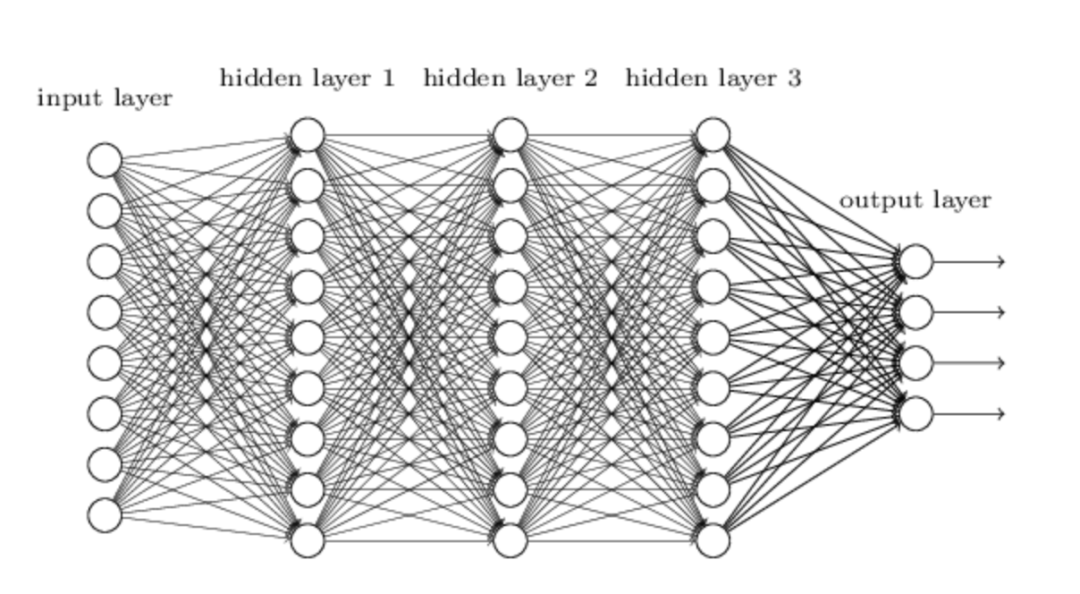

说到这里,我们可以看看过去是如何识别手写数字的,下图是过去识别手写数字的网络结构:

每一层网络都和相邻层全部连接。但是这样并没有考虑到图片中像素的空间分布,不管两个像素离的很近还是非常远都一视同仁,显然这样做是不合理的。

而CNN的出现,考虑到了输入值的(像素的)空间分布,(再加上一些人工设定的特性 例如共享权重等)使得它非常容易训练。也就可以做出更深层的网络结构,拥有更好的识别效果。

旧神经网络架构上的调整和改变,以及BP算法的引入,使得识别效果发生了惊人的提升,也为经典架构CNN的发展真正叩开了大门。

除此之外,我们还可以发现,算法输出的结果还可以“学习”到输入数字的位置,并且针对不同输入情况,有着极好的鲁棒性,这在1993年,完全称得上令人惊叹。

此外,这次曝光出来的实验涉及的输入类型,并不局限于MNIST:

当时的LeCun和其他研究人员很可能无法想象,在一个小小的实验室里提出的架构,竟然会对未来整个AI的发展,起着举足轻重的作用。

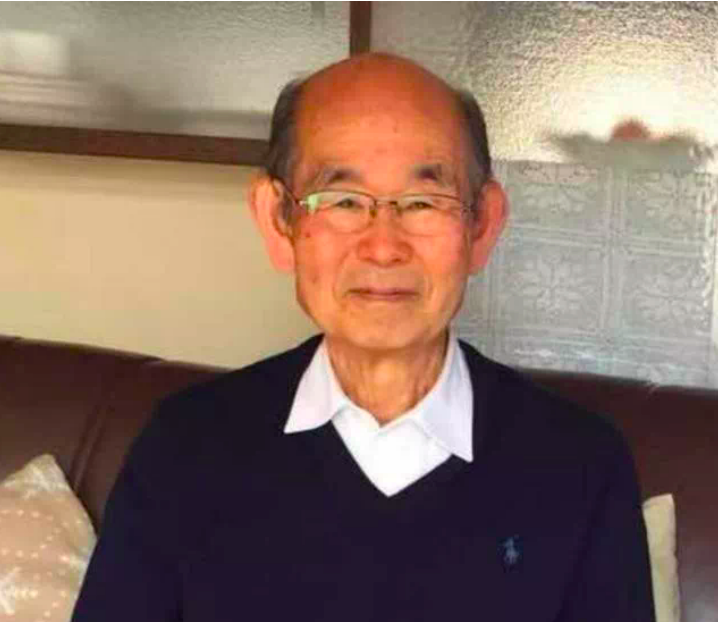

看着当时他们脸上的笑容,除了满满的成就感,更多的是热爱、激情,以及对研究结果的兴奋:

虽然身穿最朴素不过的衣服,窝在小小的办公室里,但是他们身上的光芒,却闪耀地无法令任何人无视。

是啊,无关乎功利,真正追求自己真正热爱的东西的时候,身上才会散发着任何人都会为之吸引的光芒。

当前,全世界仍然有大批研究者正在孜孜不倦的探索,努力开拓前景,为后来的人打开一扇扇窗。

可能有人会怀疑自己所做工作是否真正有意义,是的,一份工作的真正价值,并不一定会体现在当下,就像直到2012年,Imagenet图像识别大赛中,Hinton组的论文《ImageNet Classification with Deep Convolutional Neural Networks》中提到的Alexnet引入了全新的深层结构和dropout方法,一下子把error rate从25%以上提升到了15%,颠覆了图像识别领域之后,CNN才开始得到最蓬勃的发展一样。

只要你热爱你所做的,并不断去尝试,不管一时成功还是失败,它都具有极大的意义。

正是整个行业所有从业人员都在奋力地奔跑,这个领域的发展,才焕发出了最大的活力,其中的每个正在学术一线钻研的科研人员,他们的每一份尝试,每一次探索,每一次突破,都值得我们给予最大的敬意。

参考链接:

https://www.reddit.com/r/MachineLearning/comments/kuc6tz/d_a_demo_from_1993_of_32yearold_yann_lecun/

本文仅做学术分享,如有侵权,请联系删文。