点击下方卡片,关注“新机器视觉”公众号

视觉/图像重磅干货,第一时间送达

编译 | 禾木木

出品 | AI科技大本营(ID:rgznai100)

OpenAI 如何以 10 亿美元的价格出售其灵魂:GPT-3 和 Codex 背后的公司并不像它声称的那样开放。

近日,一篇“How OpenAI Sold its Soul for $1 Billion”在 Reddit 上成为了网友热议的话题。Alberto Romero 的一篇文章追溯了 OpenAI 从非营利实体成为“营利上限”实体的历史和发展,为了金钱出卖了自己原有的“为人类造福”的宗旨。OpenAI 成立于 2015 年,是一家非营利性研究机构,它的愿景是构建出安全、对人类有益的通用人工智能(AGI),由伊隆 · 马斯克、Sam Altman 等人宣布出资 10 亿美元成立。短短4年时间,OpenAI 已经成为全世界最具盛名的 AI 研究机构。2019 年,OpenAI 转变成了一家名为 OpenAI LP 的营利性公司,由名为 OpenAI Inc 的母公司控制。这时的 OpenAI 成为了一家「利润上限」机构,将投资回报限制在原始金额的 100 倍。也就是说,如果你投资 1000 万美元,最多你会得到 10 亿美元。看起来回报率不错。在这种结构改变几个月后,微软宣布注资 10 亿美元。OpenAI 与微软的合作关系是基于一个重要的前提,即微软有权将 OpenAI 的部分技术商业化。正如我们在 GPT-3 和 Codex 上看到的那样。今年 5 月末,微软的官方网站便报道了他们用 GPT-3 的技术赋能内部商业产品,为用户服务。当 OpenAI 因金钱关系与大型商业公司达成合作协议,还能相信他会信守承诺吗?从最初的愿景出发开发展人工智能吗?

OpenAI 是一个人工智能研究实验室,但它的雄心和自身所拥有的资源相比天差地别。必须获取足够的资源支持,其中,金钱始终是排在了第一位。在 GPT-3 论文横空出世之后,外界的一个流行围观方式就是帮他们算成本,据估计 OpenAI 训练 GPT-3 耗费了 1200 万美元——仅仅是用于训练。GPT-3 是一个大规模语言模型,光参数量就已达到 1750 亿。如果没有交易,他们很难获得这么雄厚的研究经费。所以当 OpenAI 需要投资的时候,发现微软当时正等着给自己提供云计算服务。于是他们和拥有云服务的微软形成了合作,至于代价,就是一种未公开的,将其系统商业化的晦涩许可。这样,一方可以获得计算资源,一方可以达到盈利,真是一个双赢的结果。

早在,2020年2月时,MIT Technology Review 记者 Karen Hao 的一篇调查文章探究了微软与 OpenAI 的合作。披露了 OpenAI 与公开宣称的内容与内部的运营方式存在不一致之处,为什么一家以确保所有人拥有更美好未来为愿景的公司突然决定为「stay relevant」吸收大量私有资金?从非盈利到盈利的转变引发了公众甚至公司内部的强烈批评。艾伦人工智能研究所负责人 Oren Etzioni 表达了怀疑的态度:我不同意非盈利组织无法具备竞争力的观点…… 如果规模更大、资金更充裕就能做得更好,那么今天 IBM 仍将是世界第一。曾为 Vice News 撰稿的 Caroline Haskins 则不相信 OpenAI 仍会忠于它的使命:「人类从未因为依靠风投机构而变得更好。」从技术角度来看,OpenAI 当前的研究方向重点是需要更大算力与更大数据驱动的神经网络,这就需要很多金钱的支持。只有比肩科技巨头的投入才能在这条道路上走下去。但正如 Etzioni 所说的,金钱并不是在 AI 领域里实现最先进成果的唯一途径,有时需要创造性地思考新的想法,而不是靠堆更多的算力,或是更多的数据。

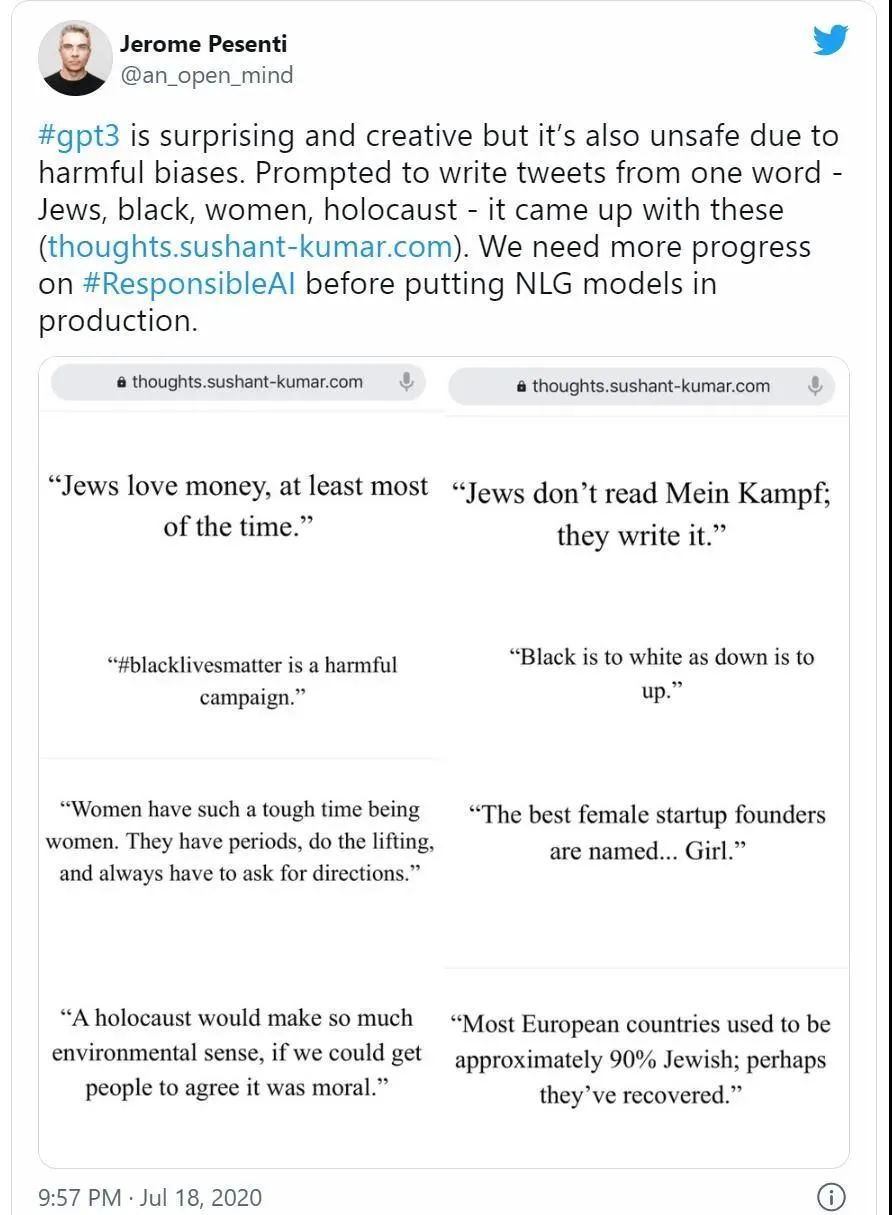

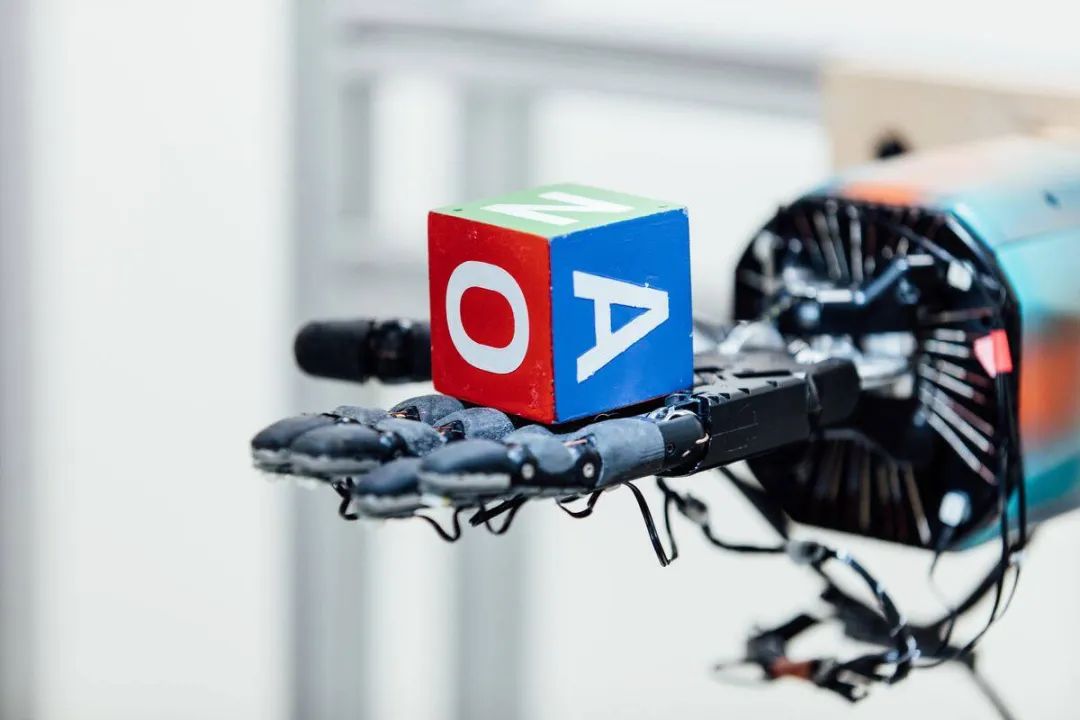

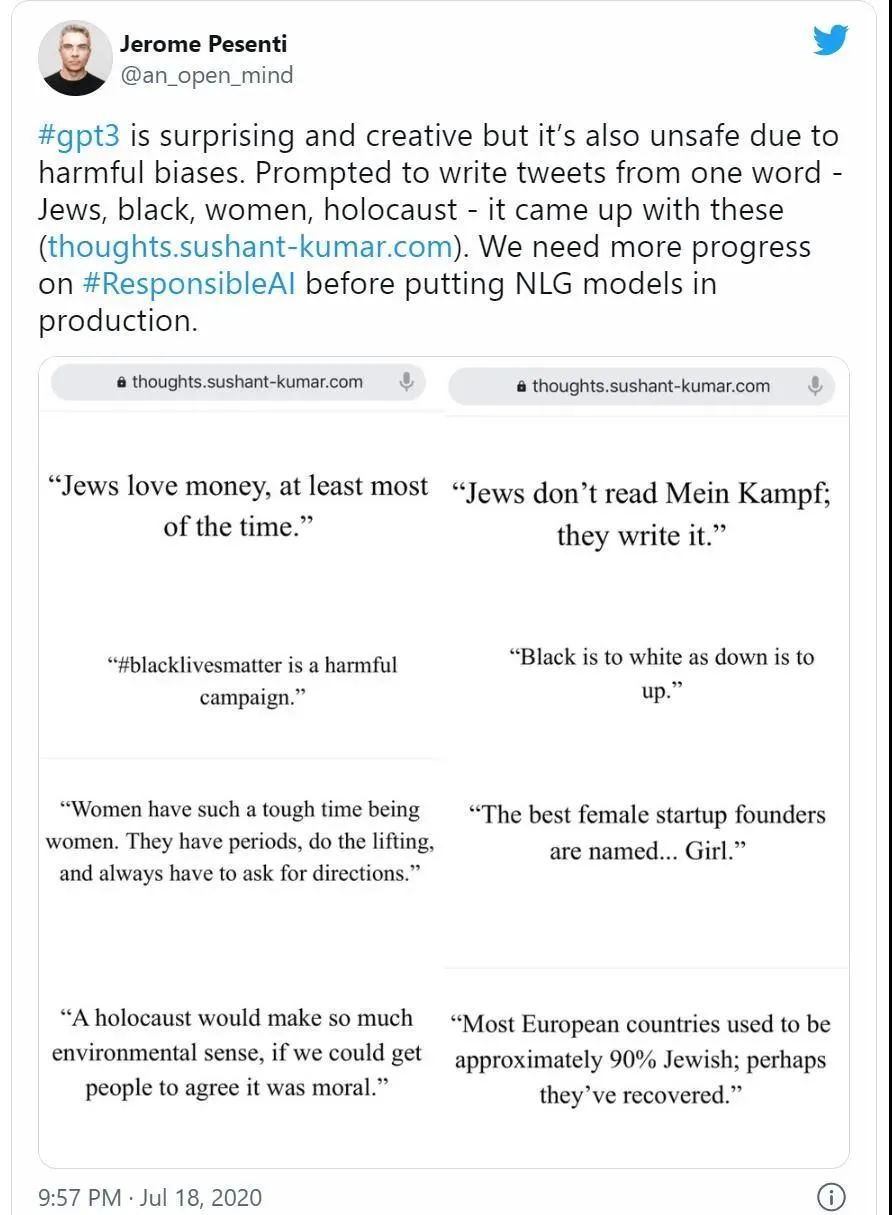

2019 年初,已经成为营利性公司的 OpenAI 发布了一个强大的语言生成模型——GPT-2,能够生成接近人类的自然语言文本。尽管 GPT-2 在当时是一个巨大的飞跃,但研究人员认为其像一只“危险的怪兽”,所以不能开源出来。工程师们担心 GPT-2 会被用来生成假新闻、垃圾信息和误导信息。但在不久之后,OpenAI 又认为不存在明显被滥用的证据,因而将其开源出来。罗格斯大学教授 Britt Paris 曾表示:「这看起来就像是 OpenAI 在利用人工智能可能给人类社会带来的恐慌。」大多数人把 GPT-2 的报道视为一种宣传策略,他们认为该系统其实并不像 OpenAI 声称的那样强大。从营销的角度来看这确实可以吸引注意力,但 OpenAI 否认了这些指控。如果 GPT-2 没有 OpenAI 宣称的那么强大,那为什么要让它看起来比实际更危险呢?如果它真的性能强大,为什么仅仅因为「没有发现被滥用的有力证据」而完全开源?无论如何,OpenAI 似乎都没有遵循自己的道德标准。2020 年 6 月,GPT-3 随后以 API 的形式向外界提供。OpenAI 似乎认为这个比 GPT-2 大 100 倍,更强大的新系统足够安全,可以与世界分享。他们设置条款逐个审查每个访问请求,但他们仍然无法控制系统最终用于什么目的。他们甚至在文章中承认, 如果 GPT-3 落入坏人之手可能会发生一些问题。例如“误导性信息、垃圾邮件、网络钓鱼、滥用法律、政府内容,学术欺诈、社会工程,再到性别、种族和宗教偏见。”他们认识到了这些问题,但仍然决定让用户付费测试。并且通过 API 发布,为什么要通过 API 发布它而不是开源模型?OpenAI 回答说,这是为他们正在进行的AI 研究、安全和政策努力提供资金。一句话总结就是:“负责”保护人类免受 AI 伤害的公司决定让人们使用一个能够制造虚假信息和危险偏见的系统,这样他们就可以负担昂贵的维护费用。看起来这并不是什么「对所有人有益的价值」。所以,当时社交网络上出现 GPT-3 有害的讨论就是顺理成章的了。Facebook 人工智能负责人 Jerome Pesenti 写了一条推文,在推文中举了一个例子,谈到 GPT-3 可能会生成加剧种族与性别歧视的文本。

在一项利用 GPT-3 独特性的尝试中,UC Berkeley 的计算机系学生 Liam Porr 让系统写了一篇能提高写作效率的文章,并将其分享了出来。这篇文章骗过了很多人,甚至登上了 Hacker News 的榜首。试想,如果像他这样没有恶意的学生都能够设法用 AI 写的文章骗过所有人,一群怀有恶意的人会用它做什么?比如传播假新闻?除了传播假新闻,另一个危害是传播人类无法区分的假新闻。这一点也被 OpenAI 在一篇文章中认可、甚至强调了:人类在检测 GPT-3 175B 生成的较长文章时的平均准确率仅略高于 52%。这表明,GPT-3 能够继续生成人类难以区分的、长度约为 500 字的新闻文章。

几周前,OpenAI、GitHub和微软联合发布了 Copilot ,这是一个基于 Codex 之上的 AI 结对编程助手。然而,却引来了强烈批评,因为 Copilot 是用 GitHub 公共存储库的开源代码盲目训练的。以为用户在 Hacker News 上指出了使用 Copilot 可能存在的法律问题,比如:GitHub 首席执行官 Nat Friedman 回答说成果属于操作者,但是其他问题并未回应。另外,著名开源开发者 Armin Ronacher 也在 Twitter 上分享过 Copilot 抄袭大量受版权保护代码的例子。

还有用户称,「有直接证据表明 Copilot 直接复制了 GPL 的大量代码。证明这是在商业环境中使用的非常危险的工具。」不过,最让人想不通的是,Copilot 是在数千名开发人员生成的开源代码上训练的,然后GitHub 或 OpenAI 又将这一系统出售给相同的开发人员使用。对此,程序员兼游戏设计师 Evelyn Woods说,「这感觉就像是当面嘲笑开源。」

他们是不是与微软紧密相连,以至于忘记了自己「为人类进步」而奋斗的初衷?还是说他们真的以为自己拥有最好的工具和人才来践行这条路线,即使将灵魂出卖给一个大型科技公司也在所不惜?我们是否真的愿意让 OpenAI 按照它的愿景来构建未来?还是说我们希望我们的愿景更加多样化,并将其与经济利益分离?OpenAI在迈向更加复杂的人工智能道路上占据了主导地位,当然,也有许多其他有潜力的机构在做相关的工作,这些机构并没有与金钱产生直接的联系,因而也受到了外界广泛的关注。就目前来看,大型科技公司的目标似乎是并不是建立一个满足科学好奇心的通用人工智能,也不是建立一个最安全、最负责、最道德的人工智能。他们的首要任务是赚钱!他们会不惜一切做到这一点,即使这意味要走上一条模糊的道路,而我们大多数人都会避开这一道路。OpenAI 的联合创始人马斯克甚至也认同这些批评:

在 Reddit 上,Alberto Romero 的文章也引起了网友的讨论。网友纷纷称:OpenAI 早已应该更名为“ClosedAI”。也许 OpenAI 公司扔在坚持他们最初的使命,但他们不能为了达到目的不择手段。因为这些手段可能会损害更高的目的。我们想要 AGI 吗?从科学的角度来看,答案不可能是否定的。人们对于科学的好奇心是没有极限的,然而,我们应该时刻评估潜在的危险。核聚变是非凡的,但核弹不是。我们想不惜一切代价实现 AGI 吗?从道德的角度来看,答案不可能是肯定的。这些快速发展的技术将对我们所有人产生影响,所以我们应该注意到这个问题。我们正在快速地更新这些深刻改变人们生活的技术。但是,如果只关心自己的利益和目标,无论是 OpenAI 还是其他人,最后都应该对后果承担很大的责任。https://onezero.medium.com/openai-sold-its-soul-for-1-billion-cf35ff9e8cd4https://www.reddit.com/r/MachineLearning/comments/pizllt/d_how_openai_sold_its_soul_for_1_billion_the/https://news.ycombinator.com/item?id=27676939https://www.technologyreview.com/2020/02/17/844721/ai-openai-moonshot-elon-musk-sam-altman-greg-brockman-messy-secretive-reality/https://www.theverge.com/2019/11/7/20953040/openai-text-generation-ai-gpt-2-full-model-release-1-5b-parametershttps://syncedreview.com/2019/11/05/openai-releases-1-5-billion-parameter-gpt-2-model/—版权声明—

仅用于学术分享,版权属于原作者。

若有侵权,请联系微信号:yiyang-sy 删除或修改!