【机器学习】一文概览量子机器学习!

【导读】大家好,我是泳鱼。一个乐于探索和分享AI知识的码农!熟话说,“遇事不决 量子力学!”。当两股科技顶流——量子计算 + 人工智能 相遇,会产生怎么样的火花呢?

今天带来的这篇文章首先介绍了量子计算+机器学习的基本概念,接着从五个方面分别介绍了量子机器学习,分别是量子有监督学习、量子无监督学习、量子强化学习、量子深度学习、量子迁移学习、量子降维学习,并介绍了几种常用的量子机器学习库,最后对量子机器学习未来的工作进行展望。

0 背景介绍

机器学习是人工智能的核心组成,在过去十几年里不断发展,并对其他领域产生了深远的影响。近几年,研究人员发现结合量子计算特性的新型机器学习算法可实现对传统算法的加速,该类成果引起了广泛的关注和研究。

图1 量子机器学习算法的发展历程

1 量子机器学习

量子计算是一种基于量子力学原理的计算技术,它利用量子比特的叠加态和纠缠态,能够快速地处理大规模的数据,并且能够解决一些经典计算难以解决的问题。

机器学习是一种让计算机能够通过经验和数据自我改进的技术。在机器学习中,计算机通过对训练数据的分析和学习,可以自动地发现数据中的规律和模式,并根据这些规律和模式进行预测和决策。

量子计算与机器学习的结合是一个新兴的研究领域,称为量子机器学习。量子机器学习的目标是利用量子计算的优势,如量子并行性和量子纠缠,来加速机器学习的训练和推理过程,同时也可以为量子计算提供更好的应用场景和更高的应用价值。

虽然量子机器学习仍处于发展初期,但已经有一些实质性的进展。例如,量子支持向量机的实现已经被证明可以在量子计算机上实现指数级加速,而量子神经网络的训练也已经在实验中得到了初步的验证。随着量子计算技术的不断发展和机器学习算法的不断创新,相信量子机器学习将会成为一个重要的研究领域,并为人工智能的发展带来新的机遇和挑战。

2 量子机器学习与传统机器学习的联系和区别

量子机器学习算法可以通过经典机器学习算法来优化和改进,例如使用经典的优化算法来优化量子神经网络的参数。传统机器学习算法也可以通过量子计算的方法来处理高维数据和非线性问题,例如使用量子支持向量机来处理高维数据。因此,量子机器学习算法和传统机器学习算法可以相互补充和促进。

量子机器学习算法和传统机器学习算法存在的区别可以从数据表示方式、计算方式、算法复杂度、应用场景、研究方向等方面来分析。

2.1 数据表示方式

传统机器学习算法使用经典的二进制表示方式来表示数据,而量子机器学习算法使用量子态来表示数据。量子态是一种复杂的数学对象,它可以表示多个状态的叠加和纠缠关系。

2.2 计算方式

传统机器学习算法使用经典的计算方式来处理数据,而量子机器学习算法使用量子计算的方式来处理数据。量子计算是一种基于量子力学原理的计算方式,它可以在较短的时间内处理复杂的问题。量子计算的基本单位是量子比特(qubit),它可以表示多个状态的叠加和纠缠关系。

2.3 算法复杂度

量子机器学习算法的时间复杂度通常比传统机器学习算法低,但是空间复杂度通常比传统机器学习算法高。这是因为量子机器学习算法可以利用量子计算的并行性质,在较短的时间内找到最优解。但是,量子机器学习算法需要存储和操作大量的量子态,这需要更多的存储空间和计算资源。

2.4 应用场景

传统机器学习算法适用于处理低维数据和线性问题,而量子机器学习算法适用于处理高维数据和非线性问题。传统机器学习算法通常使用线性模型或者基于树的模型来处理数据,这些模型在处理高维数据和非线性问题时效果不佳。而量子机器学习算法可以使用量子神经网络或者量子支持向量机等模型来处理高维数据和非线性问题,这些模型可以利用量子计算的优势来提高算法的效率和准确性。

2.5 研究方向

传统机器学习算法的研究主要集中在算法的改进和优化上,例如深度学习、强化学习等。而量子机器学习算法的研究主要集中在算法的设计和实现上,例如量子神经网络、量子支持向量机等。此外,量子机器学习算法还需要解决量子纠错、量子噪声等问题,这些问题在传统机器学习算法中并不需要考虑。

3 量子机器学习算法步骤

量子机器学习算法的步骤可以概括为:将经典数据和特征转换为量子态,对量子态进行量子算法运算,将量子输出结果转换为经典输出结果。这些步骤的具体实现方式和顺序取决于具体的算法和任务。

3.1 量子数据编码

量子数据编码的目的是将经典数据转换为量子态,以便在量子计算机上进行处理。量子数据编码可以使用不同的方法,如量子振幅编码、量子相位编码等。例如,在量子支持向量机算法中,可以使用量子振幅编码将经典数据转换为量子态。

3.2 量子特征映射

量子特征映射的目的是将经典特征转换为量子态,以便在量子计算机上进行处理。量子特征映射可以使用不同的方法,如量子线性变换、量子非线性变换等。例如,在量子支持向量机算法中,可以使用量子线性变换将经典特征映射到量子态上。

3.3 量子算法运算

量子算法运算的目的是对量子态进行处理,以实现机器学习的任务。量子算法运算可以使用不同的方法,如量子相位估计、量子相位放大等。例如,在量子支持向量机算法中,可以使用量子相位估计算法来计算支持向量机分类器的核函数值。具体来说,可以将经典的核函数表示为一个量子电路,然后使用量子相位估计算法来估计其相位,从而得到分类器的输出。

3.4 量子测量

对量子态进行测量,得到经典输出结果。这一步骤可以使用不同的测量方法,如基态测量、投影测量等。例如,在量子支持向量机算法中,可以使用基态测量来得到分类器的输出结果。

3.5 经典数据解码

将量子输出结果转换为经典输出结果。这一步骤可以使用不同的解码方法,如量子振幅放大、量子相位估计等。例如,在量子支持向量机算法中,可以使用量子振幅放大来增强分类器的输出结果。

不同的量子机器学习算法可以使用不同的编码、特征映射、算法、测量和解码方法,以实现不同的机器学习任务。具体来说,可以使用量子梯度下降算法来计算损失函数的梯度,并使用量子模拟算法来模拟神经网络的前向传播过程。最后,可以使用量子测量和经典数据解码来将量子输出结果转换为经典输出结果。

除了上述步骤,量子机器学习算法还需要考虑一些其他的问题,例如:

量子噪声和误差:量子计算机的运算过程容易受到噪声和误差的影响,因此需要采取相应的纠错和校准方法来提高算法的鲁棒性和可靠性。

量子资源的利用:量子计算机的资源有限,因此需要设计高效的量子算法来充分利用这些资源,同时避免不必要的浪费。

经典和量子计算的结合:量子机器学习算法通常需要与经典计算机进行交互和结合,因此需要设计合适的接口和协议来实现这种交互和结合。

算法的可解释性和可验证性:量子机器学习算法通常比经典机器学习算法更难以解释和验证,因此需要设计相应的方法来提高算法的可解释性和可验证性,以便更好地理解和应用这些算法。

4 量子机器学习分类

量子机器学习的研究内容包括量子有监督学习、量子无监督学习、量子强化学习、量子深度学习、量子迁移学习、量子降维学习。

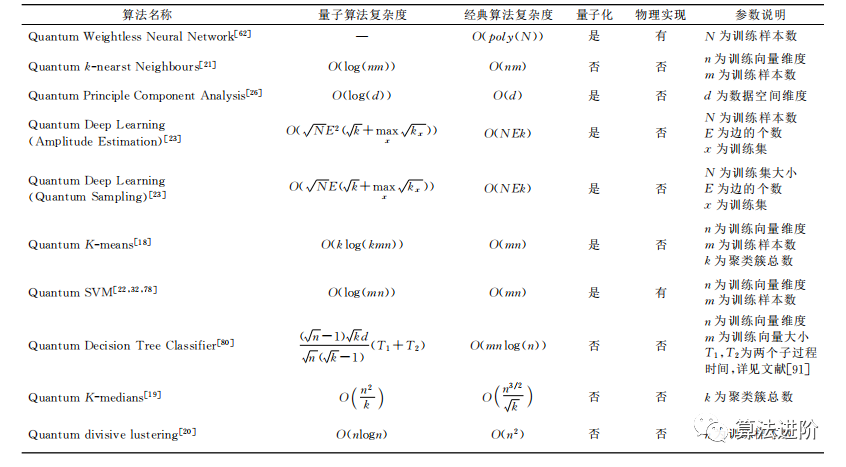

表1 量子机器学习算法

表1 量子机器学习算法

4.1 量子有监督学习

有监督量子分类算法是一种基于量子计算的算法,用于分类问题。它需要有标记的训练数据,以便训练模型。在量子监督学习中,训练数据包括输入和输出,通过训练数据来学习输入和输出之间的关系。

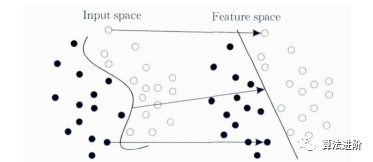

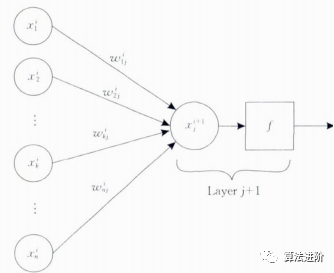

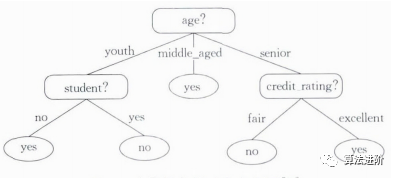

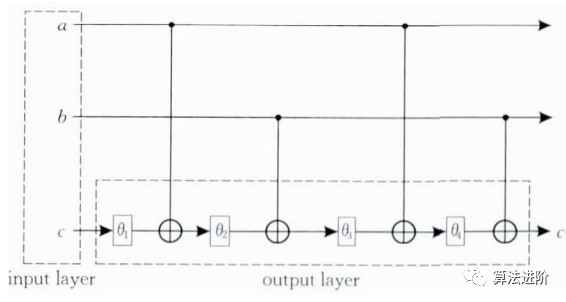

常见的有监督量子分类算法包括量子K近邻算法(KNN)、量子支持向量机(SVM)(图2)、量子神经网络(图3)、量子决策树算法(图4)等。其中,量子支持向量机可以用于分类和回归问题。量子神经网络可以用于图像识别、语音识别等任务。量子神经网络模型的实现方式大致可分为以下几类:基于测量的量子神经网络;基于量子点的神经网络;基于量子门电路的神经网络(图5);基于量子比特的神经网络(图6)等。

图2 SVM特征空间映射示意图

图3 神经网络示意图

图4 决策树分类过程实例图

图5 基于量子门电路的神经网络

图6 基于量子比特的神经网络

4.2 量子无监督学习

量子无监督学习是一种基于量子计算的无监督学习方法,它不需要有标记的训练数据,而是通过将数据编码为量子态,利用量子态的叠加和纠缠性质,将数据点分组成不同的簇,从而提取出有用的信息。在量子无监督学习中,训练数据只包括输入,没有输出,通过训练数据来学习输入之间的关系。量子无监督学习可以用于聚类、降维等任务。

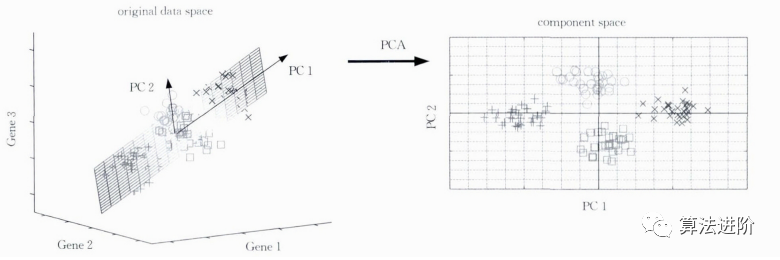

常见的量子无监督学习方法包括量子主成分分析(QPCA)(图7)、量子自编码器(QAE)、量子K-means聚类算法等。这些算法可以在较短的时间内找到最优的聚类结果,但在某些情况下可能会失效。其中,量子主成分分析可以通过量子计算机的优势来加速经典主成分分析算法,从而实现更高效的降维任务;量子聚类可以通过量子计算机的优势来加速经典聚类算法,从而实现更高效的聚类任务。

图7 主成分分析示意图

4.3 量子强化学习

量子强化学习是一种基于量子计算的强化学习算法,它可以用于智能控制和自适应优化等领域,如游戏、机器人控制等任务。在量子强化学习中,智能体通过与环境的交互来学习如何做出最优决策,从而最大化累积奖励。与经典强化学习相比,量子强化学习可以在较短的时间内找出最优的策略,但在某些情况下可能会失效。

常见的量子强化学习算法包括量子Q学习、量子策略梯度等。量子Q学习是利用量子态的叠加和纠缠性质来更新Q值函数;量子策略梯度是利用量子态的叠加和纠缠性质来更新策略函数。这些算法都利用了量子计算的优势,如叠加和纠缠性质,来解决强化学习中的问题。

4.4 量子深度学习

量子深度学习是一种基于量子计算的深度学习方法,它利用量子计算的优势来解决深度学习中的问题。在量子深度学习中,神经网络的参数和输入数据都被表示为量子态,并利用量子态的叠加和纠缠性质来进行计算。与经典深度学习相比,量子深度学习可以在较短的时间内找到最优的参数,但在某些情况下可能会失效。

常见的量子深度学习算法包括量子神经网络、量子变分算法等。量子神经网络利用量子态的叠加和纠缠性质来进行计算。量子变分算法利用量子态的叠加和纠缠性质来进行参数优化。

4.5 量子迁移学习

量子迁移学习是一种基于量子计算的迁移学习方法,它利用已有的量子数据来帮助解决新的量子学习问题。在量子迁移学习中,已有的量子数据被称为源域数据,新的量子学习问题被称为目标域问题。通过将源域数据和目标域问题进行映射,可以将源域数据的知识迁移到目标域问题中,从而提高目标域问题的学习效果。在量子迁移学习中,通过将已学习的知识迁移到新的任务中来加速学习过程。量子迁移学习可以用于快速适应新的任务。

常见的量子迁移学习算法包括量子域自适应迁移学习、量子域迁移学习等。量子域自适应迁移学习利用量子态的叠加和纠缠性质来进行计算;量子域迁移学习利用量子态的叠加和纠缠性质来进行源域数据和目标域问题之间的映射。

4.6 量子降维学习

量子降维学习是一种基于量子计算的降维学习方法,它利用量子计算的优势来解决高维数据的降维问题。在量子降维学习中,高维数据被表示为量子态,并利用量子态的叠加和纠缠性质来进行计算。与经典降维学习相比,量子降维学习可以在较短的时间内找到最优的降维方案,但在某些情况下可能会失效。

常见的量子降维学习算法包括量子主成分分析、量子流形学习等。量子主成分分析利用量子态的叠加和纠缠性质来进行计算;量子流形学习利用量子态的叠加和纠缠性质来进行流形学习。

5 量子机器学习库

量子机器学习库是一组工具和算法,用于构建和训练量子机器学习模型。由于真实的量子计算的硬件设施过于昂贵,对于研究者而言,需要借助经典计算机对量子线路(演化)进行仿真,从而开展研究。这些量子机器学习的仿真库旨在帮助研究人员和开发人员更好地理解和利用量子计算的优势。它们的实现方式各不相同,但都提供了丰富的工具和算法,用于构建和训练量子机器学习模型。常见的量子机器学习库包括Qiskit Machine Learning、PennyLane、Cirq、TensorFlow Quantum和TensorCircuit等。

5.1 Qiskit Machine Learning

Qiskit Machine Learning是IBM Qiskit量子计算平台的一部分,它提供了一系列工具和算法,用于构建和训练量子机器学习模型。Qiskit Machine Learning支持多种量子机器学习任务,包括分类、回归和强化学习等。它还提供了一些经典机器学习算法的量子实现,例如量子支持向量机和量子主成分分析。

Qiskit Machine Learning与IBM Q Experience集成,这使得用户可以在IBM Q Experience上运行他们的量子机器学习模型,并比较它们的性能。此外,Qiskit Machine Learning还提供了一些量子神经网络的构建工具,例如量子变分电路和量子卷积神经网络。这些工具使得用户可以构建和训练各种类型的量子神经网络,以解决不同的量子机器学习问题。

5.2 PennyLane

PennyLane是一个开源的量子机器学习库,由Xanadu开发。它提供了一系列工具和算法,用于构建和训练量子机器学习模型。PennyLane支持多种量子机器学习任务,包括分类、回归和强化学习等。它还提供了一些经典机器学习算法的量子实现,例如量子支持向量机和量子主成分分析。

PennyLane支持多种量子计算平台,包括IBM Q、Google Cirq和Rigetti Forest等。这使得用户可以在不同的量子硬件上运行他们的量子机器学习模型,并比较它们的性能。此外,PennyLane还提供了一些量子神经网络的构建工具,例如量子变分电路和量子卷积神经网络。这些工具使得用户可以构建和训练各种类型的量子神经网络,以解决不同的量子机器学习问题。

5.3 Cirq

Cirq是Google开发的一个开源的量子计算框架,用于构建、测试和运行量子算法。Cirq支持多种量子计算平台,包括Google的量子处理器和模拟器。它提供了一系列工具和算法,用于构建和运行量子电路,并进行量子模拟和量子算法的测试。

Cirq提供了一种用于构建和运行量子电路的Python API,这使得用户可以使用Python编写量子算法,并在Cirq中进行量子模拟和量子算法的测试。此外,Cirq还提供了一些量子算法的实现,例如量子随机行走和量子主成分分析。

总之,Cirq是一个功能强大的量子计算框架,它为用户提供了丰富的工具和算法,以构建、测试和运行量子算法。它的Python API和量子算法的实现使得用户可以使用Python编写量子算法,并在Cirq中进行量子模拟和量子算法的测试。

5.4 TensorFlow Quantum

TensorFlow Quantum是Google开发的一个开源的量子机器学习库。它结合了TensorFlow和Cirq,提供了一种用于构建和训练量子神经网络的框架。TensorFlow Quantum支持多种量子机器学习任务,包括分类、回归和强化学习等。它还提供了一些经典机器学习算法的量子实现,例如量子支持向量机和量子主成分分析。

TensorFlow Quantum支持多种量子计算平台,包括Google的量子处理器和模拟器。这使得用户可以在不同的量子硬件上运行他们的量子机器学习模型,并比较它们的性能。此外,TensorFlow Quantum和PennyLane一样,还提供了一些量子神经网络的构建工具,例如量子变分电路和量子卷积神经网络。

5.5 TensorCircuit

TensorCircuit是最新的量子计算库,里面结合了开发者对已经存在的库的不足之处的反思,应该是代表了量子计算库研究方面最新的进展。

TensorCircuit由纯 Python 编写,基于张量网络引擎,直接构建在成熟的机器学习框架 TensorFlow、JAX、PyTorch 之上,兼容自动微分、即时编译、硬件加速和矢量化并行等先进的工程范式,适用于理想、噪声和近似情况下量子经典混合范式和变分量子算法的高效模拟。它还具有简洁优雅的接口,灵活可扩展的架构,全面丰富的功能,相较其他软件数量级加速的性能和特定线路结构下上百个量子比特的模拟能力。如下TensorFlow 接口的代码示例:

import tensorcircuit as tcimport tensorflow as tfK = tc.set_backend("tensorflow")n = 1def loss(params, n):c = tc.Circuit(n)for i in range(n):c.rx(i, theta=params[0, i])for i in range(n):c.rz(i, theta=params[1, i])loss = 0.0for i in range(n):loss += c.expectation([tc.gates.z(), [i]])return tf.math.real(loss)def vgf(params, n):with tf.GradientTape() as tape:tape.watch(params)l = loss(params, n)return l, tape.gradient(l, params)vgf = tf.function(vgf)params = tf.random.normal([2, n])print(vgf(params, n))

从学术研究的角度来看,仿真量子计算库的规模越大越好,且支持GPU能显著提高效率;对于研究者而言,编写底层代码繁琐,因此便捷性和快速实施是第一准则;对于工业界而言,易用性和便捷性同样重要。

6 总结与展望

量子机器学习是一个较为空白的交叉研究领域,结合了量子力学和机器学习的原理。首先,它利用量子计算的高并行性来提高机器学习处理、分析和挖掘大数据的能力;其次,它借鉴量子力学的原理来促进新机器学习算法的产生;第三,它借鉴传统传统的机器学习算法,提出了量子力学领域的一种新的研究方法,如提出新的量子断层分析方法。

近年来量子机器学习吸引着越来越多的科研团队、企业和个体研究者,该领域的研究不仅可以推动机器学习发展提高机器学习的学习效率和学习精度,也可促进量子世界的繁荣发展。加之,大数据时代来临、人工智能方兴未艾,这些都是推动量子机器学习发展的内在动力。综上所述,未来量子机器学习的研究令人振奋,同时也充满挑战。

往期精彩回顾

适合初学者入门人工智能的路线及资料下载

(图文+视频)机器学习入门系列下载

机器学习及深度学习笔记等资料打印

《统计学习方法》的代码复现专辑

机器学习交流qq群772479961,加入微信群请扫码