一文讲透鱼眼相机畸变矫正,及目标检测项目应用

共

6636字,需浏览

14分钟

·

2022-05-27 09:59

点击下方卡片,关注“新机器视觉”公众号

重磅干货,第一时间送达

本文由《AI未来星球》-潘大强 分享

作者:潘大强

转自:江大白

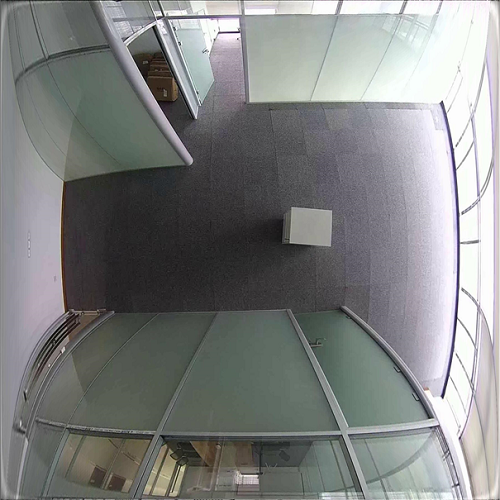

在CV项目中,枪机、球机很常用,但是还有一个非常重要的相机-鱼眼相机,在很多遮挡严重的场景中,比如客流统计、轨迹追踪,常常由于遮挡而效果不好。因此采用鱼眼相机,是一个非常好的方式。本文是《AI未来星球》潘大强老师的行业内部分享,希望对于大家鱼眼相机项目落地会有帮助!1 个人介绍

2 鱼眼相机的畸变矫正

3 鱼眼相机的三种矫正方法

3.1 棋盘标定法

3.2 横向展开法

4.1 棋盘标定法

4.2 横向展开法

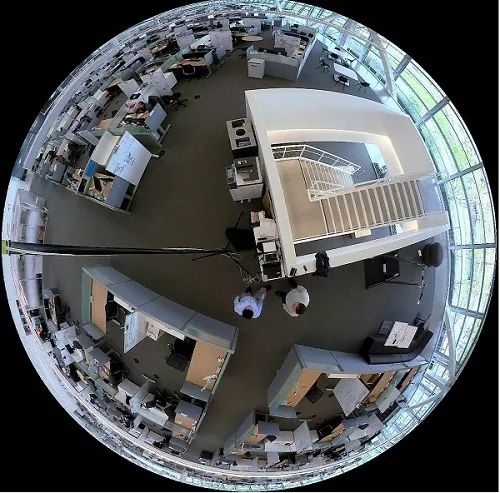

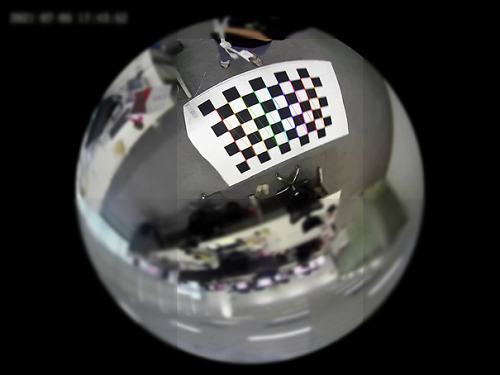

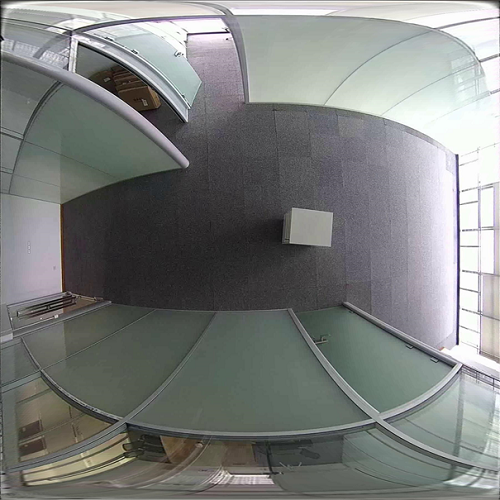

应大白的邀请,从AI从业者的角度,分享工作中遇到的一些经验。之前在江大白的群里,看到有同学提问“鱼眼相机标定”的问题。对于鱼眼相机的标定和矫正,网上已经有很多理论文章,但是落实到代码层面的并不多,而且大部分代码都是C++实现。但是做AI的同学,大多数都是用python语言,所以本次分享,我用python语言(只依赖opencv-python包和numpy包),把之前做的鱼眼矫正和变形的相关经验,以实践为目的,一步步分享给大家。首先我们来了解一下鱼眼相机,和平时普通相机拍摄出的效果不同,鱼眼相机通常固定在空间顶部,所以拍摄出的视角是这样的:大家可以看到,鱼眼图像类似于把很大角度范围内的光线,进行「压缩」和「扭曲」,将图像压进一个相对较小的空间内。鱼眼相机采用的是鱼眼镜头,它的前镜组具有一个极凸的镜片表面,外形上看起来让人联想到鱼的眼睛,这就是“鱼眼”的由来。在目标追踪任务中,通常的球机或者枪机方案,无法避免人群遮挡的问题,从而导致较高的ID Swich,造成追踪不稳定。但是鱼眼相机的顶视角安装方式,天然缓解了人群遮挡的问题。 在客流统计任务中,鱼眼相机利用视野大的优势,在同一空间中,可以顶X个枪机。当然除了降低硬件成本,还能避免多相机检测导致的区域人数去重。了解了鱼眼相机的原理和优势,但在实际项目中,我们会对鱼眼图像进行矫正和变形,作为最终应用的前置任务。无论是单目相机还是双目相机,拍摄的图像都会存在畸变。它们和鱼眼相机的畸变矫正原理也是一样的:核心是求解一个“好”的重映射矩阵(remap matrix)。从而将原图中的部分像素点(或插值点)进行重新排列,“拼”成一张矩形图。“好”是跟最终需求挂钩的,不同任务往往采用不同的矫正/变形方案。对于单目相机,为了得到相机像素坐标系和三维世界坐标系的对应关系,我们需要对相机的桶形畸变和枕形畸变进行矫正。张正友老师的棋盘标定法,通过标志物的位置坐标,估计出相机的内外参数和畸变系数,从而计算出remap matrix。该方法是目前上述两类相机,矫正效果最好的方法。对于鱼眼相机,本次主要分享三种方法:棋盘标定法、横向展开法、经纬度法。下图是某款鱼眼相机的采集图像,而真正有效的监控区域,是内部的圆形区域。(1)棋盘标定法

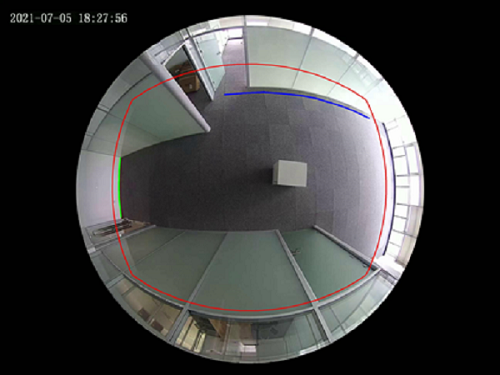

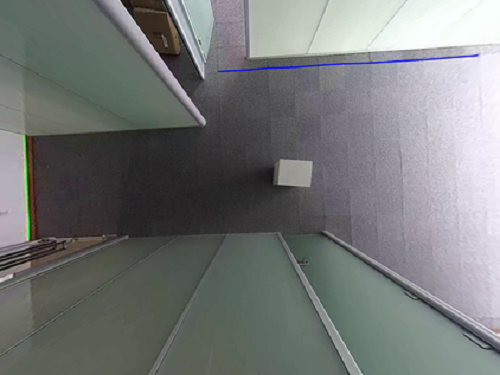

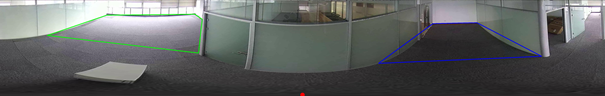

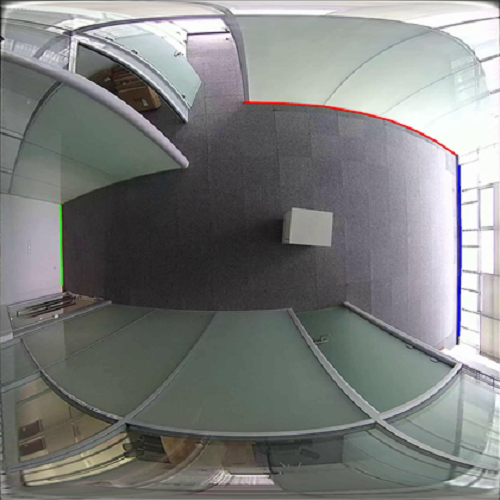

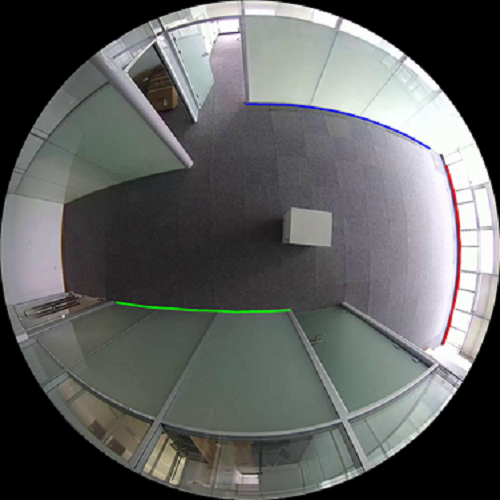

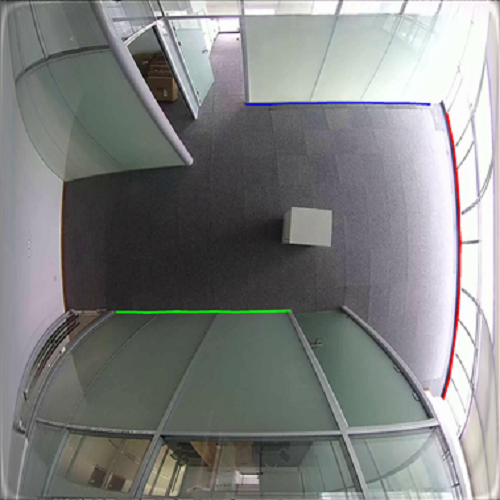

棋盘矫正法的目的,是将鱼眼图“天生”的桶形畸变进行矫正。具体效果类似于“用手对着圆形中心做挤压,把它压平”,使得真实世界中的直线,在矫正后依然是直线。① 现实世界中的直线,在鱼眼图中发生了扭曲(如鱼眼图中的蓝色和绿色曲线),矫正后变成了直线(如正方形图中的蓝色和绿色直线);② 矫正图只占据了鱼眼图中间的一部分(如鱼眼图中的红色曲线)。从这个矫正效果中,可以看出:棋盘标定法的缺点,是靠近圆周(外围区域)的区域,会被拉伸的很严重,视觉效果变差。所以一般会进行切除,导致矫正后的图片只保留了原图的中间区域。基于以上特点,在实际使用中,我会把棋盘标定法,作为简单测量的前置任务(矫正图中的两点距离和真实世界中的两点距离,存在一一对应的关系)。也可以作为鱼眼图像拼接的前置任务(真实世界中的三点共线,在拼接图中依然共线)。(2)横向展开法

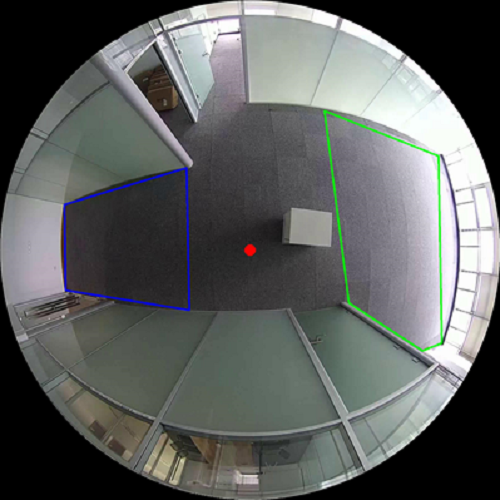

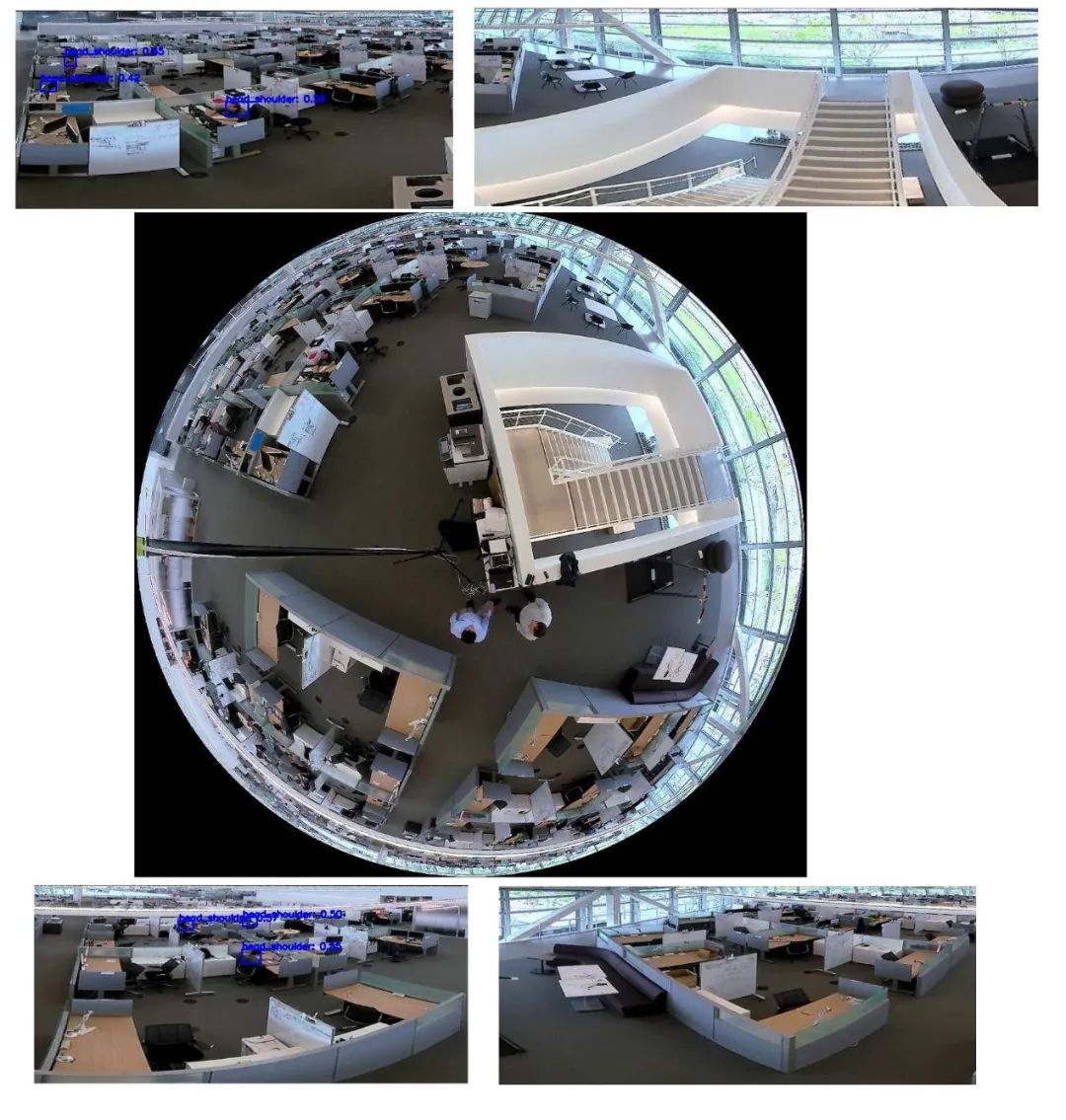

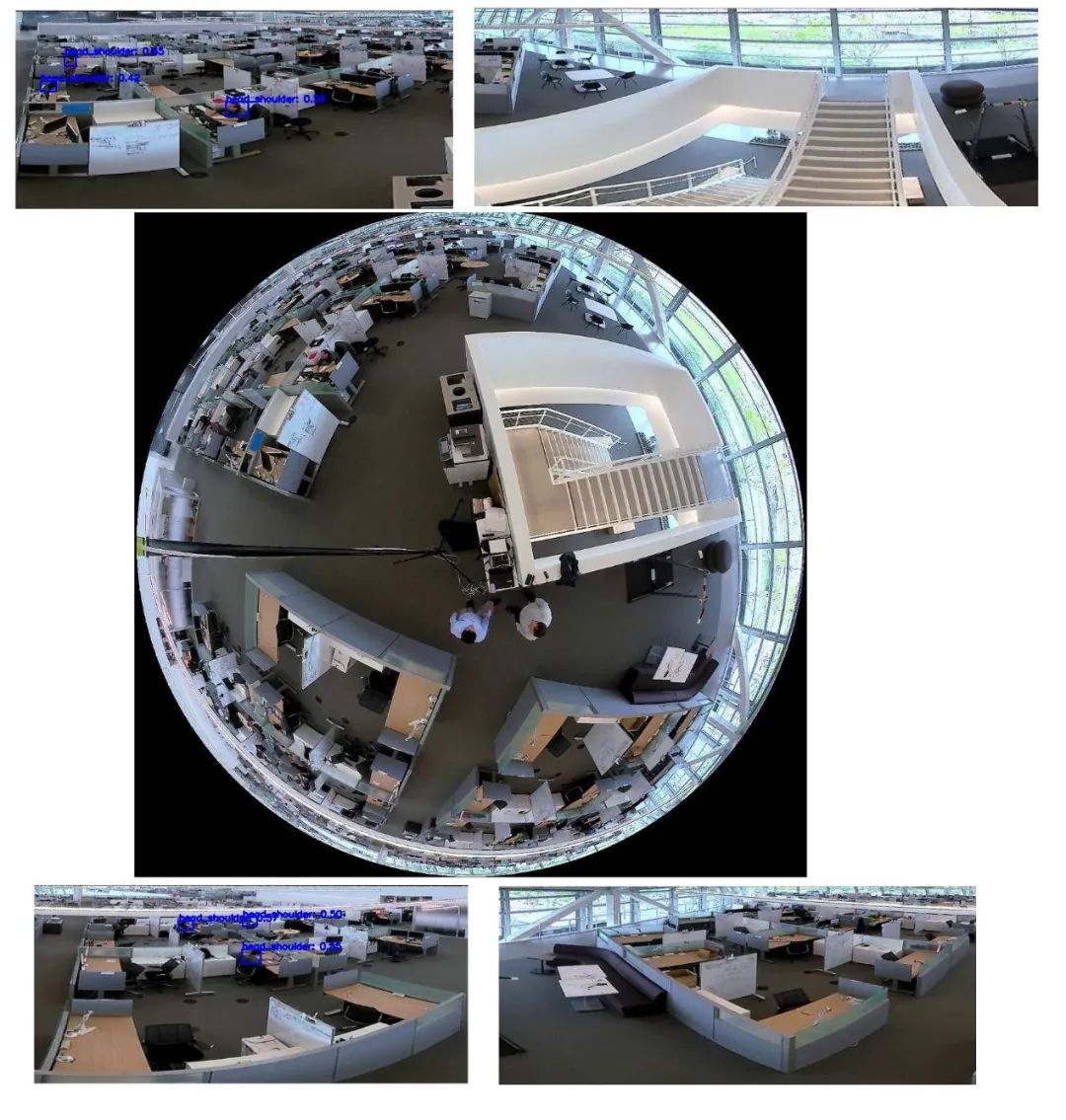

横向展开法,主要是利用鱼眼相机的大FOV和俯视拍摄的特点,来进行变形。比如我们把上图中的红点,想象成一个观察者,当他身体旋转360度,看到的什么样的画面呢?因此可以根据区域功能,进行切片,再用普通视角的检测模型,做后续任务。但是缺点也一目了然,比如展开图的左右两侧,在真实世界中应该是连通的。所以当有目标在鱼眼图中穿过分界线时,在展开图中该目标会从左侧消失,右侧出现(或者倒过来),看起来不是很自然。基于以上特点,在实际使用中,我会利用鱼眼相机,覆盖面积大的特点(比如3米层高的情况下,至少覆盖100平米),在“某些场景”中取代枪机或半球机,画面展开后用正常的检测器去完成后续任务。① COCO数据集上训练的人体检测器,在鱼眼图中直接使用是不会work的;② 与棋盘标定法不同,横向展开不会损失像素,所以展开图也可以再remap回鱼眼原图。(3)经纬度法

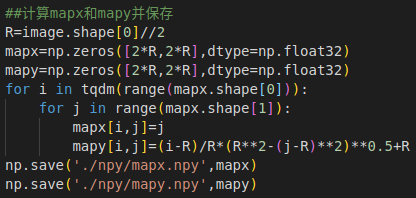

该方法与棋盘矫正法相比,没有像素损失,也不需要标定(人为设计规则求解remap matrix)。但是缺点也很明显,它只对竖直方向(图中的蓝色线和绿色线)进行了矫正,而水平方向(红色线)依然是扭曲的。可以看到,只对水平方向(图中的蓝色线和绿色线)进行了矫正,而竖直方向(红色线)依然是扭曲的。基于以上特点,在实际落地中,我没有采用经纬度矫正法。更多的是在学习和研究阶段,把它当作设计和计算remap matrix的一个作业。了解上面三种矫正效果的原理,下面我们再来看一下具体的算法实现。无论采用以上哪种方法,最核心的部分是求解remap matrix,具体到之后的代码中就是mapx和mapy两个变量。它们反映了矫正图中的像素坐标和原始图像素坐标之间的对应关系。如果我们把原图记为image, mapx和mapy表示以上三种方法求出的不同的映射矩阵,那么通过原图和映射矩阵,就可以得到矫正/变形后的图像,记为image_remap。其中 mapx和mapy 的shape都是 ( image_remap.shape[0], image_remap.shape[1] )。且“mapx[i, j]=m 和 mapy[i, j]=n” 表示 “image_remap的第i行、第j列的像素值,等于image的第n行、第m列的像素”,其中m, n允许是非整数 。下面我针对以上三种方法,依次贴出代码实现和流程解释。(1)棋盘标定法

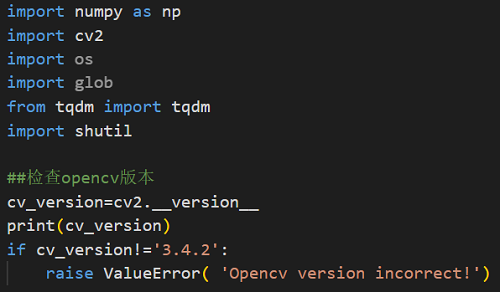

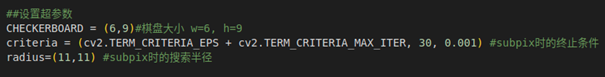

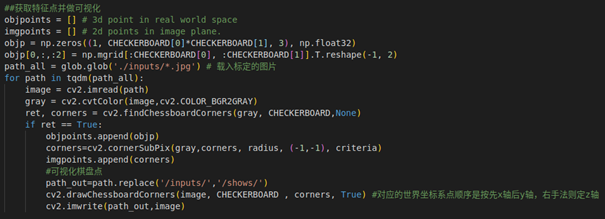

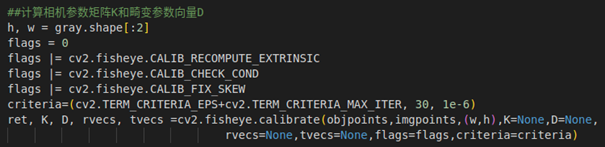

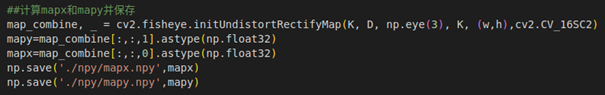

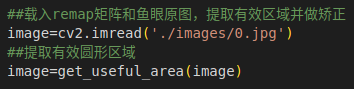

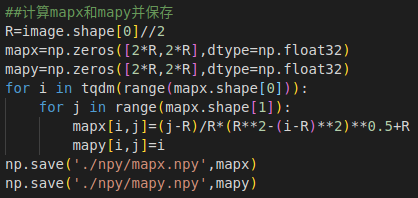

① 载入依赖包,和计算相关的只有opencv-python和numpy,我用的opencv版本是3.4.2.16, 初次使用建议改成该版本。② 设置超参数,主要是 CHECKERBOARD, 保证输入大小和你的棋盘大小是一致的。以我的案例图为例,黑白方块共有 7*10 个,所以棋盘的内点数量是 w=7-1=6, h=10-1=9。③ 按照张正友标定法的流程,对拍摄的各种姿态棋盘图,进行角点检测和亚像素提取。 拍摄数量一般在50~80之间,保证棋盘的宽高可以占整个画面1/4以上。上述代码会将提取的棋盘点,绘制在原图中并做保存,我们可以肉眼检测一遍,将提取有误的图片从库中剔除。④ 根据提取的棋盘点坐标,计算相机参数和畸变参数。ret表示拟合误差,如果ret很大,说明在第③步中检测的棋盘点不准确,可以回去再检查下(比如ret>5)。K和D分别是相机内参和畸变参数,之后会用到。rvecs和tvecs是相机外参。⑤ 根据相机内参和畸变参数求解remap matrix,并做保存。至此,“训练”阶段结束。只要相机不变,这组remap matrix可以重复使用。⑥ 加载remap matrix,对输入的鱼眼图片进行remap矫正。(2)横向展开法

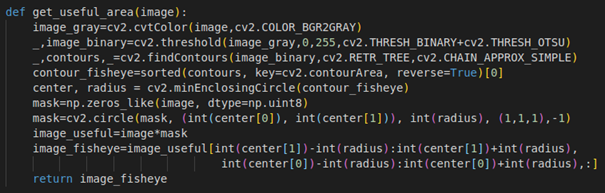

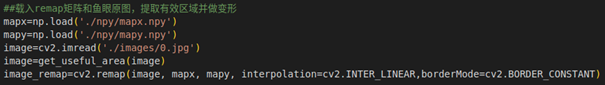

① 横向展开法需要对鱼眼图片,先crop出圆形有效区域,再做横向展开。我写了个简单的提取函数get_useful_area,剔除多余黑边。代码为: 当然在实际落地时,相机型号一旦确定,完全可以手动找到合适的参数,切去“黑边”。至此,“训练”阶段结束。同样只要相机不变,这组remap matrix可以重复使用。③ 加载remap matrix,对输入的鱼眼图片,进行有效区域提取和remap变形。(3)经纬度法

经纬度法也不需要做相机标定,所以方法流程和横向展开法一样,只是remap matrix的计算公式不同。以上就是本次关于鱼眼相机的畸变与矫正的分享,希望对大家工作和学习有帮助。大家如果有相关问题想了解的,也可以进行提问,我来给大家解答。PS:本次分享内容中的相关图片和完整代码,点击“阅读原文”进行获取。Q:想问下,鱼眼相机和平时常用的枪机,在不同的项目任务中,如何更好的选择?A:看任务需求吧,如果是室内场景,并且只是统计人数或者目标追踪,可以考虑用鱼眼相机。但是如果要提取目标的属性特征,比如做人脸识别,ReID,口罩识别等,还是得用枪机。Q:在前面鱼眼相机的校正中,有三种方式,经纬度法不太推荐。那么针对剩下的两种,棋盘标定法和横向展开法,实际应用中,更倾向于哪一种呢?A:这个要看需求的吧,刚才分享时也提到了。棋盘标定是真正做到了去畸变,所以适合作为测量和拼接的前置任务。对于横向展开法的用处,我就看到一种:如果要对鱼眼图像做目标检测,但是之前的检测器都是正常正视视角的,那可以考虑把鱼眼图横向展开切片后,再上检测器。我找下图。正中间的鱼眼图,我用头肩检测器去推理时,没有检到任何目标。然后我把它横向展开后,按区域切成4块,再用头肩检测器逐一推理,是可以检测到目标的(图中的蓝色框)。Q:你刚才说要横向展开后再做检测,是因为直接对鱼眼图像做目标检测时,效果不好吗?RAPiD: Rotation-Aware People Detection in Overhead Fisheye Images它提供了鱼眼相机下的人体检测方案,用旋转矩形框代替了正矩形框。是基于YOLOv3改的,增加了对框的旋转角的regression head。效果如下:代码和数据:http://vip.bu.edu/projects/vsns/cossy/fisheye/rapid/但当时在私有数据集上训练时,遇到两个问题:(1)推理时,即使静止的目标,他的检测框的旋转角抖动依然很大 (2)与正的矩形框相比,旋转框的标定更耗时。后来,我就直接用正矩形框对头肩进行标注和训练了,效果也不错。Q:那对鱼眼图像进行棋盘矫正后,再目标检测,效果如何啊?A:如果采用棋盘矫正,会把地面上的人体进行拉伸,且越到周围拉伸越严重,所以不推荐用棋盘矫正做目标检测,我找下图。Q:明白了,那我想在鱼眼相机中直接做目标检测,有什么好的训练trick吗?① 不要选择“人体”这种长条形物体作为标定目标。因为长条形物体旋转后,再用正的矩形框标定时,相邻框之间很容易产生大的overlap,并且框内有冗余信息。所以选择人头(偏圆形)或者头肩(偏正方形)。② 标定时,太远的目标可以不标,或者mask掉。目的是减少误检。④ 数据增强时,可以添加360度任意角旋转。在数据量不大时,可以有效缓解过拟合。⑤ 鱼眼相机本身都是2K以上的分辨率,所以模型训练推理都可以适当调大输入的尺寸。比如640甚至960.Q:看完分享,感觉对于每张鱼眼图像都需要矫正或变形,这样操作的话,对于图像处理会不会开销很大?A:刚才代码中也看到了,推理时就一个remap操作,我测试过用python的cv2.remap处理2K大小鱼眼图,速度在300FPS,如果有专门的工程人员在CUDA上实现的话,1000FPS都没问题吧。A:海康大华宇视都有,像我用的就是500多块的海康相机,1.16mm的焦距。Q:针对之前的分享,有一个问题,代码实现的时候,opencv必须要用特定的版本吗?因为已经装了其他版本的opencv了,是否也适用呢?A:版本不同,cv2的内置函数的输入输出的dtype或者格式可能会不同。所以最好跟我代码中的统一,否则报错了你得一步步去debug。我现在主要用3.4.2和4.5.2。Q:常规做法是鱼眼相机展开再做检测和track来进行人流量统计吧?A:看检测器吧。如果顶视角的检测器效果不理想,那可以先展开,再用正视角的检测器去做,毕竟正视角的数据集更多Q:球形的这种画面下的目标追踪跟枪机下的是不是也不太一样,原来的deepsort追踪算法能直接用吗?还是有别的trick在里面?A:会有些不同。比如枪机下的SORT会把框的x,y,w,h都做Kalman滤波。鱼眼下,我会去掉w,h,而考虑半径rReID 的feature已经不明显了,而且用鱼眼的优势就是减少遮挡,所以不会用“Deep”。Q:还有一个疑问,我看你用的鱼眼相机的焦虑是1.16mm,不是说焦虑越小观测的目标会越近么?车载前视的大概6mm焦虑,能看15米左右吧,鱼眼是想看更大范围的,为啥选这么小的焦虑呢,还是说鱼眼相机的特性就是和平常的相机不一样?比如单反相机大炮筒长焦200以上的,所谓拍鸟利器,视野窄拍的远。Q:主机厂在车上前装的环视相机也是鱼眼相机,那么在进行目标检测任务时,应该以原始畸变图直接作为训练集还是应该先去畸变再训练?A:① 肯定不推荐用棋盘标定法去畸变再目标检测,因为这种矫正方式会把 “和相机平面不平行”的物体进行拉伸,比如下图中的人体。而且这种拉伸程度越到周围越厉害,造成了扭曲,反而不利于检测。② 如果你的原有检测器只是针对传统正视视角图片(比如COCO)训练的,那么在鱼眼图这种俯视视角一般不会work。所以有个办法就是用横向展开法,展开后用常规视角的检测器去做。③ 当然,如果你已经积累了大量鱼眼视角下的标签数据,那么直接去做目标检测也是OK的。我在前面也分享了几个trick,可以参考,就是针对不做畸变矫正直接检测的case。A:可以一起用,我实验过,出来的效果会跟棋盘矫正相似,就是圆周的区域会被拉伸的很扭曲。中间区域没有棋盘矫正好,所以我没采用。

Q:这个数据增强贴图放到鱼眼图中是要做反向计算吗?比如之前已经计算一个remap matrix。A:可以的。我也有代码实现,之后让大白整理后,一起放出来。

本文仅做学术分享,如有侵权,请联系删文。

点赞

评论

收藏

分享

手机扫一扫分享

举报

点赞

评论

收藏

分享

手机扫一扫分享

举报