OpenAI新研究:扩散模型在图像合成质量上击败BigGAN,多样性还更佳

来源:AI科技评论 本文约3600字,建议阅读5分钟 本文介绍了OpenAI新研究:扩散模型在图像合成的最新技术。

1 扩散模型在图像合成上击败了BigGAN

论文地址:https://arxiv.org/abs/2105.05233

代码地址:https://github.com/openai/guided-diffusion

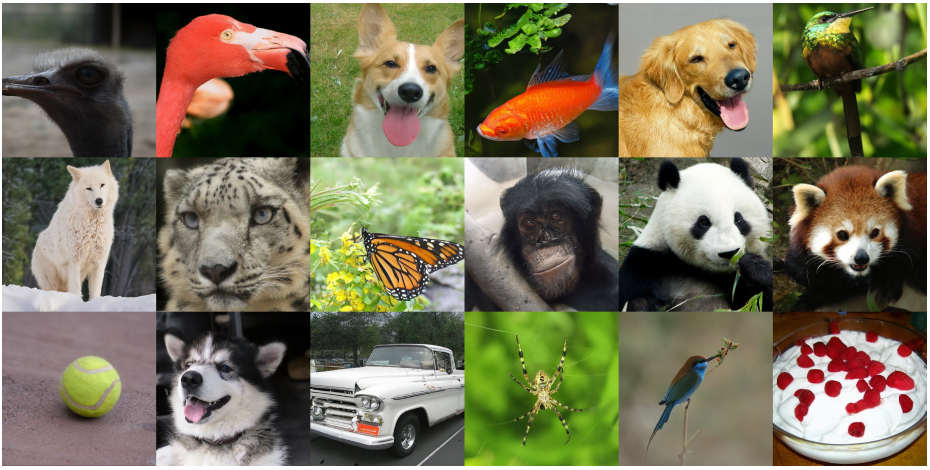

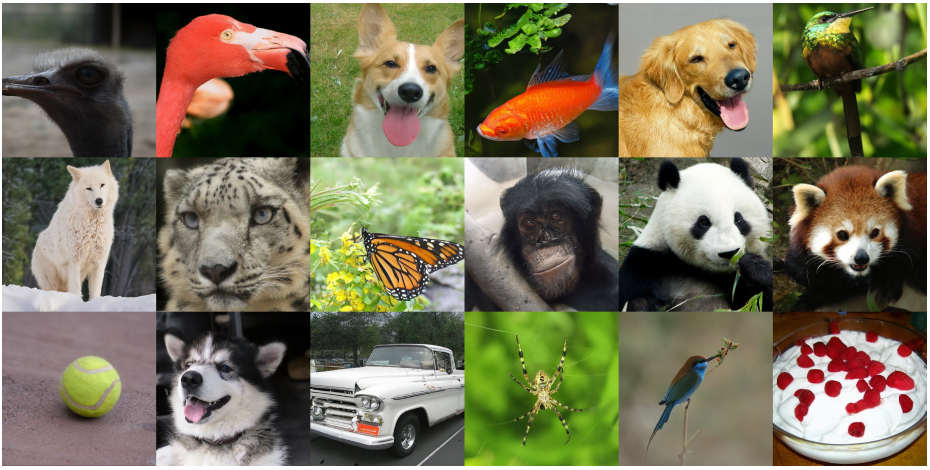

2 扩散模型图像生成

3 扩散模型改造

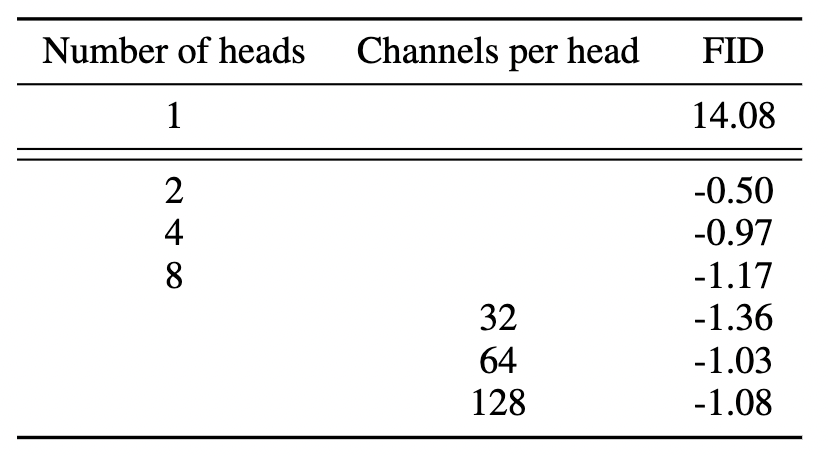

增加深度与宽度,保持模型尺寸相对恒定。 增加注意力头的数量。 使用32×32,16×16和8×8分辨率的注意力,而不仅仅是16×16。 使用BigGAN残差块对激活值进行上采样和下采样。 参考“Score-based generative modeling through stochastic differential equations”等论文,以1/√2因子重新缩放残差连接数。

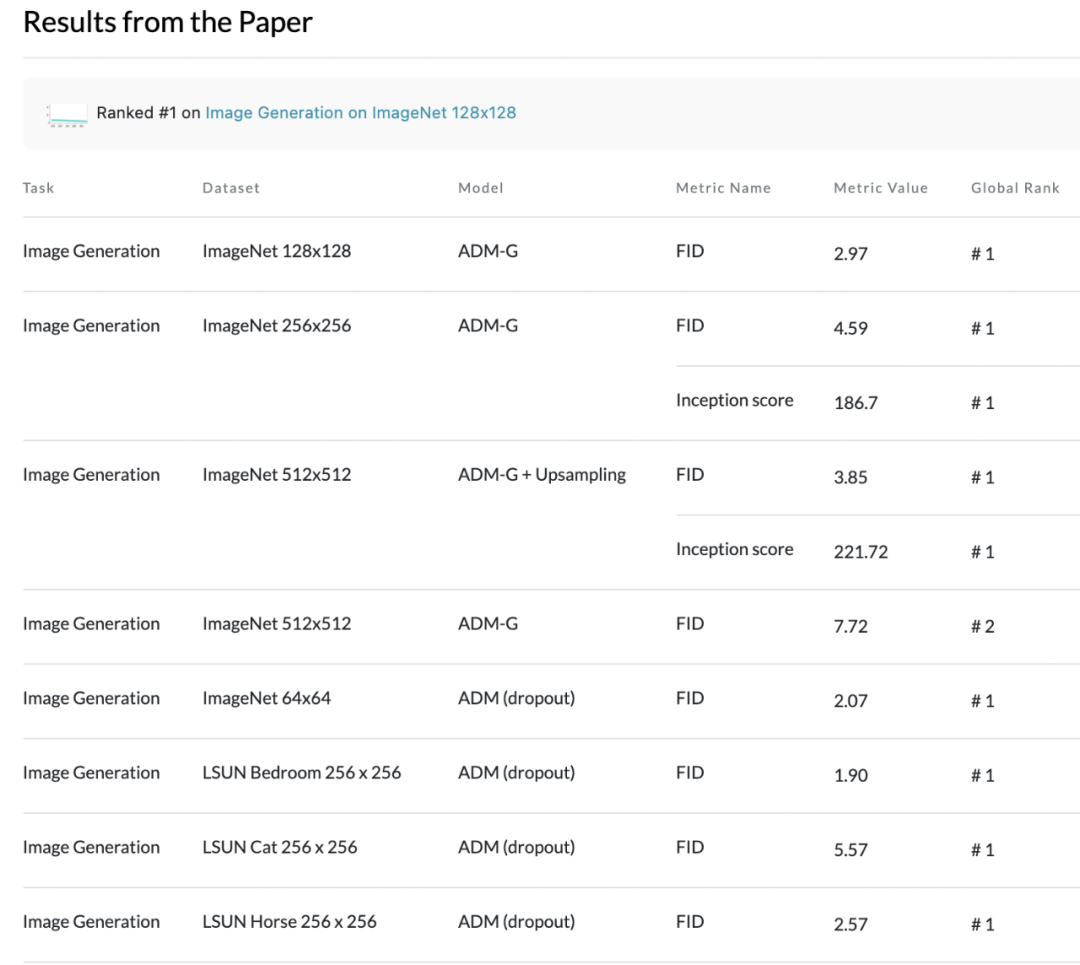

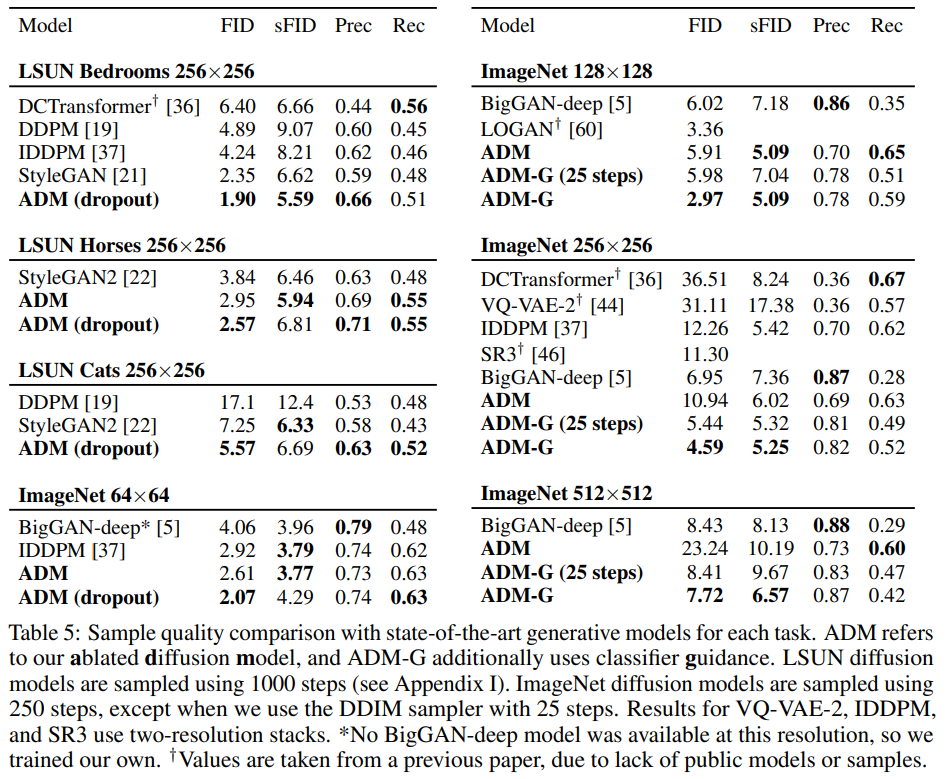

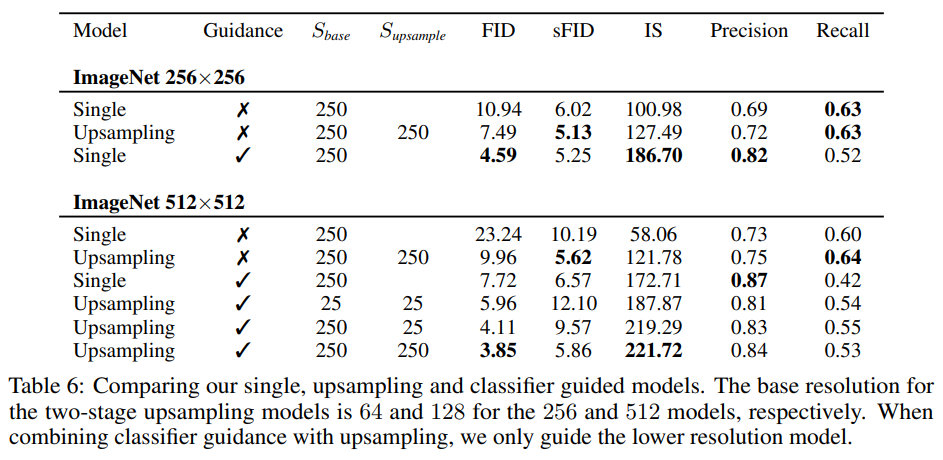

4 实验结果

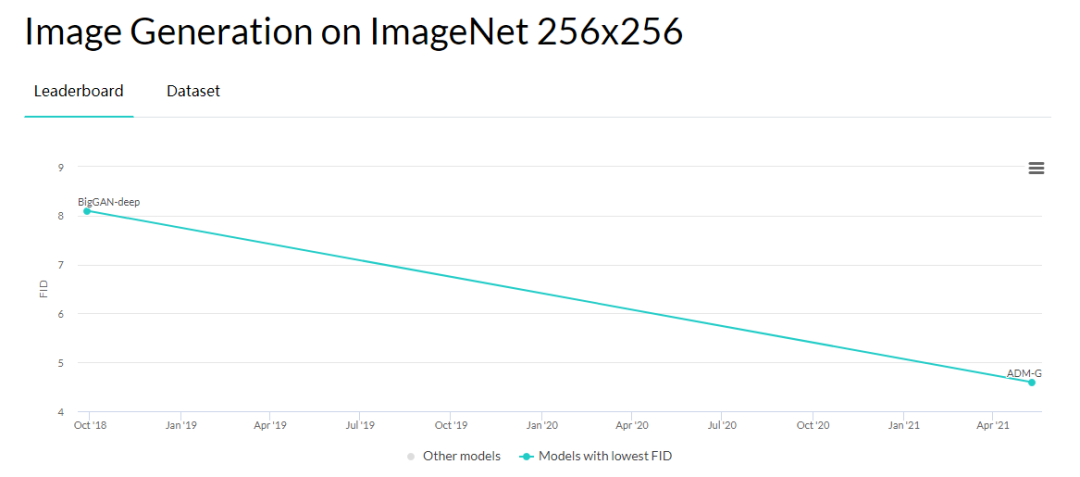

5 扩散模型的发展

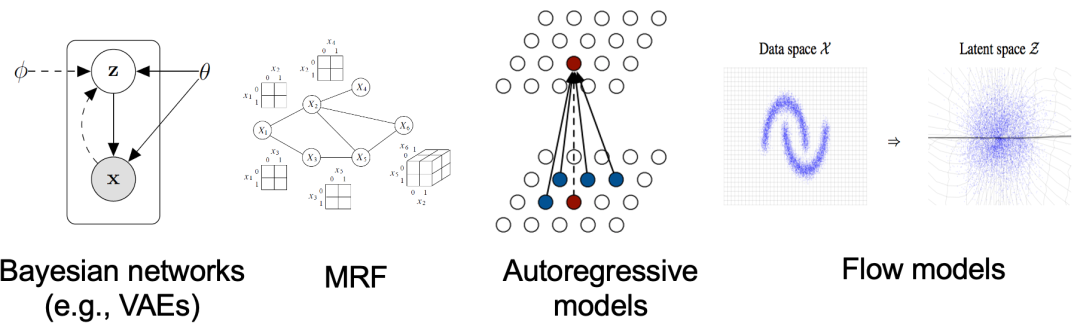

第一种是基于似然的模型,它通过近似的最大似然直接学习分布的概率密度(或质量)函数。典型的基于似然的模型包括自回归模型、归一化流模型、基于能量的模型(EBMs)和变分自编码器(VAEs)。

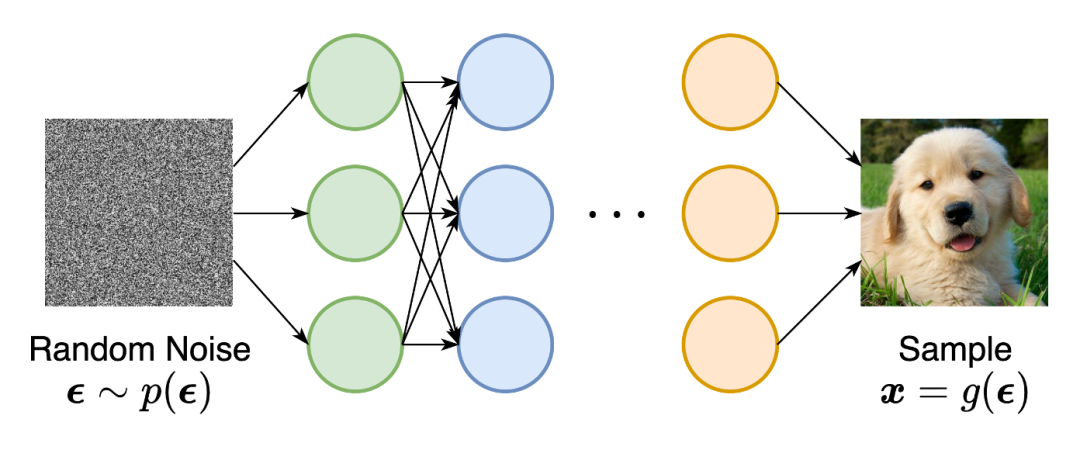

第二种是隐式生成模型,其中概率分布是通过采样过程的模型来隐式表示的。最突出的例子是生成对抗性网络(GANs) ,它通过将随机高斯矢量与神经网络相转换来合成新的数据分布样本。

贝叶斯网络、马尔可夫随机场(MRF)、自回归模型和归一化流模型都是基于似然的模型的例子。所有这些模型都表示一个分布的概率密度或质量函数

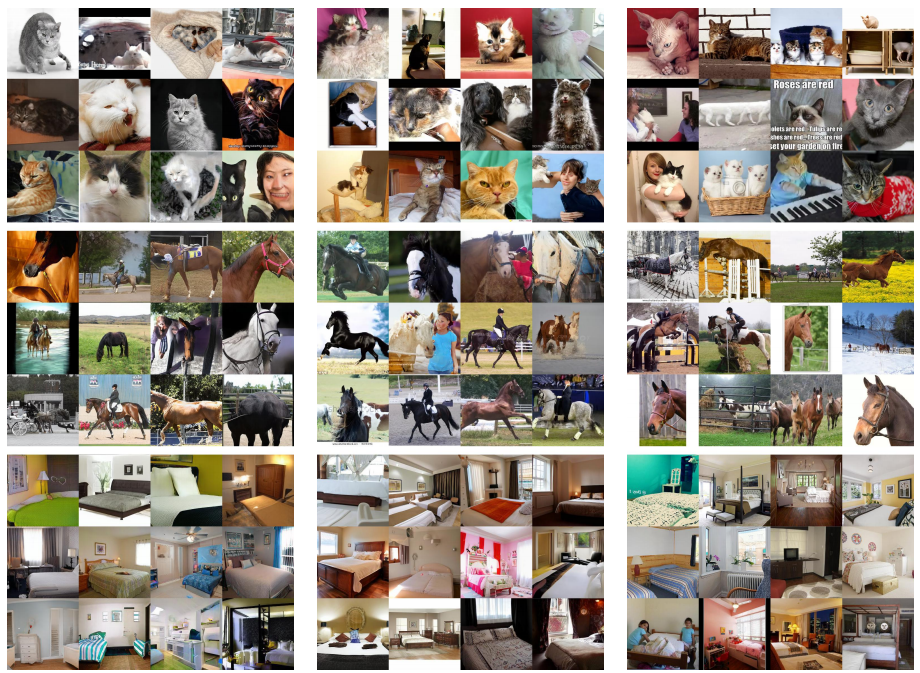

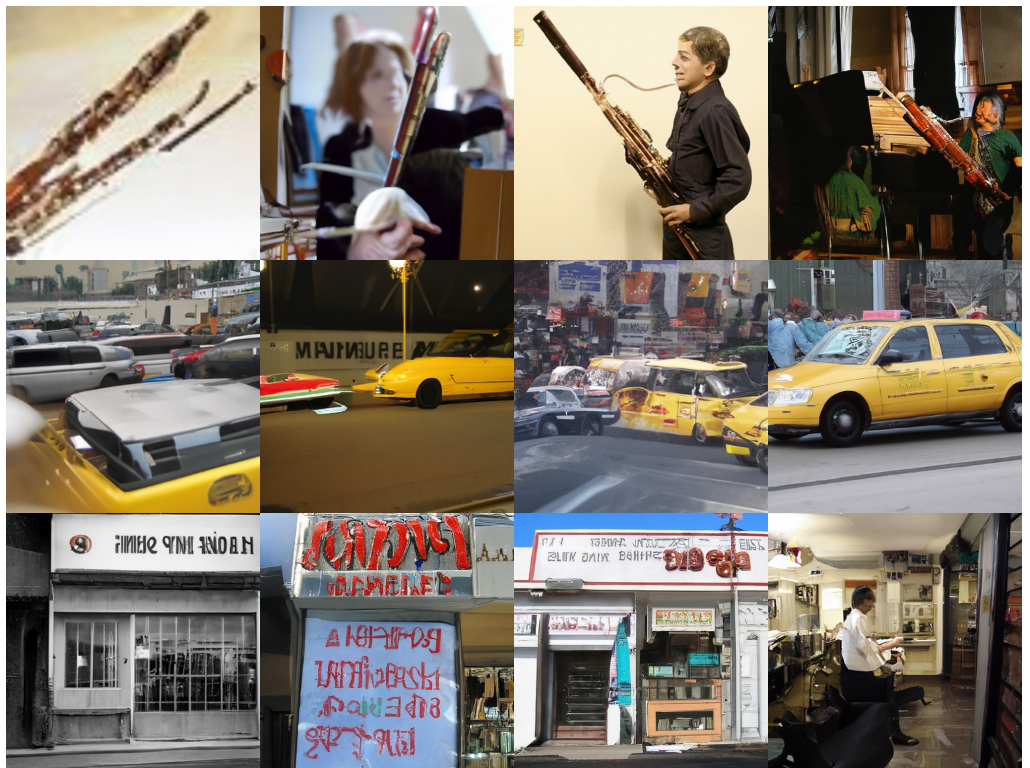

6 ADM的更多图像生成结果

参考链接:

https://twitter.com/arankomatsuzaki/status/1392280377784369152

http://yang-song.github.io/blzog/2021/score/

https://mp.weixin.qq.com/s/dQ9UAaD7cu7a05XXKkBsdw

https://paperswithcode.com/paper/diffusion-models-beat-gans-on-image-synthesis

https://openreview.net/pdf?id=B1xsqj09Fm

编辑:王菁

校对:林亦霖

评论