【学术前沿】基于上下文的信息生成,用于管理使用图像字幕的无人机获取的数据

声明:本文只是针对个人学习记录,侵权可删。本人自觉遵守《中华人民共和国著作权法》和《伯尔尼公约》等法律,其他个人或组织等转载请保留此声明,并自负法律责任。论文版权与著作权等全归原作者所有。

文章摘要

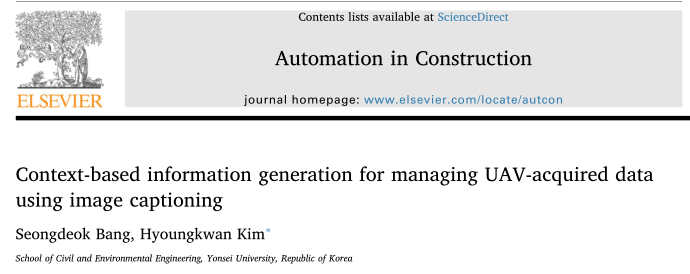

无人机(uav)可以有效地收集代表建筑工地各种情况的图像数据,但人工分析获取现场管理的有用信息需要大量的时间和成本。本文提出了一种从无人机获取的数据中生成基于时间、空间和视觉上下文的信息的方法。该方法使用图像字幕从站点图像中生成关于位置、状态、运动、颜色和建设资源数量的文本信息。然后,建筑工地的图像、生成的文本,以及无人机飞行数据,包括纬度、经度、日期和一天中的时间,都被整理到一个数据库中。为评估所提出的方法,使用了无人机在实际施工现场获得的数据。该方法预测文本信息的平均精度为43.52%,优于现有方法。

文章导读

数据收集和存储技术的发展使我们能够收集大量的数据,并通过计算机系统来管理它们。在这种情况下,建筑项目在规划、设计、施工、运营等生命周期内产生的数据,传统上是以文档、图像、网页和BIM

(Building Information

Modeling,简称BIM)的形式存储的。随着传感器网络和物联网(IoT)等技术的商业化,建筑行业可用的数据量预计将进一步增加。在建筑行业积累的“大数据”的基础上,人们做了很多尝试,提取有用的知识来支持建设项目管理。为了开发一个有效的项目管理系统,在从可用数据中提取信息时,有必要考虑周围的环境、时间和空间背景。

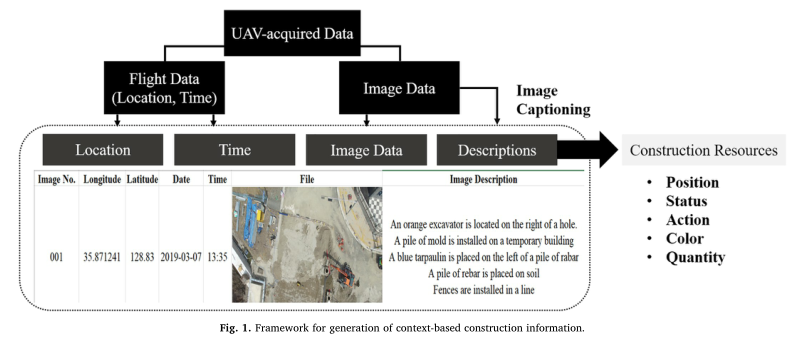

无人机(uav)的引入使图像数据采集能够在广泛的建筑工地代表各种情况。无人机具有良好的机动性,可以在短时间内生成大量的建筑工地图像。无人机获取的施工现场图像为管理者提供了视觉信息,如施工资源的存在和施工工作的进展情况。通过这些图像,管理者可以识别施工资源并了解现场的施工过程。然而,人工分析大量的建筑站点图像需要花费大量的时间和精力。当建筑场地较大,数据记录周期较长时,这项工作就变得更加困难。计算机视觉技术的发展使得从图像中自动获取有用信息成为可能。特别是图像字幕,一种基于计算机视觉的技术,在这一领域正获得越来越多的关注。该技术了解对象的特征、活动和关系,并以自然语言表达它们。图像字幕的使用可以使管理员在很短的时间内搜索到他们想要查看的图像,从而有效地管理每天获取的大量建筑网站图像。

此前,图像字幕的研究主要针对日常图像的数据集,如PASCAL句子数据集、Flickr

30K、Microsoft COCO数据集、Visual

Genome。然而,站点管理人员需要的管理信息比这些技术所能提供的更多。这些信息包括基于对象的上下文解释和图像的情境感知所创建的知识,如材料的数量、特定结构的安装状态、工人或施工设备的移动。在图像字幕技术的基础上,需要研究如何从建筑工地图像中提取这些信息。然而,由于图像字幕只是从图像中提取信息,其他难以从图像中获取的信息需要单独获取。在建筑工地,由于某些过程中某些任务的重复,即使在不同的时间和位置拍摄了相似的图像,也可能会获得这些图像。因此,时间和位置信息应该伴随拍摄的图像。从图像中提取的文本信息,如关键建设资源的位置、颜色、状态、运动和数量等,可以与时间和空间数据结合生成新的信息。例如,通过与计划数据的比较,该信息可以用作项目股东之间的诉讼证据或施工过程的进度管理。它还可以帮助制作每日日志,定期记录建筑工地的竣工数据。

主要图表

生成基于上下文的构造信息的框架

密集字幕模型的简要模式

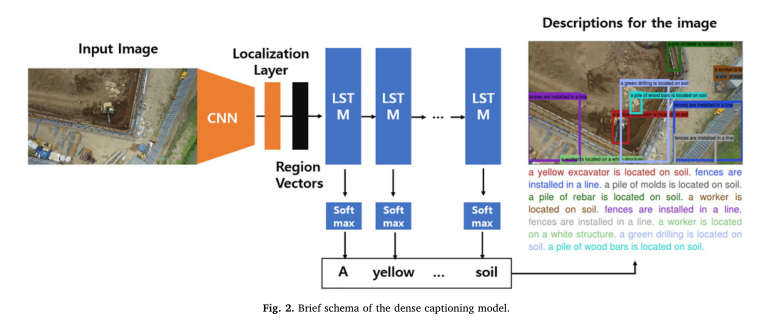

使用带有图像区域和字幕的VGG图像注释器手工标记的例子

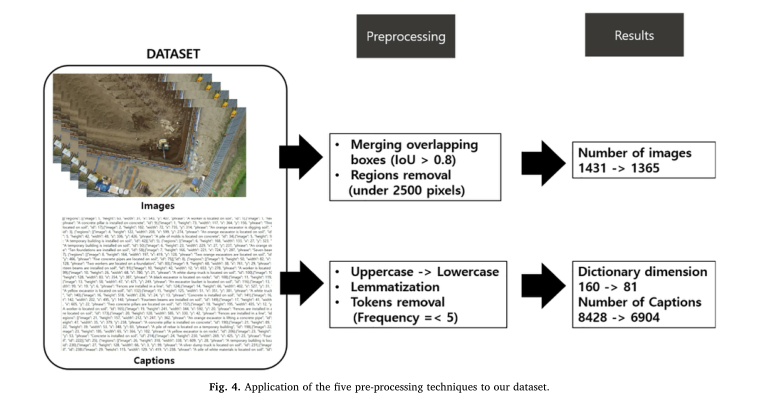

五种预处理技术在我们数据集上的应用

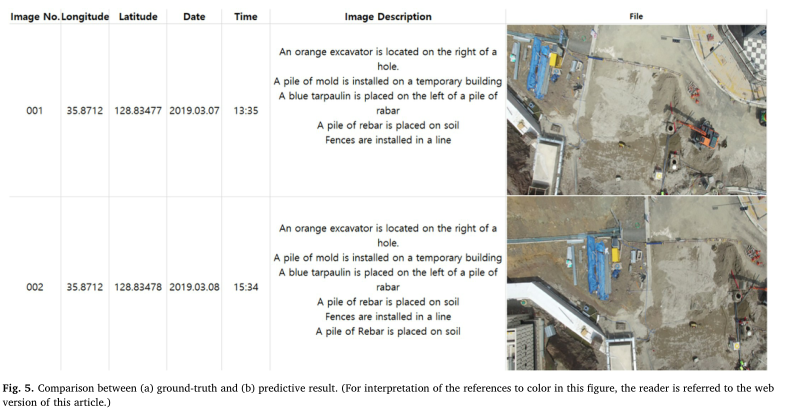

(a)地面真值与(b)预测结果的比较

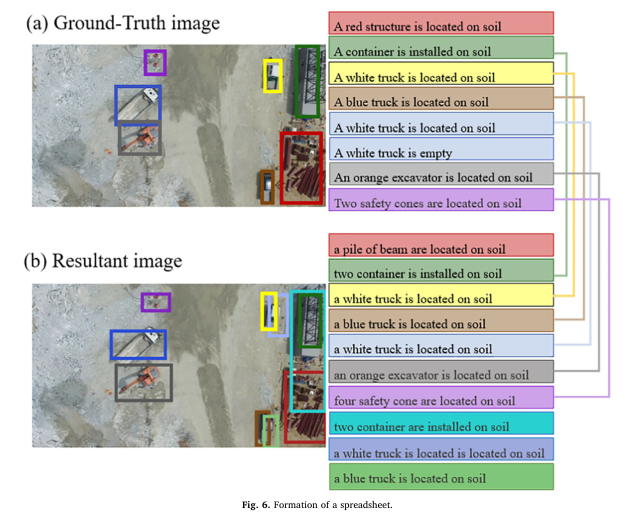

编制电子表格

(a)训练图像和(b)测试图像的例子

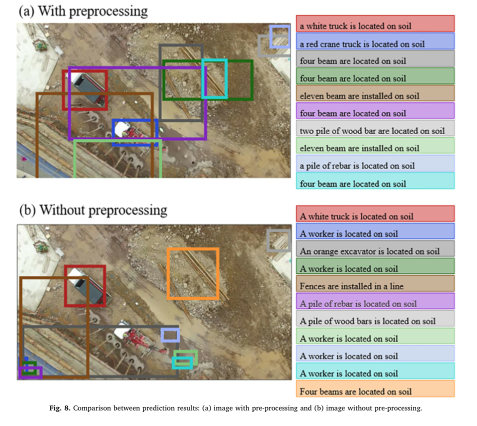

预测结果对比:(a)经过预处理的图像和(b)未经预处理的图像

主要结论

本研究提出了一种从无人机获取的数据中生成基于上下文的信息的方法。该方法从无人机获取的建筑站点图像中提供关于建筑资源的位置、状态、运动、颜色和数量的信息。基于深度学习的密集字幕基于目标检测从图像区域创建文本描述。然后,该方法以电子表格的形式构建一个数据库,该数据库包含建筑站点图像、无人机飞行数据的时间和位置,以及文本描述技术生成的文本信息。为了验证所提出的方法,使用了一个由无人机在六个不同的建筑工地捕获的1431张图像和描述图像区域的8601个字幕组成的数据集。在五种预处理技术处理的1365幅图像中,用1000幅图像训练密集字幕模型,其余365幅图像对模型进行测试。密集字幕模型从描述建筑工地的测试图像中预测句子的准确率为43.52%,优于现有密集字幕研究。利用预测的句子从无人机获取的建筑站点图像中提取基于上下文的信息,以及时间和位置信息,建立数据库。实验结果表明,该方法能够有效地从无人机获取的数据中生成基于上下文的信息。

本研究对建筑业的贡献是双重的。首先,我们的研究提出了一种基于图像标题的方法来从无人机获取的建筑站点图像中生成时间-空间和基于视觉上下文的信息。为有效管理无人机获取的海量施工现场数据,本文提出的方法将施工现场图像、基于文本的图像描述、施工现场位置和时间等属性的数据库系统化,为施工现场管理者提供管理信息。利用所生成的基于上下文的信息,管理人员可以识别特定施工资源的数量和确切位置,以及使用所提议方法生成的数据库在给定时间内特定施工部分临时结构的安装状态。此外,根据基于上下文的信息,如果某一特定部分的施工进度晚于计划的进度,管理者可能会做出决策,例如增加对该部分的资源投入或改变施工过程的顺序。我们的实验结果表明了基于深度学习的图像字幕在建筑行业中的可行性。其次,创建了一个包含建筑网站图片和说明文字的数据集。建筑行业现有的图像数据集包括建筑资源的识别和位置信息,用于分类、检测和分割。相比之下,我们的数据集包含五种类型的建筑资源文本信息,以及它们的识别和位置信息。该数据集可以继续用作从建筑站点图像生成文本信息的基准。

本研究旨在开发一种有效管理无人机获取的海量施工现场数据的方法。本研究的结果有望通过生成基于上下文的建筑信息来提高无人机获取数据的可用性,并进一步促进建筑的自动化。然而,未来的研究需要将这种方法应用到实际的建筑工地。使用静态图像创建运动信息的困难和相对于建筑资源识别的低性能将提示未来研究努力的方向