Flink SQL 1.11 on Zeppelin集成指南

点击上方蓝色字体,选择“设为星标”

回复”资源“获取更多惊喜

前言

Flink SQL on Zeppelin!

配置Zeppelin

目前Zeppelin的最新版本是0.9.0-preview2,可以在官网下载包含所有Interpreters的zeppelin-0.9.0-preview2-bin-all.tgz,并解压到服务器的合适位置。接下来进入conf目录。将环境配置文件zeppelin-env.sh.template更名为zeppelin-env.sh,并修改:# JDK目录将服务配置文件zeppelin-site.xml.template更名为zeppelin-site.xml,并修改:

export JAVA_HOME=/opt/jdk1.8.0_172

# 方便之后配置Interpreter on YARN模式。注意必须安装Hadoop,且hadoop必须配置在系统环境变量PATH中

export USE_HADOOP=true

# Hadoop配置文件目录

export HADOOP_CONF_DIR=/etc/hadoop/hadoop-conf

最基础的配置就完成了。运行bin/zeppelin-daemon.sh start命令,返回Zeppelin start [ OK ]的提示之后,访问<服务器地址>:18080,出现下面的页面,就表示Zeppelin服务启动成功。

zeppelin.server.addr

0.0.0.0

Server binding address

zeppelin.server.port

18080

Server port.

Zeppelin集成了Shiro实现权限管理。禁止使用匿名用户之后,可以在conf目录下的shiro.ini中配置用户名、密码、角色等,不再赘述。注意每次修改配置都需要运行bin/zeppelin-daemon.sh restart重启Zeppelin服务。

zeppelin.notebook.storage

org.apache.zeppelin.notebook.repo.FileSystemNotebookRepo

Hadoop compatible file system notebook persistence layer implementation, such as local file system, hdfs, azure wasb, s3 and etc.

zeppelin.notebook.dir

/zeppelin/notebook

path or URI for notebook persist

zeppelin.recovery.storage.class

org.apache.zeppelin.interpreter.recovery.FileSystemRecoveryStorage

ReoveryStorage implementation based on hadoop FileSystem

zeppelin.recovery.dir

/zeppelin/recovery

Location where recovery metadata is stored

zeppelin.anonymous.allowed

true

Anonymous user allowed by default

配置Flink Interpreter on YARN

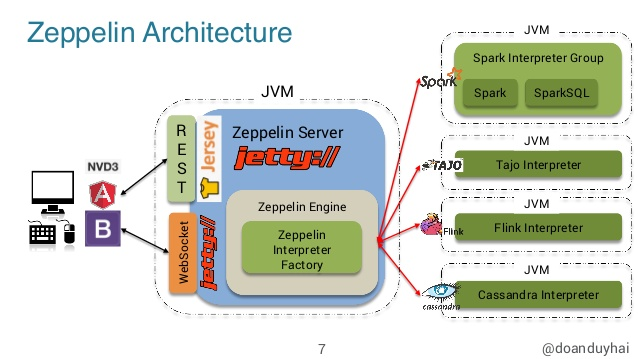

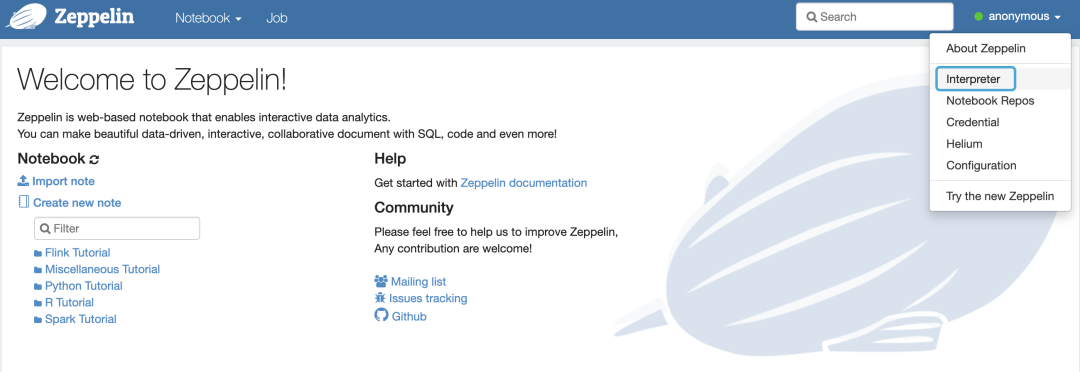

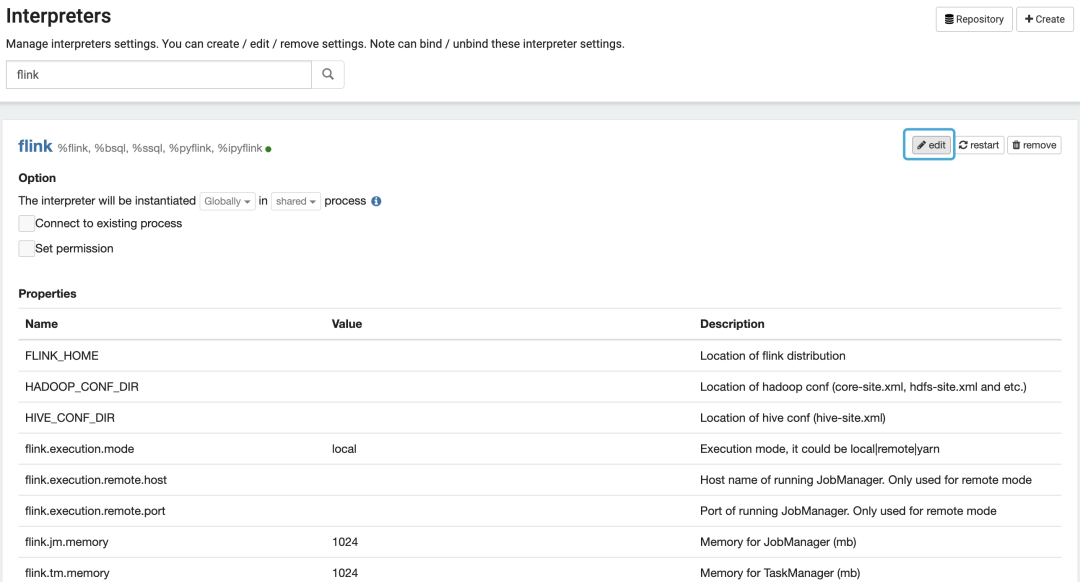

在使用Flink Interpreter之前,我们有必要对它进行配置,使Flink作业和Interpreter本身在YARN环境中运行。点击首页用户名区域菜单中的Interpreter项(上一节图中已经示出),搜索flink,就可以看到参数列表。

Interpreter Binding

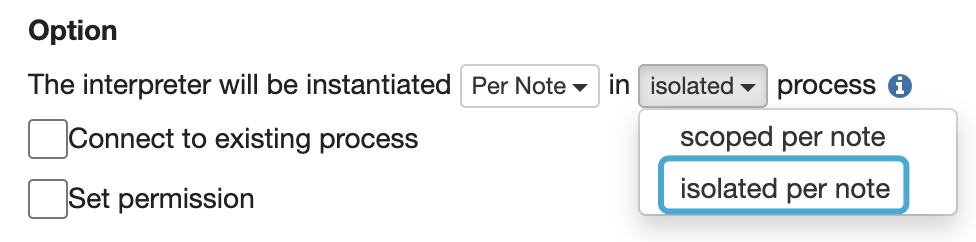

首先,将Interpreter Binding模式修改为Isolated per Note,如下图所示。

Flink on YARN参数

以下是需要修改的部分基础参数。注意这些参数也可以在Note中指定,每个作业自己的配置会覆盖掉这里的默认配置。FLINK_HOME:Flink 1.11所在的目录;

HADOOP_CONF_DIR:Hadoop配置文件所在的目录;

flink.execution.mode:Flink作业的执行模式,指定为yarn以启用Flink on YARN;

flink.jm.memory:JobManager的内存量(MB);

flink.tm.memory:TaskManager的内存量(MB);

flink.tm.slot:TaskManager的Slot数;

flink.yarn.appName:YARN Application的默认名称;

flink.yarn.queue:提交作业的默认YARN队列。

Hive Integration参数

如果我们想访问Hive数据,以及用HiveCatalog管理Flink SQL的元数据,还需要配置与Hive的集成。HIVE_CONF_DIR:Hive配置文件(hive-site.xml)所在的目录;

zeppelin.flink.enableHive:设为true以启用Hive Integration;

zeppelin.flink.hive.version:Hive版本号。

复制与Hive Integration相关的依赖到$FLINK_HOME/lib目录下,包括:

flink-connector-hive_2.11-1.11.0.jar

flink-hadoop-compatibility_2.11-1.11.0.jar

hive-exec-*.*.jar

如果Hive版本是1.x,还需要额外加入hive-metastore-1.*.jar、libfb303-0.9.2.jar和libthrift-0.9.2.jar保证Hive元数据服务(Metastore)启动。注意不能是Embedded模式,即必须以外部数据库(MySQL、Postgres等)作为元数据存储。

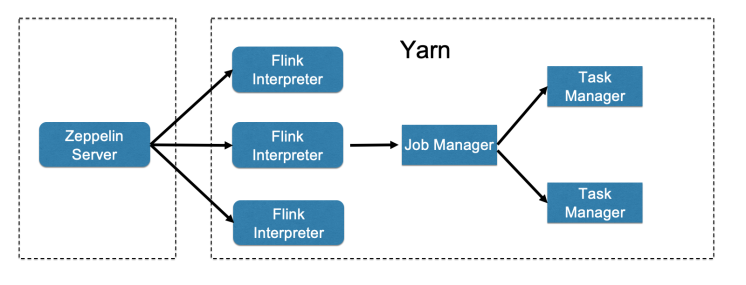

Interpreter on YARN参数

在默认情况下,Interpreter进程是在部署Zeppelin服务的节点上启动的。随着提交的任务越来越多,就会出现单点问题。因此我们需要让Interpreter也在YARN上运行,如下图所示。

zeppelin.interpreter.yarn.resource.cores:Interpreter Container占用的vCore数量

zeppelin.interpreter.yarn.resource.memory:Interpreter Container占用的内存量(MB)

zeppelin.interpreter.yarn.queue:Interpreter所处的YARN队列名称

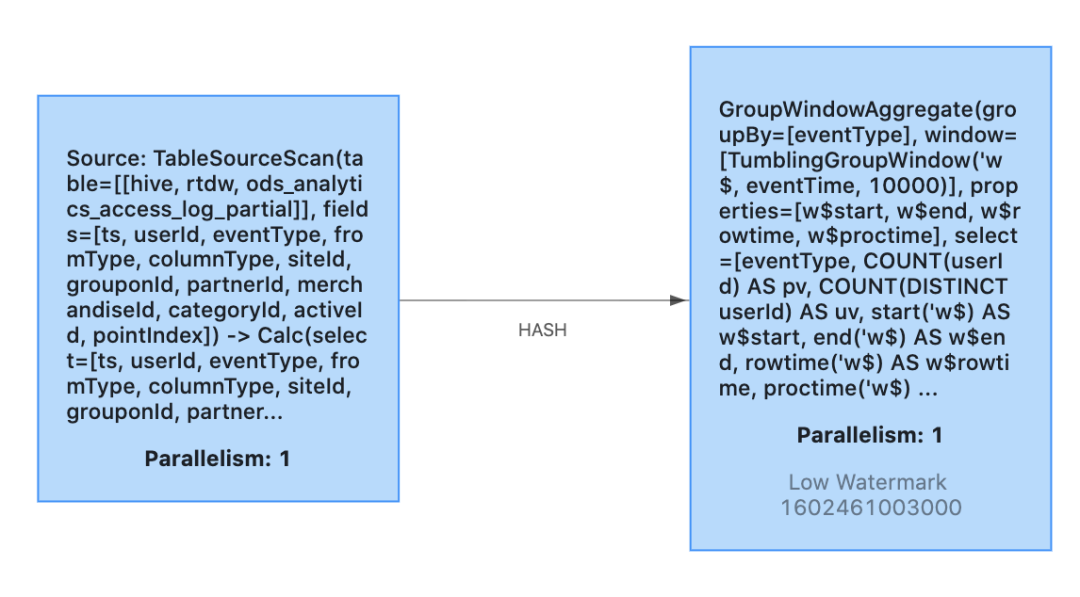

测试Flink SQL on Zeppelin

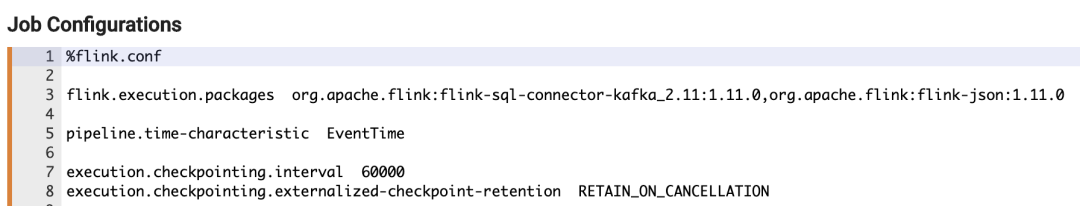

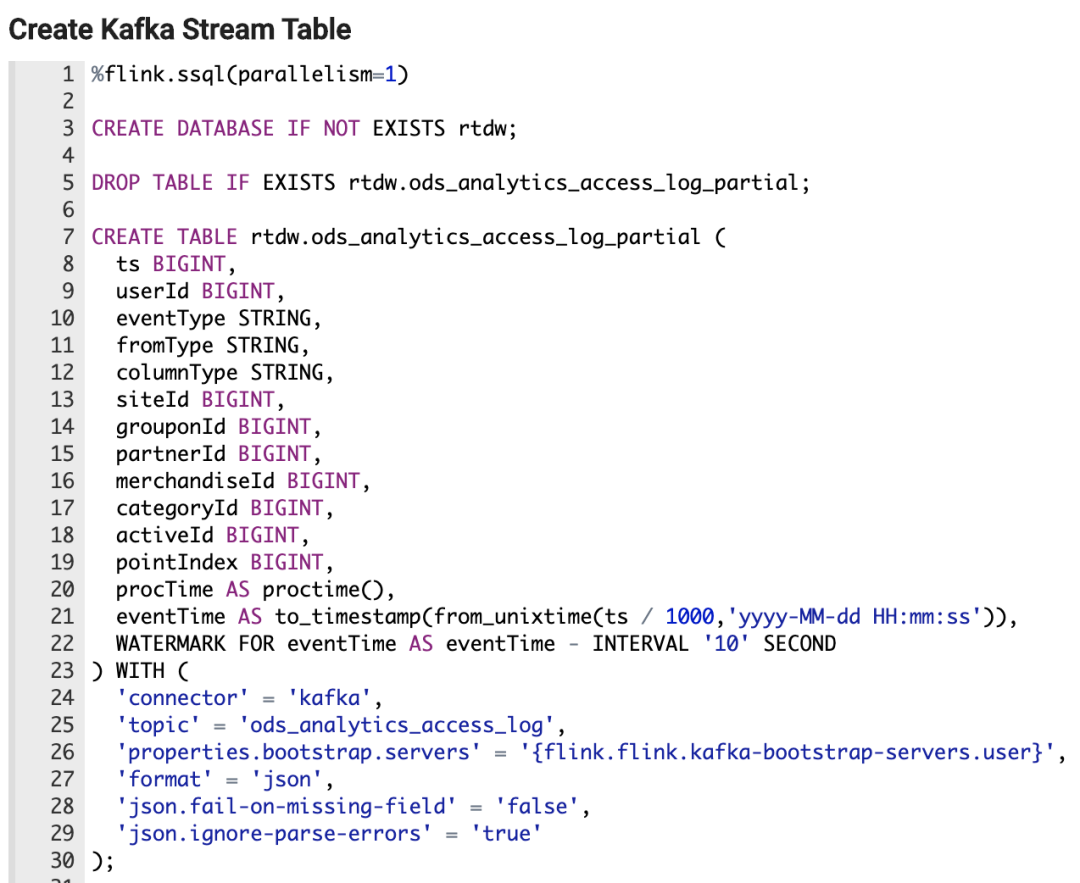

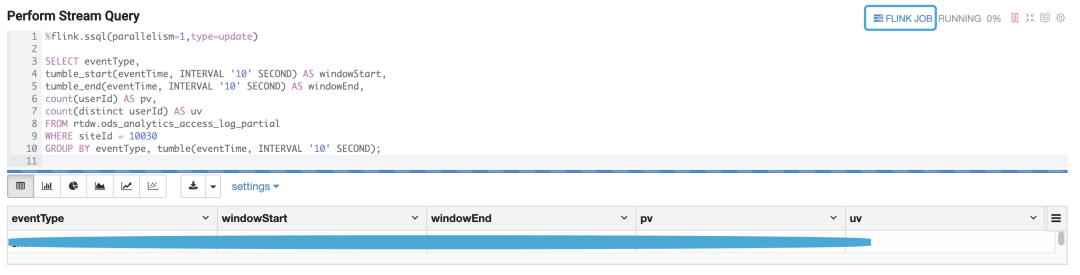

创建一个Note,Interpreter指定为flink。然后写入第一个Paragraph:

版权声明:

本文为《大数据技术与架构》整理,原作者独家授权。未经原作者允许转载追究侵权责任。编辑|冷眼丶微信公众号|大数据技术与架构文章不错?点个【在看】吧! ?