元宇宙火了!终于有人把虚拟现实(AR/VR/MR)讲明白了

导读:最近,元宇宙火了!

“元宇宙”是美国科幻小说家尼奥·斯蒂文森1992年在《雪崩》中提出的概念,书中设定现实世界中的人在网络世界中都有一个分身,这个由分身组成的世界就是“元宇宙”。如今,随着虚拟现实技术的发展,元宇宙逐渐从科幻走入现实。

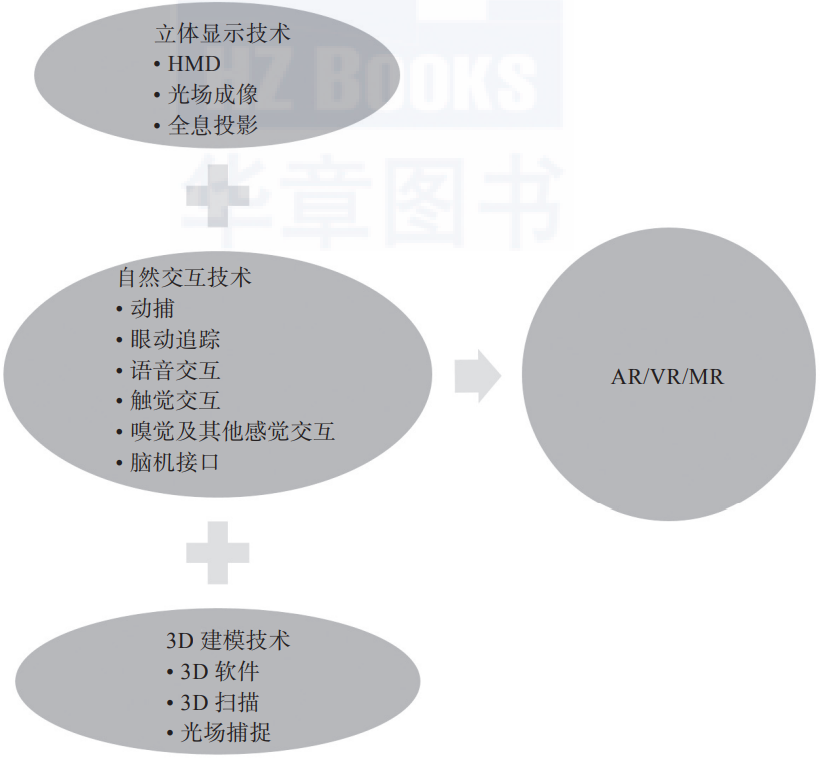

本文将介绍虚拟现实的核心概念、行业应用以及相关的开发技术。

作者:王寒 张义红 王少笛

来源:大数据DT(ID:hzdashuju)

单向脑机接口只允许单向的信息通信,比如只允许计算机接收大脑传来的命令,或者只允许计算机向大脑发送信号(比如重建影像)。 双向脑机接口则允许大脑和外部计算机设备实现双向的信息交换,比如Neurosky(神念科技)的Brainlink。它可以采集大脑产生的生物电信号,并通过esense算法获取使用者的精神状态参数(专注度、放松度)等,实现基于脑电波的人机交互,或是俗称的“意念控制”。

评论