ICCV2021 Challenge | 多视角行人追踪

极市导读

微软云计算认知服务计算机视觉团队构建了一个大规模的多视角多目标追踪数据集和基准(MMP-Tracking)。同时,将在计算机视觉顶会ICCV2021上举办本次MMP-Tracking Challenge,以供研究人员开发和测试新的多视角多目标跟踪算法。 >>加入极市CV技术交流群,走在计算机视觉的最前沿

比赛入口:https://competitions.codalab.org/competitions/33729

比赛官网:https://iccv2021-mmp.github.io

1.概述

多目标追踪是计算机视觉最基本且最重要的研究方向之一。多目标追踪有很多实际应用,例如动作捕捉,安防追踪,人机交互,机器人导航等等。因此,受到学术界和工业界的广泛关注。

对于单视角多目标追踪,目前已经有不少公开数据集和基准,比如MOT,PathTrack,HiEve等。这些数据集和基准极大促进了单视角目标追踪技术的发展。然而,对于多视角多目标追踪,由于收集和标注数据的复杂程度远远高于单视角多目标追踪,目前只有很少数几个公开数据集(WILDTRACK,SALSA,EPFL-RLC),且这些数据集多数时长较短或者并非完全标注。缺乏数据,极大限制了多视角目标追踪算法的发展。

为了支持和推动多视角目标追踪领域的发展,鼓励研究者研发更高效更新颖的目标追踪算法,微软云计算认知服务计算机视觉团队构建了一个大规模的多视角多目标追踪数据集和基准(MMP-Tracking)。同时,将在计算机视觉顶会ICCV2021上举办MMP-Tracking Challenge,以供研究人员开发和测试新的多视角多目标跟踪算法。

具体信息可以参考网站:https://iccv2021-mmp.github.io

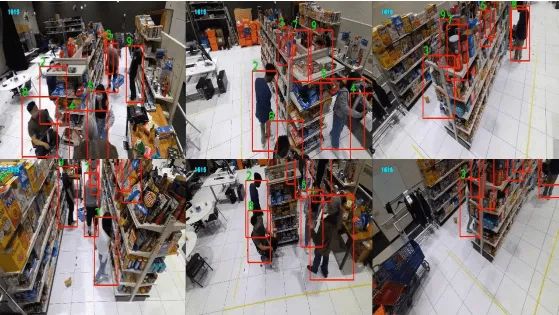

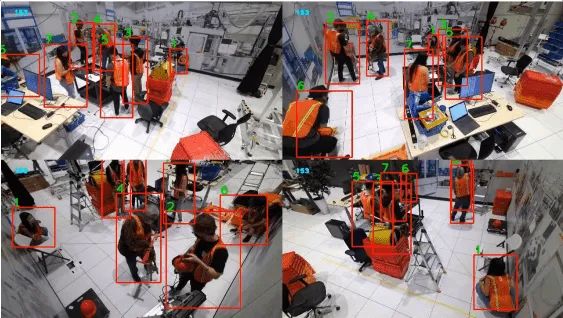

2.数据样本可视化

3.比赛简介

数据集分为训练集(5小时),验证集(1.5小时)和测试集(2.5小时)三个部分。其中,测试集不提供标注,只供研究者生成算法结果并提交到比赛网站参加比赛。数据集收集于五种不同的模拟环境,例如零售店,大堂,工长,办公室,茶水间。我们的数据集标注了每一帧,训练集包含了大约120万帧的图像及其标注。

关于数据的格式请参考我们的网站中有关数据格式的介绍:https://iccv2021-mmp.github.io/subpage/dataset.html

比赛会从两个不同的方面评判结果,因此分为两个不同的排行榜:

3.1摄像头视角评测

参赛者提交对应于每个摄像头视角的目标跟踪bounding box坐标,对应的tracking id以及confidence score,综合所有视角的表现,根据MOTA和IDF1进行最终排名。

3.2俯视图视角评测

参赛者需要根据提供的calibration数据,计算出每个目标在3维空间俯视图上的坐标并提交,最终根据在俯视图上的MOTA和IDF1进行排名。

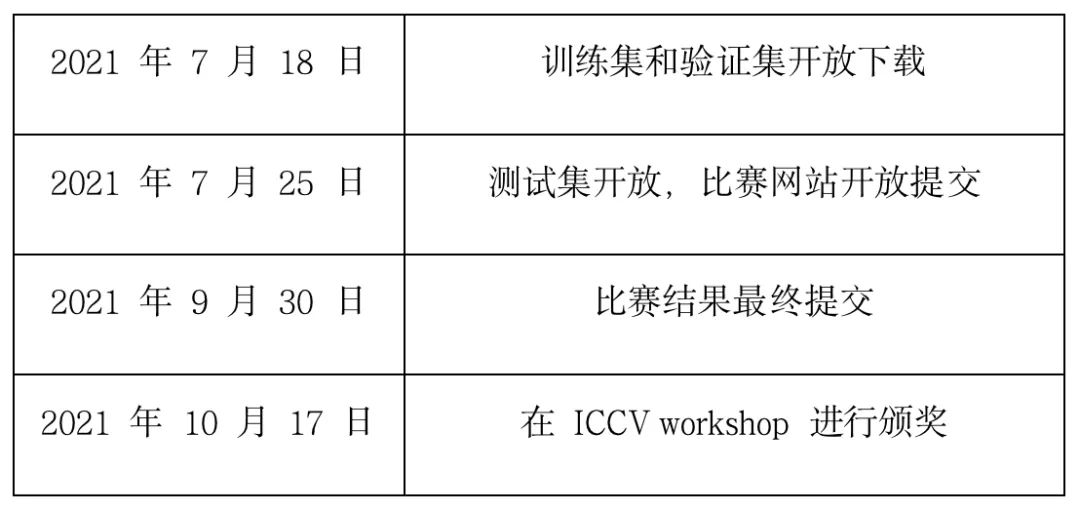

3.3重要日期

4.比赛参赛和数据集申请

所有参赛者需要在CodaLab注册账户:https://competitions.codalab.org

我们的比赛入口是:https://competitions.codalab.org/competitions/33729

所有参赛队伍需要签署我们的数据使用协议数据集:https://iccv2021-mmp.github.io/attachments/MMPTracking%20User%20Agreement.docx

请下载并且将签署好的申请发送电子邮件到iccv2021mmp@outlook.com. 我们将会给您发送下载链接。

欢迎感兴趣的研发团队踊跃参赛!

比赛组织者

比赛顾问委员会

如果觉得有用,就请分享到朋友圈吧!

公众号后台回复“CVPR21检测”获取CVPR2021目标检测论文下载~

# CV技术社群邀请函 #

备注:姓名-学校/公司-研究方向-城市(如:小极-北大-目标检测-深圳)

即可申请加入极市目标检测/图像分割/工业检测/人脸/医学影像/3D/SLAM/自动驾驶/超分辨率/姿态估计/ReID/GAN/图像增强/OCR/视频理解等技术交流群

每月大咖直播分享、真实项目需求对接、求职内推、算法竞赛、干货资讯汇总、与 10000+来自港科大、北大、清华、中科院、CMU、腾讯、百度等名校名企视觉开发者互动交流~