引导式超高分辨率

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

低分辨率深度图+高分辨率RGB图像=高分辨率深度图

01.什么是引导式超高分辨率

02.为什么要使用引导式超高分辨率

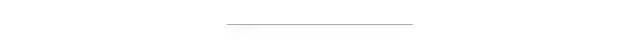

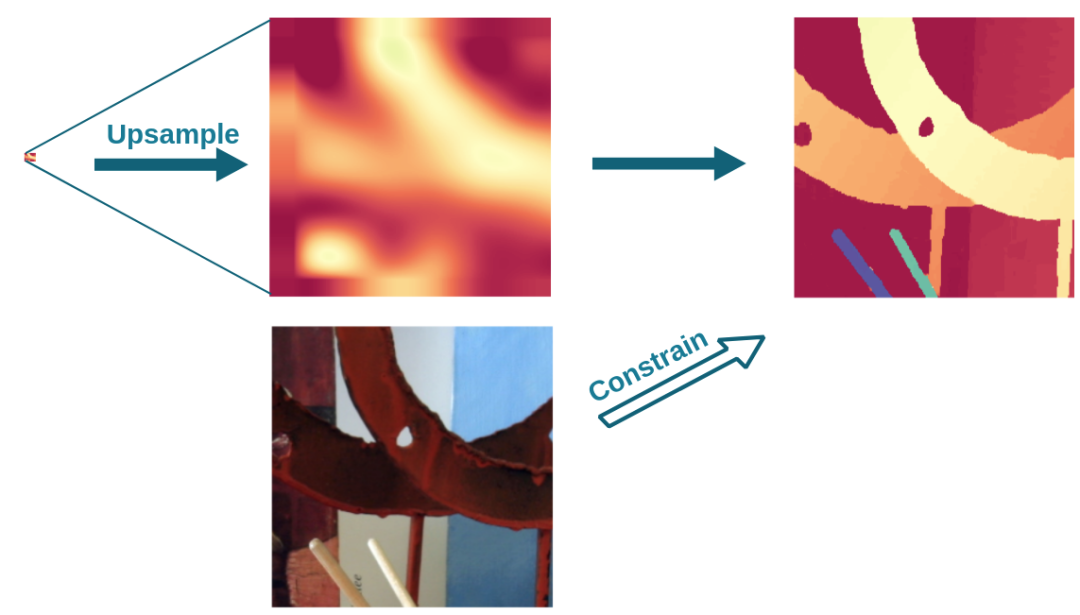

引导式超分辨率示意图

03.方法运用

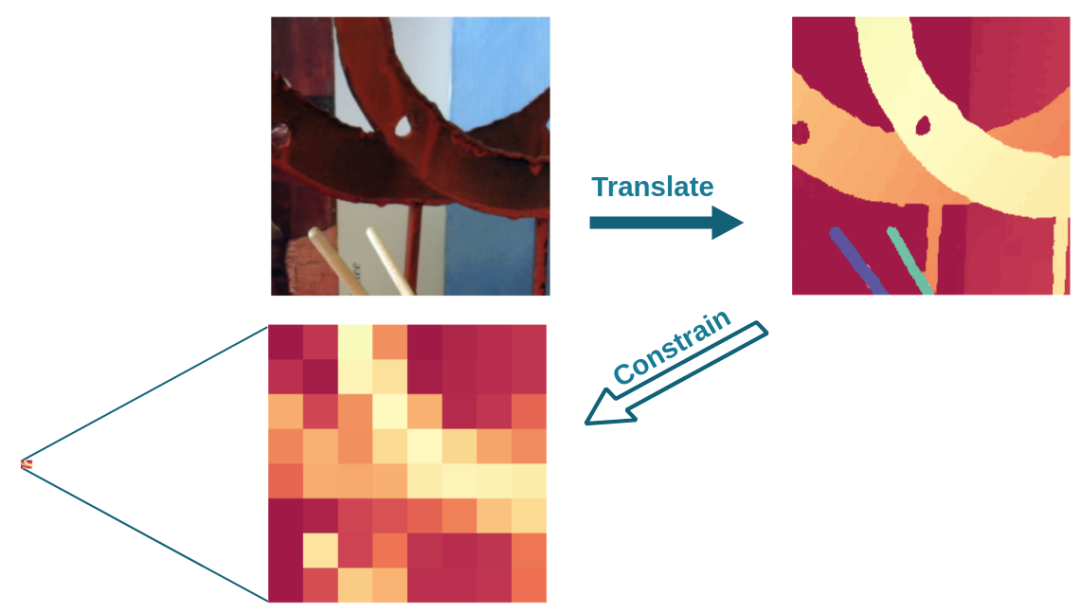

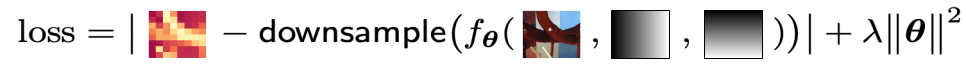

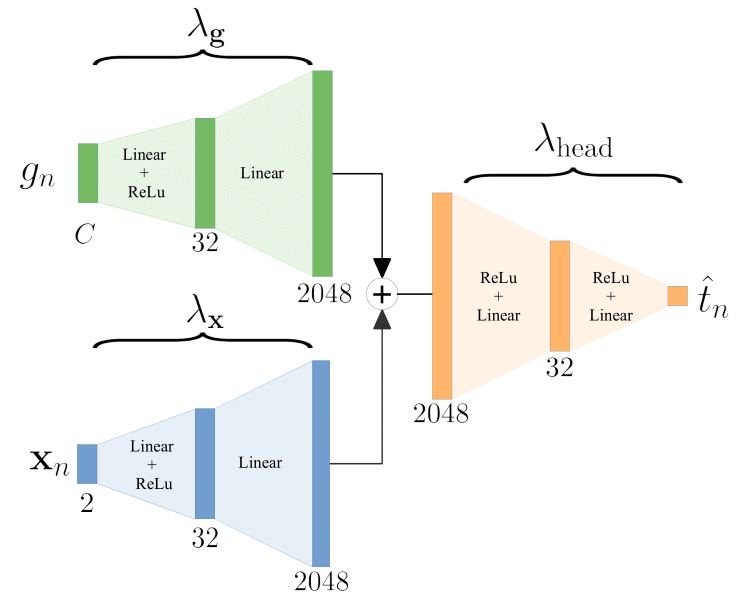

逐像素映射意味着从要存在一一映射,而且一种颜色只会对应一个深度值,这当然不是我们想要的。因此我们需要将输入图像添加到映射函数中,其中x、y为图像中的像素坐标。通过这个操作,我们让映射函数与位置相关,引导图像中不同位置的相同颜色会映射到不同的输出值上。

g是引导图像的像素值,x是像素的空间坐标,t是输出

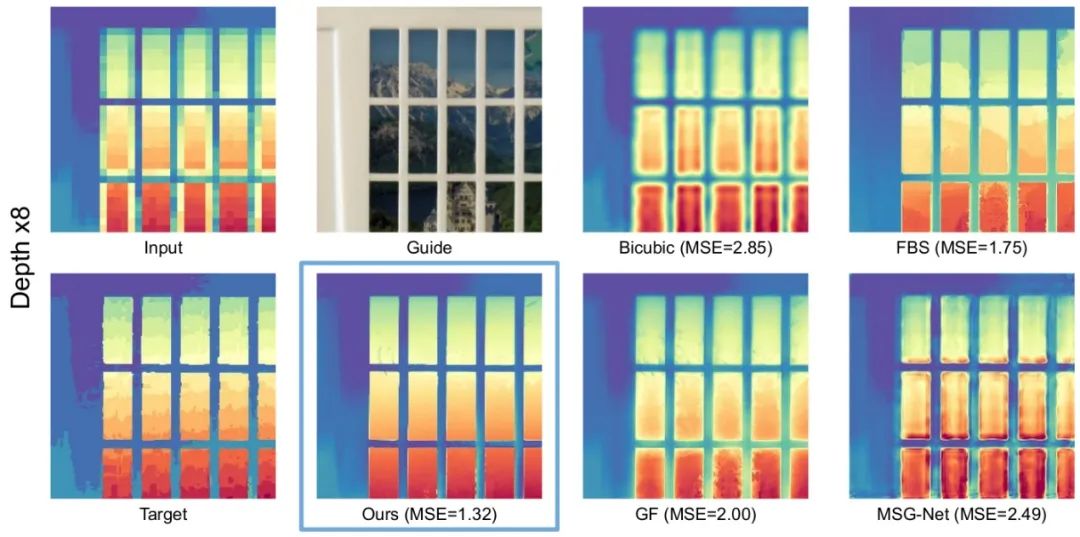

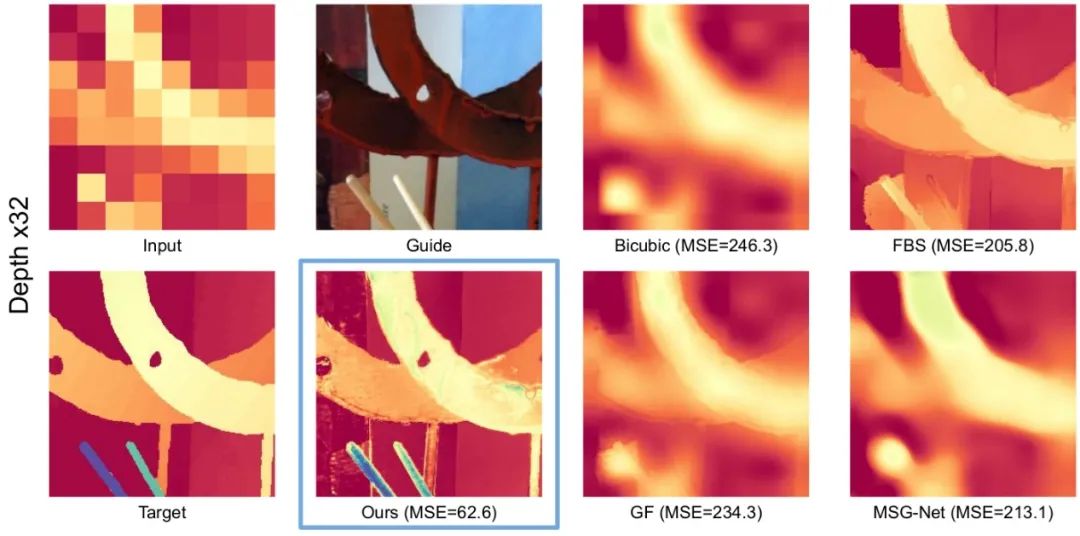

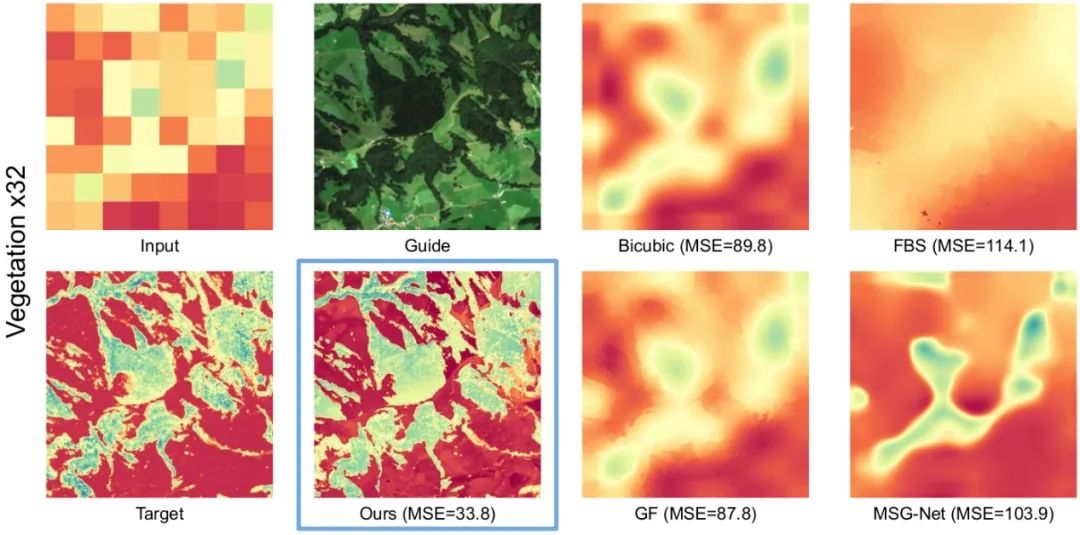

01.实验结果

要了解有该方法的详细内容,可以阅读以下文章:

R. de Lutio, S. D’Aronco, J. D. Wegner, K. Schindler: “Guided Super-Resolution as Pixel-to-Pixel Transformation”, ICCV, 2019.

代码链接:

https://github.com/riccardodelutio/PixTransform

参考文献:

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

评论