爬虫案例:手把手教你爬取图片

写在最前面:程序很简单,重要的是思路以及对错误的分析

1.确认目标和大体思路:

今天我们需要爬取的网站是:http://www.bbsnet.com/doutu

下面是网站的首页:

可以看见,这个网站的特点是,一个图片是一系列图片的集合,因此我们需要先获取每一个图片的地址,然后跳转进去才能获取里面真正的图片。

接下来我们首先获取第一页的图片地址,一般来说,第一页与其他页的差别就在于url的一些小差别,因此,搞定第一页等于搞定所有。

下面开始盘它。

补充:我们下面使用requets库请求和xpath来解析(附赠正则解析方法)

二、分析与编写代码:

1.第一步导入库:

#导包

from lxml import etree

import requests

import re

import time

2.第二步写出大体框架:

这里我们还是采用面向对象来写,因为这样后期如果要改为多线程还是挺容易的。

class MySpider(object):

def __init__(self):

#显然我们需要最基础的headers信息

self.headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/86.0.4240.75 Safari/537.36',

}

#其次我们需要url

self.url = 'http://www.bbsnet.com/doutu'

def run(self):

#首先我们需要一个函数获取每一个url

target_urls = self.get_target_urls()

#其次我们需要去获取每一个url里面的图片

self.get_target_images(target_urls)

def get_target_urls(self):

'''这里我们使用一个东西,比如列表等来存储url的结果并返回'''

pass

def get_target_images(self,target_urls):

'''这里我们需要接收之前获取的url,所以需要一个参数'''

pass

if __name__ == '__main__':

spider = MySpider()

spider.run()

显然上面的代码跟我们的思路一模一样,是不是so easy。

3.第三步完成第一个函数 -- get_target_urls():

首先按照惯例,写下以下代码:

response = requests.get(self.url,headers=self.headers)

print(response.content.decode('utf-8'))

首先,分享下为什么有的时候我们对于文本要decode('utf-8'),而有时候对于文本需要decode('gbk'),这是根据网页源代码的编码形式来写的,比如这个网站的源代码如下:

但是,尝试运行了下,发现以下错误:

UnicodeEncodeError: 'gbk' codec can't encode character '\u2009' in position 424: illegal multibyte sequence

这个意思是说,这个网页存在一些字符是utf-8无法解码的,这是很正常的,毕竟有些神奇的字符,是utf-8无法表示的。

但是,大家不必紧张,这并不影响我们写代码。于是我们就这样吧,不解码了,直接以二进制的形式存储它,因为它并不影响我们去获取我们需要的链接。

于是写下这样代码:

response = requests.get(self.url,headers=self.headers)

text = response.content

好的,下面我们开始解析网页:

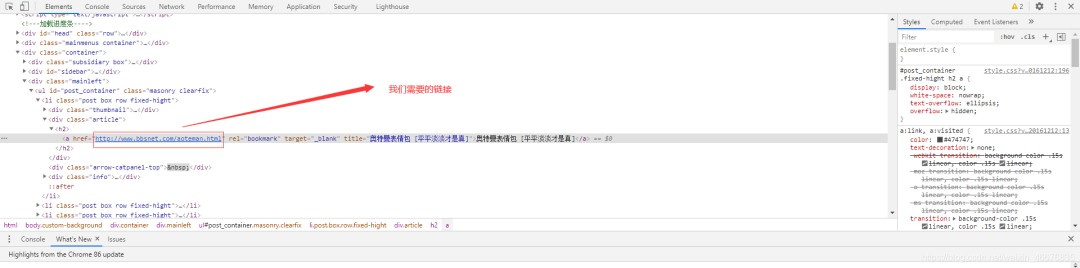

可以得到以下结果:

下面我们使用xpath来解析这个html代码,我们首先如上图定位a标签,显然这个a标签在h2标签里面,且这个h2标签里面只有这么一个a标签,所以十分容易获取,代码如下:

html = etree.HTML(text)

target_urls = html.xpath('//h2/a/@href')

print(target_urls)

下面是尝试打印的结果(部分):

['http://www.bbsnet.com/aoteman.html', 'http://www.bbsnet.com/jieqian.html', 'http://www.bbsnet.com/youxitu.html', 'http://www.bbsnet.com/liaotian-3.html',......]

好的,至此,这个函数就完成了,是不是十分简单。该函数代码如下:

def get_target_urls(self):

response = requests.get(self.url,headers=self.headers)

text = response.content

html = etree.HTML(text)

target_urls = html.xpath('//h2/a/@href')

return target_urls

4.第四步完成第二个函数 --get_target_images():

老套路,写下下面的代码:

for url in target_urls:

response = requests.get(url,headers=self.headers)

text = response.content.decode('utf-8')

print(text)

#这里强烈建议加上break测试

break

于是,得到下面的结果:

<html><head><script type="text/javascript">function f(){window.location.href="http://www.bbsnet.com/aoteman.html";}script>head><body onload="f()"><img style="display:none" src="http://tieba.baidu.com/_PXCK_7132125338940_2652120900.gif" />body>html>

好吧,显然这并不是我们需要的结果,那这是什么呢?这段代码(html代码)会自动把我们重定向到首页,这样我们显然获取不成功,于是,我们怎么办呢?在访问一次就可以了,我们仅需要在加上一次请求即可获取所需的html代码。如下:

for url in target_urls:

response = requests.get(url,headers=self.headers)

response = requests.get(url,headers=self.headers)

text = response.content

#这里同上面,不解码,直接解析,原因同上

print(text)

break

结果如下(部分结果):

b'html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">\r\n<html xmlns="http://www.w3.org/1999/xhtml">\r\n<head profile="http://gmpg.org/xfn/11">\r\n<meta charset="UTF-8">\r\n<meta http-equiv="Content-Type" content="text/html" />\r\n<meta name="referrer" content="no-referrer" />.......

好的,解决了这个大麻烦,我们下面的工作就很简单了。

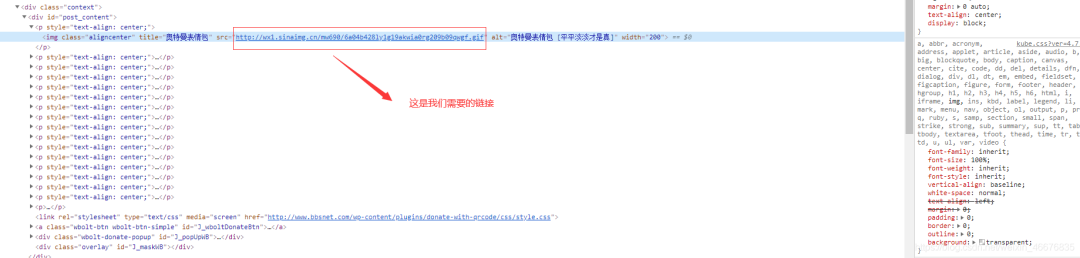

可以得到以下内容:

我们需要获取img标签里面的src属性,仅需获取div标签下的p标签下的img标签即可。下面是代码:

for url in target_urls:

response = requests.get(url,headers=self.headers)

time.sleep(2) #一定要加上,不然会访问太快会被禁止的

response = requests.get(url,headers=self.headers)

text = response.content

#开始解析

html = etree.HTML(text)

target_images = html.xpath('//div[@id="post_content"]//p//img/@src')

print(target_images)

break

部分结果如下:

['http://wx1.sinaimg.cn/mw690/6a04b428ly1g19akwia0rg209b09qwgf.gif', 'http://wx1.sinaimg.cn/mw690/6a04b428ly1g19al1td90g209q08sq4i.gif',....]

好的,我们仅仅剩最后一步,下载图片,这里我给出两者方式:

方式一:使用urllib库里的urlretrieve()函数,代码如下:

#该段代码添加至获得target_images后面

#大家使用这个方法的话,一定要记得导入库:from urllib import request

for image_url in target_images:

request.urlretrieve(image_url,'./info/test.gif')

break

方式二:获取链接的源代码后保存至本地,代码如下:

#该段代码添加至获得target_images后面

for image_url in target_images:

response = requests.get(image_url,headers=self.headers)

f = open('./info/test.gif','wb')

f.write(response.content)

f.close()

break

两者的结果都如下:

ok,到此处,恭喜大家,已经完成了99%的任务了。下面就是完善和补充一些代码了。

此函数完整代码如下:

def get_target_images(self,target_urls):

for url in target_urls:

response = requests.get(url,headers=self.headers)

time.sleep(2)

response = requests.get(url,headers=self.headers)

text = response.content

html = etree.HTML(text)

target_images =html.xpath('//div[@id="post_content"]//p//img/@src')

for image_url in target_images:

request.urlretrieve(image_url,'./info/test.gif')

break

break

#建议大家测试的时候,加上break,如果有基础的可以考虑代理或者多线程

5.第五步优化与完善:

一个优秀的人,总是想写出点优秀的代码,所以优化必不可少

1.优化角度一:文件存储的优化:

首先,上面我在这个py文件下面创建了一个info文件夹,所以才能写"./info/..."这样的代码,但是我相信大家的目录下肯定没有。所以必须优化。

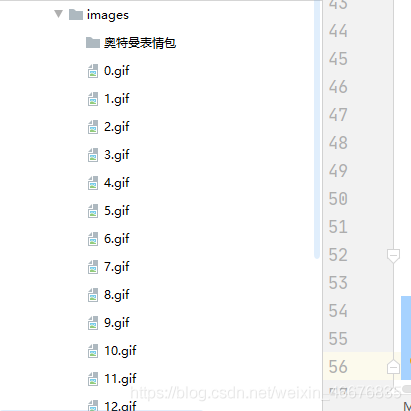

其次,我们可以这样考虑:使用os模块自动创建一个images的文件夹,其次可以在获取图片集合的url时顺便获取每个图片集合的标题,所以开始改写代码:

修改完成后如下(只需修改第二个函数):

def get_target_images(self,target_urls):

os.mkdir('./images')

for url in target_urls:

response = requests.get(url,headers=self.headers)

time.sleep(2)

response = requests.get(url,headers=self.headers)

text = response.content

html = etree.HTML(text)

target_images = html.xpath('//div[@id="post_content"]//p//img/@src')

title = html.xpath('//div[@id="post_content"]//p//img/@title')[0]

os.mkdir('./images/'+title)

for index,image_url in enumerate(target_images):

response = requests.get(image_url, headers=self.headers)

#这里我是用文件方式下载,因为不知道为什么我运行urlretrieve下载时下太久了

f = open('./images/%s/%s.gif'%(title,index), 'wb')

f.write(response.content)

f.close()

break

示例结果;

2.优化角度二:速度优化:

我相信如果直接去掉break去爬取所有的肯定会报错,因为访问太快了,所以可以采取一定的优化手段去优化它,这里我推荐两种方式,第一种是多线程,第二种是代理。这里我就不给出如何实现这种优化了,因为这篇文章的目的不在于此。

3.优化角度三:代码本身优化:

这里第二个函数的代码其实有点长了,因为里面有两个循环。所以可以考虑将其中的每一个循环封装为一个新的函数。这个结果我将给在最后的全部代码里面。

4.优化角度四:异常捕获:

想要捕获异常,有简单的方式,也有复杂的方式。下面只给出简单方式的代码:

这里我们只需修改主函数:

def run(self):

try:

#首先我们需要一个函数获取每一个url

target_urls = self.get_target_urls()

#其次我们需要去获取每一个url里面的图片

self.get_target_images(target_urls)

except Exception as e:

print('错误原因:',e)

复杂的方式就是分别去获取一些常见的异常,如404或者其他异常。

5.完善代码:

下面给出如何爬取多页的思路:

首先我们需要提取出第一、二、三页的url,如下:

第一页:http://www.bbsnet.com/doutu

第二页:http://www.bbsnet.com/doutu/page/2

第三页:http://www.bbsnet.com/doutu/page/3

好的,下面提出共同的部分:http://www.bbsnet.com/doutu/page/ + 页数

这里为了验证上面对于第一页这个特殊页是否适用,访问http://www.bbsnet.com/doutu/page/1,结果可以成功访问,因此下面我们只需去一个个迭代即可获取一页页的图片。

代码我将给在整体代码中。

三、全部代码:

# -*- coding:utf-8 -*-

# Author: 自学小白菜

'''

既然选择了前进,那每一步都要认真的去做

'''

#导包

from lxml import etree

import requests

from urllib import request

import time

import os

class MySpider(object):

def __init__(self):

#显然我们需要最基础的headers信息

self.headers = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/86.0.4240.75 Safari/537.36',

}

#其次我们需要url

self.url = 'http://www.bbsnet.com/doutu/page/{page}'

def run(self):

try:

pages = int(input('请输入需要获取多少页:'))

for page in range(1,pages+1):

url = self.url.format(page = page)

#首先我们需要一个函数获取每一个url

target_urls = self.get_target_urls(url)

#其次我们需要去获取每一个url里面的图片

self.get_target_images(target_urls)

except Exception as e:

print('错误原因:',e)

def get_target_urls(self,url):

'''这里我们使用一个东西,比如列表等来存储url的结果并返回'''

response = requests.get(url,headers=self.headers)

text = response.content

#下面开始解析

html = etree.HTML(text)

target_urls = html.xpath('//h2/a/@href')

return target_urls

def get_target_images(self,target_urls):

'''这里我们需要接收之前获取的url,所以需要一个参数'''

os.mkdir('./images')

for url in target_urls:

target_images,title = self.get_info(url)

for index,image_url in enumerate(target_images):

self.download(image_url,index,title)

break

break

def get_info(self,url):

response = requests.get(url, headers=self.headers)

time.sleep(2)

response = requests.get(url, headers=self.headers)

text = response.content

# 开始解析

html = etree.HTML(text)

target_images = html.xpath('//div[@id="post_content"]//p//img/@src')

title = html.xpath('//div[@id="post_content"]//p//img/@title')[0]

os.mkdir('./images/' + title)

return target_images,title

def download(self,image_url,index,title):

response = requests.get(image_url, headers=self.headers)

f = open('./images/%s/%s.gif' % (title, index), 'wb')

f.write(response.content)

f.close()

if __name__ == '__main__':

spider = MySpider()

spider.run()