深度学习需要掌握的 13 个概率分布(附代码)

共

2203字,需浏览

5分钟

·

2020-09-07 11:19

知乎作者:Sophia 来源:深度学习自然语言处理本文仅用于学术分享,著作权归作者所有。如有侵权,请联系后台作删文处理。在逛Github时发现了一个不错的总结,对深度学习的概率分布进行了总结。https://github.com/graykode/distribution-is-all-you-needgithub.com https://github.com/graykode/distribution-is-all-you-need/blob/master/uniform.py均匀分布在 [a,b] 上具有相同的概率值,是简单概率分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/bernoulli.py先验概率 p(x)不考虑伯努利分布。因此,如果我们对最大似然进行优化,那么我们很容易被过度拟合。利用二元交叉熵对二项分类进行分类。它的形式与伯努利分布的负对数相同。https://github.com/graykode/distribution-is-all-you-need/blob/master/binomial.py参数为 n 和 p 的二项分布是一系列 n 个独立实验中成功次数的离散概率分布。二项式分布是指通过指定要提前挑选的数量而考虑先验概率的分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/categorical.py多伯努利称为分类分布。交叉熵和采取负对数的多伯努利分布具有相同的形式。https://github.com/graykode/distribution-is-all-you-need/blob/master/multinomial.py多项式分布与分类分布的关系与伯努尔分布与二项分布的关系相同。https://github.com/graykode/distribution-is-all-you-need/blob/master/beta.py利用共轭,利用已知的先验分布可以更容易地得到后验分布。当β分布满足特殊情况(α=1,β=1)时,均匀分布是相同的。https://github.com/graykode/distribution-is-all-you-need/blob/master/dirichlet.py

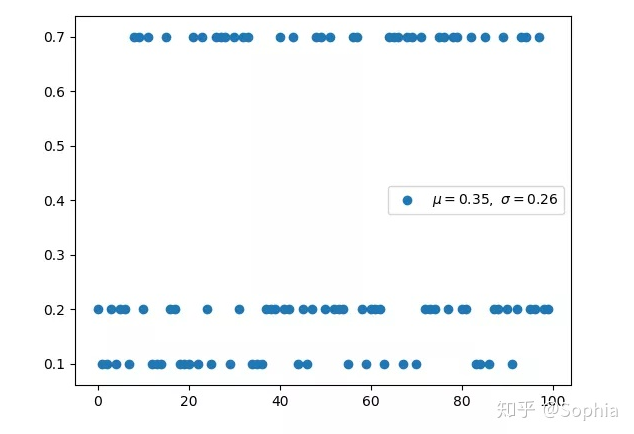

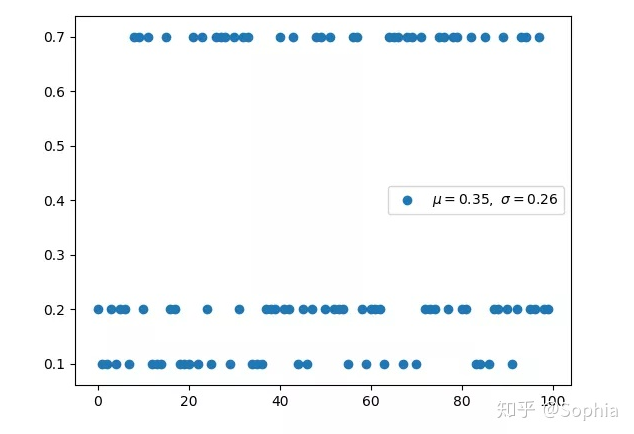

https://github.com/graykode/distribution-is-all-you-need/blob/master/uniform.py均匀分布在 [a,b] 上具有相同的概率值,是简单概率分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/bernoulli.py先验概率 p(x)不考虑伯努利分布。因此,如果我们对最大似然进行优化,那么我们很容易被过度拟合。利用二元交叉熵对二项分类进行分类。它的形式与伯努利分布的负对数相同。https://github.com/graykode/distribution-is-all-you-need/blob/master/binomial.py参数为 n 和 p 的二项分布是一系列 n 个独立实验中成功次数的离散概率分布。二项式分布是指通过指定要提前挑选的数量而考虑先验概率的分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/categorical.py多伯努利称为分类分布。交叉熵和采取负对数的多伯努利分布具有相同的形式。https://github.com/graykode/distribution-is-all-you-need/blob/master/multinomial.py多项式分布与分类分布的关系与伯努尔分布与二项分布的关系相同。https://github.com/graykode/distribution-is-all-you-need/blob/master/beta.py利用共轭,利用已知的先验分布可以更容易地得到后验分布。当β分布满足特殊情况(α=1,β=1)时,均匀分布是相同的。https://github.com/graykode/distribution-is-all-you-need/blob/master/dirichlet.py https://github.com/graykode/distribution-is-all-you-need/blob/master/gamma.py如果 gamma(a,1)/gamma(a,1)+gamma(b,1)与 beta(a,b)相同,则 gamma 分布为β分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/exponential.pyhttps://github.com/graykode/distribution-is-all-you-need/blob/master/gaussian.pyhttps://github.com/graykode/distribution-is-all-you-need/blob/master/normal.pyhttps://github.com/graykode/distribution-is-all-you-need/blob/master/chi-squared.pyk 自由度的卡方分布是 k 个独立标准正态随机变量的平方和的分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/student-t.pyt分布是对称的钟形分布,与正态分布类似,但尾部较重,这意味着它更容易产生远低于平均值的值。

https://github.com/graykode/distribution-is-all-you-need/blob/master/gamma.py如果 gamma(a,1)/gamma(a,1)+gamma(b,1)与 beta(a,b)相同,则 gamma 分布为β分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/exponential.pyhttps://github.com/graykode/distribution-is-all-you-need/blob/master/gaussian.pyhttps://github.com/graykode/distribution-is-all-you-need/blob/master/normal.pyhttps://github.com/graykode/distribution-is-all-you-need/blob/master/chi-squared.pyk 自由度的卡方分布是 k 个独立标准正态随机变量的平方和的分布。https://github.com/graykode/distribution-is-all-you-need/blob/master/student-t.pyt分布是对称的钟形分布,与正态分布类似,但尾部较重,这意味着它更容易产生远低于平均值的值。

点赞

评论

收藏

分享

手机扫一扫分享

举报

点赞

评论

收藏

分享

手机扫一扫分享

举报

下载APP

下载APP