上个月,ACL 2021 公布了最佳论文、最佳主题论文和杰出论文,共8篇论文入选!

其中,字节跳动摘得唯一一篇最佳论文(best paper)桂冠。

这是ACL成立59年以来,中国科学家团队第2次摘得最高奖项!

这篇获奖论文题目为 Vocabulary Learning via Optimal Transport for Machine Translation 。

该研究提出了一种新的词表学习方案VOLT,在多种翻译任务上取得了优秀的结果。

今年是自然语言处理领域顶级会议ACL的第59届年会,于8月2日-5日在线上举行。

在8月5日进行的ACL 2021大会上,主办方为最佳论文正式颁奖。

要说这次获奖的idea,离不开一个「执念」。

如今AI在全世界都很火,AI模型的强度往往和算力成正比,占用大量算力资源、消耗大量电能去训练超大模型成为一股风潮,而且确实创造了巨大的效益。

但是在字节AI Lab很多研究人员看来,在实现同样效果的前提下,降低模型复杂度、推动节能环保也是很有价值的一个研究方向。

VOLT论文第一作者许晶晶,就以「机器学习节能减排」的研究当选为AAAI今年评选的学术新星(New Faculty Highlight)。

从VOLT的测试效果来看,其对促进AI产业节能环保极具潜力。

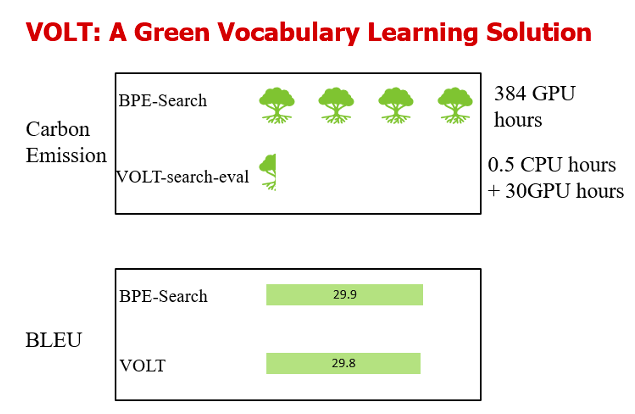

以主流词表BPE为例,业界普遍会通过大量自然语言处理下游任务的训练以寻找最优大小。

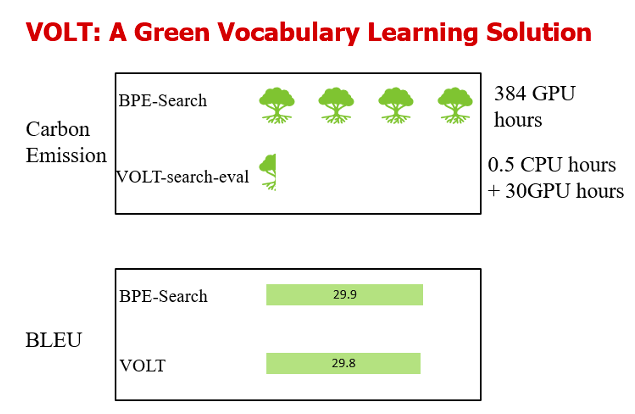

相比之下,使用VOLT方案可以节省大约92%的算力,这同时意味着所需电能的大量减少。

这篇论文得到ACL评审们的一致好评:

字节跳动的VOLT方案对机器翻译中一个重要问题提出了有效且新颖的解决方案,能显著减少词表的学习和搜索时间,相信其不仅会在研究界产生重要影响,在工业应用方面也有着巨大潜力。根据ACL 2021官方信息,本届大会共计收到3350篇论文投稿,最终有 21.3% 的论文录用,并接收了14.9%的论文到Findings子刊,综合录用率为 36.2%。那么,字节跳动AI Lab的VOLT为何能在3350篇论文中脱颖而出?

VOLT最为突出的贡献便是去解决自然语言处理(NLP)的两个基本问题:

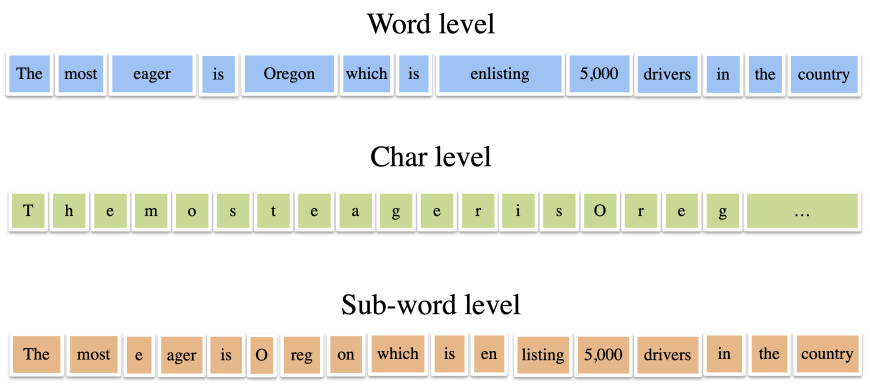

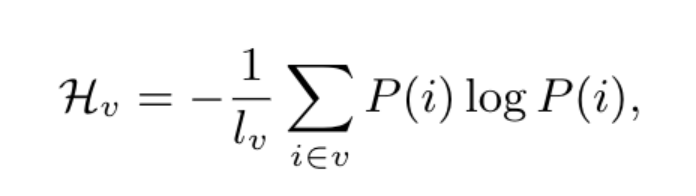

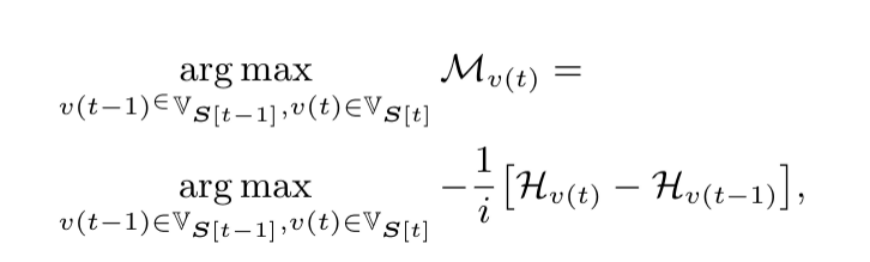

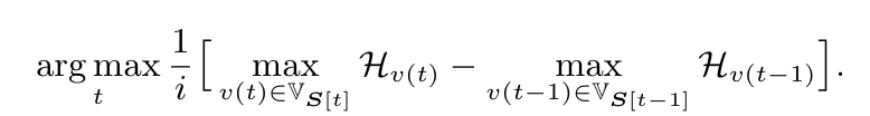

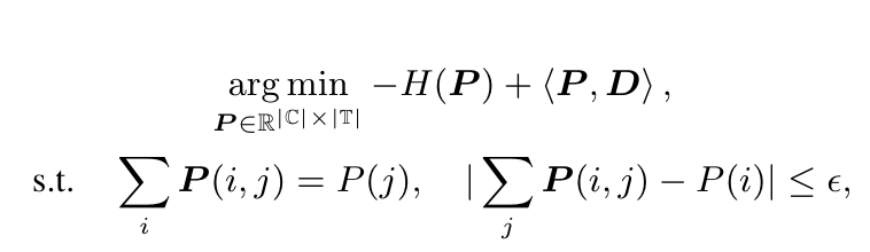

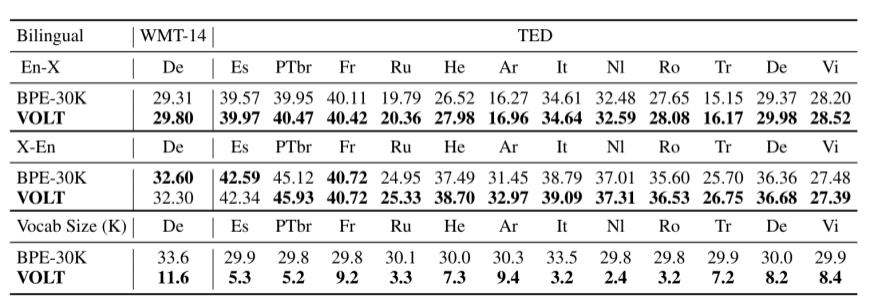

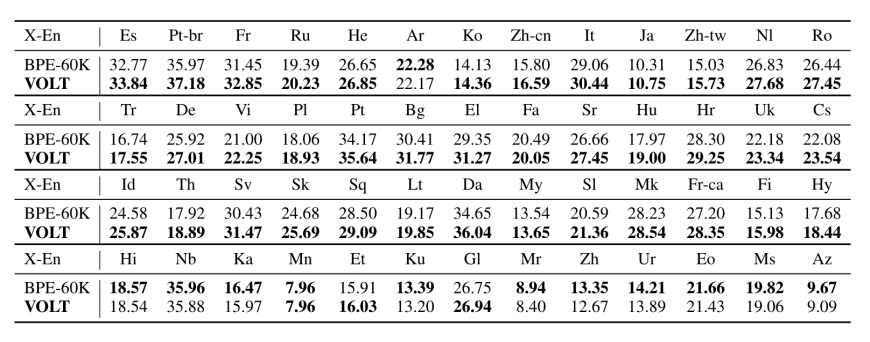

子词级别词表的效果在多个任务上已经得到了验证,由此,作者表示子词是目前来说比较好的选择。相比于传统的词为基础单位的词表,子词规模小不会面临稀疏标记(token)的问题。相比于字结构的词表,子词也不会面临熵太大语义无法区分的问题。于是,在确定最优词表的评价指标方面,作者综合考虑了信息熵和词表大小这两个主要因素。信息熵也可以理解成为蕴含在每个字中的平均语义含量。直观上理解信息熵越小表示每个字或者词表示的信息越简单,那么更加利于模型学习。作者使用基于字的熵计算方式来评估该属性,其中v为词表,i为词表中的标记,P为标记在训练集出现的频率:机器学习对训练数据的数量要求很高,稀疏标记的出现概率较低,因此稀疏标记越多,需要的训练数据往往也就越多。在基于频率的方法下,词表越小,稀疏标记越少,参数也越少,因此,小的词表更加有利于模型学习。然而,信息熵和词表大小不可以兼得。词表越大,所需参数越大,稀疏标记越多,但是信息熵在减小。边际收益衡量了付出单位代价所能获得的利益的数量。边际收益越大,那么投入产出比越高。将信息熵看成是边际收益中的利益,词表大小看成是边际收益中的代价。随着词表的增加,不同大小的词表的信息熵收益是不同的。因此,利用边际收益的概念便可以对衡量词表质量的指标MUV进行定义,并且可以观测到MUV指标和下游任务的相关性。在确定词表评价指标MUV之后,学习最优词表的问题可以粗略地等价为寻找具有最大MUV的词表问题。为了解决这一问题,作者将词表搜索转化为最优运输的过程。比如cat在训练集中出现了20次,那么cat需要20个c,20个a,和20个t来组成该标记。为了避免不合法的搬运,作者将不合法的搬运设为无穷大(比如字e搬运给标记cat是不合法的)。由于字的个数是有限的,有一些标记候选就无法拿到对应的字,那么这些标记将会从最终的词表中踢出去。为了将词表学习的问题转化成为最优运输的代价,就需要进行一些重构操作了:MUV可以理解成为熵对词表大小的一阶导数,为了建模连续的导数,作者引入了相对分数来模拟导数:H代表的是信息熵,分子是信息熵的相对变化量,而分母中的i代表词表大小的变化量,S是一个递增序列,每个元素代表以该时刻大小为上届的所有词表组合。因此对于每个步骤来说,都存在一个具有最大MUV分数的词表,只要对所有的步骤做遍历,就可找到最优词表。为了进一步降低求解难度,作者对每一步的求解公式做了一个近似:因此,每个步骤的问题就转化成了每个步骤寻找熵最大词表的问题。接着使用基于熵的最优运输解法就可以将最优运输的目标定义成为寻找熵最大词表的问题。找到词表的最大熵并且计算出当前的最大MUV分数,最后遍历所有的步骤即可找到具有最优的MUV的词表。由于篇幅限制,这儿就不展开说了。相关细节可查看论文作者blog:https://jingjing-nlp.github.io/volt-blog/在从双语翻译的结果上看,新方法学到的词表比经常使用的词表小很多,效果也很有竞争力。从多语翻译的结果上看,在三分之二的数据集上效果也是较好的。文章除了介绍VOLT提供一个更好的词表学习工具外,还分析了词表大小对表现的影响。作者使用VOLT搜索出的词表大小生成了BPE的词表,发现也可以得到相似的结果,因此作者也推荐使用VOLT作为一种词表大小学习方式。除此之外,实验中也发现简单的基线模型在使用了VOLT生成的词表之后也达到了和最优受限结果(不借助外部资源)匹配的分数,或许也可以引发对基线模型效果的进一步思考。

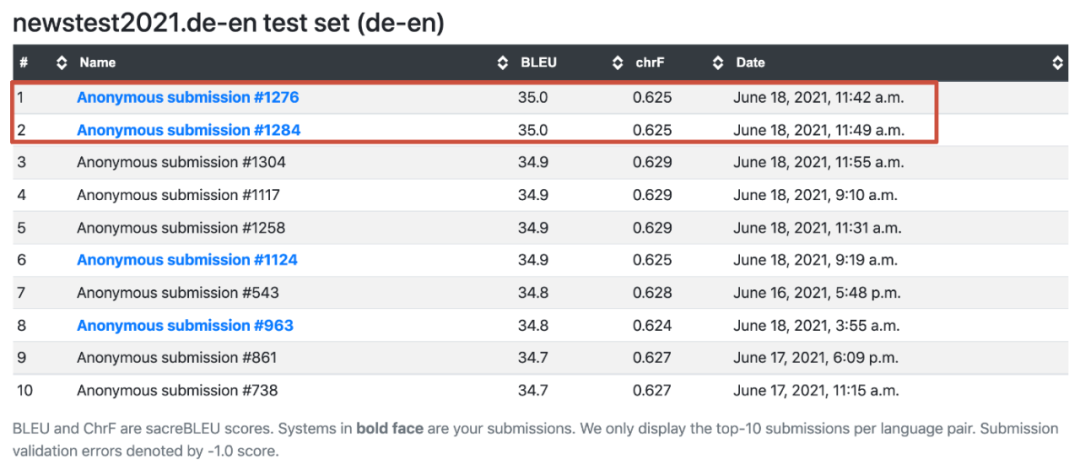

和谷歌翻译一样,字节团队的论文研究成果也会在火山翻译中逐步得到应用。主要为飞书、今日头条等产品和火山引擎的「企业级客户」提供机器翻译支持。这是一个数学教学视频,原视频中带有人工翻译的字幕。再来看经过火山翻译后的视频字幕,其翻译质量并不比人工翻译逊色多少。2021年以来,火山翻译实现多项重要技术突破,研发出支持150个语种互译的大规模翻译模型mRASP2。项目地址: https://github.com/PANXiao1994/mRASP2此外,还对外开源了当前业界最快的推理和训练引擎LightSeq2.0,以及端到端语音翻译工具包NeurST,获得开源社区的广泛好评。项目地址: https://github.com/bytedance/lightseqLightSeq在GitHub上已经获得了1500星。项目地址: https://github.com/bytedance/neurst在此前由ACL举办的机器翻译大赛WMT2021上,火山翻译以独创的「并行翻译」系统参赛,夺得德语到英语方向比赛自动评估第一名。「并行翻译」在国际赛事中首次亮相,就击败了从左向右逐词翻译的传统技术,打破后者在机器翻译领域的绝对统治地位,这项技术的论文也得到ACL 2021大会收录。目前,火山翻译已支持56个语种、3080个语向的翻译。从背后可以看出,火山翻译的技术离不开字节团队多年来在机器学习和自然语言的深耕,有一套前沿研究、产品研发和用户反馈的闭环。字节业务覆盖150个国家和地区,研发团队分布在全世界多个国家,工作中也在使用自己打造的产品来跨语言沟通。