激光雷达作为相机 --数字激光雷达对计算机视觉的影响

点击下方卡片,关注“新机器视觉”公众号

视觉/图像重磅干货,第一时间送达

来源:CV技术指南 作者:ouster

翻译:仿佛若有光

前言:

本文源自ouster(一家激光雷达公司)的博客,以往激光雷达和相机都是作为单独的传感器,在算法上对各自的数据做融合。这家公司开发了数字激光雷达OS1,在硬件上实现了对相机和激光雷达的融合。

OS1 模糊了激光雷达和相机之间的界限

三年前我们开始开发 OS1 (中距激光雷达)时,很明显,针对相机的深度学习研究已经超过了激光雷达研究。激光雷达数据具有令人难以置信的优势——丰富的空间信息和与光照无关的传感等等——但它缺乏相机图像的原始分辨率和高效的阵列结构,而且 3D 点云仍然更难以在神经网络中编码或使用硬件进行处理加速度。

考虑到两种传感模式之间的权衡,我们从一开始就着手将激光雷达和相机的最佳方面整合到一个设备中。今天,我们将发布固件升级和更新我们的开源驱动程序,以实现这一目标。 OS1 现在无需摄像头即可实时输出固定分辨率的深度图像、信号图像和环境图像。数据层在空间上完全相关,具有零时间不匹配或快门效应,并且具有每像素 16 位和线性照片响应。一探究竟:

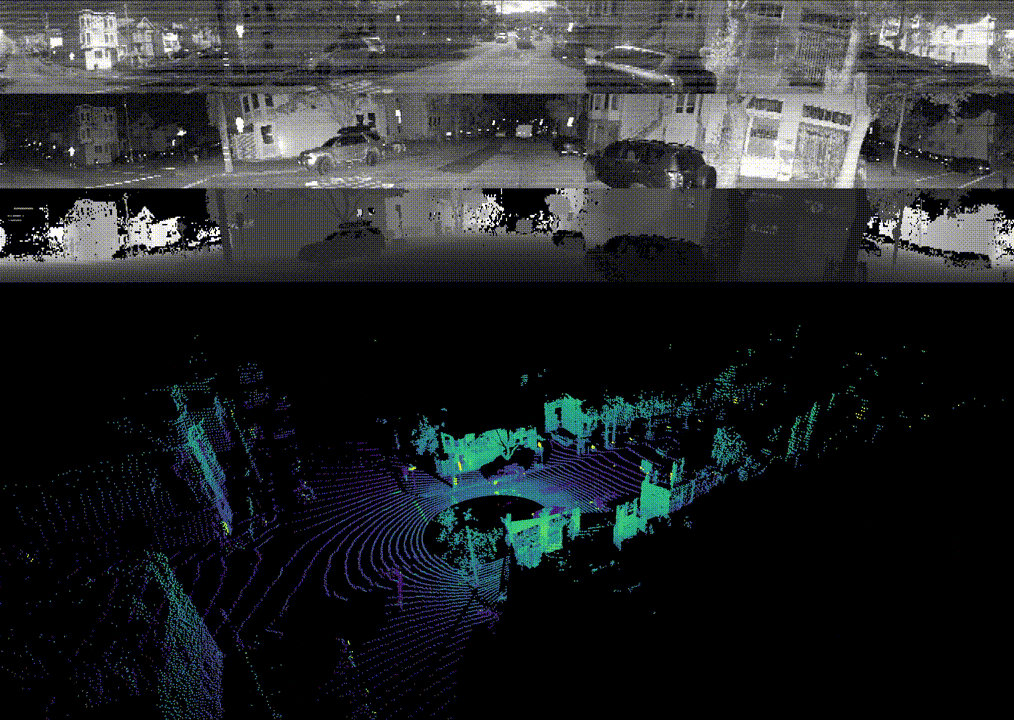

从 OS1 输出的同步实时图像层。您从上到下看到的是环境、强度、范围和点云数据 - 全部来自我们的激光雷达。请注意,环境图像捕获了多云的天空以及树木和车辆的阴影。

OS1 的光学系统具有比大多数数码单反相机更大的光圈,而且我们开发的光子计数 ASIC 具有极低的光敏度,因此即使在弱光条件下我们也能够收集环境图像。OS1 捕获近红外信号和环境数据,因此数据与同一场景的可见光图像非常相似,这使数据看起来很自然,并且很有可能为相机开发的算法很好地转化为数据。将来,我们将努力从这些环境图像中去除固定模式噪声,但我们希望同时让客户获得数据!

我们还更新了我们的开源驱动程序以将这些数据层输出为固定分辨率的 360° 全景帧,以便客户可以立即开始使用新功能,并且我们提供了一个基于 VTK 的新跨平台可视化工具,用于查看、记录,并在Linux、Mac 和 Windows 上并排播放图像和点云。传感器输出的数据不需要后处理即可实现此功能——神奇之处在于硬件,驱动程序只需将流数据包组装成图像帧。

我们新的开源可视化工具。 完整驱动视频:https://www.youtube.com/watch?v=LcnbOCBMiQM

我们鼓励任何对 OS1 感到好奇的人在线观看我们未经编辑的视频,或下载我们的原始数据并使用可视化工具自己播放。

固件更新页面:https://www.ouster.io/downloads

Github & 样本数据:www.github.com/ouster-LIDAR

This Is Not a Gimmick(噱头)

我们已经看到多家激光雷达公司通过将单独的摄像头与激光雷达共同安装、执行劣质的外部校准并发布最终无用产品的新闻稿来销售激光雷达/摄像头融合解决方案。我们没有这样做,为了证明这一点,我们想分享一些示例,说明 OS1 传感器数据的强大功能,这让我们回到了深度学习。

由于传感器输出具有每个像素的深度、信号和环境数据的固定分辨率图像帧,因此我们能够将这些图像直接输入到最初为相机开发的深度学习算法中。我们在向量中编码深度、强度和环境信息,就像彩色图像网络在输入层编码红色、绿色和蓝色通道一样。我们训练的网络非常适合新的激光雷达数据类型。

作为一个例子,我们训练了一个每像素语义分类器,以在旧金山周围的一系列深度和强度帧上识别可行驶的道路、车辆、行人和骑自行车的人。我们能够在 NVIDIA GTX 1060 上实时运行生成的网络并取得了令人鼓舞的结果,特别是考虑到这是我们尝试的第一个实现。

Full video: https://www.youtube.com/watch?v=JxR9MasA9Yc

因为所有数据都是按像素提供的,所以我们能够将 2D 掩码无缝转换为 3D 帧,以进行额外的实时处理,如边界框估计和跟踪。

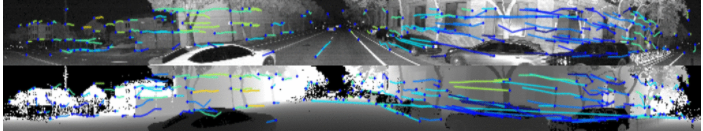

在其他情况下,我们选择将深度、信号和环境图像分开,并将它们独立地通过同一个网络。 例如,我们从DeTone 等人的 SuperPoint 项目 [link] 中获取了预训练的网络,并直接在我们的强度和深度图像上运行它。该网络在大量通用 RB 图像上训练,从未见过深度/激光雷达数据,但强度和深度图像的结果都令人惊叹:

Full video:https://www.youtube.com/watch?v=igsJxrbaejw

仔细检查后,很明显网络在每张图像中拾取了不同的关键点。 任何从事激光雷达和视觉里程计工作的人都会明白这个结果所体现的冗余的价值。 激光雷达里程计在隧道和高速公路等几何均匀的环境中挣扎,而视觉里程计在无纹理和光线不足的环境中挣扎。 OS1 的相机/激光雷达融合为这一长期存在的问题提供了多模式解决方案。

正是这样的结果让我们相信,融合良好的激光雷达和相机数据远不止它们的总和,我们预计未来激光雷达和相机之间会进一步融合。

1. 视频:

带有环境数据的 Sunny Drive:

正向视图:https://www.youtube.com/watch?v=9qYwROaCxF4

顶视图:https://www.youtube.com/watch?v=X7TljH5x2kE

斜视:https://www.youtube.com/watch?v=LcnbOCBMiQM

像素语义分割:https://www.youtube.com/watch?v=JxR9MasA9Yc

超点:https://www.youtube.com/watch?v=igsJxrbaejw

2.固件更新页面:

https://www.ouster.io/downloads

3. Github & 样本数据:

www.github.com/ouster-LIDAR

原文链接:

https://ouster.com/zh-cn/blog/the-camera-is-in-the-lidar/

—版权声明—

仅用于学术分享,版权属于原作者。

若有侵权,请联系微信号:yiyang-sy 删除或修改!

—THE END—