昨晚,CVPR 2021 公布了最佳论文、最佳学生论文等奖项。德国马普所和蒂宾根大学的研究者获得了最佳论文奖,加州理工和西北大学的研究者获得最佳学生论文奖。此外,FAIR 包括何恺明在内的两位华人学者获得最佳论文提名,而另一位华人学者、华盛顿大学计算机系硕士研究生林山川(Shanchuan Lin)获得了最佳学生论文提名。

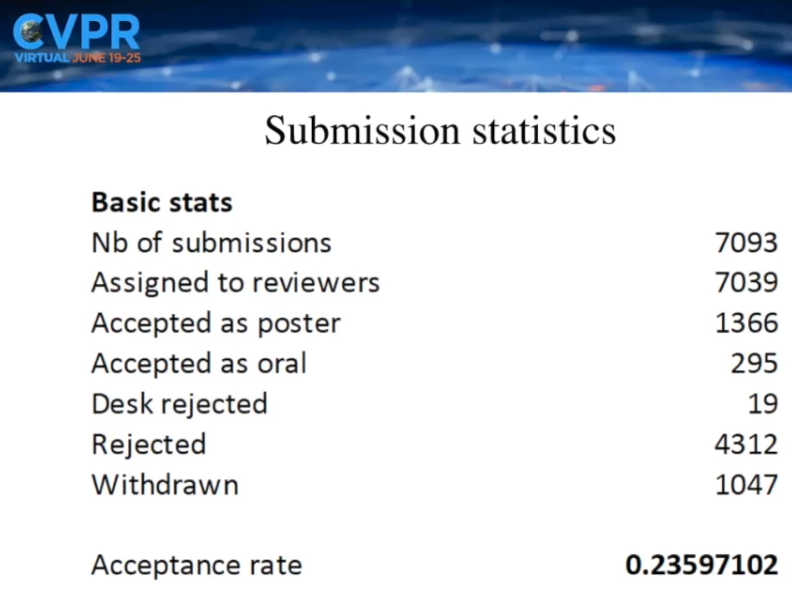

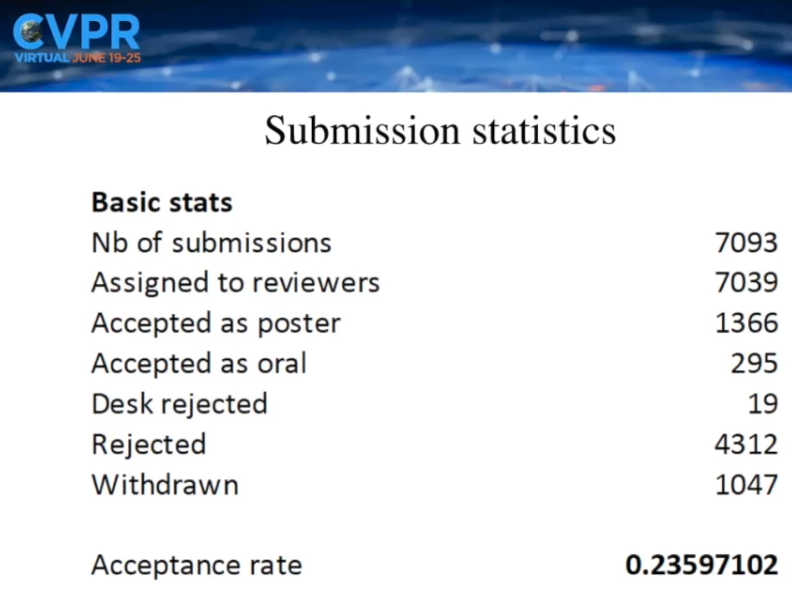

6 月 19 日,CVPR 2021 在线上拉开帷幕。今年,大会一共接收了 7039 篇有效投稿,其中进入 Decision Making 阶段的共有约 5900 篇,最终有 1366 篇被接收为 poster,295 篇被接收为 oral,其中录用率大致为 23.6%,略高于去年的 22.1%。

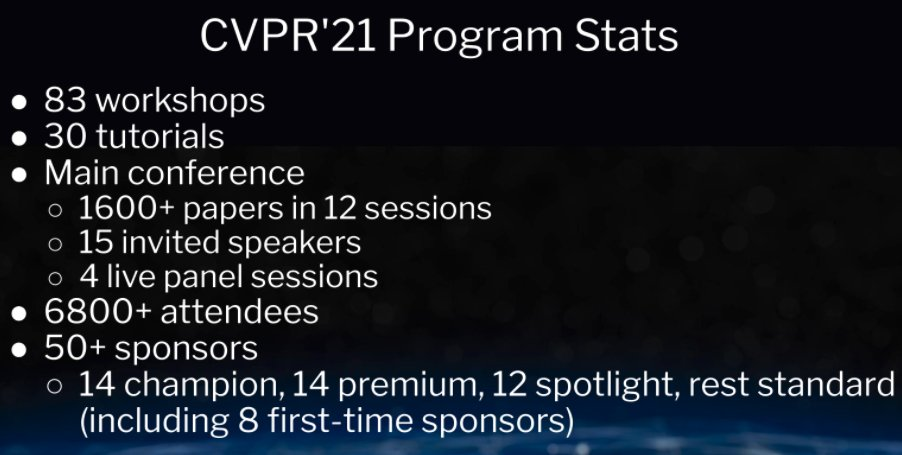

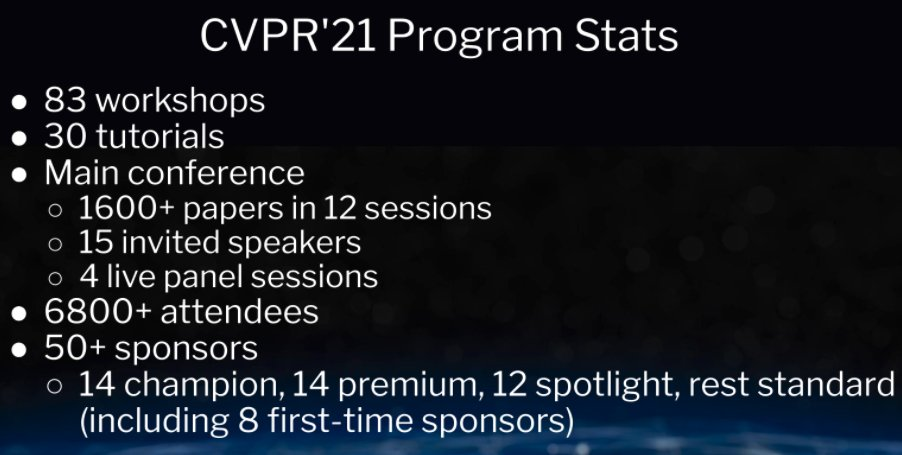

此外,大会还公布了参会人数等具体的统计数据。据悉,CVPR 2021 共有 83 个 workshop、30 个 tutorial、6800 多位参与者、12 个 session 的 1600 多篇论文、15 位受邀演讲者和 4 个 live 专题讨论会,以及 50 多位赞助商。

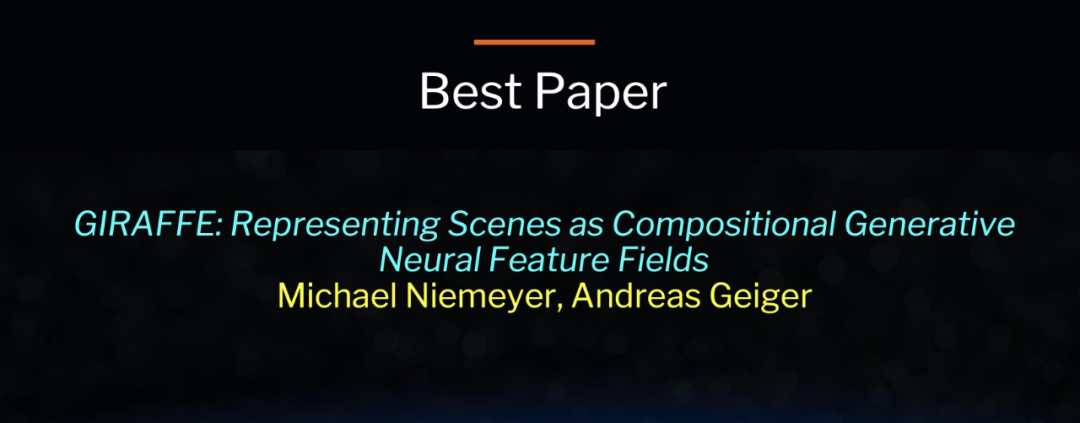

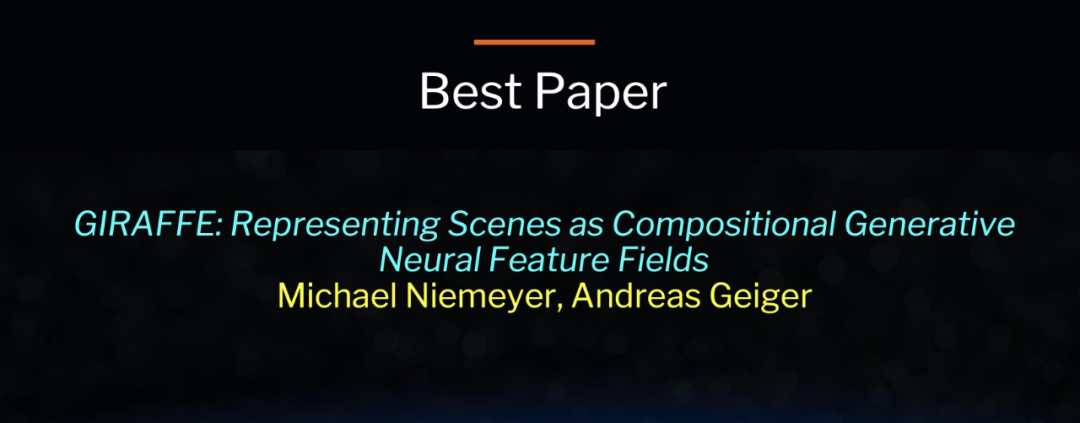

企业方面,国内的 AI 公司在本届 CVPR 上依然取得了良好的成绩,比如商汤有 66 篇论文入选,还拿到了 CVPR 2021 ActivityNet 时序动作检测任务弱监督学习赛道冠军以及 CVPR 2021 NTIRE 视频理解挑战赛的三项冠军;快手也有 14 篇论文被接收,涵盖三维视觉、目标检测、视频目标分割、人脸伪造技术检测等热门研究领域。昨晚,本届大会的最佳论文、最佳学生论文等奖项悉数公布,其中,最佳论文由德国马普所和蒂宾根大学的两位研究者摘得,最佳学生论文由加州理工学院、西北大学的多位研究者获得。今年的最佳论文是由德国马普所和蒂宾根大学的两位研究者摘得,获奖论文是《GIRAFFE: Representing Scenes As Compositional Generative Neural Feature Fields》。

论文地址:https://arxiv.org/pdf/2011.12100.pdf深度生成模型允许以高分辨率进行高真实感图像合成。但对于许多应用程序来说,这还不够:内容创建还需要可控。虽然近来一些工作研究了如何解开数据中变化的潜在因素,但其中大多数是在 2D 场景下运行的,而忽略了现实世界是 3D 的。此外,只有少数研究考虑了场景的构图性质。而该研究的关键假设是将组合 3D 场景表征结合到生成模型中,以生成更加可控的图像合成。通过将场景表征为组合的生成神经特征场,该研究能够从背景中分离出一个或多个目标以及单个目标的形状和外观,同时从非结构化和未定位的图像集合中学习,而无需任何额外的监督。该研究通过将场景表征与神经渲染 pipeline 相结合,得到了快速且逼真的图像合成模型。实验表明,该模型能够分离出单个目标,并允许在场景中平移和旋转它们以及改变相机位姿。

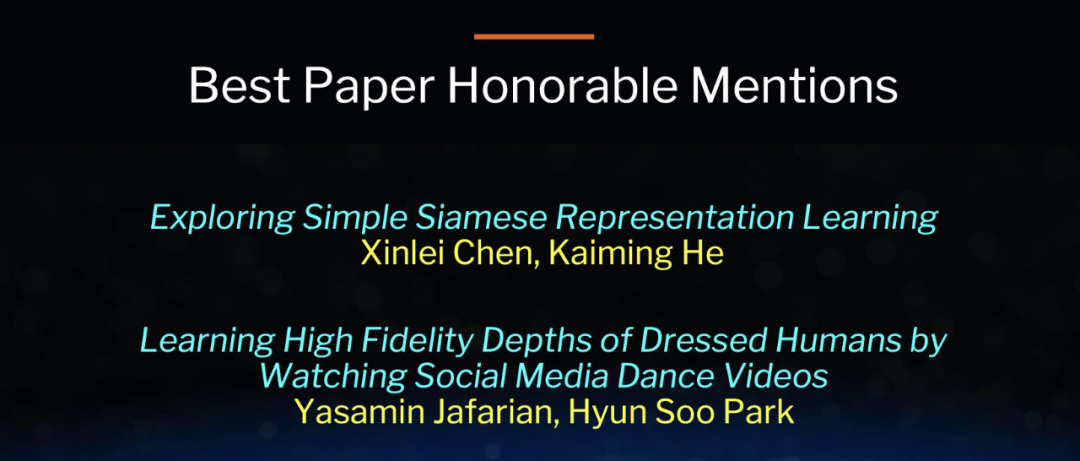

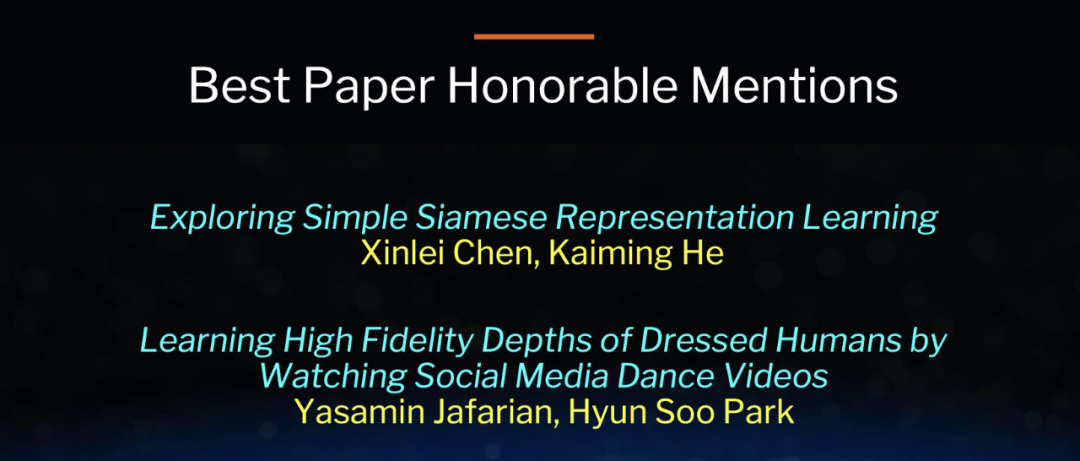

Michael Niemeyer 马克斯·普朗克智能系统研究所 AVG 组计算机视觉 / 机器学习方向的博士生,导师是 Andreas Geiger。他的研究重点是 3D 视觉,并对机器从稀疏观察中推断出 3D 表征感兴趣。此外,Niemeyer 重点关注神经场景表征领域的研究。Niemeyer 本科毕业于德国科隆大学,之后在圣安德鲁斯大学获得高级计算机科学硕士学位。今年获得最佳论文提名的论文有两篇,分别由 FAIR 和明尼苏达大学的研究者摘得。

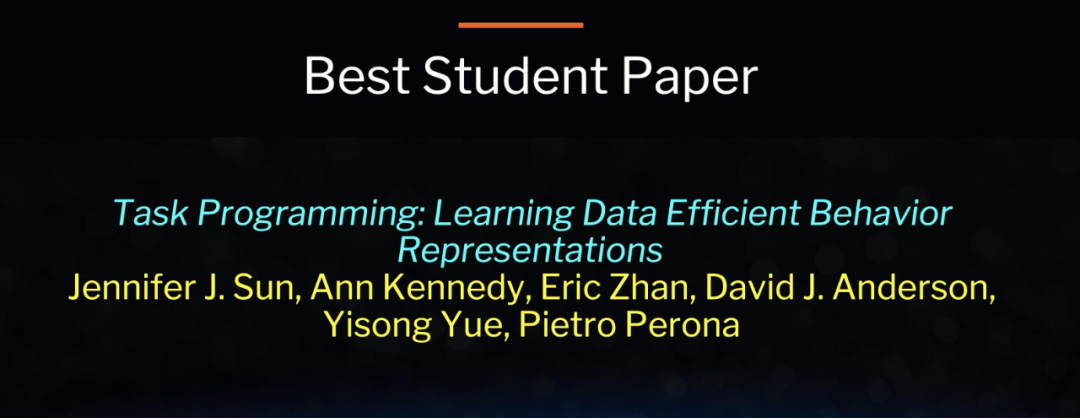

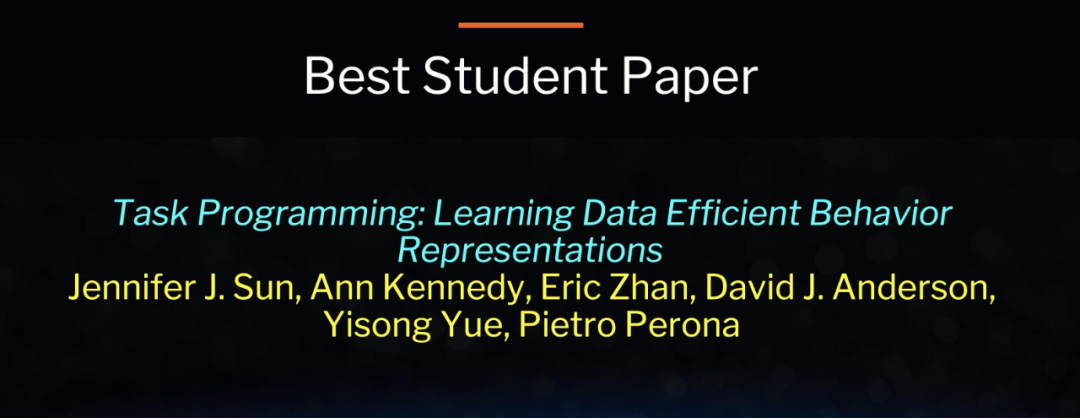

论文 1:《Exploring Simple Siamese Representation Learning》摘要:Siamese 网络已成为各种无监督视觉表征学习模型中的常见结构。这些模型最大限度地提高了一个图像的两个增强之间的相似性,但需要满足一定的条件,以避免模型崩溃。该论文给出了令人惊讶的实证结果,即使不使用以下任何一种形式,简单的 Siamese 网络也可以学习有意义的表征:(i) 负样本对、(ii)大 batch 和(iii)momentum 编码器。实验证明,对于损失和结构确实存在崩溃解 (collapsing solutions),但停止梯度操作在防止崩溃方面起着至关重要的作用。该论文提供了一个关于 stop-gradient 含义的假设,并通过概念验证实验进一步验证了这一假设。该研究提出的 SimSiam 方法在 ImageNet 和下游任务上获得了具有竞争力的结果。该研究希望这个简单的基线将激励研究者重新思考 Siamese 体系架构在无监督表征学习中的作用。论文 2:《Learning High Fidelity Depths of Dressed Humans by Watching Social Media Dance Videos》摘要:学习穿戴人体几何的一个关键挑战在于真值数据(如三维扫描模型)的有限可用性,这导致三维人体重建在应用于真实世界图像时性能下降。该研究通过利用一种新的数据资源来应对这一挑战:大量的社交媒体舞蹈视频,涵盖了不同的外观、服装风格、表演和身份。每个视频描述了一个人的身体和衣服的动态运动,然而缺乏 3D 真值几何。为了利用这些视频,该研究提出了一种新的方法来使用局部变换,即将预测的局部几何体从一幅图像在不同的时刻扭曲到另一幅图像。通过变换,预测的几何可以通过来自其他图像的扭曲几何进行自监督。此外,该研究还通过最大化局部纹理、褶皱和阴影的几何一致性,联合学习深度以及对局部纹理、褶皱和阴影高度敏感的曲面法线。该研究的方法是端到端可训练的,可以产生高保真深度估计来预测精细几何贴近输入真实图像。该论文表明所提方法在真实图像和渲染图像上都优于 SOTA 人体深度估计和人体形状恢复方法。今年的最佳学生论文由加州理工学院、西北大学的多位研究者获得,获奖论文是《Task Programming: Learning Data Efficient Behavior Representations》。

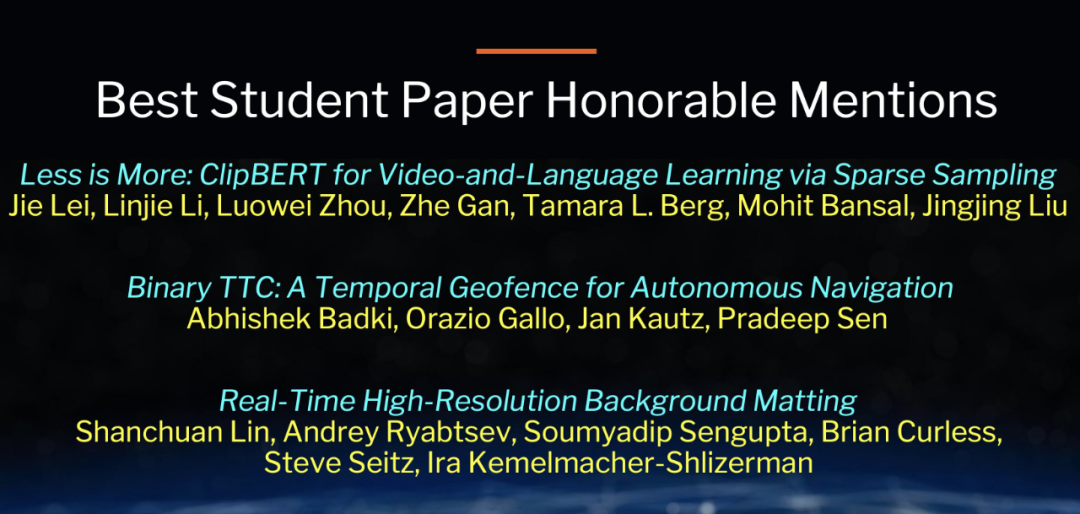

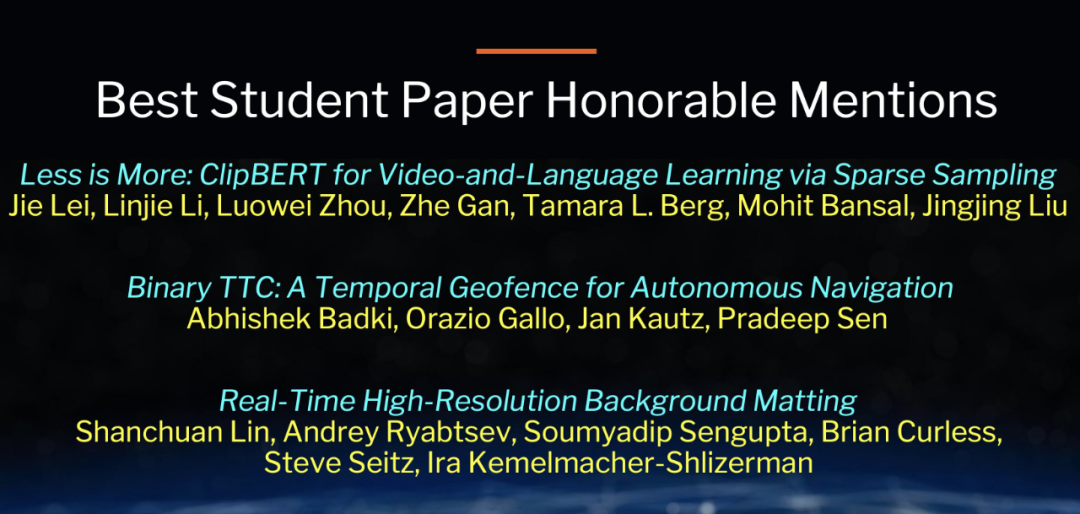

论文地址:https://arxiv.org/pdf/2011.13917.pdf专业领域知识对于准确注释训练集以进行深入分析通常是必需的,但从领域专家那里获取这些知识可能既繁琐又耗时。这个问题在自动化行为分析中尤为突出,该领域通常从视频跟踪数据中检测出智能体运动或其他感兴趣的动作。为了减少注释工作,该研究提出了 TREBA:一种基于多任务自监督学习,用于行为分析的学习注释样本有效轨迹嵌入的方法。该方法中的任务可以由领域专家通过一种称为「任务编程」的过程进行有效设计,该过程使用程序明确编码来自领域专家的结构化知识。通过构建少量编程任务来换取数据注释时间,可以减少领域专家的工作量。该研究使用来自行为神经科学的数据来评估这种权衡,其中使用专门的领域知识来识别行为。该研究在两个领域(小鼠和果蝇)的三个数据集中展示了实验结果。与 SOTA 特征相比,使用来自 TREBA 的嵌入可以在不影响准确率的情况下将注释负担减少 10 倍。该研究的结果表明,任务编程和自监督可以成为减少领域专家注释工作的有效方法。今年获得最佳学生论文提名的论文有三篇,分别由北卡罗来纳大学教堂山分校 & 微软 Dynamics 365 AI Research、英伟达 & 加州大学圣芭芭拉分校以及华盛顿大学的研究者摘得。

论文 1:《Less Is More: ClipBERT for Video-and-Language Learning via Sparse Sampling》论文作者:Jie Lei、Linjie Li、Luowei Zhou、Zhe Gan、Tamara L. Berg、Mohit Bansal、Jingjing Liu

作者机构:北卡罗来纳大学教堂山分校、微软 Dynamics 365 AI Research

论文地址:https://arxiv.org/pdf/2102.06183.pdf

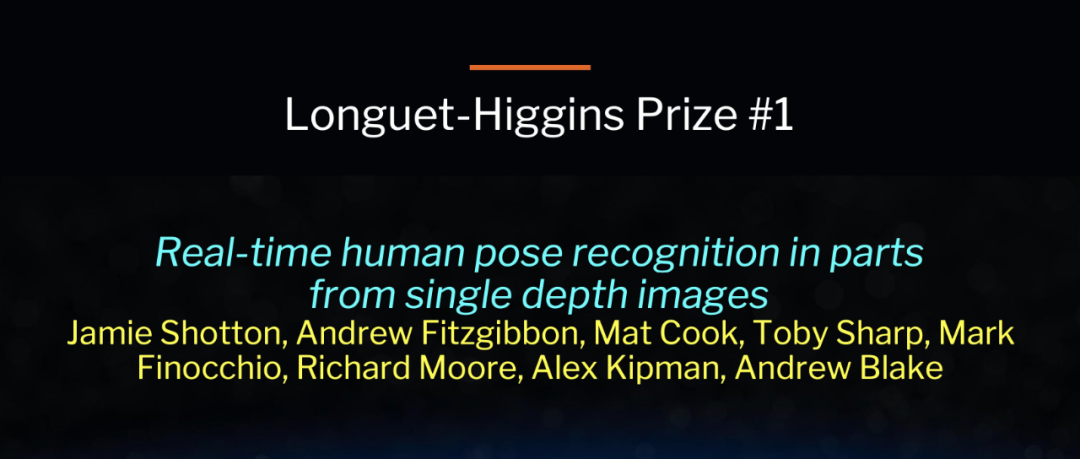

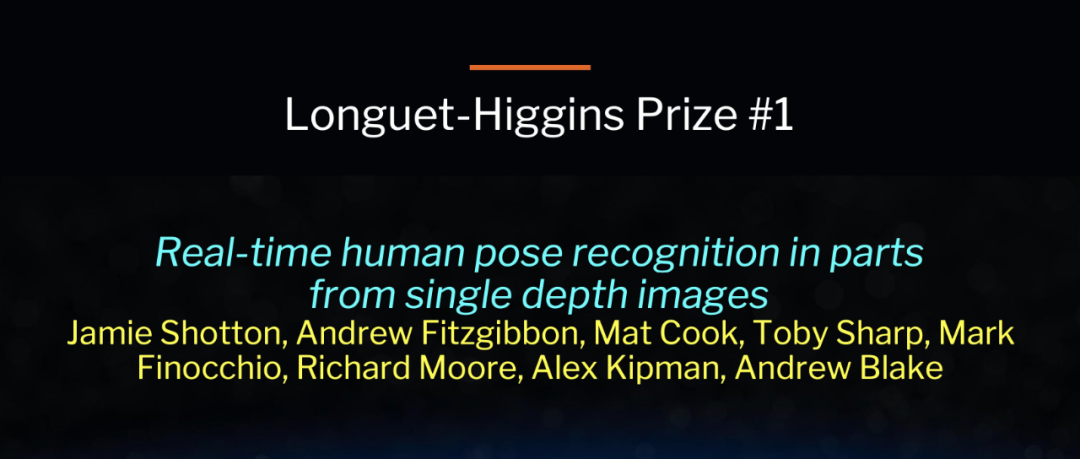

摘要:视频和语言学习的规范方法(例如,视频问答)要求神经模型从视觉模型中离线提取的密集视频特征和语言模型中的文本特征中学习。通常,这些特征提取器是独立训练的,以用于与目标域不同的任务,但这些固定特征对于下游任务来说不是最佳的。此外,由于密集视频特征的计算量很大,通常很难(或不可行)将特征提取器直接插入现有方法中以方便微调。为了解决这个难题,该研究提出了一个通用框架 CLIPBERT,它通过采用稀疏采样来实现视频和语言任务的端到端学习,而且在每个训练步骤中只需要使用一个或几个稀疏采样的视频短片。在 6 个数据集上进行的文本 - 视频检索和视频问答的实验表明,CLIPBERT 优于(或与之媲美)利用全长视频(full-length videos)的现有方法,这表明仅使用几个稀疏采样的剪辑即可进行端到端学习通常比使用从全长视频中密集提取的离线特征更准确,证明了众所周知的「少即是多」原则。数据集中的视频来自不同的域和长度,从 3 秒的通用域 GIF 视频到 180 秒的 YouTube 人类活动视频,这显示了该方法的泛化能力。此外,该研究还提供了全面的消融研究和彻底的分析,以剖析导致这种成功的因素。论文 2:《Binary TTC: A Temporal Geofence for Autonomous Navigation》摘要:Time-to-contact (TTC) 是物体与观测者水平碰撞的时间,是路径规划的有力工具:拥有比场景中物体的深度、速度和加速度更丰富的信息。TTC 有几个优点,其中一个优点是只需要一个单目、未经校准的摄像机。然而,回归每个像素的 TTC 并不简单,现有的大多数方法对场景的假设都过于简化。该研究通过一系列简单的二元分类(binary classifications)来估计 TTC 以解决这个问题,并以低延迟预测观测者是否会在特定时间内与障碍物发生碰撞,这通常比精确每个像素的 TTC 更为关键。对于这种情况,该研究的方法在 6.4 毫秒内提供了一个临时地理围栏(temporal geofence),比现有方法快 25 倍多。在计算预算允许的条件下,该方法也可以用任意精细量化(包括连续值)估计每像素(per-pixel)的 TTC。据了解,该方法是第一个以足够高的帧率提供 TTC 信息(二进制或粗量化)以供实际使用。论文 3:《Real-Time High-Resolution Background Matting》摘要:该论文提出了一种实时、高分辨率的背景替换技术,该技术可以在 GPU 上以 30fps 速度运行 4K 分辨率和以 60fps 的速度运行高清分辨率。该技术是基于背景抠图(background matting),其中一个额外的背景帧被捕获,并用于通知 alpha 蒙版和前景层。该研究的主要挑战是计算一个高质量的 alpha 蒙版,在实时处理高分辨率图像的同时保留头发的细节。为了实现这个目标,该研究使用了两个神经网络;基础网络计算低分辨率结果,该结果由第二个网络在选择性 patch 上以高分辨率运行。此外,还介绍了两个大规模的视频和图像抠图数据集:VideoMatte240K 和 PhotoMatte13K/85。与 SOTA 背景抠图技术相比,该研究产生了更高质量的结果相比,同时显著提高了运行速率和分辨率。除了论文奖之外,大会还颁布了 PAMITC 奖,其中包括三个重要奖项,即往年设立的 Longuet-Higgins 奖、青年研究者奖,以及在 CVPR 2020 设立、今年开始颁发的 Thomas S. Huang 纪念奖。Longuet-Higgins 奖是 IEEE 计算机协会模式分析与机器智能(PAMI)技术委员会在每年的 CVPR 颁发的「计算机视觉基础贡献奖」,表彰十年前对计算机视觉研究产生了重大影响的 CVPR 论文。该奖项以理论化学家和认知科学家 H. Christopher Longuet-Higgins 命名。今年获得 Longuet-Higgins 奖的论文有两篇,分别是微软研究者的《Real-Time Human Pose Recognition in Parts from Single Depth Images》和石溪大学研究者的《Baby Talk: Understanding and Generating Simple Image Descriptions》。论文 1:《Real-Time Human Pose Recognition in Parts from Single Depth Images》发表于 2011 年,作者来自于微软剑桥研究院,目前被引用次数为 4110。论文主要介绍了基于单张深度图像的实时人体姿态识别。

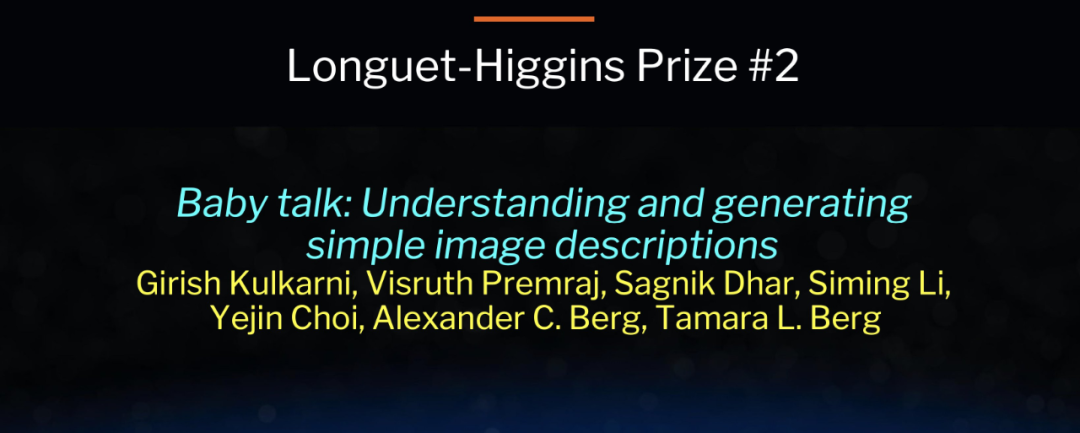

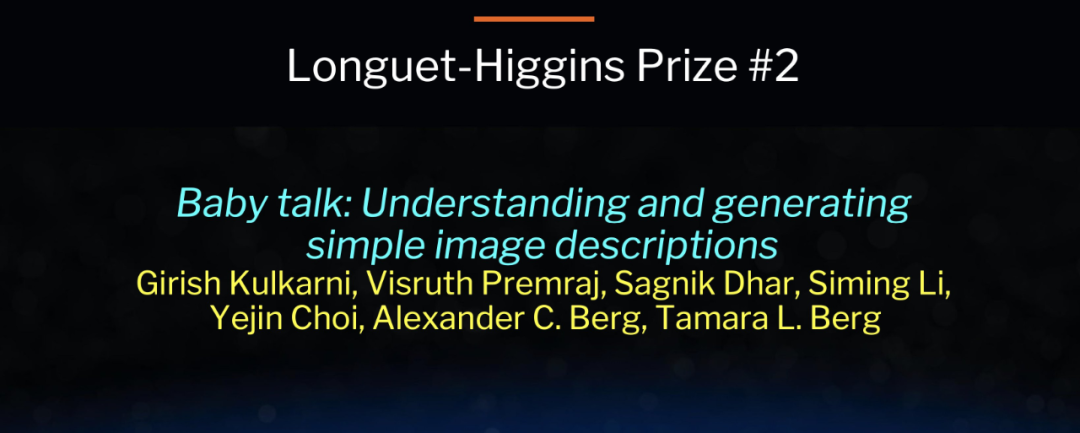

论文地址:https://www.microsoft.com/en-us/research/wp-content/uploads/2016/02/BodyPartRecognition.pdf论文 2:《Baby Talk: Understanding and Generating Simple Image Descriptions》也发表于 2011 年,研究者来自于石溪大学,目前被引用次数为 1159。论文主要提出了一个从图像自动生成自然语言描述的系统。

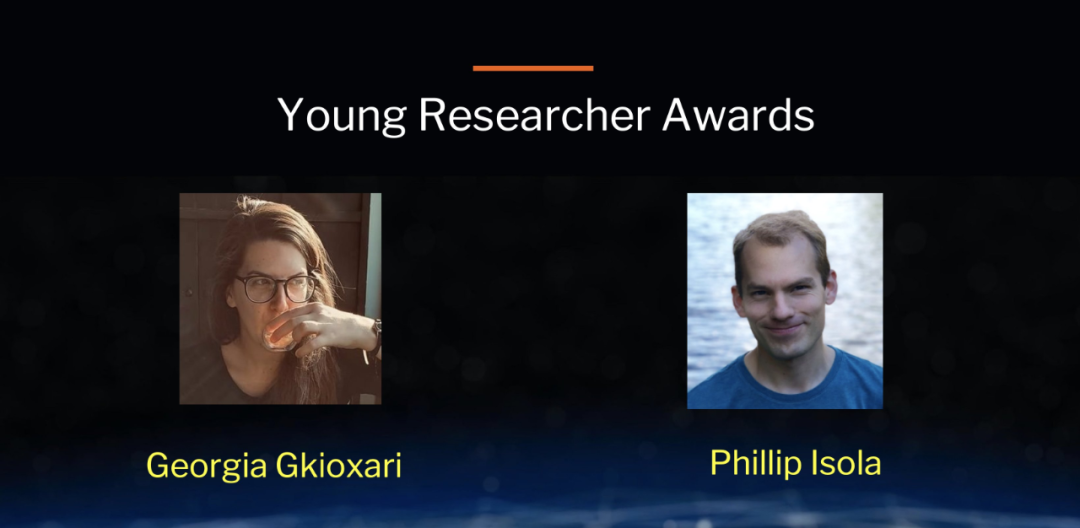

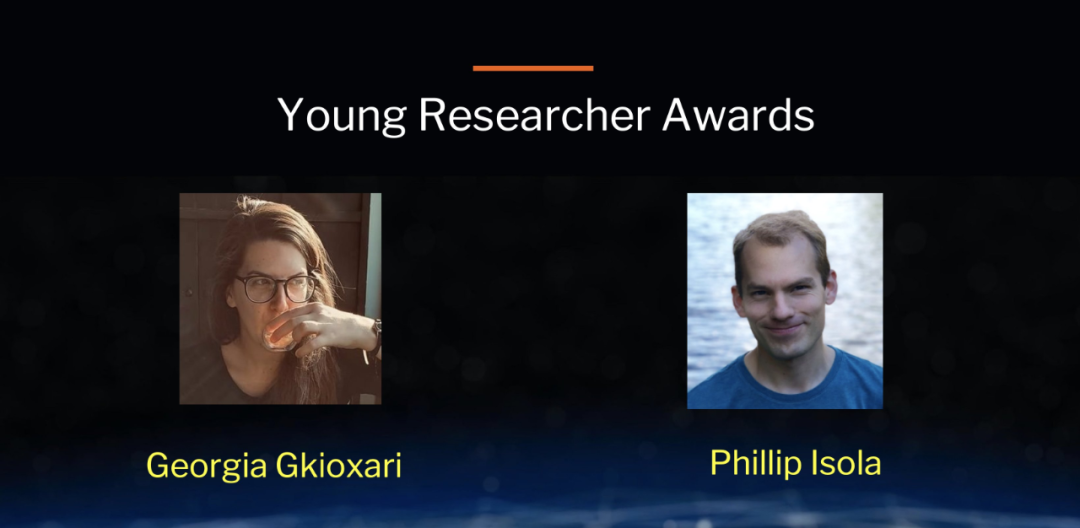

论文地址:https://ieeexplore.ieee.org/document/5995466青年研究者奖(Young Researcher Awards)旨在表彰年轻的科学家,鼓励ta们继续做出开创性的工作。评选标准是获奖者获得博士学位的年限少于 7 年。今年获得该奖项的研究者分别是 FAIR 的 Georgia Gkioxari 和 MIT 的 Phillip Isola。

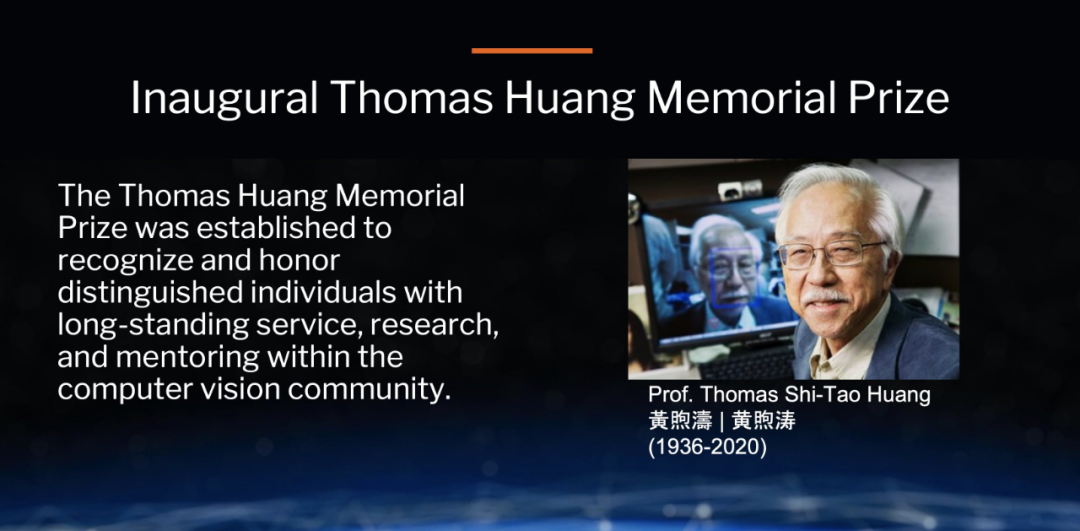

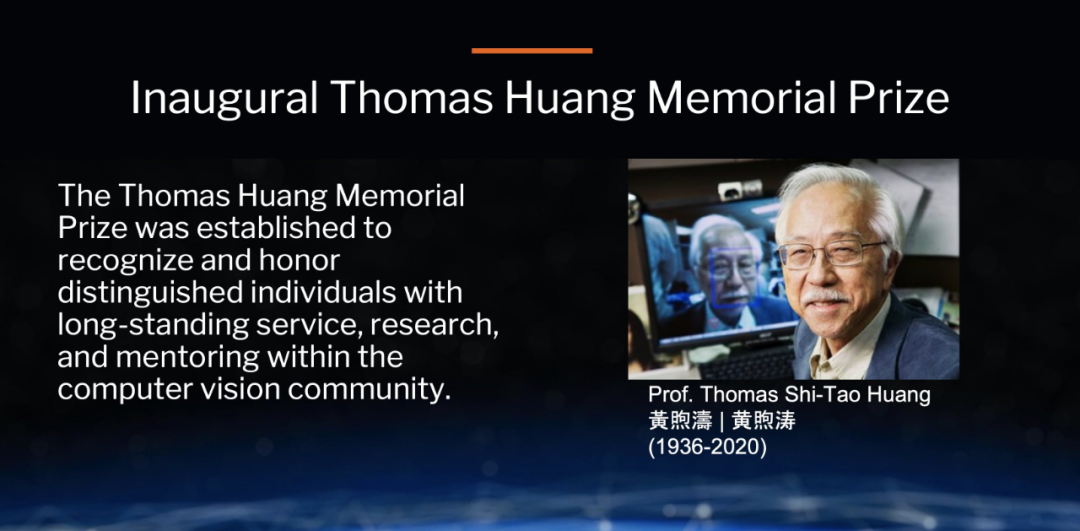

Georgia Gkioxari 现为 FAIR 的研究科学家。2010 年,她取得了雅典国家技术大学的学士学位。2016 年,她取得了加州大学伯克利分校的博士学位,导师为 Jitendra Malik。2016 年至今,她进入 FAIR 担任博士后研究员,并从 2018 年起担任 FAIR 的研究科学家。Georgia Gkioxari 的主要研究领域是计算机视觉,还是 PyTorch 3D 的开发者之一以及 Mask R-CNN 的作者之一。个人主页:https://gkioxari.github.io/Phillip Isolas 是 MIT 电气工程与计算机科学系的助理教授,主要研究方向为计算机视觉、机器学习与 AI。2008 年,他取得了耶鲁大学的计算机科学学士学位,2015 年获得了 MIT 的认知科学博士学位,2015-2017 年成为 UC 伯克利的博士后研究员,2017-2018 年担任 OpenAI 的访问研究科学家,2018 年至今任职 MIT 助理教授。他在 Google Scholar 上的论文被引量达到 28056,h 指数为 33。个人主页:http://web.mit.edu/phillipi/为了纪念去年四月底去世的 Thomas S. Huang(黄煦涛)教授,PAMITC 奖励委员会去年批准设立 Thomas S. Huang 纪念奖,以表彰在 CV 研究、教育和服务方面被公认为楷模的研究人员。该奖项从 2021 年开始颁发。获奖者需要拿到博士学位至少 7 年,最好处于职业发展中期(不超过 25 年)。

黄教授是中国工程院外籍院士,中国科学院外籍院士,美国国家工程院院士,美籍华裔信息学家,美国伊利诺依大学(香槟分校)Beckman 研究院图像实验室主任,于 2020 年 4 月 25 日夜(美国东部时间)在美国印第安纳州逝世,享年 84 岁。黄煦涛教授在图像处理、模式识别、计算机视觉等方面有不少原创性的研究成果,开拓了新的研究领域。此奖项的设立正是为了缅怀黄教授对计算机视觉领域的突出贡献。

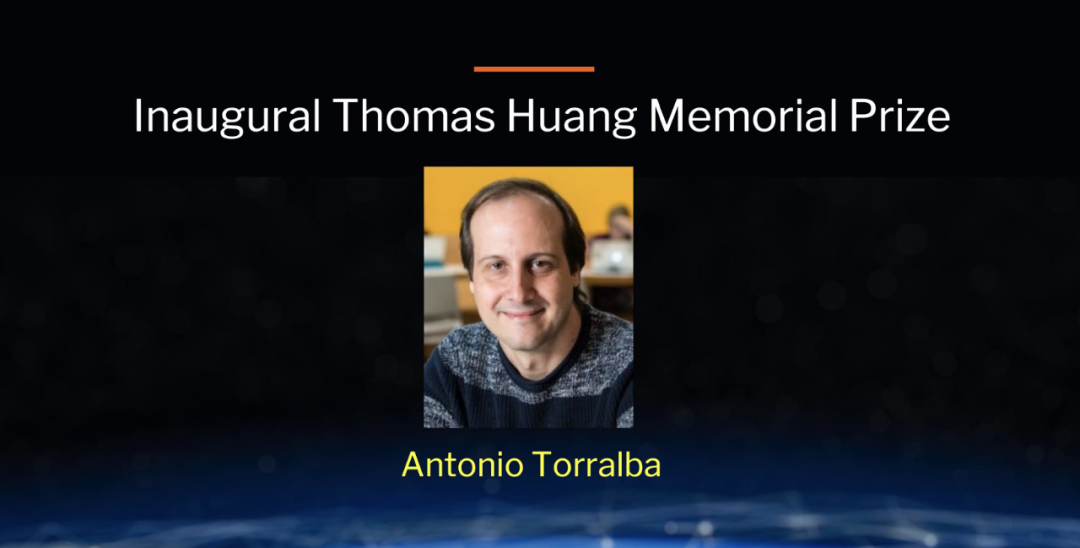

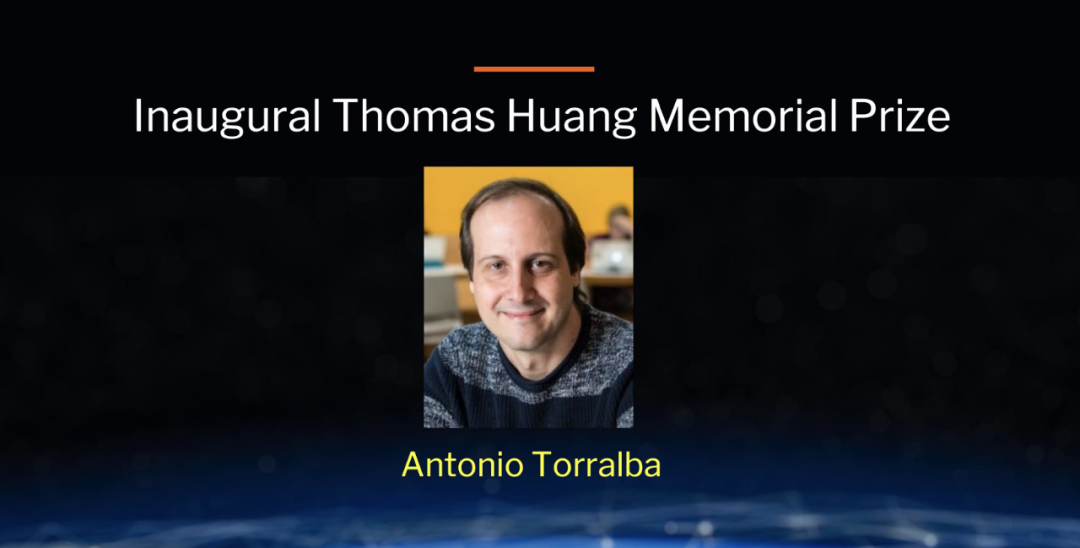

首届 Thomas S. Huang 纪念奖的获奖者是 MIT 电气工程与计算机科学教授 Antonio Torralba。他的研究领域涉及计算机视觉、机器学习和人类视觉感知,并热衷于构建像人类一样感知世界的系统。此外,他还对神经网络、常识推理、计算摄影、构建图像数据库以及视觉艺术与计算之间的交互等其他领域颇有兴趣。目前,Antonio Torralba 在 Google Schlor 上的论文总引用量高达 78736,h 指数为 111。

个人主页:https://groups.csail.mit.edu/vision/torralbalab/注:本文中的相关图示来自推特用户 @CSProfKGD 和 @JaredHeinly。http://cvpr2021.thecvf.com/node/329http://cvpr2021.thecvf.com/node/330