机器学习小抄,轻松搞定理解机器学习!

机器学习小抄表翻译自Chris Albon博士。Chris 是一位很有热情的机器学习从业者、数据科学家,也是初创公司NewKnowldgeAI的联合创始人。

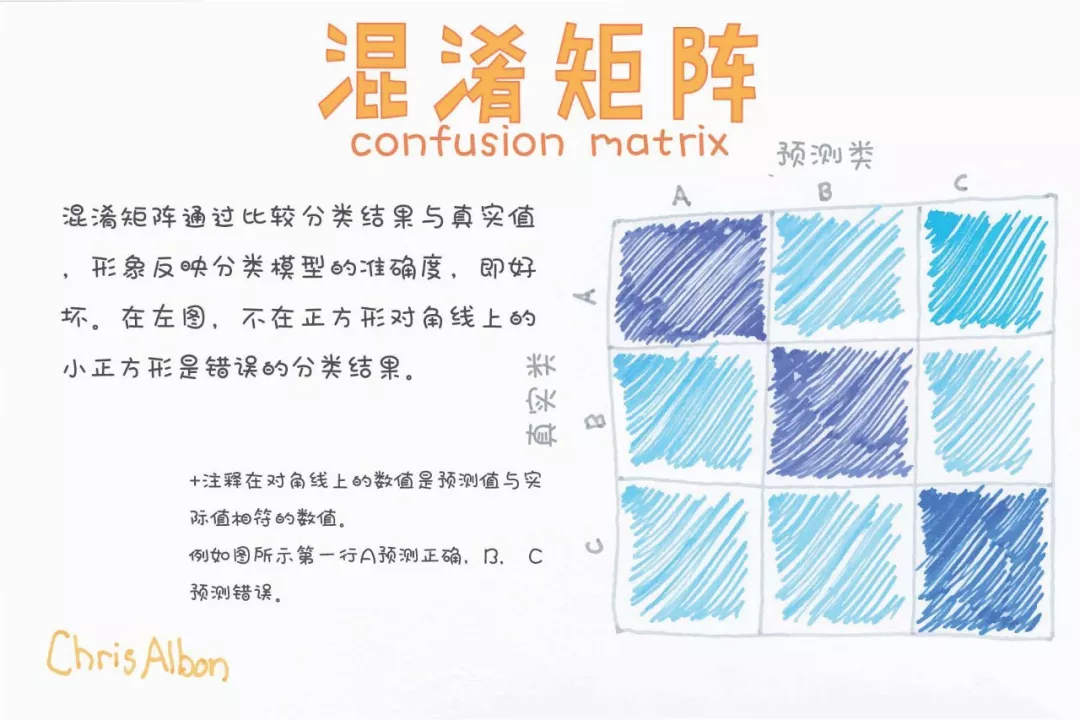

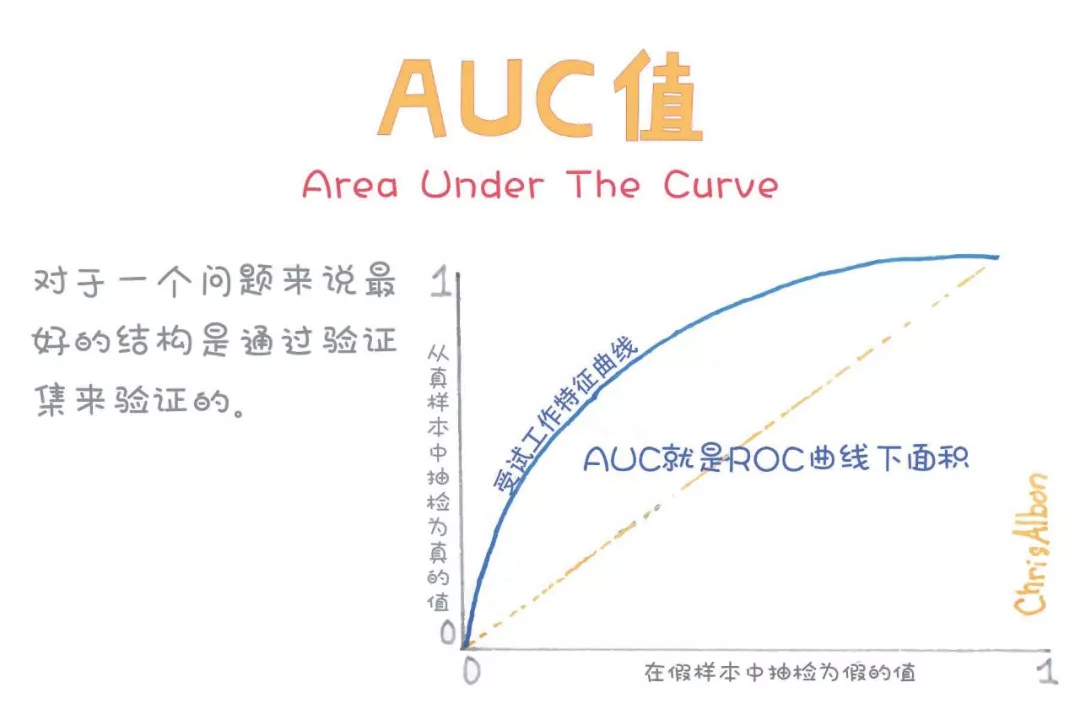

小抄共284页,通俗易懂,如图背托福单词的随身小抄一样方便!简直分分钟搞定机器学习各种记不住的概念啊!

部分内容如图:

最后,让我们感谢所有参与这次翻译校对设计和管理的志愿者们,是你们不计回报的付出才让这份小抄表的中文版最终面世:

翻译:范玥灿Edward、李越、魏晓聪、笪洁琼、文静、一针、Echo Lai、王富贵、王奕磊、蔡雨辰、冯媛、刘冠男、张礼俊、潘一伟、李聪之、远方

校对:程亚雄、金诗韵、田苗苗、Fox 、吕征达、赵承业、夕映、张露、邹可 、Figo、Jamie Sun、马新、李浩铭、徐子尧、谑、伊可心、赵江、kevin、koala

设计:王富贵、王得宇

统筹:王富贵、魏子敏、韩蕊

本站将全部284张图片整合成一个pdf,由于公众号不方便下载,故放在百度网盘中,下载方式:

请关注公众号,回复“小抄”可以获取下载地址。

同时,我们建立了人工智能学习交流群,方便大家学习讨论!欢迎对AI感兴趣的朋友进群交流!微商和广告勿扰!谢谢合作!

也可以加我微信1286407489,邀请你进群交流!

评论