3D卷积GAN飞起!微软“可缩放”新框架只需2D数据即可生成逼真3D...

新智元报道

来源:VB

编辑:元子

【新智元导读】Microsoft Research近日发表论文介绍了一种通过2D数据生成3D模型的新框架,其使用3D卷积GAN,利用2D图像提供的物体表面之间的曝光差异成功检测出凹形物体的内部结构,从而准确捕捉物体的空间结构,在识别物体形状方面优于当前模型。「新智元急聘主笔、编辑、运营经理、客户经理,添加HR微信(Dr-wly)或扫描文末二维码了解详情。」

将2D图像转换成3D图像是一件非常困难的事情,包括Facebook,Nvidia的AI研究实验室,以及Threedy.ai之类的初创公司都在不断的在此领域进行探索。

最在一份新的预印本论文中,来自Microsoft Research的团队详细介绍了一个框架。研究人员称,该框架是首个针对2D数据的3D模型的“可缩放”训练技术。

据悉,仅使用2D图像进行训练,该框架可以始终学习比现有模型更好的形状,这对于缺乏从头开始创建3D形状的视频游戏开发人员,电子商务企业和动画工作室可能是一个福音。

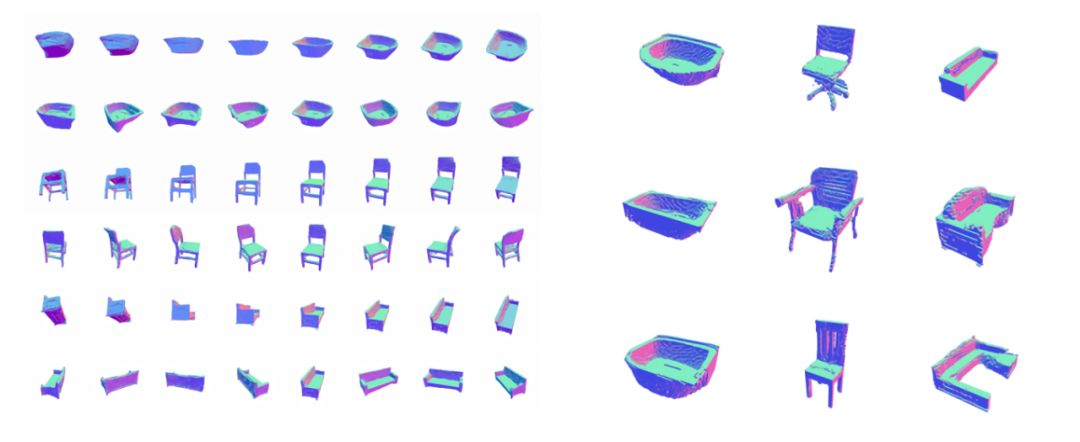

与以前的工作相反,研究人员试图利用功能齐全的工业渲染器,例如显示数据生成图像的软件。为此,他们训练了3D形状的生成模型,以便生成与2D数据集的分布相匹配的图像。

生成器模型采用随机输入向量(代表数据集特征的值)并生成3D对象的连续体素表示(3D空间中网格上的值)。然后,它将体素馈送到不可微分的渲染过程,该过程将阈值设置为离散值,然后再使用现成的渲染器(在OpenGL之上构建的Pyrender)进行渲染。

一种新颖的代理神经渲染器(proxy neural renderer)直接渲染由3D生成模型生成的连续体素网格。正如研究人员所解释的那样,在给定3D网格输入的情况下,它经过训练可以匹配现成渲染器的渲染输出。

在实验中,该团队为生成器采用了3D卷积GAN架构。从3D模型生成的一系列合成数据集和一个现实生活的数据集,他们合成了来自不同对象类别的图像,并在整个训练过程中从不同的角度对其进行了渲染。

研究人员说,他们的方法利用了图像提供的照明和阴影提示,使其能够从每个训练样本中提取更多有意义的信息,并在这些设置下产生更好的结果。

此外,在对自然图像的数据集进行训练后,它可以生成逼真的样本。该论文的合著者写道:“我们利用表面之间的曝光差异成功地检测出凹形物体的内部结构,从而使其能够准确地捕获凹面和中空空间。”

参考链接:

https://venturebeat.com/2020/03/05/microsofts-ai-generates-3d-objects-from-2d-images/