基于毫米波雷达和机器视觉的夜间前方车辆检测

点击下方卡片,关注“新机器视觉”公众号

视觉/图像重磅干货,第一时间送达

01

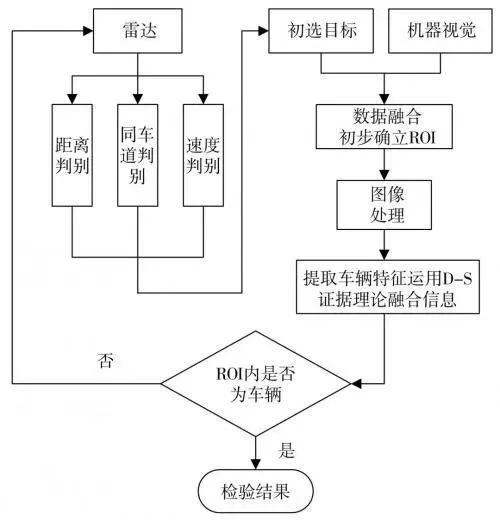

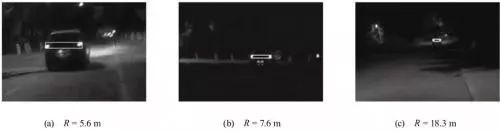

夜间车辆检测算法实现

图 1 夜间前方车辆检测方法流程图

02

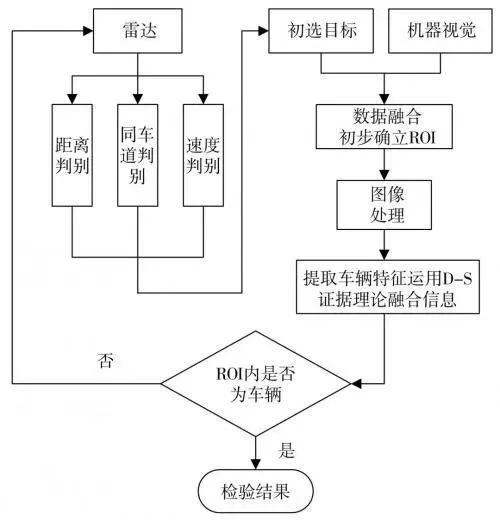

假设产生(HG)

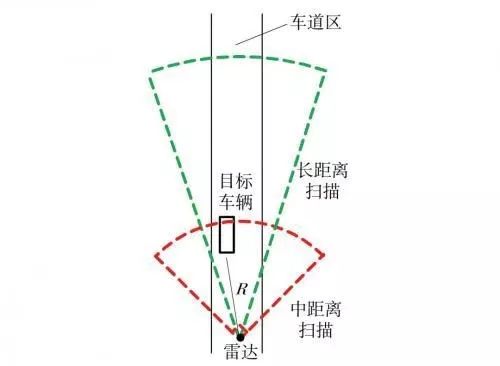

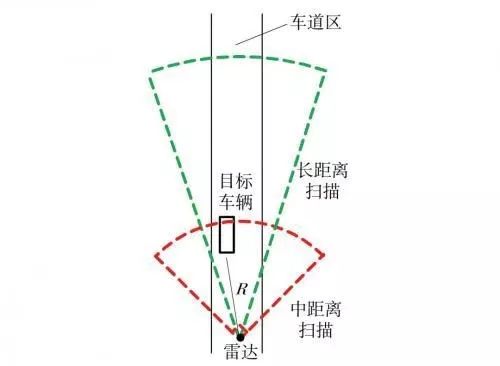

2.1 雷达数据处理及初选目标的确定

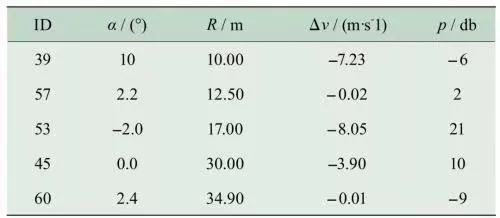

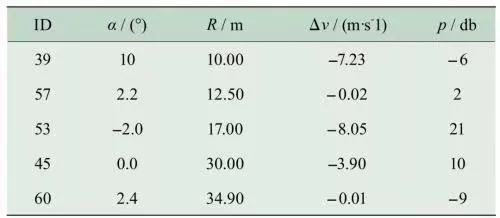

表 1 初选有效目标信号

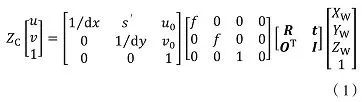

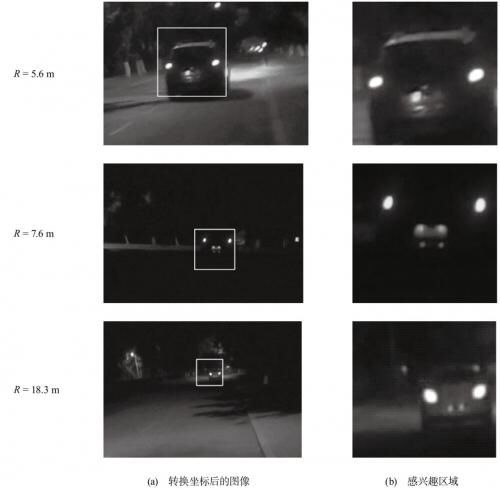

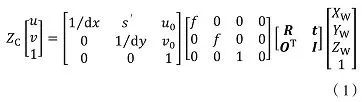

2.2 雷达数据和机器视觉的融合

03

假设验证(HV)

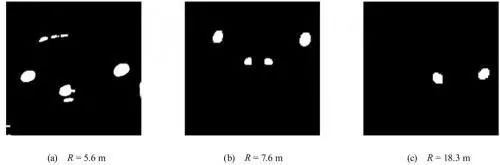

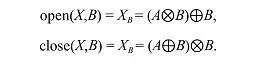

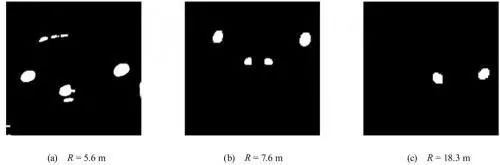

3.1 图像分割

04

试验结果

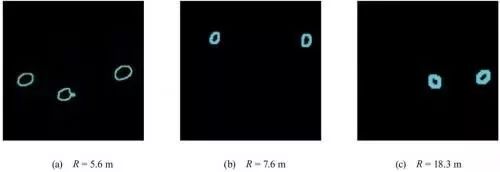

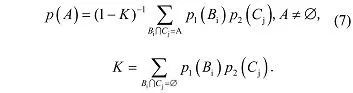

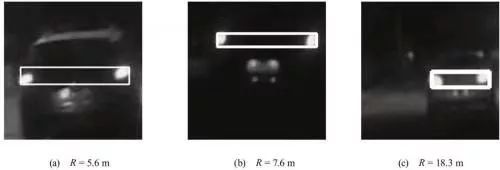

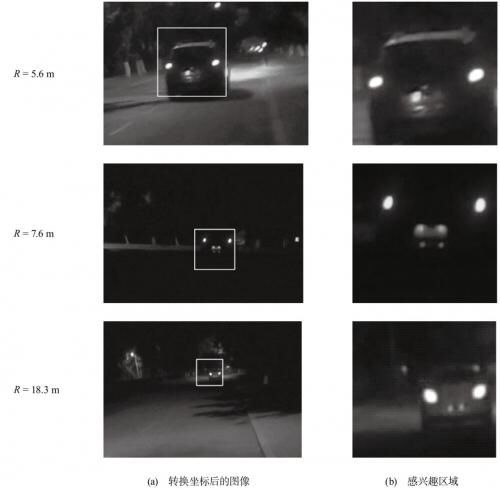

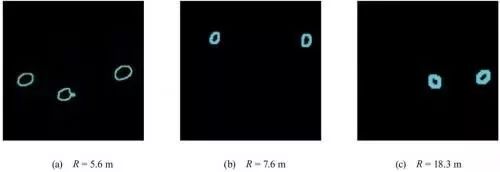

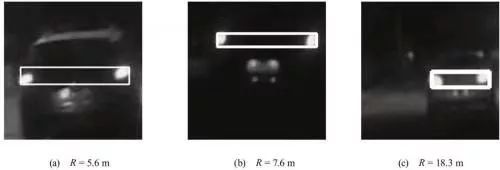

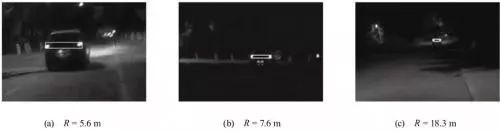

图 9 夜间前方车辆识别

表 2 车辆检测的实验结果

05

结论

本文仅做学术分享,如有侵权,请联系删文。

评论

下载APP

下载APP点击下方卡片,关注“新机器视觉”公众号

视觉/图像重磅干货,第一时间送达

01

夜间车辆检测算法实现

图 1 夜间前方车辆检测方法流程图

02

假设产生(HG)

2.1 雷达数据处理及初选目标的确定

表 1 初选有效目标信号

2.2 雷达数据和机器视觉的融合

03

假设验证(HV)

3.1 图像分割

04

试验结果

图 9 夜间前方车辆识别

表 2 车辆检测的实验结果

05

结论

本文仅做学术分享,如有侵权,请联系删文。