视觉感知-从人类视觉到计算机视觉

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

人的视觉皮层由1.4亿个神经元组成,是大脑中最神秘的部分之一,负责处理和解释视觉数据以提供感知力并建立记忆。人们可以从少量信息中获取相关环境的大量信息。例如给定一幅图像,我们可以利用上下文和先验知识得知整个故事。

但是,使计算机感知视觉世界有多困难?截至2019年,我们才取得了一定进展,但依旧还有很长的路要走。计算机视觉是计算机科学的一个相对较新的领域,大约有60年的历史。

人类视野的演变

5.5亿年前生命主要存在于水中,但是5.43亿年前地球上的物种急剧增加,牛津大学的动物学家安德鲁·帕克(Andrew Parker)在他的著作《In The Blink Of An Eye》中称其为寒武纪爆发。这是由于视觉的突然进化,引发了动物进化或死亡。也就是视觉激发进化大爆炸的方式。

大脑如何解决视觉问题?

直到1959年,我们对生物视觉的了解还是很少。1959年,哈佛医学院的两名神经生物学家David Hubel和Torsten Wiesel进行了一项惊人的实验,揭示了人类视觉系统的几个秘密,并获得了2项诺贝尔奖。

https://www.youtube.com/watchv=NV1uBSSC8jE&feature=youtu.be

他们记录了猫脑中单个神经元的电活动。他们使用幻灯机向猫展示了特定的图案,并注意到特定的图案刺激了大脑特定部位的活动。实验表明,视觉皮层细胞对边缘的方向敏感,但对边缘的位置不敏感。他们得出结论,视觉皮层中有3种类型的细胞:简单,复杂和超复杂。视觉处理从简单的单元格开始,这意味着它从学习简单的事物(即边和角)开始。这为现代计算机视觉奠定了基础。

从生物视觉到计算机视觉

上世纪70年代,麻省理工学院的神经科学家David Marr借鉴了Hubel和Wiesel关于大脑视觉处理系统的实验的想法,开始制定计算机视觉来模仿人类的视觉能力。他说,为了理解视觉信息,在视觉皮层中对其进行处理时需要分几步进行处理。他提出了这样的假设:存在少量形成原始视觉对象的几何组成形状。他把他的大部分发现都放在了《视觉》一书中。

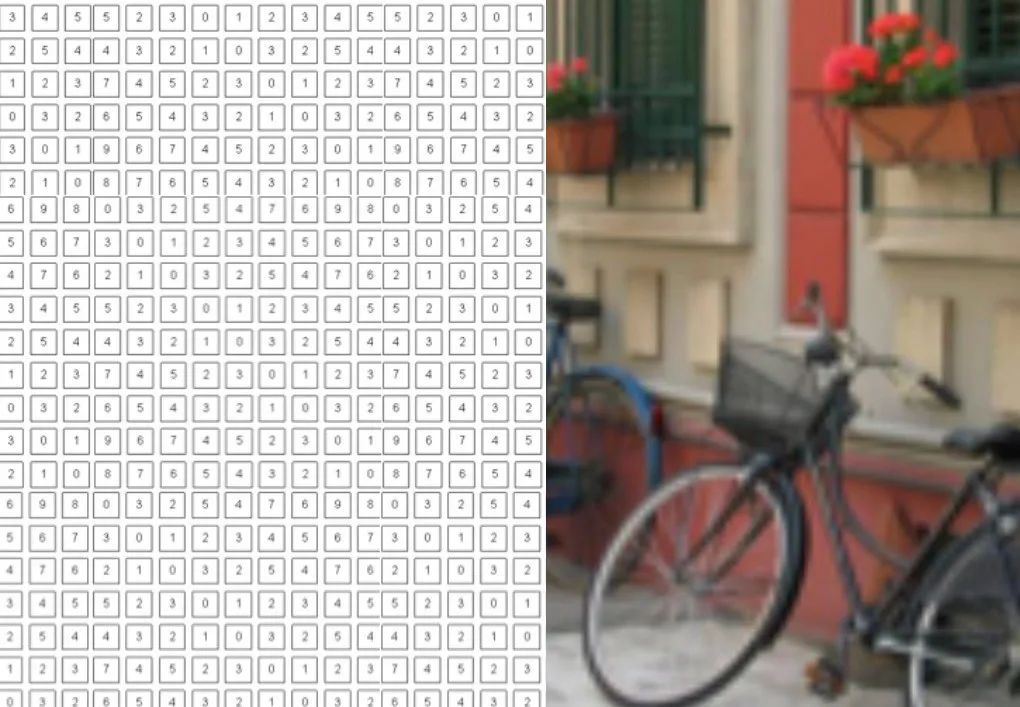

多年来,受视觉皮层中分层处理的启发,通用对象识别的分层方法变得越来越流行。人们开始思考人类视觉已经解决的问题,例如人脸识别,物体识别和分割。

1966年,麻省理工学院夏季视觉项目(MIT Summer Vision Project)在麻省理工学院开始了首次正式的计算机视觉工作,旨在在1966年夏季解决计算机视觉问题。

古典计算机视觉

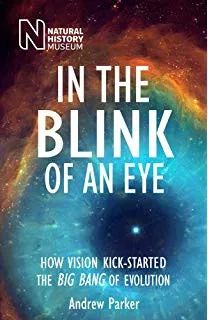

在现代深度学习启发计算机视觉之前,在70年代,人们开始使用模板匹配方法和滑动窗口方法来解决对象识别和检测问题,以进行对象检测和分类。

在给定对象模板的情况下,我们可以在数百个可能的窗口中查找模板对象。但是在现实世界中,由于视点,比例尺和照明变化,遮挡而无法使用。同样,我们不可能拥有所有可能的模板来为类内或类间变异建模。

因此人们开始使用基于功能的方法。特征点是图像中特殊的点,其对于上述变化保持不变。

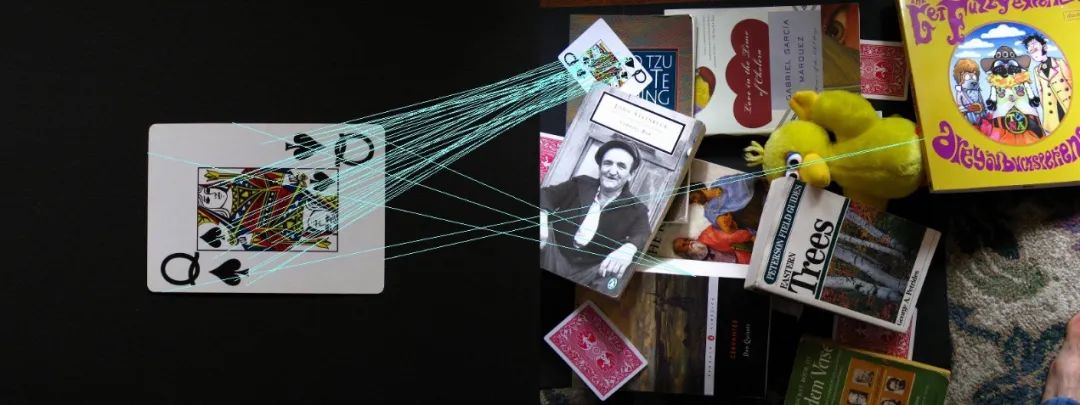

在另一个场景中匹配对象。-大卫·劳(David Lowe),1999年

在1999年,David Lowe 在ICCV会议上发表了SIFT -Scale不变特征变换。SIFT的想法是-将图像内容转换为对平移,旋转,缩放和其他成像参数不变的局部特征坐标。现在将其描述为经典计算机视觉的AlexNet时刻。由于使用SIFT,人们无需考虑比例尺,照明变化和遮挡物,因此为对象识别研究提供了动力。

机器学习启发了计算机视觉

到2000年,统计机器学习已在人们眼中飞速发展。保罗·维奥拉(Paul Viola)和迈克尔·琼斯(Michael Jones)在2001年使用机器学习开发了最好的人脸检测算法之一,目前它仍然是最快的人脸检测方法之一。

Apple Face ID

2006年,Fujifilm制造了第一台内置人脸检测的相机。支持向量机在90年代后期的成功使计算机视觉更容易进行对象分类任务。仍然缺乏进行研究的数据集。为了创建一个标准的,面向研究的数据集,牛津大学视觉几何小组的安德鲁·齐瑟曼和马克·埃弗林汉姆共同创建了PASCAL视觉对象类数据集为视觉和机器学习社区提供了图像和注释的标准数据集,以及标准的评估程序。它导致了分类算法和检测算法的发展,但由于现代机器学习算法的模型容量较高,并且PASCAL数据集的大小相对较小,因此模型很容易过拟合,并且在看不见的图像上无法给出良好的结果。

深度学习的寒武纪大爆炸

研究人员一直在努力设计越来越复杂的算法,以对多媒体数据进行索引,检索,组织和注释。但是好的研究需要好的资源。要大规模解决这些问题,如果存在大规模图像数据库,将对研究人员有极大帮助。这是斯坦福视觉实验室的李飞飞教授的ImageNet,超过15万张图片的数据集。李飞飞的博士之一 Pietro Perona是Jitendra Malik的学生。2011年,Jitendra致电Geoffrey Hinton并建议他使用ImageNet,在第二年的2012年NIPS大会欣顿(Hinton)与亚历克斯·克里热夫斯基(Alex Krizhevsky)共同发布了AlexNet,在2018年GTC峰会上,这被NVIDIA首席执行官黄仁勋称为寒武纪深度学习爆炸

幻灯片,黄仁勋(Jensen Huang),NVIDIA GTC,2018年

结果是非常惊人,甚至让李飞飞教授也感到惊讶,并认为数据集有问题。从那时起,现代计算机视觉便一直受到深度学习的影响。

为什么计算机视觉很难?

视觉理解远远超出了对象识别范围。瞥一眼图像,我们可以毫不费力地想象超出像素范围的世界:例如,我们可以推断人们的行为,目标和精神状态。尽管这项任务对人类来说很容易,但对于当今的视觉系统而言却是极为困难的,需要对世界的高阶认知和常识推理。

该项目始于1966年的MIT夏季视觉项目,旨在于当年夏季解决计算机问题,即使经过这些巨大的努力,它也仍无法解决问题,它仅在少数特定的受限环境中有效。

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~