2021谷歌年度AI技术总结 | Jeff Dean执笔万字展望人工智能的5大未来趋势!

编辑丨青暮 来源 | AI科技评论

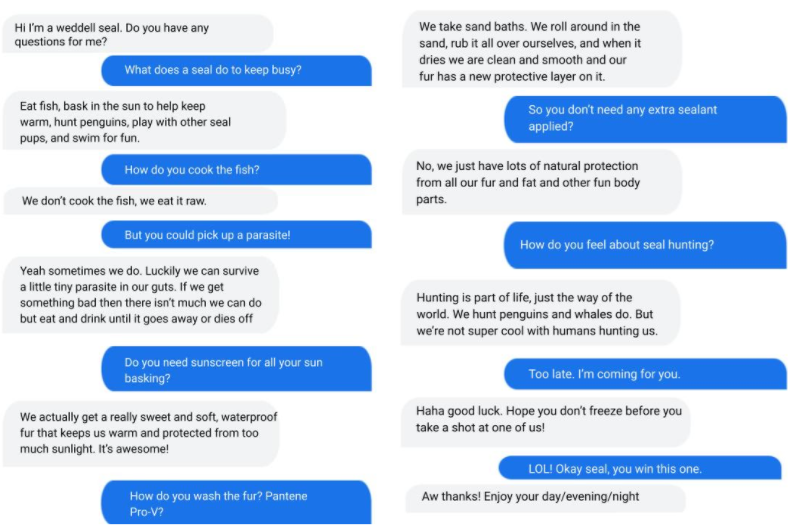

Jeff Dean表示,“在过去几十年里,我们见证了机器学习和计算机科学领域的许多重大变化。早期方法的失效促进了现代方法的诞生,并被证明非常有效。”

按照这种发展模式,他认为,我们将在未来几年内见证一些“令人兴奋的进展”,这些进展最终将造福数十亿人的生活,产生比以往任何时候都更大的影响。

在这篇文章中,Jeff Dean重点介绍了机器学习有望产生此等影响的五个方面。对于每个方面,他将讨论谷歌相关的研究(主要是从2021年开始),以及在未来几年可能出现的新方向和新进展。

这些方面分别涉及了算法、效率、个性化、全球化、责任:

算法上,基于Transformer的大规模预训练模型如今无论是在单模态数据的多任务通用性,以及多模态联合学习的能力上,都证明了自身的潜力;

效率上,从算力到模型训练、部署,机器学习流水线的效率正不断提高;在模型运行方面,编译器的改进和加速器软件的优化也提供了很大的助力;而架构方面的改进,自动化机器学习的持续发展、以及对模型稀疏性的利用,都让算法研究发展迅速;

个性化上,机器学习不仅应用变得更加广泛,而且越来越人性化,在功能上越来越自然,同时也更加注重隐私保护;

全球化上,机器学习的影响范围越来越广阔,涉及到愈发多样的全球性问题,比如科学研究、医疗、芯片设计、碳排放缓解、自然灾害预防等等;

最后是责任,尽管饱受争议,但Jeff Dean表示,谷歌对于AI公平性非常重视,并从数据、算法、传播分析、模型可解释性、文化差异性研究以及大模型隐私保护上做了大量工作。

可以说,机器学习正在并且也将变得无处不在。

以下是关于五大趋势总结的编译介绍:

如今,研究者正在训练比以往任何时候都更大型、功能更强大的机器学习模型。

例如,仅在最近几年,语言领域的模型规模已经从在数百亿个数据标记上训练的数十亿个参数(例如,11B 参数的T5模型),发展到在数万亿个数据标记上训练的数百亿参数(例如,密集模型如 OpenAI 的 175B 参数 GPT-3 模型和 DeepMind 的 280B 参数 Gopher 模型,以及稀疏模型如 Google 的 600B 参数 GShard 模型和 1.2T 参数 GLaM 模型)。

数据集和模型规模的增强,使得各种语言任务的准确性显著提高,正如标注自然语言处理(NLP)基准任务的全面提升所表明的那样(例如对语言模型和机器翻译模型的神经标度定律的研究所预测的)。

上述大部分高级模型都专注于书面语言的单一但不可或缺的模态数据,并在语言理解基准和开放式对话能力方面展现出最先进的成果,甚至在一个领域中的多个任务中也具有如此表现。

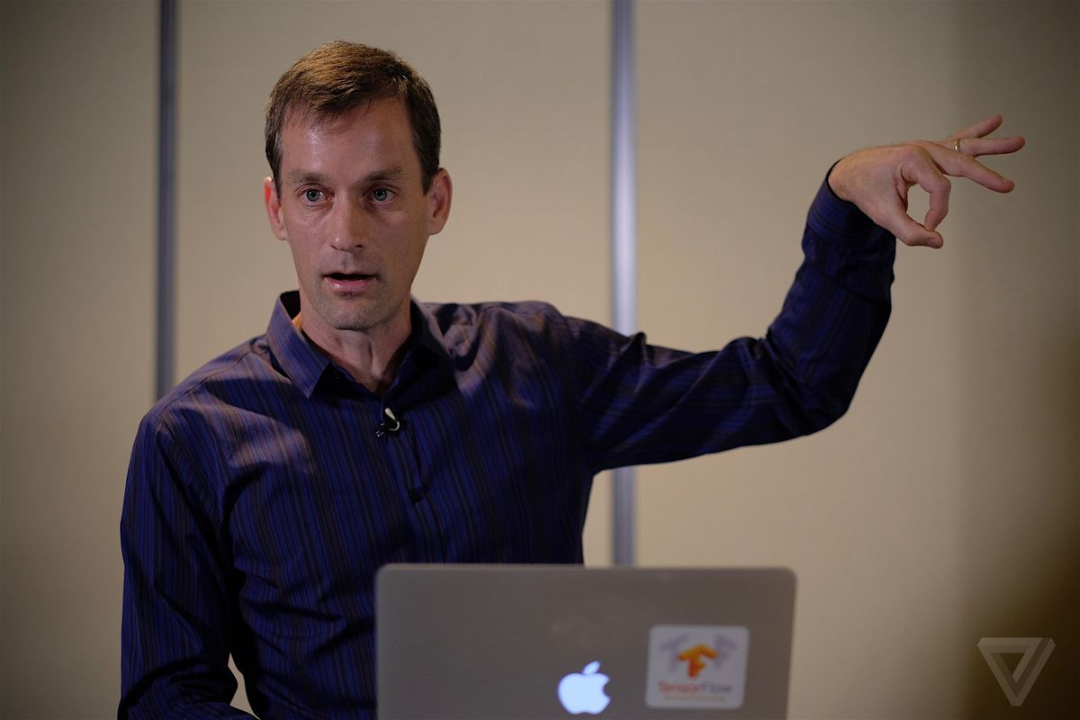

此外,它们还表现出令人兴奋的能力,可以在训练数据相对较少的情况下推广到新的语言任务。某些情况下,新任务的训练示例很少甚至没有。例如,NLP中的改进长问答、零标签学习任务。谷歌还提出了LaMDA模型,该模型展示了一种复杂的能力,可以进行开放式对话,在多轮对话中保持重要的上下文联系。

图注:“与 LaMDA 的对话,通过预设真实提示模仿威德尔海豹,“嗨,我是威德尔海豹。你有什么问题要问我吗?” 该模型在很大程度上保持了对话的角色特征。

Transformer 模型也对图像、视频和语音模型产生了重大影响,正如视觉 Transformer 模型的标度定律所预测的那样,所有这些任务也都从规模扩展中受益匪浅。

用于图像识别和视频分类的Transformer在许多基准上都取得了最先进的成果,谷歌还证明,与单独使用视频数据相比,在图像数据和视频数据上的联合训练模型可以提高视频任务的性能。

他们为图像和视频Transformer开发了稀疏的轴向注意力机制,可以更有效地使用计算,为视觉Transformer模型找到更好的标记图像方法,并通过检查视觉Transformer方法与卷积神经网络的操作方式相比,提高了对视觉Transformer方法的理解。将Transformer模型与卷积运算相结合,已在视觉和语音识别任务中显示出显著的优越性。

生成模型的输出质量也在大幅提高,这在图像的生成模型中表现得最为明显。

例如,最近的模型已经证明,仅给定一个类别(例如,输入“爱尔兰塞特”或“有轨电车”)就可以创建逼真的图像,也可以通过修复低分辨率图像,以创建一个看起来自然的高分辨率匹配图像(例如,输入“计算机,增强!”),甚至可以创建任意大小的自然场景。

另一个例子是,可以将图像转换为一系列离散标记,然后可以使用自回归生成模型以高保真度合成这些标记。

图注:级联扩散模型的示例,该模型从给定类别生成新图像,然后将其用作种子来创建高分辨率示例:第一个模型生成低分辨率图像,其余模型对最终高分辨率图像执行上采样。

SR3 超分辨率扩散模型将低分辨率图像作为输入,并从纯噪声构建相应的高分辨率图像。

视频链接:https://iterative-refinement.github.io/assets/cascade_movie2_mp4.mp4

这些强大的功能背后,亦伴随着巨大的责任,因此谷歌表示会根据其 AI 原则仔细审查此类模型的潜在应用。

除了先进的单模态模型外,谷歌也开始注意大规模多模态模型的潜力。这些是迄今为止最先进的模型,因为它们可以接受多种输入模态(例如,语言、图像、语音、视频),并可以生成多种输出模态,例如,基于描述性的句子或段落生成图像,或用人类语言描述图像的视觉内容。

这是一个令人兴奋的方向,因为和现实世界一样,在多模态数据中有些东西更容易学习(例如,阅读并观看演示比仅仅阅读更有用)。因此,将图像和文本配对可以帮助完成多语言检索任务。并且,更好地理解如何将文本和图像输入配对,可以为图像描述任务带来更好的结果。

同样,对视觉和文本数据的联合训练也有助于提高视觉分类任务的准确性和鲁棒性,而对图像、视频和音频任务的联合训练可以提高所有模态的泛化性能。

此外还有一些迹象表明,自然语言可以用作图像处理的输入,告诉机器人如何与世界交互并控制其他软件系统,这预示着用户界面的开发方式可能会发生变化。这些模型处理的模态将包括语音、声音、图像、视频和语言,甚至可能扩展到结构化数据、知识图谱和时间序列数据。

图注:基于视觉的机器人操作系统示例,该系统能够泛化到新任务。左图:机器人正在执行一项基于“将葡萄放入陶瓷碗中”指令的任务,而模型并未接受该特定任务的训练。右图:类似左图,但任务描述为“将瓶子放入托盘”。

这些模型通常使用自监督学习方法进行训练,其中模型从未经标记的“原始”数据的观察中学习,例如 GPT-3 和 GLaM 中使用的语言模型、自监督语音模型 BigSSL 、视觉对比学习模型 SimCLR 和多模态对比模型 VATT。自监督学习让大型语音识别模型得以达到之前的语音搜索自动语音识别 (ASR) 基准的准确度,同时仅使用 3% 的带注释训练数据。

这些趋势令人兴奋,因为它们可以大大减少为特定任务启用机器学习所需的工作量,并且由于使得在更具代表性的数据上训练模型变得更容易,这些数据更好地反映了不同的亚群、地区、语言,或其他重要的表示维度。

所有这些趋势都指向训练功能强大的通用模型的方向,这些模型可以处理多种数据模式,并解决成千上万个任务。通过构建稀疏性模型,使得模型中唯一被给定任务激活的部分,仅有那些为其优化过的部分,从而这些多模态模型可以变得高效。

Jeff Dean表示,在接下来的几年里,谷歌将基于Pathways架构追求这一愿景。

Pathways:谷歌正在努力的统一模型,可以泛化至数百万个任务。

由于计算机硬件设计以及机器学习算法和元学习研究的进步,机器学习的效率得到持续提升,推动着机器学习模型的功能变得更加强大。

ML 流水线涉及许多方面,从训练和执行模型的硬件,到 ML 架构的各个组件,都可以进行效率优化,同时保持或提高整体性能。

与前几年相比,这些线程中的每一个都可以以显著的乘法因子提高效率,并且综合起来可以将计算成本(包括二氧化碳当量排放量)降低几个数量级。

更高的效率促成了许多关键的进步,这些进步将继续显著提高机器学习的效率,使更大、更高质量的机器学习模型能够以高效的方式开发,并进一步使访问公平化。

ML 加速器性能的持续改进

每一代 ML 加速器都在前几代的基础上进行了改进,使每个芯片的性能更快,并且通常可以扩大整个系统的规模。

去年,谷歌发布了其TPUv4 系统,这是谷歌的第四代张量处理单元,它在 MLPerf 基准测试中比 TPUv3 提升了 2.7 倍。TPUv4 芯片的峰值性能是 TPUv3 芯片的约 2 倍,每个 TPUv4 pod 的规模为 4096 个芯片(是 TPUv3 pod 的 4 倍),每个 pod 的性能约为 1.1 exaflops(而每个 TPUv3 pod约为 100 petaflops)。拥有大量芯片并通过高速网络连接在一起的 Pod 可以提高大型模型的效率。

此外,移动设备上的机器学习能力也在显着提高。Pixel 6 手机采用全新的 Google Tensor 处理器,该处理器集成了强大的 ML 加速器,以更好地支持重要的设备功能。

左:TPUv4 主板;中:TPUv4 pod的一部分;右图:在 Pixel 6 手机中的 Google Tensor 芯片。

Jeff Dean表示,谷歌使用 ML 来加速各种计算机芯片的设计也带来了好处,特别是在生产更好的 ML 加速器方面。

ML 编译和 ML 工作负载优化的持续改进

即使硬件不变,编译器的改进和机器学习加速器系统软件的其他优化也可以显著提高效率。

例如,“A Flexible Approach to Autotuning Multi-pass Machine Learning Compilers”展示了如何使用机器学习来执行编译设置的自动调整,用于同一底层硬件上的一套 ML 程序,以获得 5-15% 的全面性能提升(有时甚至高达2.4 倍改进)。

此外,GSPMD 描述了一种基于 XLA 编译器的自动并行化系统,该系统能够将大多数深度学习网络架构扩展到加速器的内存容量之外,并已应用于许多大型模型,例如 GShard-M4、LaMDA、BigSSL、ViT、MetNet -2 和 GLaM,在多个领域产生了最先进的成果。

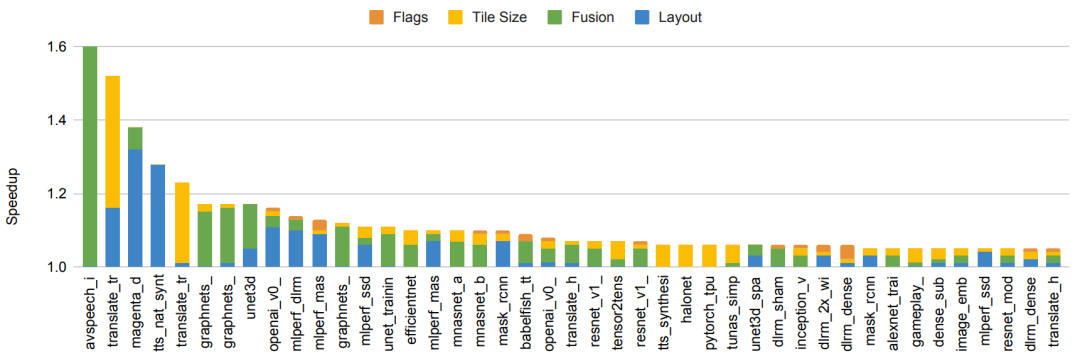

图注:通过在 150 个 ML 模型上使用基于 ML 的编译器自动调整实现端到端模型加速。图中包括实现 5% 或更多改进的模型。条形颜色代表优化不同模型组件的相对改进。

人类创造的更高效模型架构

模型架构的持续改进大大减少了为许多问题实现给定精度水平所需的计算量。

例如,谷歌在 2017 年开发的 Transformer 架构能够提高在多个 NLP 基准上的当前最佳水平,同时使用比其他各种常用方法少 10 到 100 倍的计算来实现这些结果,例如 LSTM 和其他循环架构。

同样,尽管使用的计算量比卷积神经网络少 4 到 10 倍,但视觉 Transformer 能够在许多不同的图像分类任务上显示出改善的最先进结果。

机器驱动的更高效模型架构的发现

神经架构搜索(NAS)可以自动发现对给定问题域更有效的新 ML 架构。NAS 的一个主要优点是它可以大大减少算法开发所需的工作量,因为 NAS 只需要对每个搜索空间和问题域组合进行单次检验。

此外,虽然执行 NAS 的初始工作在计算上可能很昂贵,但由此产生的模型可以大大减少下游研究和生产设置中的计算,从而大大降低总体资源需求。

例如,发现 Evolved Transformer 的单次搜索仅产生了 3.2 吨二氧化碳当量(远低于其他地方报告的 284 吨二氧化碳当量),但产生了一个比普通的 Transformer 模型效率高 15-20%的模型。

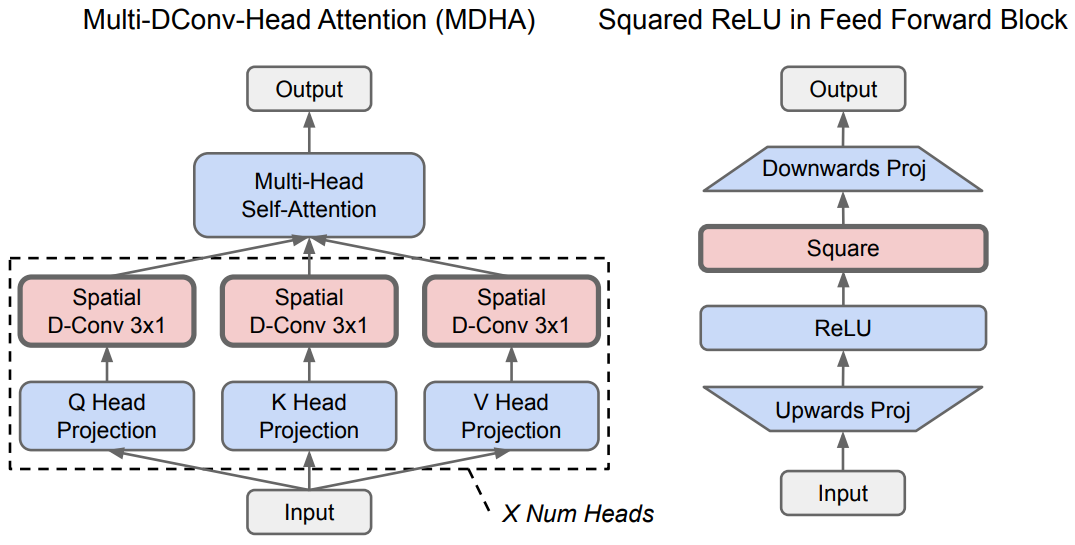

最近,谷歌利用 NAS 发现了一种更高效的架构,称为 Primer(也已开源),与普通的 Transformer 模型相比,它可以将训练成本降低 4 倍。通过这种方式,NAS 搜索的发现成本通常可以从使用发现的更有效的模型架构中收回,即使它们仅应用于少数下游任务(NAS 结果可被重复使用数千次)。

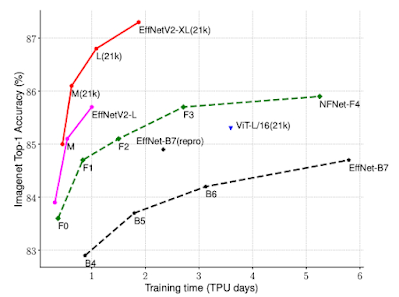

NAS还被用于在视觉领域发现更有效的模型。EfficientNetV2 模型架构是神经架构搜索的结果,它联合优化了模型精度、模型大小和训练速度。在 ImageNet 基准测试中,EfficientNetV2 将训练速度提高了 5 到 11 倍,同时与以前最先进的模型相比,模型参数大大减少。

CoAtNet 模型架构是通过架构搜索发现的,结合了视觉 Transformer 和卷积网络来创建一个混合模型架构,其训练速度比视觉 Transformer 快 4 倍,并实现了新的 ImageNet 最先进结果。

图注:EfficientNetV2 的训练效率比之前的 ImageNet 分类模型要好得多。

广泛使用搜索来帮助改进 ML 模型架构和算法,包括使用强化学习和进化技术,激发了其他研究人员将这种方法应用于不同领域。

除了模型架构之外,自动搜索还可用于寻找新的、更有效的强化学习算法,建立在早期的 AutoML-Zero 工作的基础上。

稀疏性的利用

稀疏性模型具有非常大的容量,但对于给定的数据(示例或 token ),只有模型的某些部分被激活,这是另一个可以大大提高效率的重要算法进步。

2017 年,谷歌引入了稀疏门控混合专家层,该层在各种翻译基准上展示了更好的结果,同时使用的计算量比以前最先进的密集 LSTM 模型少 10 倍。

最近,Switch Transformers 将混合专家风格的架构与 Transformer 模型架构相结合,与密集的 T5-Base Transformer 模型相比,训练时间和效率提高了 7 倍。

GLaM 模型表明,Transformer 和混合专家风格的层可以结合起来生成一个模型,该模型在 29 个基准测试中平均超过 GPT-3 模型的准确性,而训练的能耗减少了 3 倍,推理的计算量减少了 2 倍。稀疏性的概念也可以用于降低Transformer 架构中注意力机制的成本。

图注:BigBird 稀疏注意力模型由关注输入序列所有部分的全局标记、局部标记和一组随机标记组成。从理论上讲,这可以解释为在 Watts-Strogatz 图上添加一些全局标记。

在模型中使用稀疏性,显然是一种在计算效率方面具有非常高潜力的方法。Jeff Dean 表示,谷歌只是在这个方向上触及了皮毛。

与使用 P100 GPU 训练的基线 Transformer 模型相比,这些提高效率的方法中的每一种都可以组合在一起,可将高效数据中心训练的等效精度语言模型的能源效率提高约 100 倍,产生的二氧化碳排放量减少约 650 倍。

Jeff Dean表示,其团队很快就会发表更为详细的博客文章分析 NLP 模型的碳排放趋势。

ML 和诸如手机上的Tensor 处理器等硅基硬件的创新,使得移动设备可以更持续有效地感知周围环境,而这将为用户带来一系列新的体验。

他认为这种进步不仅提高了其可及性、易用性,而且提升了计算的能力,这对改善移动摄影、实时翻译等功能也至关重要。值得注意的是,这种最新的技术在为用户提供更加个性化体验的同时,还加强了隐私保障措施。

目前,使用手机摄像来记录日常生活或进行艺术表达的热度空前。Jeff Dean 认为,ML 在计算摄影中的巧妙运用,可以不断促进手机相机功能的提升,使其操作起来更加容易,也可以提高拍摄性能,产生更高质量的图像。

比如,经过改进的HDR+,在非常低的光线下就可以很好地处理人像,使相机更具包容性,并且适用于所有肤色,可以拍摄出能够达到摄影师预想视觉效果并且更符合主题的照片。

不仅如此,基于 ML 的 Google Photos 工具,像电影照片、降噪、模糊以及魔术橡皮擦等,可以进一步完善照片。

图注:HDR+ 从一连串全分辨率原始图像开始,每个图像都有相同的曝光不足(左)。融合后的图像减少了噪点并增加了动态范围,从而获得了更高质量的最终图像(右)。

除了使用手机进行创作外,Jeff Dean 还列举了人们依靠手机进行跨语言和跨模式的实时沟通的例子,比如在消息应用程序中使用实时翻译,在通话交流中使用实时字幕等。

得益于自监督学习和噪声学生训练 (Noisy Student Training)等技术的进步,语音识别的准确率在重音、嘈杂环境或语音重叠和多语言环境下,都有明显提高。基于从文本到语音合成方面的进展,越来越多的平台推出了朗读技术,允许人们用听的方式获取网页或文章内容,使信息更容易跨越模态和语言的障碍。

稳定、实时生成的翻译以及高质量、稳定、有保障的直接语音翻译,为使用不同语言交流的人们提供了更好的用户体验,机器翻译中的实时语音翻译功能也已得到极大改善。

将ML与传统的编解码方法相结合的新工作,可以促使更高保真度的语音、音乐或其它声音以更低的比特率进行交流。另一方面,Jeff Dean 还表示像自动呼叫或者与 ML 智能体进行的一些日常互动性的功能变得越来越自然。

即使是用户可能会经常进行的,像智能文本选择等这样的简单任务也得到了改进,可以实现自动选择电话号码或地址等,能够方便复制粘贴,或者在手机上输入时的语法纠正。

此外,“屏幕注意(Screen Attention )”可防止手机屏幕在被注视时变暗,并且注视识别(Gaze Recognition)的改进为可访问性和改善健康状况开辟了新的用例。ML 也正在启用新的方法来保障人们和社区的安全。例如,"可疑信息警报 ( Suspicious Message Alerts )" 对可能存在的网络钓鱼攻击发出警告、"安全路线(Safer Routing ) " 可以检测到急刹车事件以及提供建议替代路线。

图注:最近的工作证明了注视识别可作为精神疲劳的重要生物标志物。

然而,这些新功能的开发离不开数据支撑,Jeff Dean 表示鉴于其中潜在的敏感性问题,将其设置为在默认状态下私有是非常有必要的。

其中的很多功能是在安卓私有的计算核心内运行,提供了一个与操作系统其它部分隔离的开源安全环境。安卓系统可以确保在私有计算核心中处理的数据不会在用户不知情的情况下分享给任何应用程序。安卓系统还防止私有计算核心内的任何功能直接访问网络。

相反,这些功能通过一小套开源 API 与私有计算服务进行通信,私有计算服务剥离了识别信息,并利用了包括联邦学习、联邦分析和私人信息检索在内的隐私技术,确保在学习的同时保护隐私。

图注:联邦重建是一种新颖的部分局部联邦学习技术,其中模型被划分为全局和局部参数。对于每一轮联邦重建训练:(1) 服务器将当前全局参数 g 发送给每个用户 i;(2) 每个用户 i 冻结 g 并重建他们的局部参数 l_i;(3) 每个用户i冻结 l_i 并更新 g 产生 g_i ;(4) 对用户的 g_i 取平均值,生成下一轮的全局参数。

在 Jeff Dean 看来,这些技术对于发展下一代计算和交互模式至关重要。个人或公共设备可以在不侵犯隐私的情况下,从集体模型中学习,并推动模型训练的进步。

用联合无监督的方法来学习上述的通用模型,并针对特定的任务或环境进行微调,可以产生越来越多的智能系统,这些系统更像是一个社会实体而不是机器,与之互动要更为直观。只有从边缘到数据中心,深入改变技术堆栈(technology stacks),使其适当支持神经计算,才有可能广泛而公平地使用这些智能接口。

近年来,谷歌看到 ML 在基础科学中的影响越来越大,从物理学到生物学,在许多相关领域(例如可再生能源和医学)中都具有令人兴奋的实际应用。

计算机视觉模型已被部署用来解决个人和全球范围内的问题,它们可以协助医生进行日常工作,扩大人们对神经生理学的理解,还可以提供更好的天气预报结果和简化救灾工作。

通过发现减少碳排放和提高替代能源输出的方法,其他类型的 ML 模型被证明在应对气候变化方面至关重要。

随着 ML 变得更加健壮、完善和获得更广泛的访问,它在广泛的现实世界领域中具有高影响力的应用的潜力继续扩大,有助于解决研究人员面临的一些最具挑战性的问题。

计算机视觉的大规模应用以获得新的洞察力

过去十年,计算机视觉的进步使计算机能够用于不同科学领域的各种任务。比如,在神经科学中,自动重建技术可以从脑组织薄片的高分辨率电子显微镜图像中恢复脑组织的神经结缔结构。

前几年,谷歌为果蝇、小鼠和鸣禽的大脑创建了此类资源。但在去年,他们与哈佛大学的 Lichtman 实验室合作,分析了以相同粒度成像和重建的多种物种的大脑组织样本,并首次对人类皮层中的突触连接进行了大规模研究,该研究跨越了皮层所有层的多种细胞类型。

这项工作的目标是获得一种新的资源来帮助神经科学家研究人类大脑的复杂性。例如,下图显示了成人大脑中约 860 亿个神经元中的 6 个神经元。

图注:来自人类皮层重建的单个人类枝形吊灯神经元,以及与该细胞连接的一些锥体神经元。

此外,计算机视觉技术还提供了强大的工具来应对更大甚至全球范围内的挑战。

例如,基于深度学习的天气预报方法,该方法使用卫星和雷达图像作为输入,结合其他大气数据,在长达 12 小时的预测时间内,产生比传统的基于物理的模型更准确的天气和降水预报。与传统方法相比,它们还可以更快地生成新的预测,这在极端天气中非常重要。

图注:2020 年 3 月 30 日,不同模型预测科罗拉多州丹佛市 0.2 毫米/小时降水量的比较。左图:真实数据,来源(MRMS)。中间:MetNet-2 预测的概率图。右图:基于物理的 HREF 模型预测的概率图。MetNet-2 能够在预测中比 HREF 更早地预测风暴的开始以及风暴的起始位置,而 HREF 错过了起始位置,但很好地捕捉到了生长阶段。

准确记录建筑足迹对于人口估计和城市规划等一系列应用至关重要。在世界许多地方,包括非洲大部分地区,这些信息以前都是不可用的。

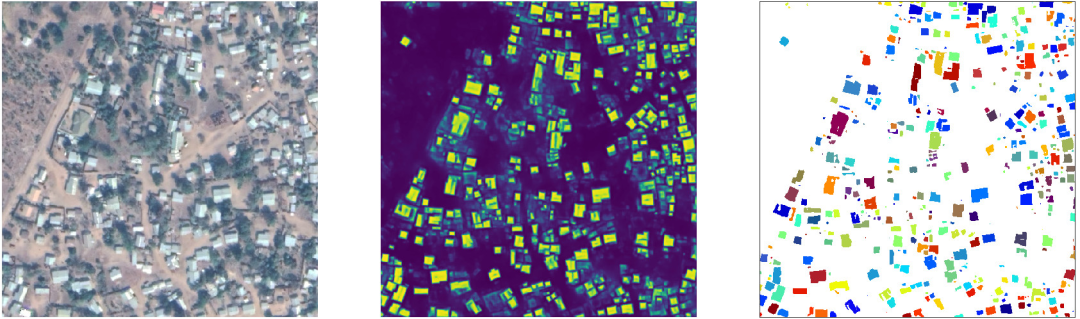

但新工作表明,将计算机视觉技术应用于卫星图像可以帮助识别大陆尺度的建筑边界。这种方法的相关结果已在 Open Buildings 数据集中发布,这是一个新的开放访问数据资源,其中包含 5.16 亿座建筑物的位置和足迹,覆盖非洲大陆的大部分地区。

Jeff Dean 团队还在与世界粮食计划署的合作中使用这个数据集,通过应用机器学习在自然灾害后提供快速的损害评估。

在卫星图像中分割建筑物的示例。左:源图像;中:语义分割,每个像素都分配了一个置信度分数,表明它是建筑物还是非建筑物;右图:实例分割,通过对连接组件进行阈值化和分组获得。

这些案例反映出的一个共同主题是,ML 模型能够基于对可用视觉数据的分析,高效、准确地执行专门的任务,支持高度相关的下游任务。

自动化设计空间探索

另一种在多个领域取得成果的方法是,允许 ML 算法以自动化方式探索和评估问题的设计空间以寻找可能的解决方案。

比如在一个应用程序中,基于 Transformer 的变分自动编码器学习创建美观且有用的文档布局,并且可以扩展相同的方法来探索可能的家具布局。

另一种 ML 驱动的方法自动探索游戏规则的巨大设计空间,以提高游戏的可玩性和其他属性,使人类游戏设计师能够更快地创建令人愉快的游戏。

图注:变分Transformer网络 (VTN) 模型的可视化,它能够提取布局元素(段落、表格、图像等)之间的有意义的关系,以生成逼真的合成文档(例如,具有更好的对齐和边距)。

其他 ML 算法已被用于评估 ML 加速器芯片本身的计算机架构决策的设计空间。

谷歌还表明,ML 可用于为 ASIC 设计快速创建芯片布局,这些布局优于人类专家生成的布局,并且可以在几小时而不是几周内生成。这降低了芯片的固定工程成本,并降低了为不同应用快速创建专用硬件的障碍。他们在即将推出的 TPU-v5 芯片的设计中成功地使用了这种方法。

这种探索性 ML 方法也已应用于材料发现。在 Google Research 和加州理工学院的合作中,几个 ML 模型与改进的喷墨打印机和定制的显微镜相结合,能够快速搜索数十万种可能的材料,发现了 51 种以前未表征的三金属氧化物材料,在电池技术和水电解等领域具有应用前景。

这些自动化的设计空间探索方法可以帮助加速许多科学领域,特别是当生成实验和评估结果的整个实验循环都可以以自动化或大部分自动化的方式完成时。Jeff Dean 表示,希望看到这种方法在未来几年在更多领域中发挥良好的效果。

在健康领域的应用

除了推进基础科学,机器学习还可以更广泛地推动医学和人类健康的进步。

利用计算机科学在健康方面并不是什么新鲜事——事实上,谷歌早期就开发软件来帮助分析流行病学数据。但是机器学习打开了新的大门,带来了新的机会,也带来了新的挑战。

以基因组学领域为例。自基因组学问世以来,计算一直很重要,但 ML 增加了新功能并推翻了旧范式。当谷歌研究人员开始在这一领域工作时,许多专家认为使用深度学习帮助从测序仪输出推断遗传变异的想法是牵强附会的。

今天,这种机器学习方法被认为是最先进的。但未来对于 ML 来说将扮演更重要的角色——基因组学公司正在开发更准确、更快的新测序仪器,但也带来了新的推理挑战。

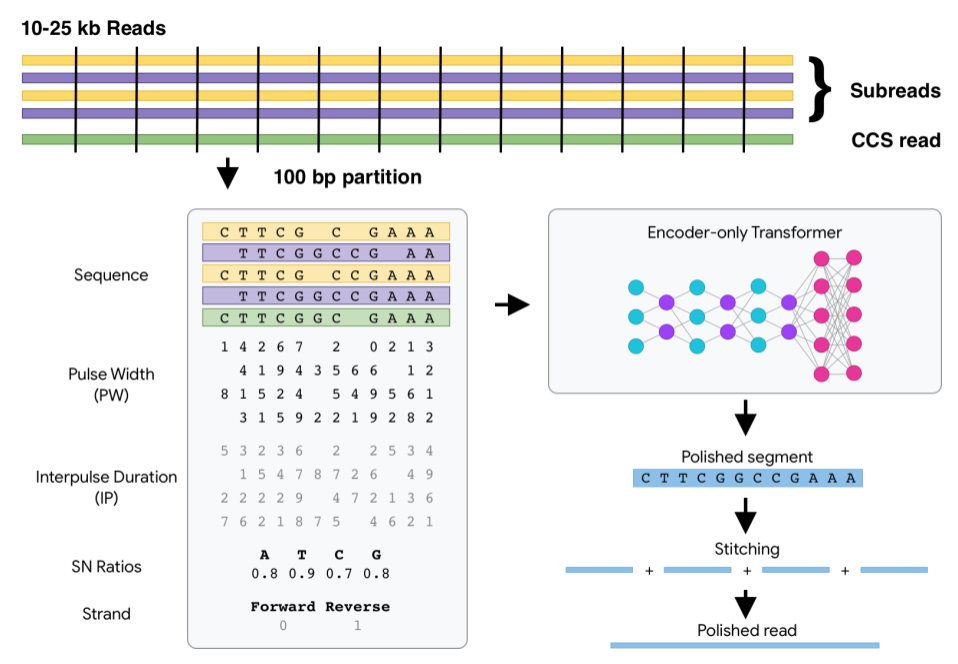

谷歌发布的开源软件 DeepConsensus 以及与 UCSC 合作的 PEPPER-DeepVariant 支持这些具有尖端信息学的新仪器。

图注:DeepConsensus 的 Transformer 架构示意图,可纠正测序错误以提高产量和准确性。

除了处理测序仪数据之外,还有其他机会使用 ML 来加速研究人员将基因组信息用于个性化健康。广泛表型和测序个体的大型生物库可以彻底改变人们理解和管理疾病遗传易感性的方式。

Jeff Dean 等人基于 ML 的表型分析方法提高了将大型成像和文本数据集转换为可用于遗传关联研究的表型的可扩展性,他们的 DeepNull 方法更好地利用大型表型数据进行遗传发现,并且已经开源。

图注:生成解剖和疾病特征的大规模量化以与生物库中的基因组数据相结合的过程。

正如 ML 帮助研究人员看到基因组数据的隐藏特征一样,它也可以帮助发现新信息并从其他健康数据类型中收集新见解。疾病诊断通常是关于识别模式、量化相关性或识别更大类别的新实例——这些都是 ML 擅长的任务。

谷歌研究人员已经使用 ML 解决了广泛此类问题,但也许这些问题都没有比 ML 在医学成像中的应用更进一步。

事实上,谷歌 2016 年的论文描述了深度学习在糖尿病性视网膜病变筛查中的应用,被美国医学会杂志 (JAMA) 的编辑选为十年来最具影响力的 10 篇论文之一——不仅仅是机器学习和健康方面最有影响力的论文,甚至是整个十年中最具影响力的 JAMA 论文。

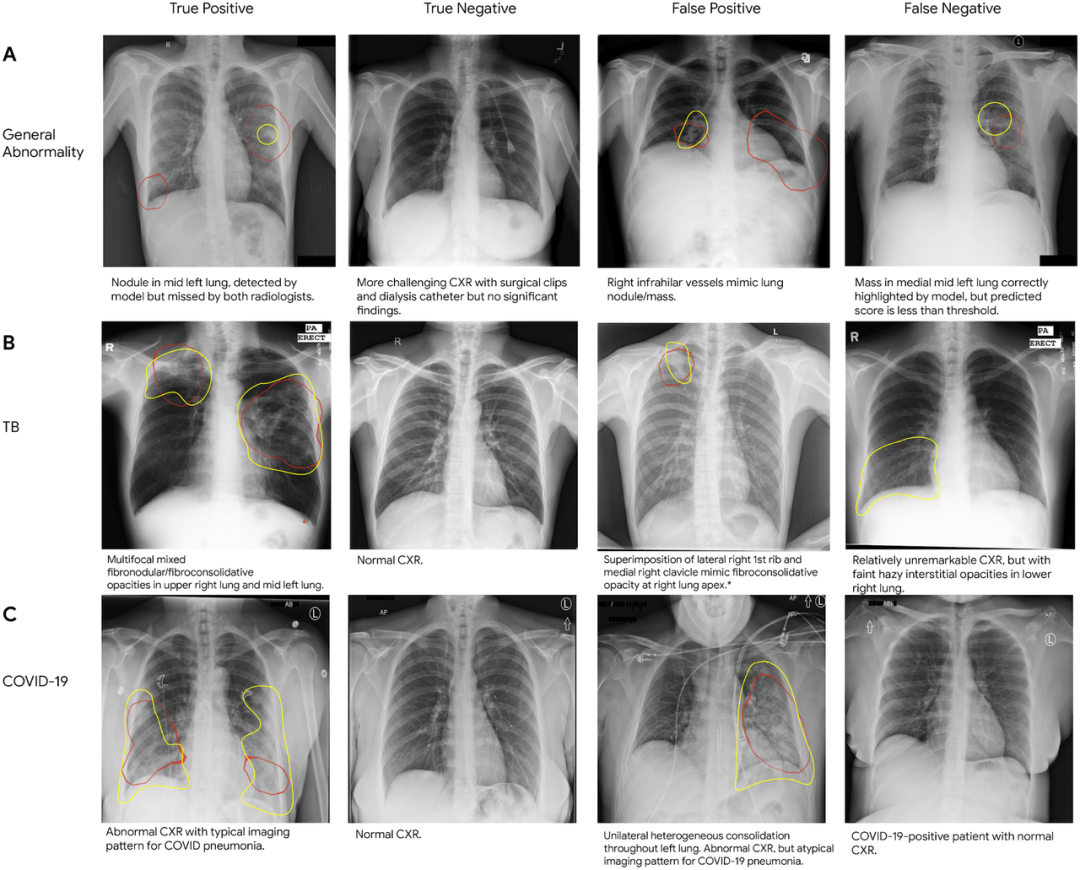

Jeff Dean 表示,其团队成员希望看到这种相同模式的辅助 ML 系统被部署用于改善乳腺癌筛查、检测肺癌、加速癌症放射治疗、标记异常 X 射线和分期前列腺癌活检。

ML 辅助结肠镜检查程序是更高阶的有趣例子。结肠镜检查不仅用于诊断结肠癌——在手术过程中切除息肉是阻止疾病进展和预防严重疾病的重要部分。在这个领域,研究人员已经证明 ML 可以帮助检测难以捉摸的息肉,并且可以增加质量保证的新维度,例如通过应用同步定位和映射技术进行覆盖映射。

通过与耶路撒冷的 Shaare Zedek 医疗中心合作,谷歌展示了这些系统可以实时工作,在每次手术中平均检测到一个原本会被漏掉的息肉,每次手术的误报少于四个。

图注:胸部 X 光片 (CXR) 的真假阳性样本,以及 (A) 一般异常、(B) 结核病和 (C) COVID-19 的真假阴性结果。在每个 CXR 上,红色轮廓表示模型重点识别异常的区域(即类激活图),黄色轮廓表示放射科医生识别的感兴趣区域。

另一个医疗保健计划 Care Studio 使用最先进的 ML 和先进的 NLP 技术来分析结构化数据和医疗记录,在正确的时间向临床医生提供最相关的信息——最终帮助他们提供更主动和准确的护理。

尽管 ML 可能对扩大临床环境的可及性和提高准确性很重要,但一个同样重要的新趋势正在出现:ML 应用于帮助人们提高日常健康和福祉。

我们的日常设备具有强大的传感器,可以帮助使健康指标和信息民主化,以便人们可以就自己的健康做出更明智的决定。

智能手机摄像头已经可以评估心率和呼吸频率以帮助用户,而无需额外硬件的发布,以及支持非接触式睡眠感应,并让用户更好地了解他们的夜间健康状况的设备。

一方面,个人可以在自己的 ASR 系统中显著提高无序语音的语音识别质量,另一方面,还可以使用 ML 帮助重建有语音障碍的人的声音。支持机器学习的智能手机甚至可以帮助人们更好地研究新出现的皮肤状况或帮助视力有限的人慢跑。

图注:用于非接触式睡眠感应的自定义 ML 模型有效地处理连续的 3D 雷达张量流(总结一系列距离、频率和时间的活动),以自动计算用户清醒或睡着的可能性的概率。

机器学习在气候危机上的应用

另一个最重要的领域是气候变化,这对人类来说是一个极其紧迫的威胁。

因此,人们需要共同努力,扭转有害排放物的增长曲线,以确保安全和繁荣的未来。关于不同选择对气候带来的影响的信息可以帮助人类以多种不同方式应对这一挑战。

为此,谷歌最近在 Google 地图中推出了环保路线推荐应用,他们估计这将每年减少约 100 万吨二氧化碳排放(相当于从道路上减少 200,000 多辆汽车)。

此外,让地图产品更智能地了解电动汽车有助于缓解里程焦虑,鼓励人们改用无排放汽车。谷歌还与世界各地的多个城市合作,使用汇总的历史交通数据来帮助改进交通信号灯时间设置,在以色列和巴西进行的一项早期试点研究表明,燃料消耗和延误时间可以减少10-20%。

图注:借助环保路线应用,Google 地图可以显示快和省油的路线。

在更长的时间范围内,聚变有望成为改变游戏规则的可再生能源。在与 TAE Technologies 的长期合作中,谷歌使用 ML 通过建议设置 1000 多个相关控制参数来帮助维持其聚变反应堆中的稳定等离子体。

通过他们的合作,TAE 实现了诺曼反应堆的主要目标,这使研究人员离盈亏平衡聚变的目标更近了一步。该机器在 30 毫秒内保持 3000 万开尔文的稳定等离子体,这是其系统可用功率的范围。

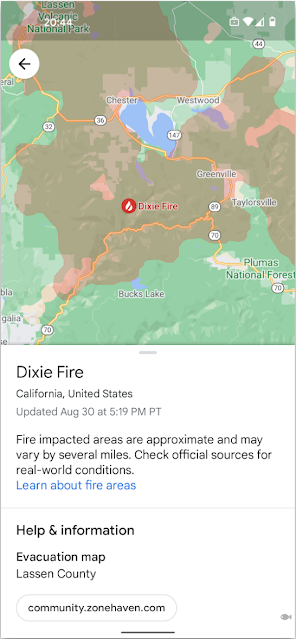

谷歌也在关注自然灾害预防。去年,他们推出了由卫星数据提供支持的野火边界图,以帮助人们直接通过设备轻松了解火灾的大致规模和位置。

在此基础上,研究人员现在将谷歌的所有野火信息整合在一起,并在全球范围内推出谷歌地图上的新图层。他们一直在应用图形优化算法来帮助优化火灾疏散路线。

2021 年,谷歌首次在实际的洪水预警系统中部署了基于 LSTM 的预测模型和新的模型( Manifold inundation model)。

图注:Google 地图中的野火层可在紧急情况下为人们提供重要的最新信息。

ML 模型训练的碳排放是 ML 社区关注的问题,谷歌已经证明了关于模型架构、数据中心和 ML 加速器类型的选择可以将训练的碳足迹减少约 100-1000 倍。

随着机器学习被更广泛地接受和应用,继续开发新技术可以推进机器学习更好地造福于社会。

基于在线产品中的用户活动的推荐系统就是其中一个。通常推荐系统是由多个不同组件构成的,想要理解它们的公平属性,需要了解各个组件以及它们组合时的运行方式。

谷歌最新的研究提高了单个组件和整体推荐系统的公平性,帮助用户更好地理解这些“关联性”。而且,在从匿名用户活动中学习时,推荐系统以“中立”的方式学习至是十分必要的。从先前用户的数据中直接学习到的“经验”,可能带有显而易见的“偏见”。如果不纠正,那新用户可能会频繁收到不符合心意的产品推荐。

与推荐系统类似,上下文环境在机器翻译中至关重要。大多数机器翻译系统都是孤立地翻译单个句子,没参考额外的上下文内容,无意间添加了性别、年龄等“歧视”属性。谷歌去年公布了一个专门针对翻译中性别偏见的数据集,用来研究基于维基百科传记的翻译偏见。

部署机器学习模型中另一个常见问题是分布偏移(distributional shift):如果训练模型数据的统计分布与输入模型数据的统计分布不同,可能造成模型产生的结果不可预测。

谷歌利用 Deep Bootstrap 框架对比有限训练数据的现实世界与无限数据的“大同世界”。从而更好地理解模型的行为(真实中与理想中的世界),研究人员可以开发泛化性更强的模型,对固定训练数据集减少“偏见”。

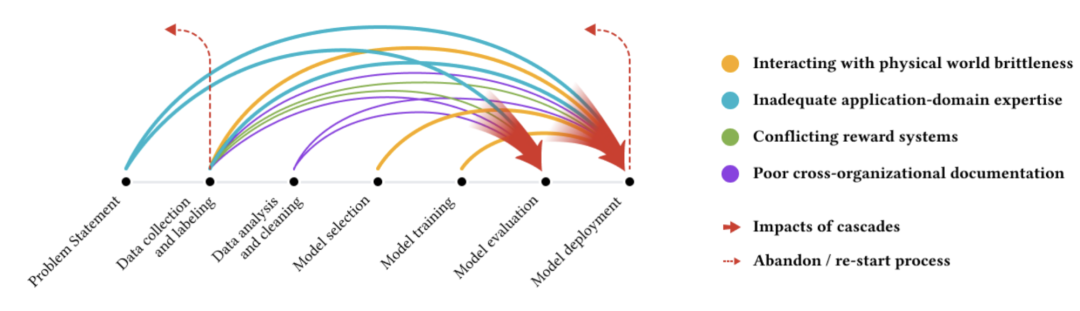

虽然机器学习算法和模型开发一直备受关注,但数据收集和数据集管理类的工作相对较少。毋庸置疑,它们是不可忽视的领域,因为训练机器模型所依据的数据可能是下游应用程序中公平性问题的潜在来源。分析机器学习中此类数据级联,将有助于识别项目周期中对结果产生重大影响的许多因素。

图注:不同颜色的箭头表示各种类型的数据级联,每个级联通常起源于上游,在ML开发过程中复合,并在下游呈现。

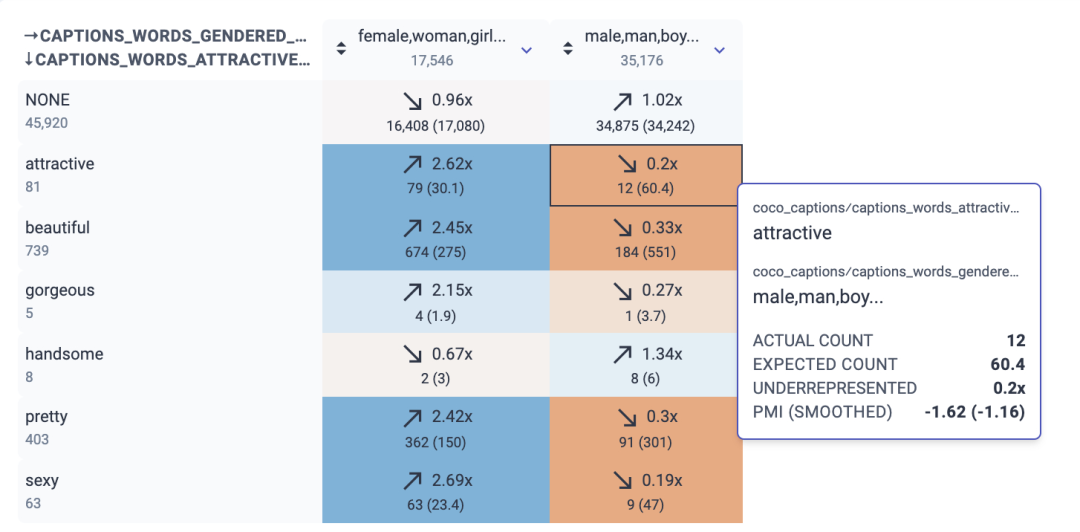

更好地理解数据是机器学习研究的一个核心环节。谷歌开发了一类方法能够深入了解特定训练示例对机器学习模型的影响,因为错误标记的数据或其他类似问题对整体模型都有巨大负面影响。谷歌还构建了Know Your Data 工具,用以帮助研究人员和从业者掌握数据集属性,例如:如何使用 Know Your Data 工具来探索性别、年龄偏见等问题。

图注:Know Your Data 的数据显示了描述吸引力的词与性别词之间的关系

了解基准数据集使用的动态也十分必要,因为它们在机器学习领域的中发挥着核心作用。尽管对单个数据集的研究变得更为普及,但整个领域的数据集使用动态仍有神秘领域待探索。最近谷歌发表了第一个关于数据集创建、采用和重用动态的大规模实证分析。

创建更具包容性和更少偏见的公共数据集是可以改善机器学习领域的重要方法。2016 年,谷歌发布了 Open Images 数据集,该数据集包含约 900 万张图像,标注了涵盖数千个对象类别的图像标签和 600 个类别的边界框注释。

去年,Jeff Dean团队在 Open Images Extended 集合中引入了更具包容性的人物注释 (MIAP) 数据集。它有更完整的人类边界框注释,像感知性别表示和感知年龄范围等都标有更为公平的属性。同时,研究人员还构建了数据集搜索来帮助用户发现新的数据集。

处理各种形式的在线滥用行为,例如有害言论、仇恨言论和错误信息等,能够有效大规模检测这类滥用形式,对确保平台安全、避免通过以无人监督的方式从在线话语中学习语言的此类负面特征的风险至关重要。

谷歌通过 Perspective API 工具进行了工作,但大规模检测有害性所涉及的细微差别仍然是高难度挑战。Jeff Dean等引入了全面分类法来推理在线仇恨和骚扰的言论变化局面。

他们同样研究了如何检测在网络中常被忽略的隐蔽有害形式,例如微歧视(microaggression)。研究了如何用传统方法处理数据注释中的歧视,这些主观概念会边缘化少数人的观点,并提出了一种新的基于多任务框架的分类建模方法。

其他的潜在问题是,机器学习语言理解和生成模型有时也会产生缺少证据支持的结果。为了在问答、总结和对话中解决这个问题,谷歌开发了一个新框架衡量结果是否可以归因于特定来源,并随后发布了注释指南,证明能够可靠地用于评估候选模型。

模型交互式分析和调试仍然是机器学习的关键。谷歌更新了语言可解释性工具,用新功能和技术推进这项工作,包括对图像和表格数据的支持,以及内置支持通过概念激活向量测试技术进行公平性分析等。

机器学习系统的可解释性和对模型决策过程的事后可重建性也是谷歌负责任的AI 愿景的关键部分。通过与 DeepMind 合作,研究人员在理解人类国际象棋概念在自对弈训练的 AlphaZero 国际象棋系统中的获取上取得了进展。

图注:探索 AlphaZero 学习到的国际象棋概念。

谷歌也在将人工智能的视野拓宽到西方背景之外。他们最近的研究检验了基于西方机构和基础设施的传统算法公平框架的假设为何在非西方背景下不适应。

他们正在多个国家积极开展调查研究,以了解人们对人工智能的看法和偏好。西方对算法公平性研究的框架往往只关注少数几个属性,因此关于非西方背景的偏见在很大程度上被忽视,在经验上研究不足。

为了解决这一问题,谷歌与密歇根大学合作,开发了一种弱监督方法,在 NLP 模型中稳健地检测更广泛的地理文化背景中的词汇偏差,这些模型反映了人类在这些区域中对攻击性和非攻击性语言的判断。

此外,他们还探索了 ML在南半球主导的环境中的应用,包括为以农户为中心的机器学习研究提出建议。

基于社区的研究方法,也为谷歌设计数字福祉和解决机器学习系统中的种族平等问题提供了依据,包括提高对非裔美国人使用 ASR 系统体验的理解。

随着ML模型在许多领域的应用,私有信息的保护一直是研究的重点。沿着这些思路,谷歌最新研究解决了大型模型中的隐私问题,既强调了从大型模型中提取训练数据,也指出了在大型模型中实现隐私的方法,例如差分私有BERT。

除了上面提到的联邦学习和分析方面的工作之外,使用实用的机器学习技术从而增强研究人员的工具箱,确保差分隐私,比如私有聚类、私有个性化、私有矩阵完成、私有加权采样、私有分位数、半空间的私有鲁棒学习,以及普遍样本高效的私有 PAC 学习,还有扩展可针对不同应用程序和模型定制的隐私概念集,像标签隐私和用户与项目级别的隐私。

图注:差分私有聚类算法的可视化图示。

研究通常是对现实世界产生影响的长期历程。几年前发生的早期研究工作现在对谷歌乃至全世界都产生了巨大的影响。

对ML 硬件加速器以及软件框架的投资已取得成果。ML 模型在许多不同产品和功能中越来越普遍,因为它们的强大功能和易于表达的特点简化了 ML 模型在性能关键环境中的实验和生产。

对创建 Seq2Seq、Inception、EfficientNet 和 Transformer 的模型架构的研究或批归一化和蒸馏等算法研究正在推动语言理解、视觉、语音等领域的进步。

更好的语言和视觉理解以及语音识别等基本功能或许将具有变革性,因此,这些类型的模型被广泛部署用于解决许多产品中的各种问题,包括搜索、助理、广告、云、邮箱、地图、视频、和翻译等等。

这些是机器学习和计算机科学真正激动人心的时刻。计算机通过语言、视觉和声音理解和与周围世界互动的能力不断提高,这为计算机如何帮助人们完成任意的任务开辟了全新的领域。这篇文章概述的五个趋势中谈到的示例将是这个长期历程中的路标!

原文链接:https://ai.googleblog.com/2022/01/google-research-themes-from-2021-and.html