重要概率分布

"本文主要介绍机器学习常用的概率论知识点:高斯分布、泊松分布、伯努利分布"

AI-CODE | 作者 / AI-code

这是人类之奴公众号的第59篇原创文章

在机器学习的世界中,没有完全确定的事,所以所有机器学习算法本质上都是在学习一种能够最佳表达事物的概率分布。

因此我们很有必要对概率分布有一个清晰的理解。

概率分布是对随机变量在现实世界中分布情况的表达,这里的随机变量概括起来可以分为两类:离散随机变量、连续随机变量。

离散随机变量类似于抛掷硬币时只能出现正面、反面,而没有介于正面、反面之间的情况出现;我们不能想当然认为离散随机变量出现的情况只能是有限个,"离散"强调的是每种情况之间的非连续性。

连续随机变量类似于我们用笔画线所画出的线的长度,这个长度值是可以为任意非负值的,所有连续随机变量可能的取值是无限个的。

概率分布便是对随机变量所有可能取值出现概率的一个完全列举。

离散型随机变量的概率分布可以用直方图的形式表达出来;连续型随机变量的概率分布却只能用概率密度函数来表达,因为我们只能够表达连续性随机变量的取值为某一区间时的概率,而连续型随机变量的值取该区间范围时的概率就对应于概率密度函数在该区间上的积分值。

随机变量对应的概率分布是有无限种的,而重要的概率分布却不多(我们应该为此感到庆幸);它们是那些对现实世界具有高度概括能力的概率分布。

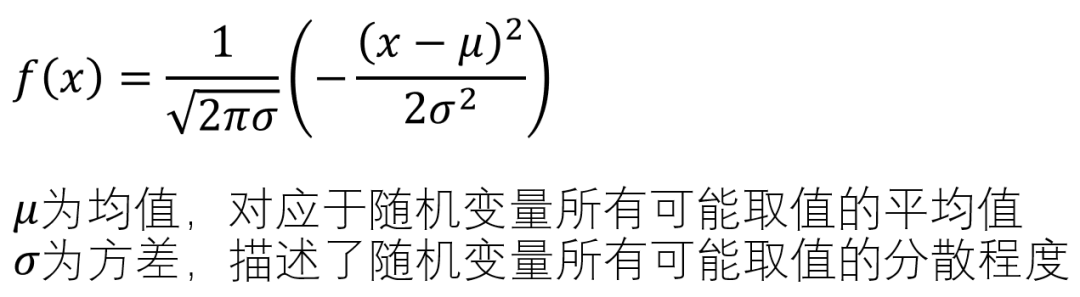

高斯分布

高斯分布又称为正态分布,它是由德国数学家高斯提出的。

高斯分布在现实世界中是最常见的概率分布之一,它描述的是那些取极端值概率小,取中庸值概率大的随机变量,例如人类的身高、班级数学成绩、午餐用餐时间等等。

高斯分布的概率密度函数为:

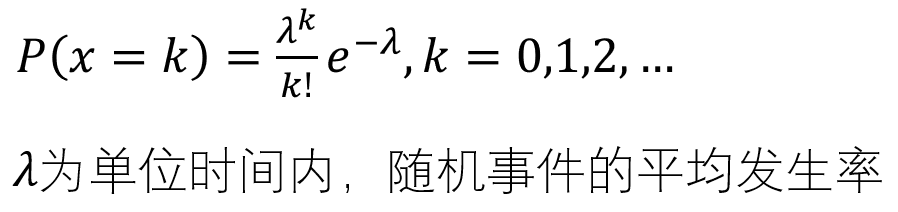

泊松分布

泊松分布是统计与概率学中常见的离散分布,它描述的是某段时间范围内,某件事情n次的概率(单位时间内,随机事件发生的次数)。

泊松分布的概率分布为:

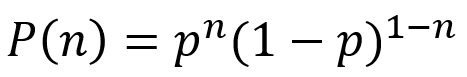

伯努利分布

伯努利分布是概率学中非常常用的一种离散分布,它满足(1)各次试验中的事件相互独立,每一次n=1和n=0的概率分别为p和q。(2)每次试验的结果只可能是n=0或n=1。

伯努利分布的概率分布为:

目前我们所了解的有关概率论在机器学习中的应用似乎只有朴素贝叶斯,其实概率率在机器学习算法中的应用是非常广泛的,之后将为大家慢慢解开概率论在机器学习中的神秘面纱。

End

点个在看你最好看