独家 | 综述:情感树库上语义组合的递归深层模型

作者:Talha Chafekar

翻译:顾伟嵩

校对:阿笛

本文约1400字,建议阅读5分钟

本文探讨了单词和n-grams的不同组合方法,以及如何借助基于树的表示法,以自底向上的方式预测短语或单词的二元或多类(本例中为5)细粒度情感。

数据集

概念

模型

结论

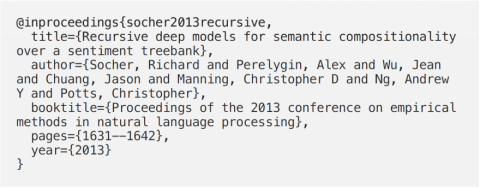

引用

原文标题:A Review on ‘Recursive Deep Models for Semantic Compositionality Over a Sentiment Treebank’

原文链接:

https://talhachafekar.medium.com/a-review-on-recursive-deep-models-for-semantic-compositionality-over-a-sentiment-treebank-9c93a2cf4bed

译者简介

顾伟嵩,中国科学院大学网络空间安全专业研究生。对数据科学领域充满好奇,渴望探索未知世界。课余时间喜欢踢足球、游泳。愿意挑战新事物,结交新朋友,一起进步,一起成长。

翻译组招募信息

工作内容:需要一颗细致的心,将选取好的外文文章翻译成流畅的中文。如果你是数据科学/统计学/计算机类的留学生,或在海外从事相关工作,或对自己外语水平有信心的朋友欢迎加入翻译小组。

你能得到:定期的翻译培训提高志愿者的翻译水平,提高对于数据科学前沿的认知,海外的朋友可以和国内技术应用发展保持联系,THU数据派产学研的背景为志愿者带来好的发展机遇。

其他福利:来自于名企的数据科学工作者,北大清华以及海外等名校学生他们都将成为你在翻译小组的伙伴。

点击文末“阅读原文”加入数据派团队~

转载须知

如需转载,请在开篇显著位置注明作者和出处(转自:数据派ID:DatapiTHU),并在文章结尾放置数据派醒目二维码。有原创标识文章,请发送【文章名称-待授权公众号名称及ID】至联系邮箱,申请白名单授权并按要求编辑。

发布后请将链接反馈至联系邮箱(见下方)。未经许可的转载以及改编者,我们将依法追究其法律责任。

点击“阅读原文”拥抱组织