场景几何约束在视觉定位中的探索

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文转自:计算机视觉工坊

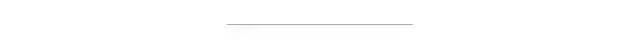

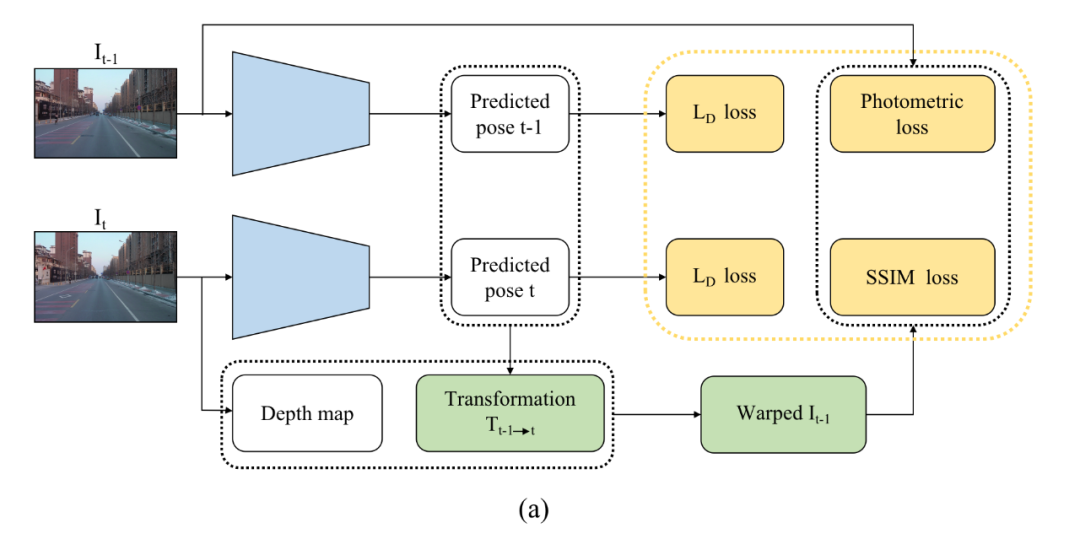

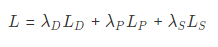

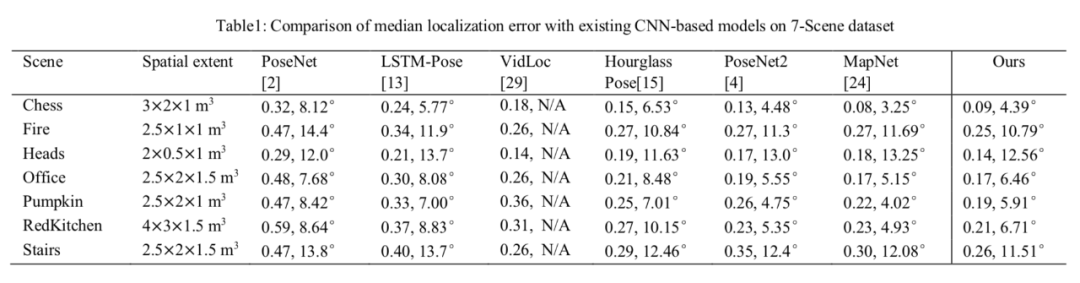

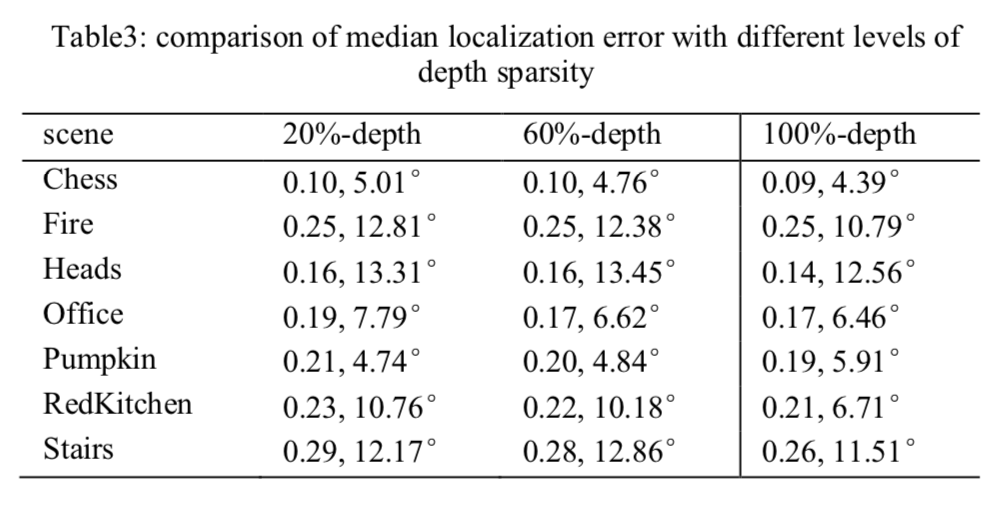

搭建了一个深度神经网络模型,可以直接从输入图像估计相应的相机绝对位姿。

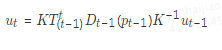

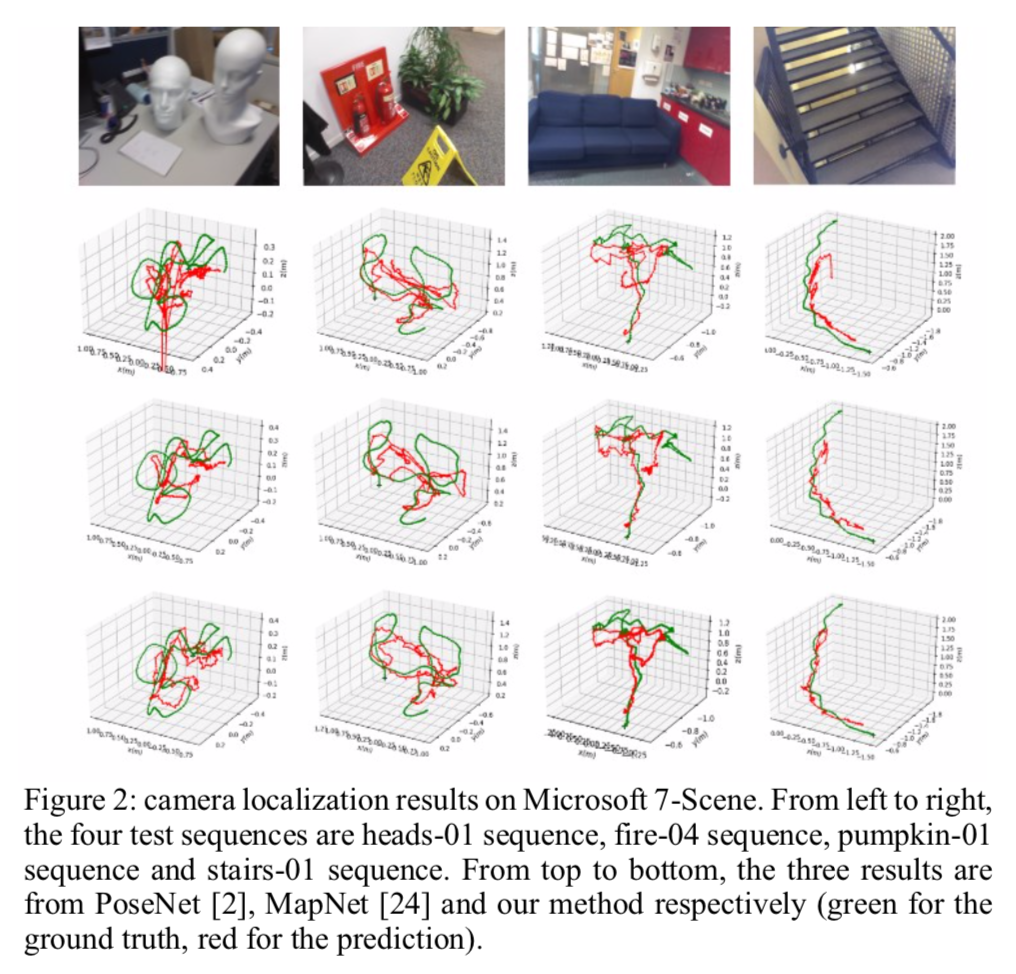

利用深度传感器信息,构建了 3D 场景几何约束来提高位姿预测精度。并且,稀疏深度信息足以获得显著的定位精度提升,这意味着我们的方法可以适用于任何类型的深度传感器(稀疏或稠密)。

在室内和室外数据集上进行了广泛的实验评估,证明了加入 3D 场景几何约束后,可以提高网络的定位精度,并且这一约束可以灵活地加入到其他网络中,帮助进一步提高算法性能。

1. 算法框架

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

评论