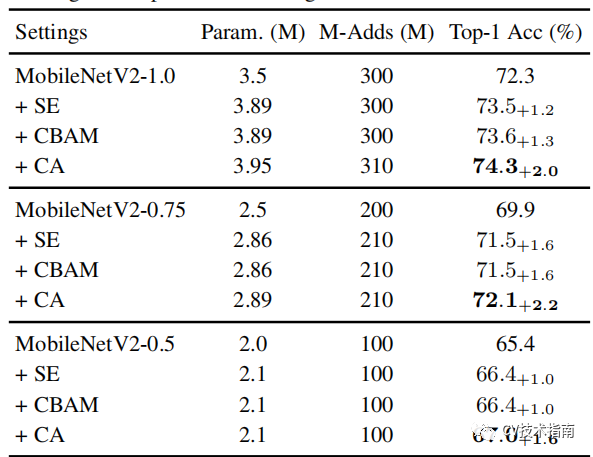

CVPR2021| 继SE,CBAM后的一种新的注意力机制Coordinate Attention

论文地址:

https://arxiv.org/pdf/2103.02907.pdf

代码地址:

https://github.com/AndrewQibin/CoordAttention

Introduction

这种coordinate attention有三个优点:

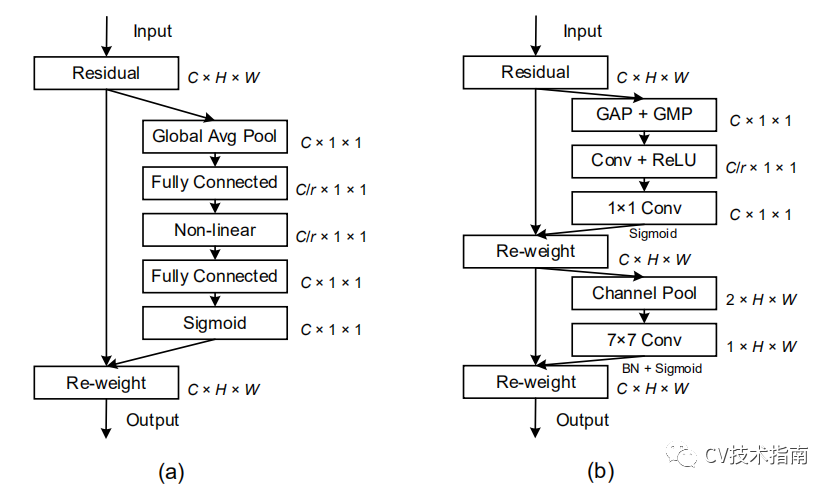

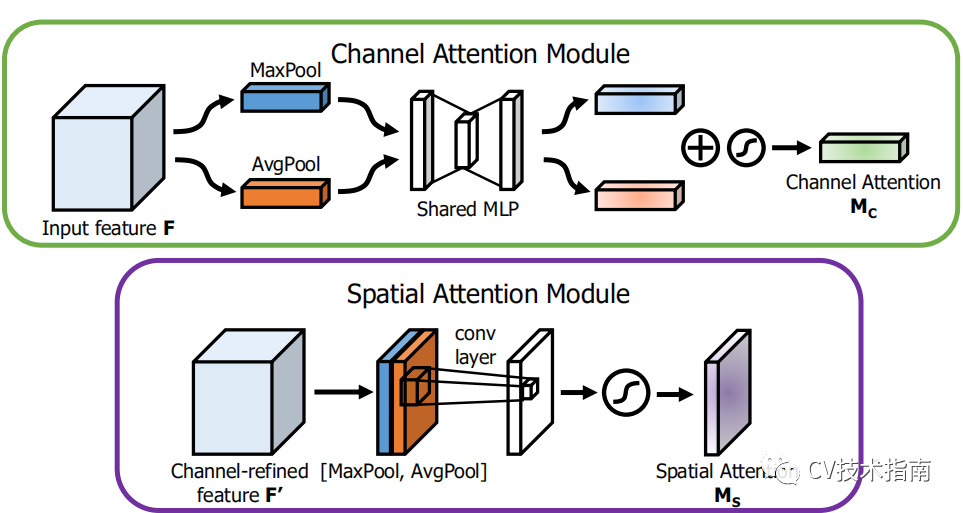

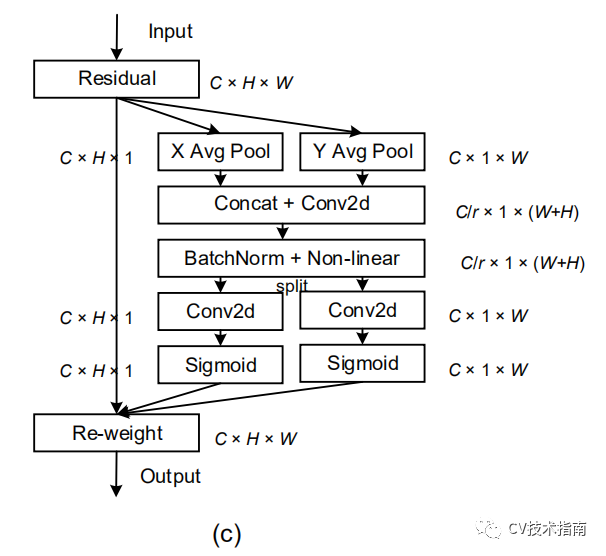

Coordinate Attention

简单说来,Coordinate Attention是通过在水平方向和垂直方向上进行最大池化,再进行transform对空间信息编码,最后把空间信息通过在通道上加权的方式融合。

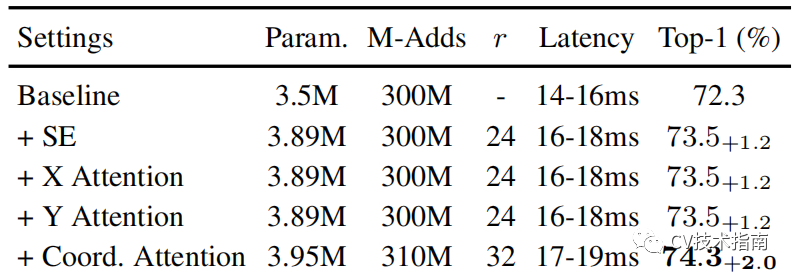

Conclusion

这种方式与SE,CBAM有明显提升。

下一篇将对注意力机制进行做一个总结。

最近把公众号所有的技术总结打包成了一个pdf,在公众号中回复关键字“技术总结”可获取。

✄------------------------------------------------

感谢对我们的支持!

评论