用光速加速AI?Nature最新研究,打破你的“次元壁”!

新智元报道

【新智元导读】面对海量的数据,硬件设备是否能跟上,是当今挑战AI发展的一个巨大问题。而本周发表在《Nature》上的研究结果,证明了将光子结构用于AI是可行的,并具有不可忽视的潜力。使用光学原理,设备可以可以快速,并行地处理信息,而这是当今电子芯片无法做到的。

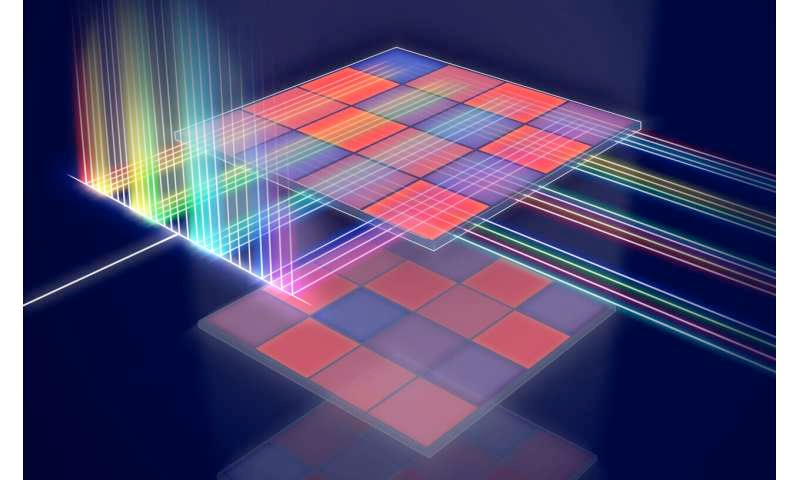

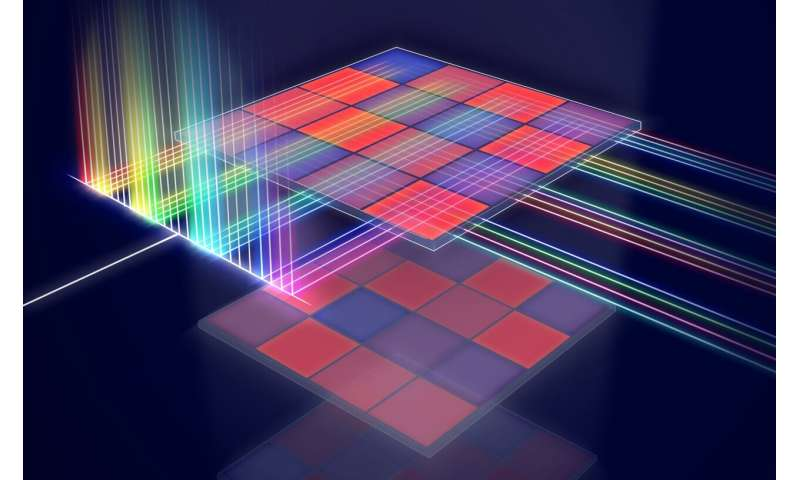

光子处理器可以通过利用光的独特特性,来加速人工智能的处理过程。

从更深远的角度来讲,这可能会激发光学计算的复兴。

传统计算逐渐临界极限,光子计算起步艰难

传统计算逐渐临界极限,光子计算起步艰难

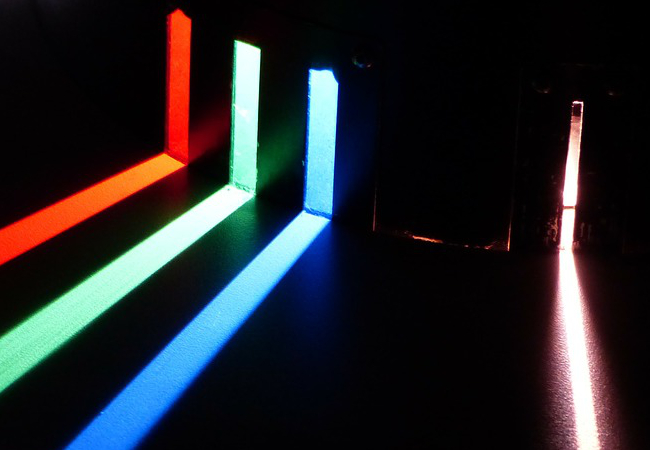

由于光谱覆盖的波长范围很广,许多不同波长的光子可以同时复用(平行传输)和调制(改变方式使它们可以携带信息),而不会使光信号相互干扰。这种信息以光速传播可以具有最小的时间延迟。

此外,无源传输(不需要输入功率)有助于超低功耗,而相位调制(光波的量子力学相位变化)使光在频率大于40千兆赫时易于调制和检测。

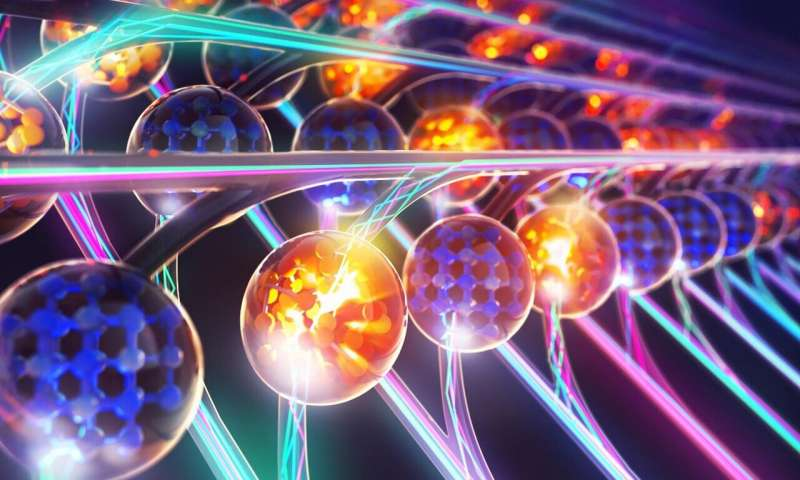

在过去的几十年里,光纤通信取得了巨大的成功。然而,使用光子进行计算仍然具有挑战性,特别是与最先进的电子处理器相比,在规模和性能水平上并不能达到最理想的效果。

这一困难主要来自于缺乏允许人工神经元的高速非线性(复杂)响应,以及可扩展的光子器件来集成到计算硬件的合适的并行计算机制和材料。

光频梳成为“救世主”,速度超群

光频梳成为“救世主”,速度超群

跨学科合作必不可少,全光计算征途依旧漫漫

跨学科合作必不可少,全光计算征途依旧漫漫

评论