东南大学EGVSR: 基于GAN的实时超分系统

点击上方“机器学习与生成对抗网络”,关注星标

获取有趣、好玩的前沿干货!

来源:新智元 arXiv 编辑:Priscilla

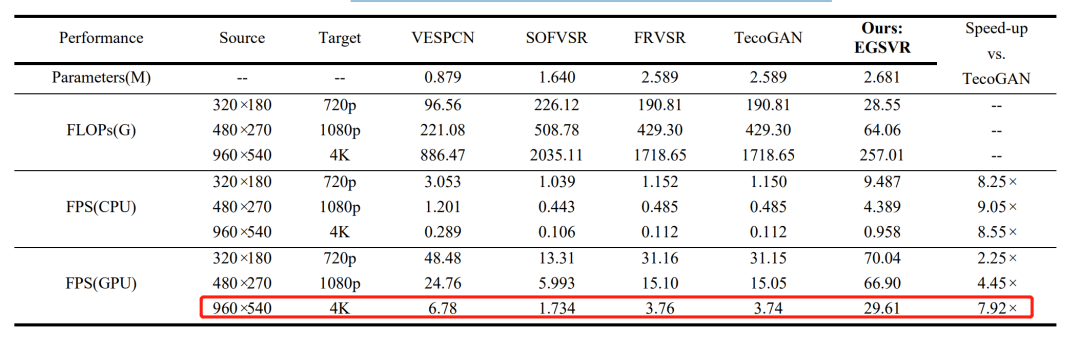

【新智元导读】东南大学研究团队最新提出的4K实时处理超分辨率系统(EGVSR)不仅能够修复高糊画质,运行速度还比TecoGAN快9倍,代码已开源。

什么是VSR?

GAN:重建视频质量的工具

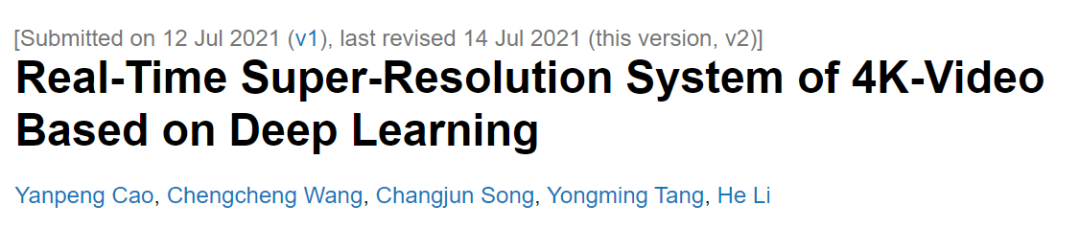

EGVSR生成器部分的框架和推理阶段的数据流

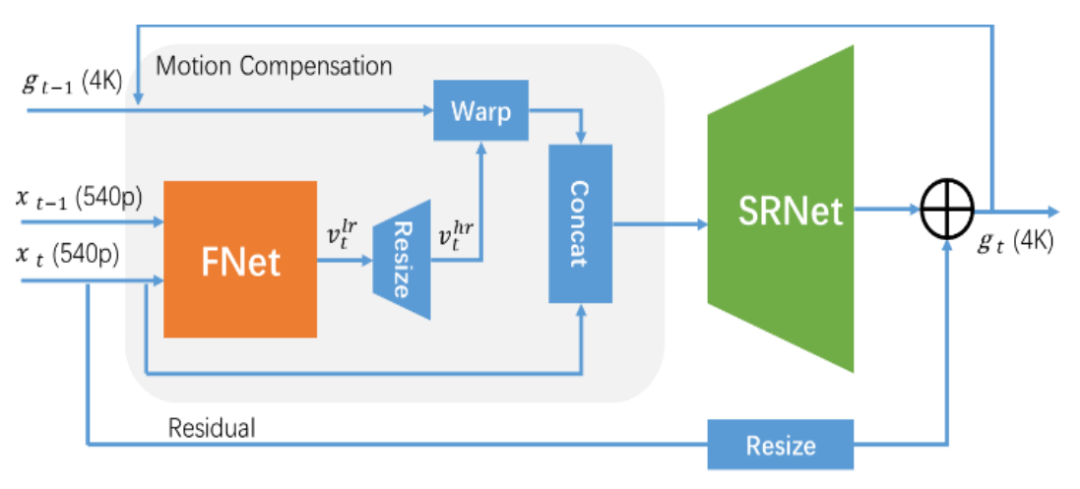

EGVSR生成器部分的框架和推理阶段的数据流快点,再快点!

快点,再快点!

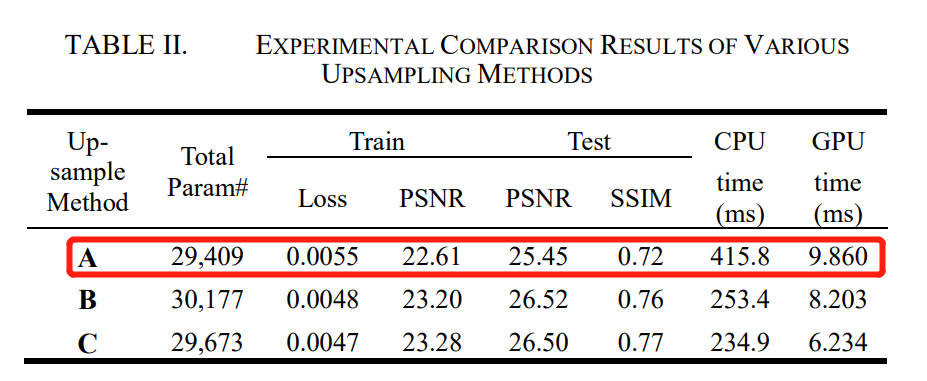

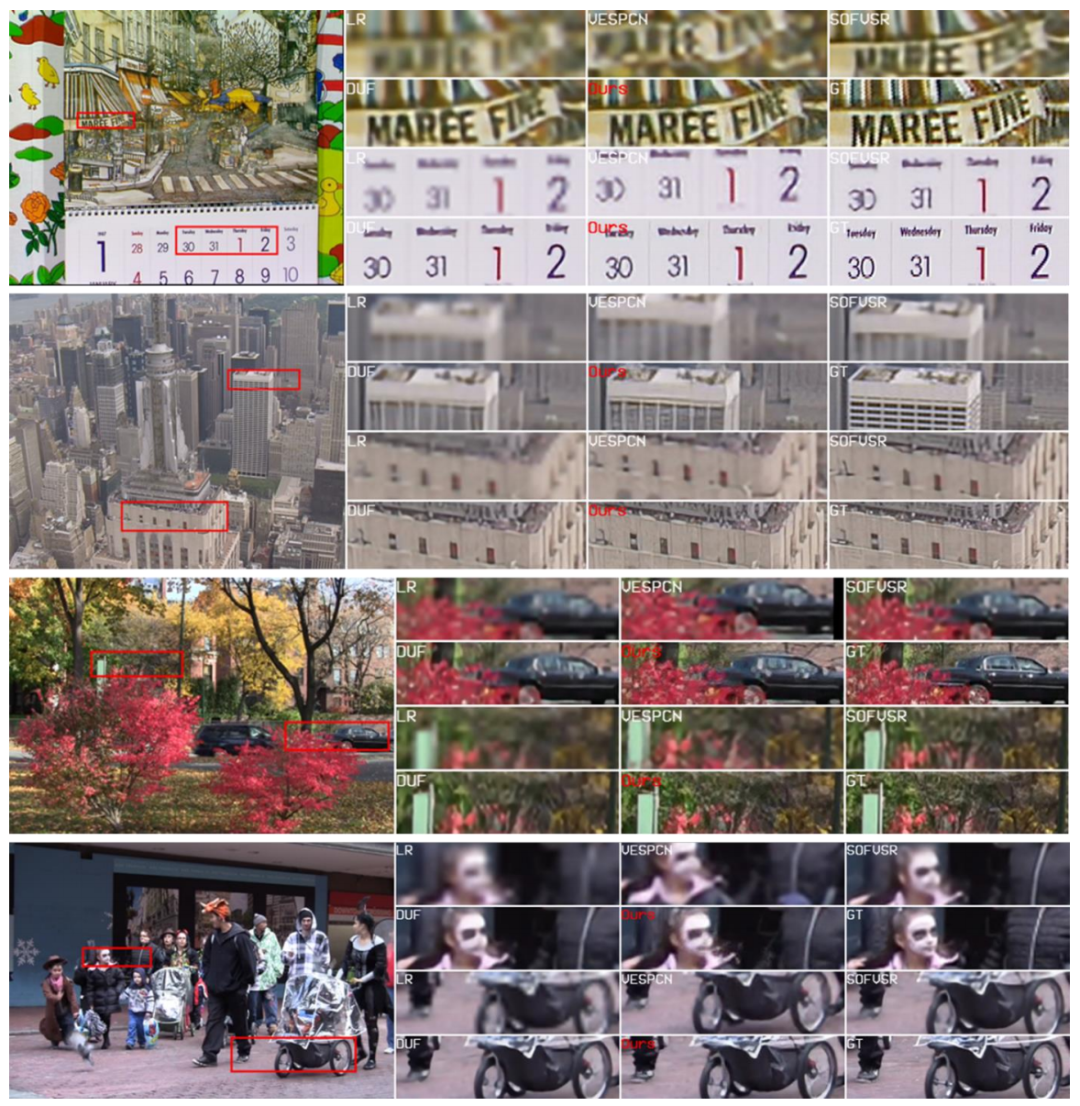

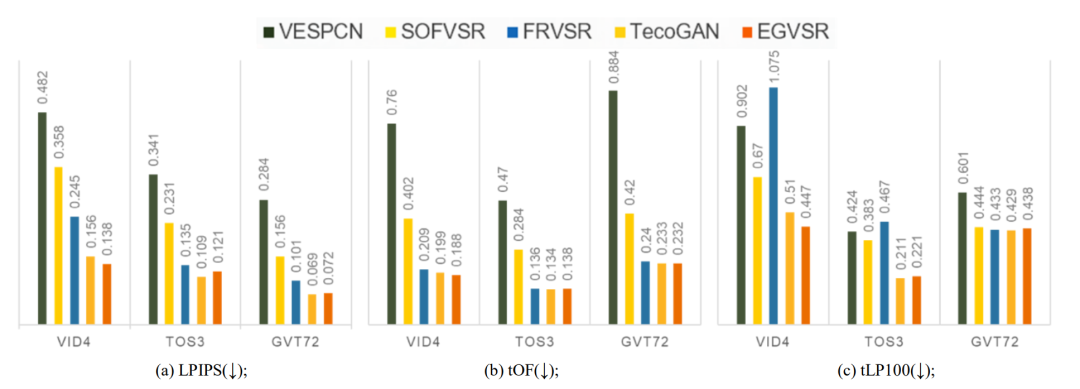

实验结果

实验结果

作者介绍

参考资料:

https://arxiv.org/abs/2107.05307

猜您喜欢:

CVPR 2021 | GAN的说话人驱动、3D人脸论文汇总

附下载 |《TensorFlow 2.0 深度学习算法实战》

附下载 | 超100篇!CVPR 2020最全GAN论文梳理汇总!

评论