Nature重磅:人类的这一能力,被AI掌握甚至超越了

本文约1800字,建议阅读5分钟

在该研究中,纽约大学心理学和数据科学助理教授 Brenden Lake 和西班牙加泰罗尼亚研究所(ICREA)教授 Marco Baroni 提出了一个具有类似人类系统泛化能力的神经网络。

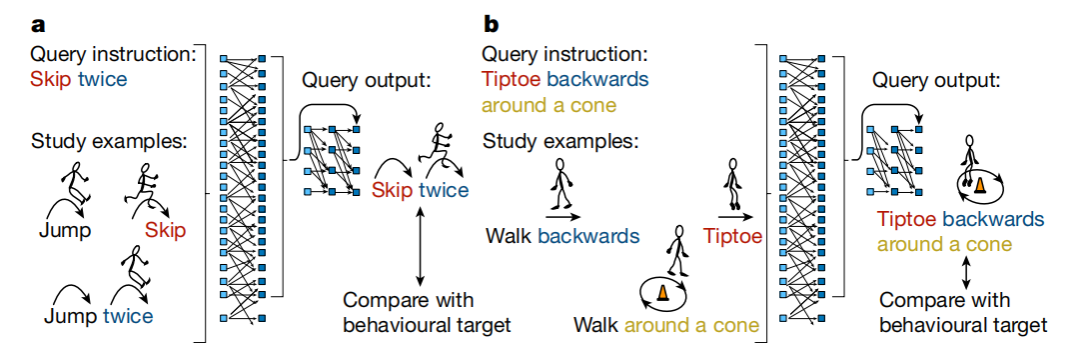

人们善于学习新概念,并将它们与已有概念进行系统组合。例如,一旦一个孩子学会了如何跳跃,他们可以通过组合技能理解如何向后跳或绕锥形物跳两次。

这种将新老概念结合的能力被称为系统泛化(systematic generalization)。

而此前,Jerry Fodor 和 Zenon Pylyshyn 两位认知科学家曾主张,人工神经网络缺乏这种能力,因此不适合作为人类认知的可靠模型。

然而,一篇发表在 Nature 上的最新研究挑战了这个已经存在了 35 年的观点。

在该研究中,纽约大学心理学和数据科学助理教授 Brenden Lake 和西班牙加泰罗尼亚研究所(ICREA)教授 Marco Baroni 提出了一个具有类似人类系统泛化能力的神经网络。

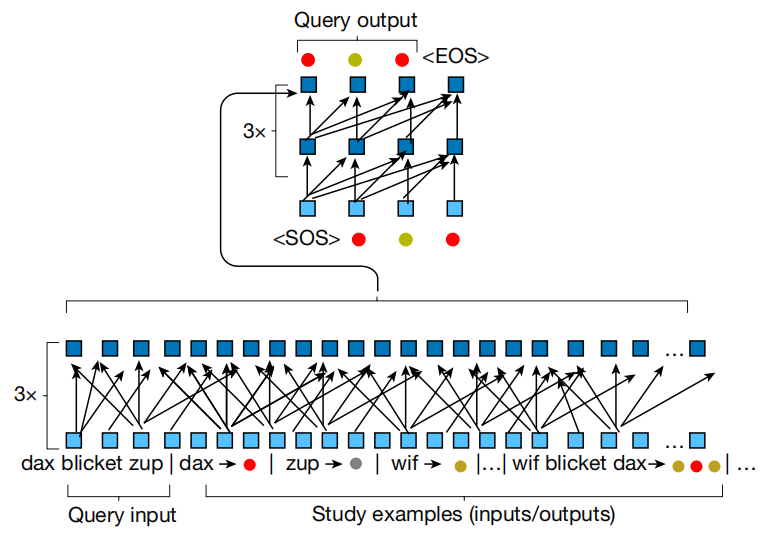

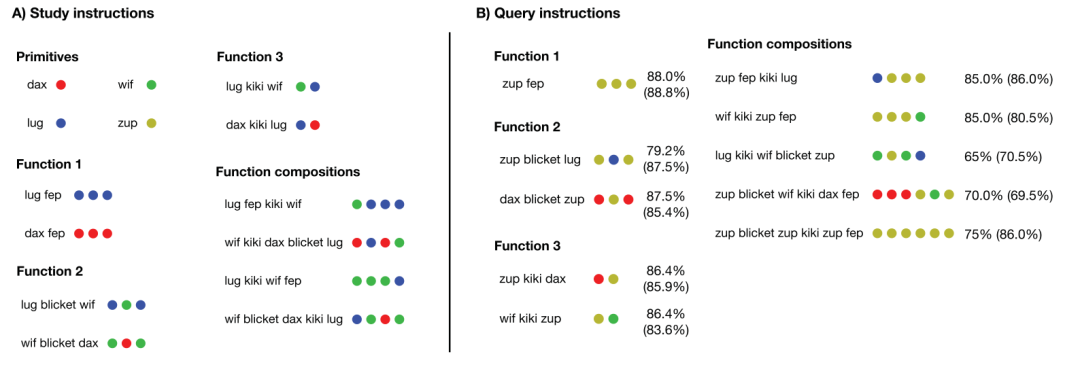

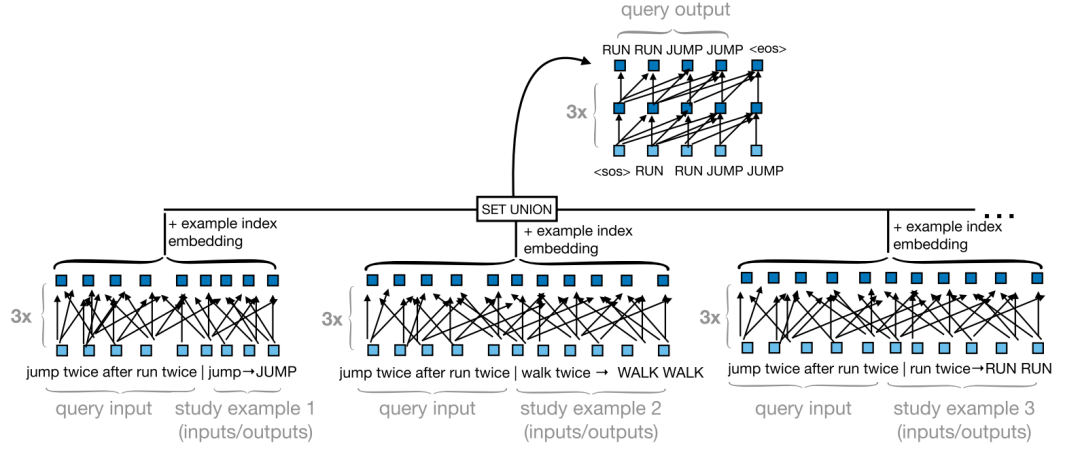

具体而言,研究团队使用了一种“组合性元学习(MLC)”的方法来优化组织能力。通过并行比较人类与神经网络,他们发现,MLC 能掌握、有时甚至能超过类似人类的系统泛化能力。另外,MLC 还在多个系统化泛化基准测试中提高了机器学习系统的组合技能。

该方法可以让机器与人进行更自然的互动,甚至超过目前最好的 AI 系统。虽然基于大型语言模型(LLMs)的系统(如 ChatGPT)在许多情况下都能很好地进行对话,但在其他情况下却表现出明显的缺陷和不一致。

相关论文以“Human-like systematic generalization through a meta-learning neural network”为题,已发表在权威科学期刊 Nature 上。

研究团队表示,虽然元学习方法无法让该神经网络对训练之外的任务进行泛化,但他们的研究结果有助于今后开发出行为更像人类大脑的 AI。

评论