【NeurIPS2022】几何知识蒸馏:图神经网络的拓扑压缩

来源:专知 本文为论文介绍,建议阅读5分钟

本文研究了一种知识迁移的新范式。

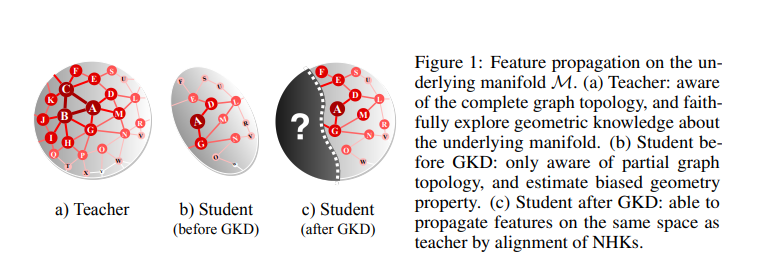

本文研究了一种知识迁移的新范式,旨在通过将知识从在完全图上训练的教师GNN模型提取到在更小或更稀疏的图上操作的学生GNN模型,将图拓扑信息编码到图神经网络(GNN)中。为此,我们回顾了热力学和GNN行为之间的联系,在此基础上,我们提出了神经热核(NHK)来封装与GNN体系结构有关的底层流形的几何特性。一个基本的和原则性的解决方案是通过对齐教师和学生模型的NHKs,称为几何知识蒸馏。我们开发了非参数实例化和参数化实例化,并在不同的实验设置中演示了它们的有效性,用于不同类型的特权拓扑信息和师生方案的知识蒸馏。

评论