多目标跟踪:监控领域你必须要了解的算法

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文转自|AI公园

对监控领域的目标跟踪方法以及面临的挑战进行了一个介绍,是一个很好的了解目标跟踪领域的“是什么”和“为什么”问题的文章。

在我们深入到目标跟踪的世界之前,我们必须理解监控世界的“为什么”和“是什么”。全球各国都安装了数百万个摄像头,但几乎没有人监控它们。人与摄像机的比例很小。

由于深度学习技术在监控领域的广泛应用,智能软件在过去十年中接管了监控领域。复杂的问题,如人员跟踪,交通密度估计,盗窃保护等,已经被世界各地的杰出研究人员解决了,并显示了巨大的前景。

本文将向你介绍智能监控中最重要的主题之一 —— 目标跟踪。

目标跟踪是指根据之前的信息估计场景中目标物体的状态。

在high level的抽象中,主要有两个层次的物体跟踪。

单目标跟踪(SOT) 多目标跟踪(MOT)

目标跟踪不局限于二维序列数据,可以应用于三维领域。

在本文中,我们将深入研究目标跟踪范式的一个子领域,即使用深度学习的二维视频序列中的多目标跟踪(MOT)。

深度神经网络(DNN)的强大之处在于它们能够学习丰富的表示,并从输入中提取复杂和抽象的特征。

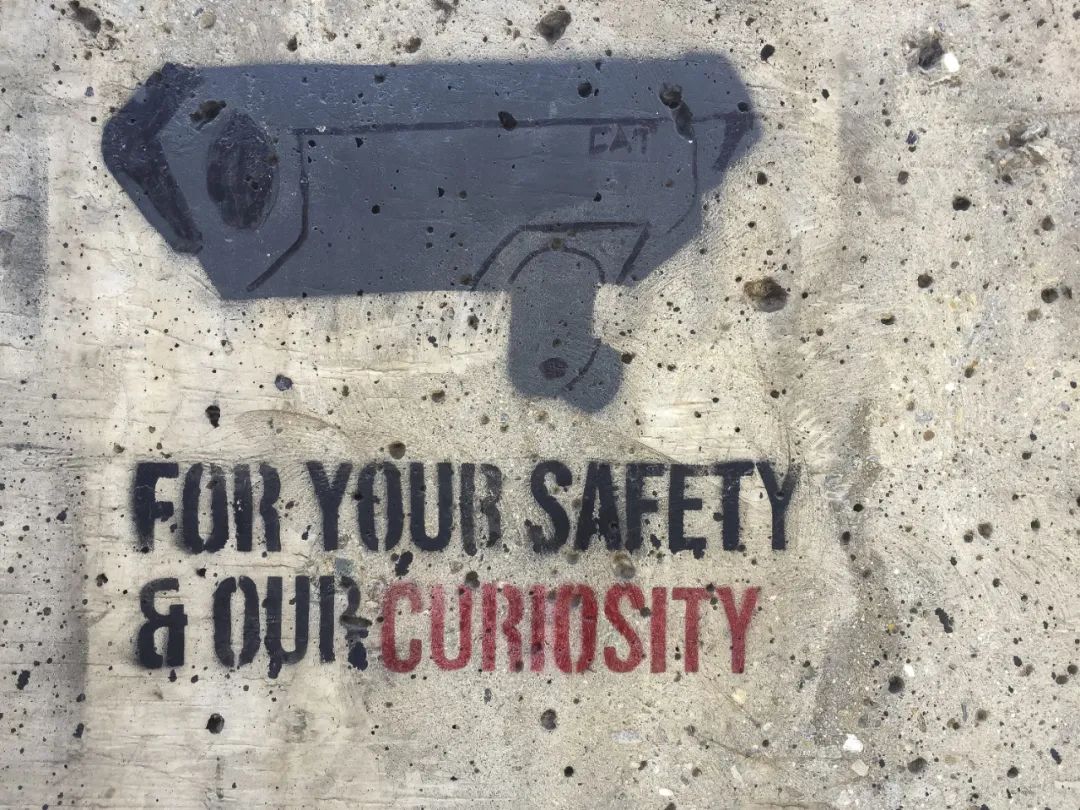

多目标跟踪(MOT),也称为多目标跟踪(MTT),是一种计算机视觉任务,旨在分析视频,以识别和跟踪属于一个或多个类别的对象,如行人,汽车,动物和无生命的物体,没有任何先验的目标外观和目标数量。

在单目标跟踪中,目标的出现是预先知道的,而在多目标跟踪中,需要一个检测步骤来识别出进入或离开场景的目标。同时跟踪多个目标的主要困难来自于各种各样的遮挡以及物体之间的相互重叠,有时物体间也会有相似的外观。因此,仅仅使用SOT模型直接解决MOT问题,往往会导致较差的结果,往往会导致目标漂移和大量的ID切换错误,因为此类模型往往难以区分外观相似的类内物体。

近年来,由于深度学习方法的研究呈指数级增长,检测和跟踪方法在准确性和性能方面取得了巨大的进步。

大多数先进的跟踪方法遵循“检测跟踪”的方案,他们首先在场景中找到对象,然后找到对象对应的tracklets(它在下一帧的位置)。

如今,这种探测器的性能异常出色,能够适应不同的场景。因此,它定义了跟踪算法的标准输入。

还有其他的方法,比如Lucas Kanade的光流,基于排序的跟踪等,它们在传统的计算机视觉方法的基础上表现也都很出色。

在解决目标跟踪问题时,会出现一些问题,这些问题会导致糟糕的结果。多年来,算法试图解决这些问题,但到目前为止,我们还没有找到一个被充分证明的解决办法,这仍然是一个开放的研究领域。

由于几何变化导致的多样性,如:姿态,关节,物体的尺度

由于光学因素的差异。例如:照明、外观 非线性运动 有限的分辨率,如从低端手机采集的视频 场景中有相似的物体,例如:相同颜色的衣服,配饰等 高度拥挤的场景,如街道,音乐会,体育馆,市场。

跟踪起始和终止。在开始任何跟踪算法之前,你需要想要跟踪的物体的先验信息。但是并不是一定可以使用目标对象初始化算法。 跟踪轨迹可能由于运动的突然变化导致合并和切换,比如相机成像质量的急剧变化等。

由于相似的特征,如相似的衣服,面部结构,眼镜,肤色,身高等,目标物体的ID可能被切换。 目标模型更新错误导致漂移。一次错误的更新可能会导致在错误的方向上持续的更新,从而在整个视频中遗忘掉正确的目标。

现在你已经了解了这个问题的广泛性,让我们深入研究对象跟踪领域中一些最令人兴奋的研究工作。

在目标跟踪领域领先的研究方法的筛选标准是基于5 关键指标:

主要会议(如:CVPR, NeurIPS, ICCV, ICML, ECCV等) 基准测试结果(例如,MOT, Kitti, VOT, CVPR19挑战) 支持论文结果的公开代码(由作者/第三方提供)。 引用 新的想法

有太多令人兴奋的研究工作。但是,如果作者不能提供代码(可能是由于一些原因)来重现论文中的结果,那么我们不得不对文档中提到的结果持保留态度。

我们已经提到了与2D MOT相关的论文,但有些想法也可以外推到3D版本。

这些只是精心挑选出来的一些非常好的跟踪领域的研究论文:

1、Tracking without bells and whistles.

论文:https://arxiv.org/pdf/1903.05625.pdf

代码:https://github.com/phil-bergmann/tracking_wo_bnw

2、Extending IOU Based Multi-Object Tracking by Visual Information.

论文:http://elvera.nue.tu-berlin.de/files/1547Bochinski2018.pdf

代码:https://github.com/bochinski/iou-tracker

3、Tracking Objects as Points.

论文:https://arxiv.org/pdf/2004.01177.pdf

代码:https://github.com/xingyizhou/CenterTrack

4、Fast Visual Object Tracking with Rotated Bounding Boxes

论文:https://arxiv.org/pdf/1907.03892v5.pdf

代码:https://github.com/baoxinchen/siammask_e

5、ODESA: Object Descriptor that is Smooth Appearance-wise for object tracking tasks

还没release,CVPR MOT 2019冠军。

6、Online Multiple Pedestrian Tracking using Deep Temporal Appearance Matching Association.

论文:https://arxiv.org/pdf/1907.00831.pdf

代码:暂无

好消息,小白学视觉团队的知识星球开通啦,为了感谢大家的支持与厚爱,团队决定将价值149元的知识星球现时免费加入。各位小伙伴们要抓住机会哦!

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~