哈工大刘挺:如何训练一个更强大的中文语言模型?

我们在比赛中实测了MacBERT,提分显著,最终在246支参赛队伍中获得了第3。

本文来带你了解这项更强大的中文语言模型 MacBERT。

论文链接

开源权重

https://github.com/ymcui/MacBERT

1. MacBERT是什么?

我们先简单回顾一下什么是BERT。

BERT本质上是一个自编码语言模型,为了见多识广,BERT使用3亿多词语训练,采用12层双向Transformer架构。注意,BERT只使用了Transformer的编码器部分,可以理解为BERT旨在学习庞大文本的内部语义信息。

input: 欲把西[mask]比西子,淡[mask]浓抹总相宜

output: 欲把西[湖]比西子,淡[妆]浓抹总相宜相比之下,MacBERT 沿用了 BERT 的整体架构,主要在训练目标上做了改进。

Mac = MLM as correction,即校正的 mask 策略。

原始 BERT 模型的缺点之一是预训练和微调阶段任务不一致,pretrain 有 [mask] 字符,而 finetune 没有。

MacBERT 用目标单词的相似单词,替代被 mask 的字符,减轻了预训练和微调阶段之间的差距。

具体实现分2步:1)我们使用全词mask以及Ngram mask策略来替代随机mask,其中单词级别的1-gram到4-gram的比例为40%,30%,20%,10%。

2)抛弃 [mask] 字符,而是通过word2vec查找被考察单词的语义相似单词进行mask。在极少数情况下,当没有相似的单词时,会降级以使用随机单词替换。

最终,我们对15%的输入单词进行mask,其中80%替换为相似的单词,10%替换为随机单词,其余10%则保留原始单词。

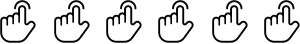

假设原始中文句子是“使用语言模型来预测下一个词的概率”。BEP切词后,按BERT的随机 masking 策略,可能得到:

1. 使 用 语 言 [M] 型 来 [M] 测 下 一 个 词 的 概 率。

如果加入全词掩码策略,会以实体为单位进行 masking:

2. 使 用 语 言 [M] [M] 来 [M] [M] 下 一 个 词 的 概 率。

继续加入 N-gram 掩码:

3. 使 用 [M] [M] [M] [M] 来 [M] [M] 下 一 个 词 的 概 率。

最后加入 Mac 掩码,用语义相似的词代替 [M]:

4. 使 用 语 法 建 模 来 预 见 下 一 个 词 的 几 率。

以上就是 MacBERT 的核心思想。

原始NSP已被证明贡献不大,MacBERT 引入了 ALBERT 的句子顺序预测(SOP)任务,通过切换两个连续句子的原始顺序来创建负样本。

后续的消融实验证明,SOP 效果好于 NSP。

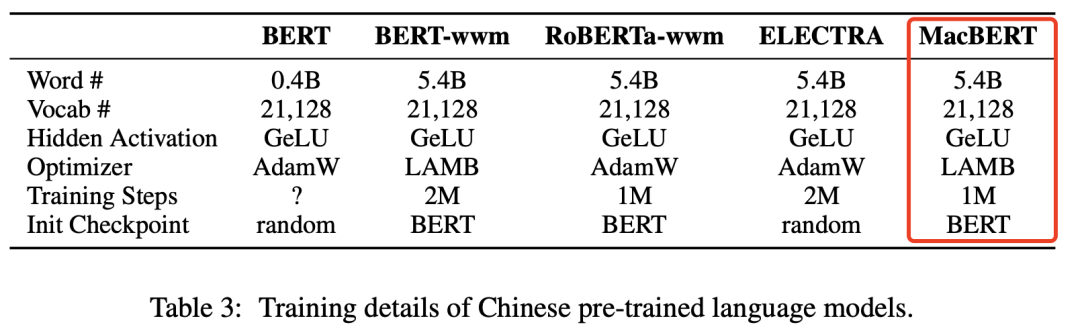

从中文维基百科中,我们获得了大约0.4B的单词。此外,还从收集的扩展数据中获得了 5.4B 个字,包含百科全书,新闻和问答网站,比中文维基百科大十倍。

为了识别中文单词的边界,我们使用LTP进行中文单词分割,词表沿用原始BERT。

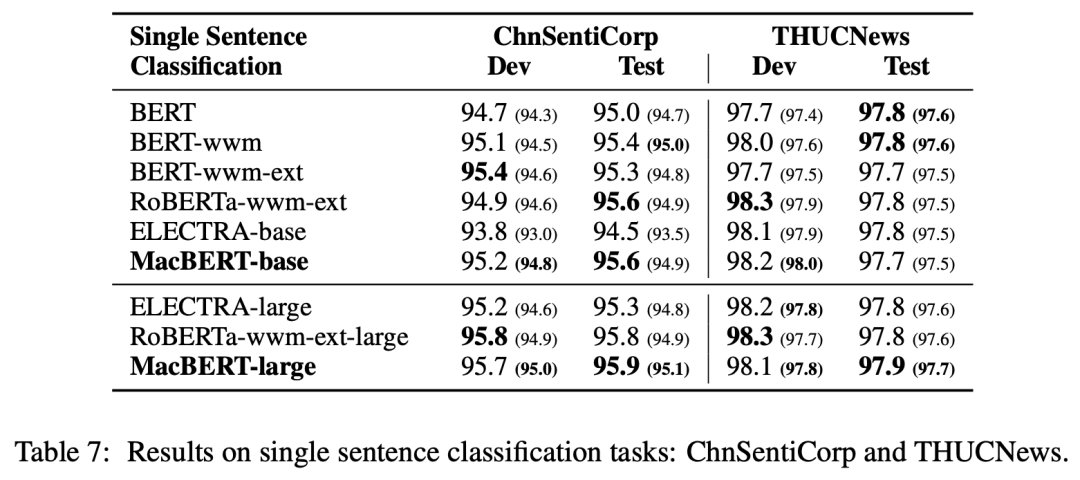

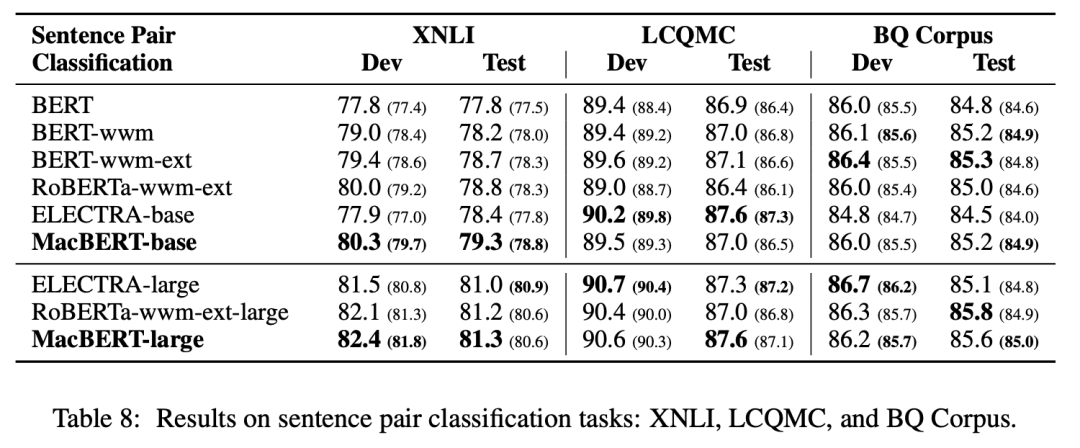

最终我们在分类、匹配、阅读理解等众多下游任务上对比了不同预训练模型的效果。

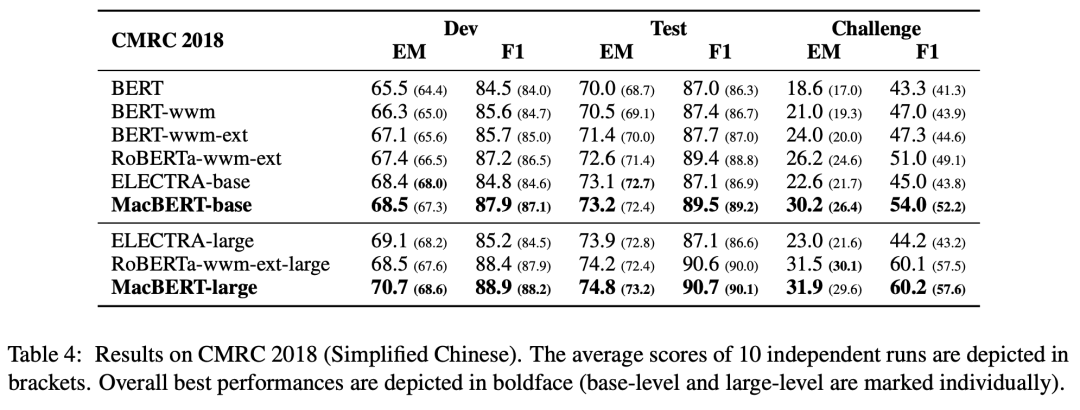

CMRC 2018 机器阅读理解:

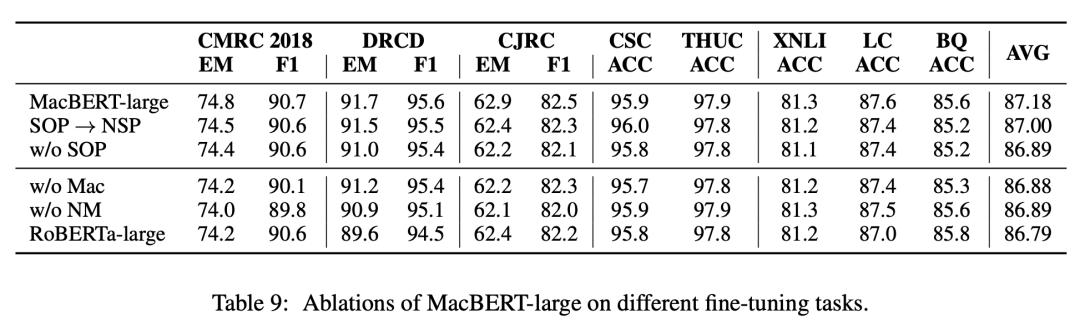

消融实验

MacBERT 将 MLM 任务作为一种语言校正方式进行了修改,减轻了预训练和微调阶段的差异。

下游各种中文NLP数据集的微调实验表明,MacBERT 可以在多数任务中获得显著收益。

通过分析消融实验,我们应该更多关注MLM任务,而不是NSP及其变体,因为类似NSP的任务并没有显示出彼此的压倒性优势。

这篇收录于 EMNLP 2020 子刊的论文,是对中文场景预训练语言模型的创新与尝试,由于模型结构并没有改动,可以很好地兼容现有任务(替换 checkpoint 和配置文件即可)。

感兴趣的小伙伴,快来动手试试吧!

——The End——