基于OpenCV的条形码区域分割

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本期,我们将一起学习如何从图像中提取出含有条形码的区域。下面的代码,我们将在Anaconda中采用Python 2.7 完成,当然OpenCV中的图像处理库也是必不可少的。

分割是识别图像内一个或多个对象的位置的过程。我们要介绍的技术其实非常简单,它利用了形态算子的扩张和侵蚀,以及诸如开运算,闭运算和黑帽算子的组合。

01.简介

安装Anaconda后,让我们从Anaconda的提示符下使用以下命令转到OpenCV安装:

conda install -c https://conda.anaconda.org/menpo opencv

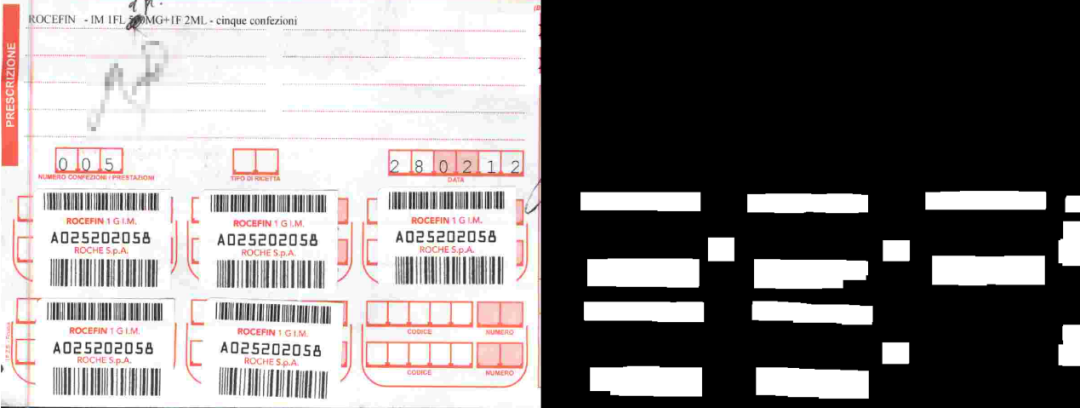

现在,让我们从Anaconda启动器启动Spyder IDE。

Anaconda启动器

一旦运行了Spyder,建议验证OpenCV安装是否成功。在Python控制台的右下角,我们进行以下测试:

import cv2代码讲解

我们已经创建了一个启动GitHub存储库。小伙伴可以使用以下方法直接克隆它:

git clone --branch step1https://github.com/lucapiccinelli/BarcodesTutorial.git

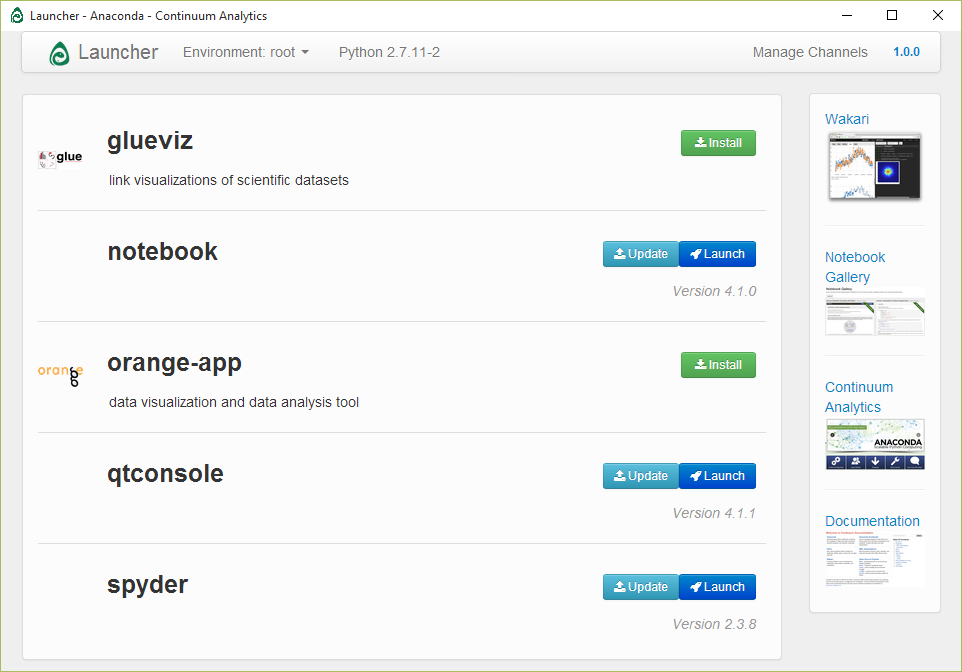

现在,我们将要下载测试图像,并对他们进行读取和显示。

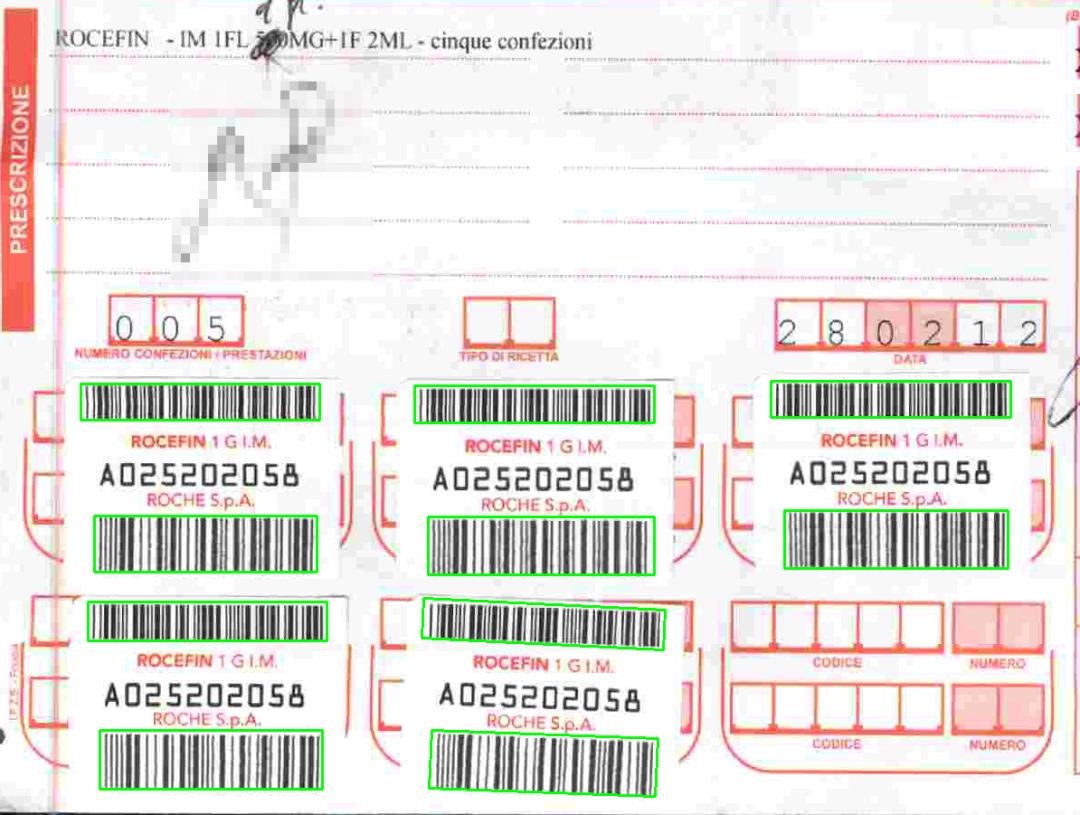

测试图片

import cv2import matplotlib.pyplot as pltim = cv2.imread(r’img\barcodes.jpg’, cv2.IMREAD_GRAYSCALE)plt.imshow(im, cmap=’Greys_r’)

接下来,我们将对图像进行二值化处理,这样可以通过阈值的设定来提取出我们感兴趣的部分。使用黑帽运算符,我们可以增加较暗的图像元素。我们可以首先使用简单的全局阈值安全地对图像进行二值化处理。黑帽运算符使我们可以使用非常低的阈值,而不必过多地关注噪声。

在应用blackhat时,我们使用的内核会更加重视垂直图像元素。内核具有固定的大小,因此可以缩放图像,这也可以提高性能(并支持某种输入归一化)。

黑帽+阈值处理

它遵循其他形态运算符的采用,顺序地将它们组合在一起以获得条形码位置中的连接组件。

#riscalatura dell'immaginescale = 800.0 / im.shape[1]im = cv2.resize(im, (int(im.shape[1] * scale), int(im.shape[0] * scale)))#blackhatkernel = np.ones((1, 3), np.uint8)im = cv2.morphologyEx(im, cv2.MORPH_BLACKHAT, kernel, anchor=(1, 0))#sogliaturathresh, im = cv2.threshold(im, 10, 255, cv2.THRESH_BINARY)

膨胀和闭合的这种组合在测试图像上效果很好,但可能无法在其他图像上达到相同的效果。这没有关系,大家可以尝试改变参数和运算符的组合,直到对结果满意为止。

膨胀+闭运算

最后的预处理步骤是应用具有很大内核的开运算符,以删除太少而无法适合条形码形状的元素。

kernel = np.ones((21, 35), np.uint8)im = cv2.morphologyEx(im, cv2.MORPH_OPEN, kernel, iterations=1)

这是我们希望得到的最终结果:

使用35x21内核打开

现在,我们可以运行连接的组件的检测算法,并检索带有坐标和尺寸的条形码矩形。如大家在上一张图像中所看到的那样,最后的形态学步骤并未滤除全部的噪声。但是,在这种情况下,将它们过滤掉非常简单,以矩形区域值作为阈值就可以了。

#rilettura dell'immagine, stavolta a coloriim_out = cv2.imread(r'img\barcodes.jpg')#estrazione dei componenti connessicontours, hierarchy = cv2.findContours(im, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_NONE)unscale = 1.0 / scaleif contours != None:for contour in contours:# se l'area non è grande a sufficienza la saltoif cv2.contourArea(contour) <= 2000:continue#estraggo il rettangolo di area minima (in formato (centro_x, centro_y), (width, height), angolo)rect = cv2.minAreaRect(contour)#l'effetto della riscalatura iniziale deve essere eliminato dalle coordinate rilevaterect = \((int(rect[0][0] * unscale), int(rect[0][1] * unscale)), \(int(rect[1][0] * unscale), int(rect[1][1] * unscale)), \rect[2])#disegno il tutto sull'immagine originalebox = np.int0(cv2.cv.BoxPoints(rect))cv2.drawContours(im_out, [box], 0, (0, 255, 0), thickness = 2)plt.imshow(im_out)#scrittura dell' immagine finalecv2.imwrite(r'img\out.png', im_out)

最后,在上面的代码中,我使用提取的矩形绘制它们,并将其覆盖在原始图像上。

最终结果,条形码以绿色框突出显示。

结论

• 提出的技术非常简单有效,但存在一些令人讨厌的缺点:

• 它对条形码偏斜非常敏感;它可以很好地工作到大约45度,然后您必须执行第二遍,修改内核的方向。

• 它只能在固定尺寸范围内找到条形码。

• 尽管对矩形区域施加了过滤,但仍有可能无法清除某些非条形码。

第一个和第二个可能不是真正的问题,但是最后一个可能会花费大家大量时间来尝试解码非条形码的内容。

一个很好的解决方案是将条形码特征(图像梯度,傅立叶变换)输入给神经网络(或一些其他一些分类器),并在第二时刻过滤掉噪声。

下面给出完整的示例代码。

import cv2import matplotlib.pyplot as pltimport numpy as npim = cv2.imread(r'img\barcodes.jpg', cv2.IMREAD_GRAYSCALE)im_out = cv2.imread(r'img\barcodes.jpg')#riscalatura dell'immaginescale = 800.0 / im.shape[1]im = cv2.resize(im, (int(im.shape[1] * scale), int(im.shape[0] * scale)))#blackhatkernel = np.ones((1, 3), np.uint8)im = cv2.morphologyEx(im, cv2.MORPH_BLACKHAT, kernel, anchor=(1, 0))#sogliaturathresh, im = cv2.threshold(im, 10, 255, cv2.THRESH_BINARY)#operazioni morfologichekernel = np.ones((1, 5), np.uint8)im = cv2.morphologyEx(im, cv2.MORPH_DILATE, kernel, anchor=(2, 0), iterations=2) #dilatazioneim = cv2.morphologyEx(im, cv2.MORPH_CLOSE, kernel, anchor=(2, 0), iterations=2) #chiusurakernel = np.ones((21, 35), np.uint8)im = cv2.morphologyEx(im, cv2.MORPH_OPEN, kernel, iterations=1)#estrazione dei componenti connessicontours, hierarchy = cv2.findContours(im, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_NONE)unscale = 1.0 / scaleif contours != None:for contour in contours:# se l'area non è grande a sufficienza la saltoif cv2.contourArea(contour) <= 2000:continue#estraggo il rettangolo di area minima (in formato (centro_x, centro_y), (width, height), angolo)rect = cv2.minAreaRect(contour)#l'effetto della riscalatura iniziale deve essere eliminato dalle coordinate rilevaterect = \((int(rect[0][0] * unscale), int(rect[0][1] * unscale)), \(int(rect[1][0] * unscale), int(rect[1][1] * unscale)), \rect[2])#disegno il tutto sull'immagine originalebox = np.int0(cv2.cv.BoxPoints(rect))cv2.drawContours(im_out, [box], 0, (0, 255, 0), thickness = 2)plt.imshow(im_out)#scrittura dell' immagine finalecv2.imwrite(r'img\out.png', im_out)

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~