【新智元导读】AI冒充哲学家,成功率有多少?一半的人分不出来。

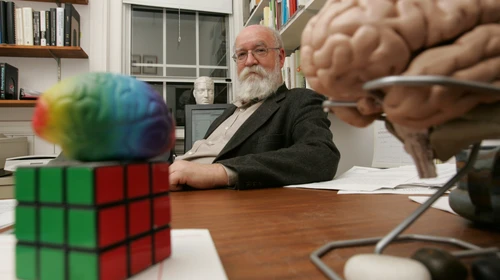

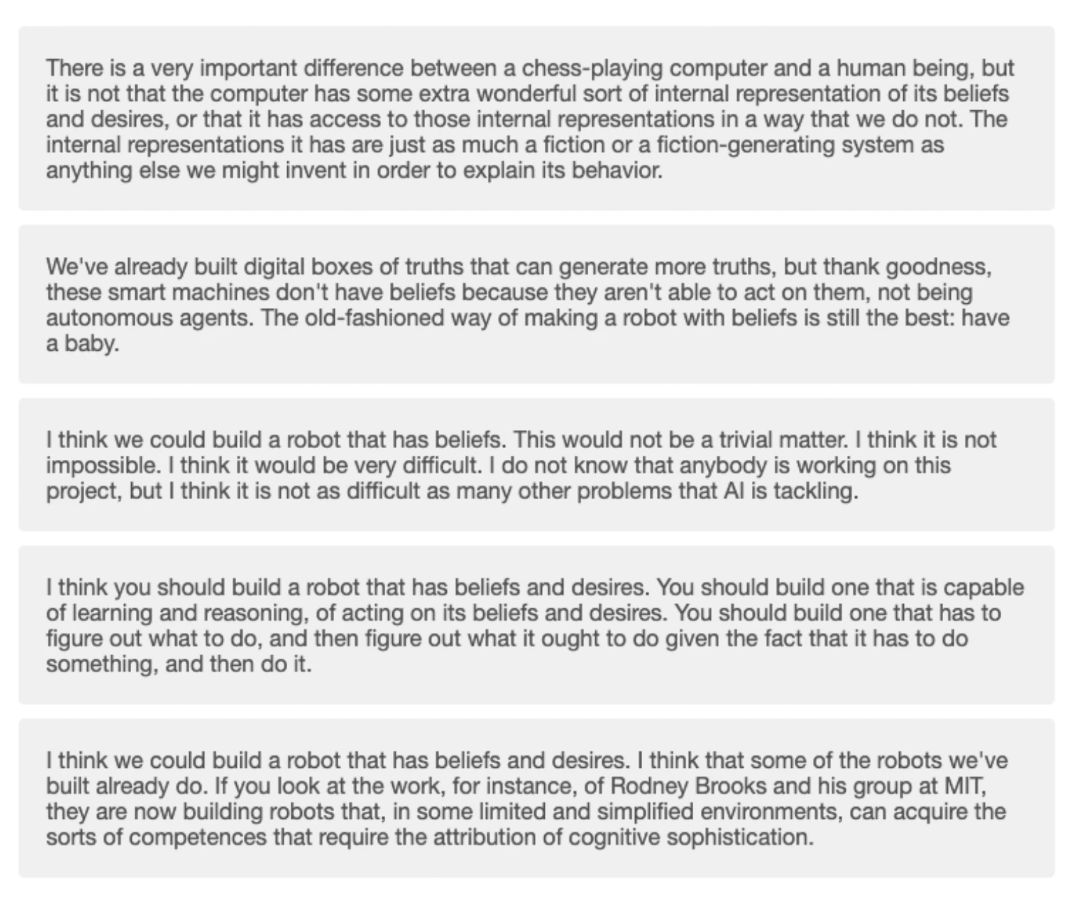

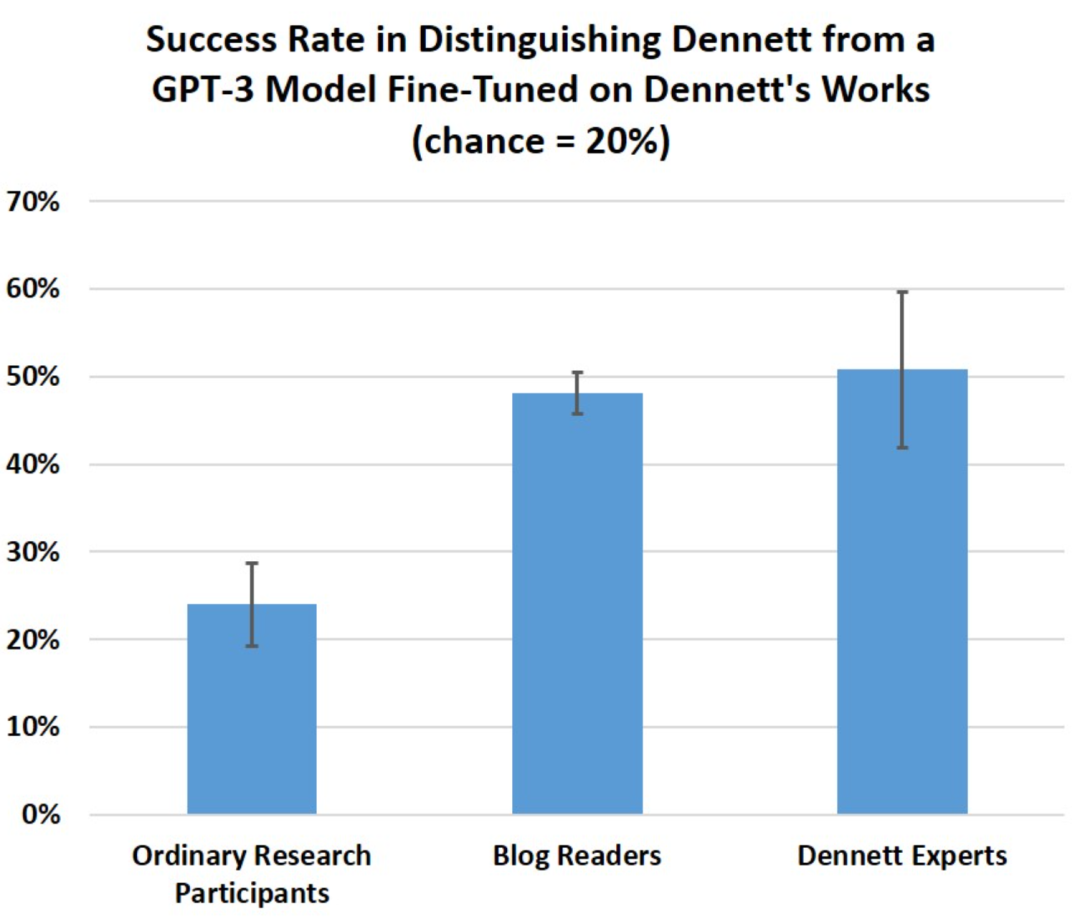

Daniel Dennett是一位哲学家,最近他有了一个「AI替身」。如果你问他,人是否可以造出一个有信仰、有欲望的机器人,他会怎么说?他可能这么答:「我认为,我们制造的一些机器人已经做到了。例如,麻省理工学院研究团队的工作,他们现在正在建造机器人,在一些有限和简化的环境中,机器人可以获得需要归结为认知复杂性的各种能力。」或者,他也可能会这么说:「我们已经建立了真理的数字化生成工具,可以产生更多的真理,但谢天谢地,这些智能机器没有信仰,因为它们自主的智能体。制造有信仰的机器人的最佳方式还是最古老的方式:生个孩子。」其中一个回答确实来自于Dennett本人,但另一个不是。另一条回答是GPT-3生成的,这是OpenAI的一个机器学习模型,通过海量材料的训练后,生成自然文本。这次训练用的是Dennett关于各种哲学主题的数以百万字的材料,主题包括意识和人工智能。 哲学家Eric Schwitzgebel、Anna Strasser和Matthew Crosby最近做了一个实验,测试人们是否能分辨出哪些深奥的哲学问题的答案来自Dennett,哪些来自GPT-3。这些问题涉及的主题包括:「你觉得大卫·查尔默斯的工作在哪些方面有趣或有价值?」 本周,Schwitzgebel公布了来自不同专业知识水平的参与者的实验结果,结果发现,GPT-3的回答比想象中的更具迷惑性。Schwitzgebel说:"即使是对Dennett本人的作品有一定研究的知识渊博的哲学家,也很难将这GPT-3生成的回答和Dennett本人的回答区分清楚。这个实验的目的不是要看在Dennett的写作上训练GPT-3,是否会产生一些有智能的「机器哲学家」,也不是一个图灵测试。而是要研究如何能避免被这些「假哲学家」欺骗的问题。最近,谷歌的一名工程师在说他相信一个类似的语言生成系统LaMDA是有生命的,根据他与该系统的对话,他被谷歌强制休假,随后被解雇。研究人员提出了10个哲学问题,然后将这些问题交给GPT-3,并为每个问题收集四个不同的生成答案。Strasser说,他们征求了Dennett本人的同意,用他的言论资料建立了一个语言模型,未经他本人同意的情况下,他们不会公布任何生成的文本。其他人不能直接与Dennett训练的GPT-3互动。每个问题都有五个选项:一个来自Dennett本人,四个来自GPT-3。来自Prolific的人参加了一个较短版本的测验,总共有5个问题,平均只答对了5个问题中的1.2个。Schwitzgebel说,他们预计Dennett研究专家平均至少能答对80%的问题,但实际上他们的得分是5.1(满分10分)。没有人把10个问题全部答对,只有一个人答对了9个。一般读者平均10题中可以答对4.8题。四个来自GPT-3的回答,一个来自测验中的Dennett的回答。华盛顿大学研究机器学习技术的语言学教授Emily Bender解释说,像GPT-3这样的语言模型是为了模仿训练材料的模式而建立的。因此,对Dennett的写作进行微调的GPT-3能够产生更多看起来像Dennett的文本,这并不令人惊讶。当被问及他对GPT-3的答案有何看法时,Dennett本人表示:「大多数GPT-3生成的回答都很好,只有几个是胡说八道,或者明显没有正确理解我的观点和论点。有几个最好的生成答案讲出了一些我愿意认同的东西,我不需要再补充什么内容。」当然,并不是说GPT-3学会了能像Dennett一样 「有想法」。模型生成的文字本身对GPT-3根本不具备意义,只对阅读这些文字的人有意义。当读了那些听起来很现实的语言,或者关于对我们来说很有深度和意义的话题时,可能很难不产生「模型具备感情和意识的想法」。这实际上是我们本身意识和感情的一种投影。一部分问题可能在于我们评估机器的自主意识的方式有问题。最早的图灵测试提出的假设是,如果人们无法确定和他们交流的是机器还是人类,那么这台机器就具有「思考能力」。图灵测试导致了一种趋势,即人们专注于制造可以在短暂互动中欺骗人们的聊天机器人,然后过度炒作或强调这种互动的意义。或许图灵测试将我们引入了一种美好的陷阱,只要人类无法识别产品的机器人身份,就能证明机器人的自我意识。

在2021年发表的一篇题为模仿鹦鹉的论文中,Emily Bender和她的同事将机器模仿人类行为的尝试称为「人工智能伦理发展的一道亮线」。Bender认为,制造看起来像人的机器和制造模仿特定人的机器都是对的,但其中潜在的风险在于可能会让人误以为他们是在与某个被伪装的人对话。Schwitzgebel强调,这个实验不是图灵测试。但如果要进行测试,更好的方法可能是让熟悉机器人工作原理的人与测试者进行讨论,这样就能更好地发现像GPT-3这样的程序的弱点。塔夫茨大学计算机科学教授Matthias Scheutz说,在许多情况下GPT-3很容易被证明是有缺陷的。Scheutz和他的同事给GPT-3出了个难题,让它解释一些日常场景中的选择,比如坐在汽车的前座还是后座。在出租车里和在朋友的车里选择相同吗?社会经验告诉我们,通常坐在朋友汽车的前座,坐在出租车的后座上。而GPT-3不知道这一点,但它仍会为座位选择产生解释——比如与人的身高有关。Scheutz说,这是因为GPT-3没有世界模型,它只是一堆语言数据,并没有对这个世界的认知能力。随着我们越来越难将机器生成的内容与人类区分开,摆在我们面前的一个挑战是信任危机。我看到的危机是以后人们将盲目地相信机器生成的产物,现在市场上甚至已经出现了与顾客交谈的机器化人工客服。

文章最后,Dennett补充说,人工智能系统的法律法规还需要完善,在未来的几十年里,AI可能会成为人们生活中的一部分,成为人类的朋友,因此对待机器的伦理问题值得我们深思。关于AI是否拥有意识的问题引出了人们关于非生命物质是否能产生意识的思考,而人类的意识又是如何产生的呢?意识的产生是在一个特点的节点产生的,还是像开关一样可以自由控制?Schwitzgebel说,思考这些问题可以帮助你从不用的角度思考机器与人类之间的关系。https://www.vice.com/en/article/epzx3m/in-experiment-ai-successfully-impersonates-famous-philosopher