贝叶斯优化可以说是一种黑盒优化算法,该算法用于求解表达式未知函数的极值问题。尽管贝叶斯优化的历史可以追溯到很久以前,但在过去的十年里,贝叶斯优化经历了一段复兴和快速发展的时期。复兴的主要驱动力是计算方面的进步,这使得贝叶斯建模和推理的工具越来越复杂。然而,具有讽刺意味的是,技术发展的关键动力根本不是贝叶斯,而是深度神经网络的兴起。但训练深度神经网络模型需要进行超参数优化,有研究者证明可以利用贝叶斯优化来解决这个问题。超参数优化被证明是贝叶斯优化的杀手级应用,随之而来出现了大量的关于开发新算法和改进旧算法的出版物。由于计算机科学出版模式的性质,关于贝叶斯的最新研究进展分散在几十篇简短的出版物中,这种模式有助于微小的细节,但从整理来看,不利于算法的发展。 来自华盛顿大学的 Roman Garnett 撰写了一本名为《 BAYESIAN OPTIMIZATION 》的书籍。这本书旨在为读者提供一个从零开始全面了解贝叶斯优化的过程,并细致的阐述了所有关键的想法。这种自下而上的方法允许我们在贝叶斯优化算法中确定统一的主题,这些主题可能在以往的调研文献时丢失。Garnett 主要研究兴趣是为不确定性下的序列决策开发新的贝叶斯机器学习方法。Garnett 还对科学发现的算法特别感兴趣,并获得了 NSF CAREER 奖以支持这项研究。此外,他还是「CSE 515T:机器学习中的贝叶斯方法」主讲老师。不过该书还不是最终版本,终稿将于 2022 年初由剑桥大学出版社出版。该书目标受众是机器学习、统计学等相关领域的研究人员或研究生。在阅读本书之前,你需要熟悉微分、积分、概率、线性代数、高斯分布。有时,书中的讨论会转向深奥的数学领域,对于这些内容读者可以忽略。

理论和实践部分的高斯过程建模;

序列决策方面的贝叶斯方法;

优化策略的实现。

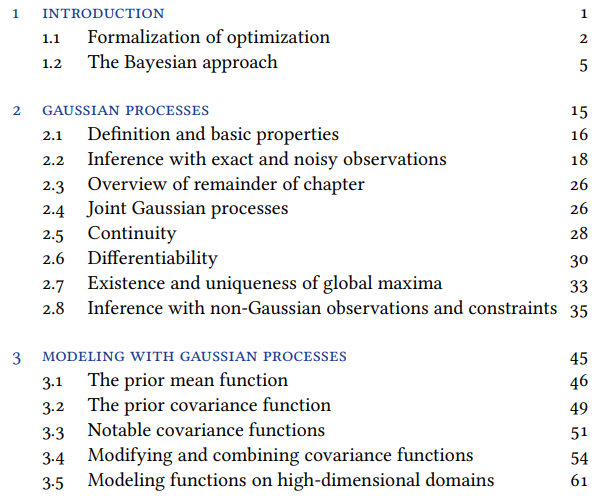

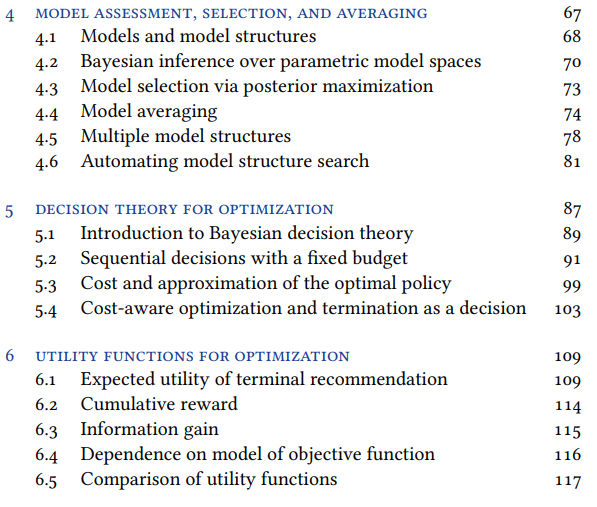

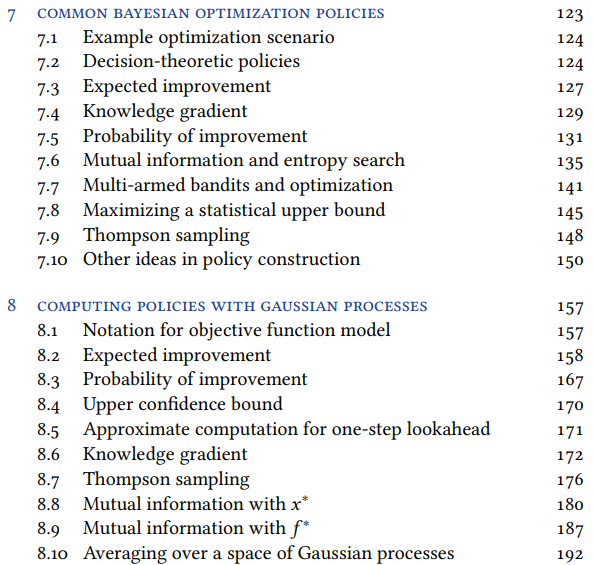

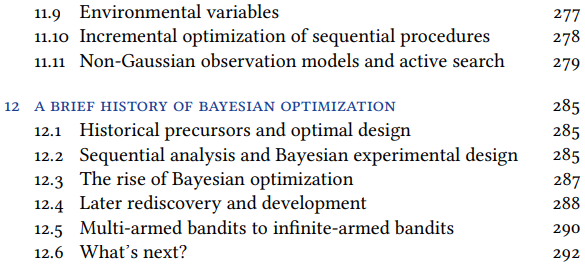

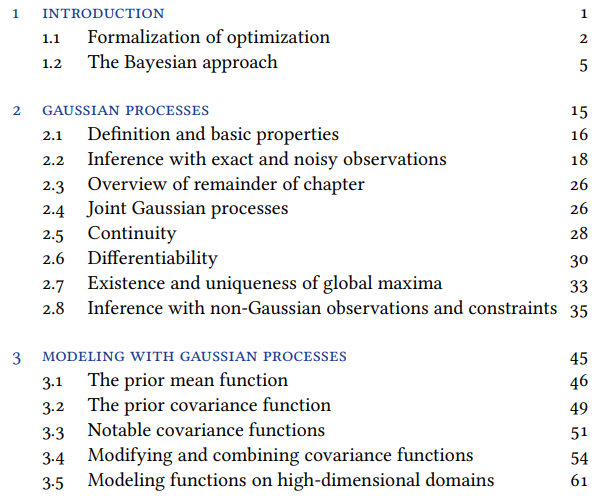

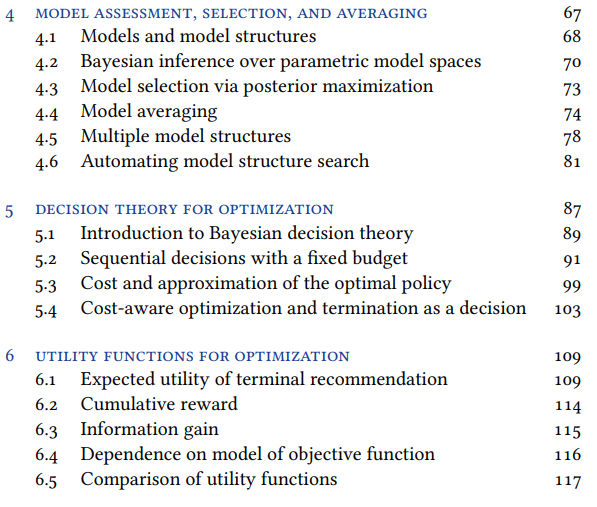

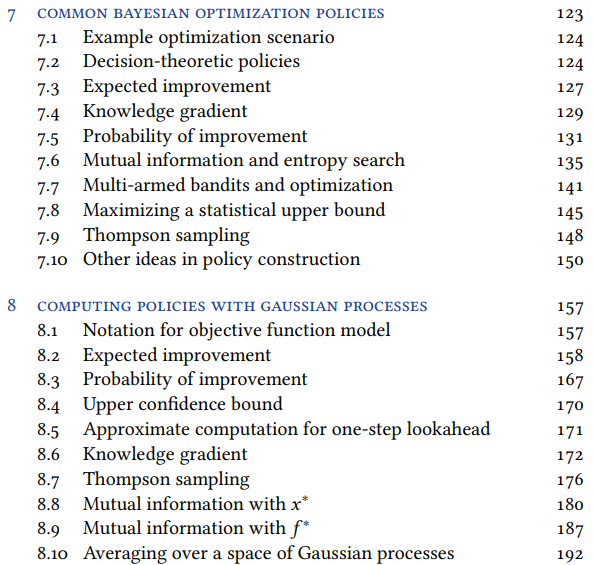

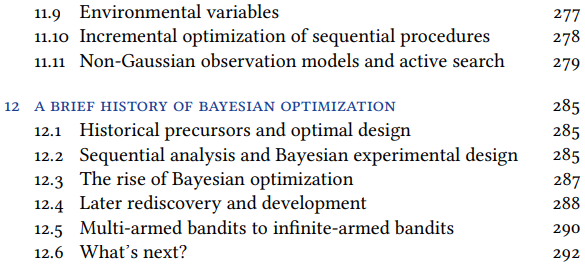

此外,该书还包括一些其他主题:理论收敛结果的概述;可扩展调查;贝叶斯优化发展史;在应用中带注释的参考书籍。具体而言,书籍主要分 12 个章节:包括引言;高斯过程;高斯过程建模;模型评估、选择和平均;优化决策理论;优化 Utility 函数;通用贝叶斯优化策略;高斯过程的计算策略;实现方式;理论分析;扩展和相关设置;贝叶斯优化发展史。

第 2-4 章介绍了高斯过程相关理论和高斯过程建模的实际应用。这类模型是贝叶斯优化文献中最受欢迎的,其中包含的材料对接下来的几章至关重要。

第 5-7 章介绍了序列决策及其在优化中的应用。尽管该理论需要一个目标函数模型和研究者对它的观察,但该介绍与模型的选择无关,可以独立于前面关于高斯过程的章节阅读。

第 8-9 章讨论了计算和实现的细节。

第 10 章讨论了贝叶斯优化算法的理论性能界限,其中大多数结果密切依赖于目标函数的高斯过程模型或相关的重新生成核希尔伯特空间。

第 11 章介绍了对这一基本设置的几个值得注意的扩展。每一个都是通过贝叶斯决策理论的统一视角系统地呈现出来的,以说明研究者在面对新情况时应该如何处理。

第 12 章介绍了关于贝叶斯优化思想方面的历史研究,包括一些重要的数学示例。此外,本章还记录了从 1962 年到现在关于贝叶斯优化方面的主要思想进展。