谷歌出品!机器学习常用术语总结

机器学习术语表

1A

A/B 测试 (A/B testing)

测试不仅旨在确定哪种技术的效果更好,而且还有助于了解相应差异是否具有显著的统计意义。A/B

测试通常是采用一种衡量方式对两种技术进行比较,但也适用于任意有限数量的技术和衡量方式。

准确率 (accuracy)

激活函数 (activation function)

型函数),用于对上一层的所有输入求加权和,然后生成一个输出值(通常为非线性值),并将其传递给下一层。

AdaGrad

ROC 曲线下面积 (AUC, Area under the ROC Curve)

曲线下面积是,对于随机选择的正类别样本确实为正类别,以及随机选择的负类别样本为正类别,分类器更确信前者的概率。

2B

反向传播算法 (backpropagation)

基准 (baseline)

批次 (batch)

批次大小 (batch size)

1,而小批次的大小通常介于 10 到 1000

之间。批次大小在训练和推断期间通常是固定的;不过,TensorFlow

允许使用动态批次大小。

偏差 (bias)

二元分类 (binary classification)

分箱 (binning)

分桶 (bucketing)

0.0 到 15.0 度之间的所有温度都归入一个分箱,将介于 15.1 到 30.0

度之间的所有温度归入第二个分箱,并将介于 30.1 到 50.0

度之间的所有温度归入第三个分箱。

3C

校准层 (calibration layer)

候选采样 (candidate sampling)

softmax)针对所有正类别标签计算概率,但对于负类别标签,则仅针对其随机样本计算概率。例如,如果某个样本的标签为"小猎犬"和"狗",则候选采样将针对"小猎犬"和"狗"类别输出以及其他类别(猫、棒棒糖、栅栏)的随机子集计算预测概率和相应的损失项。这种采样基于的想法是,只要正类别始终得到适当的正增强,负类别就可以从频率较低的负增强中进行学习,这确实是在实际中观察到的情况。候选采样的目的是,通过不针对所有负类别计算预测结果来提高计算效率。

分类数据 (categorical data)

house style的分类特征为例,该特征拥有一组离散的可能值(共三个),即Tudor, ranch, colonial。通过将 house style表示成分类数据,相应模型可以学习 Tudor、ranch 和 colonial分别对房价的影响。car maker分类特征可能只允许一个样本有一个值(

Toyota)。在其他情况下,则可以应用多个值。一辆车可能会被喷涂多种不同的颜色,因此,car color分类特征可能会允许单个样本具有多个值(例如 red 和 white)。形心 (centroid)

个形心。

检查点 (checkpoint)

类别 (class)

分类不平衡的数据集 (class-imbalanced data set)

的样本具有正类别标签,0.9999

的样本具有负类别标签,这就属于分类不平衡问题;但在某个足球比赛预测器中,0.51

的样本的标签为其中一个球队赢,0.49

的样本的标签为另一个球队赢,这就不属于分类不平衡问题。

分类模型 (classification model)

分类阈值 (classification threshold)

0.9,那么逻辑回归值高于 0.9 的电子邮件将被归类为"垃圾邮件",低于 0.9

的则被归类为"非垃圾邮件"。

聚类 (clustering)

标记为"矮型树",将聚类 2 标记为"全尺寸树"。

协同过滤 (collaborative filtering)

混淆矩阵 (confusion matrix)

表格,用于总结分类模型的预测效果;即标签和模型预测的分类之间的关联。在混淆矩阵中,一个轴表示模型预测的标签,另一个轴表示实际标签。N

表示类别个数。在二元分类问题中,N=2。例如,下面显示了一个二元分类问题的混淆矩阵示例:

个归类为有肿瘤(18 个正例),错误地将 1 个归类为没有肿瘤(1

个假负例)。同样,在 458 个实际没有肿瘤的样本中,模型归类正确的有 452

个(452 个负例),归类错误的有 6 个(6 个假正例)。

4 错误地预测为 9,将 7 错误地预测为 1。

连续特征 (continuous feature)

收敛 (convergence)

Optimization(《凸优化》)。

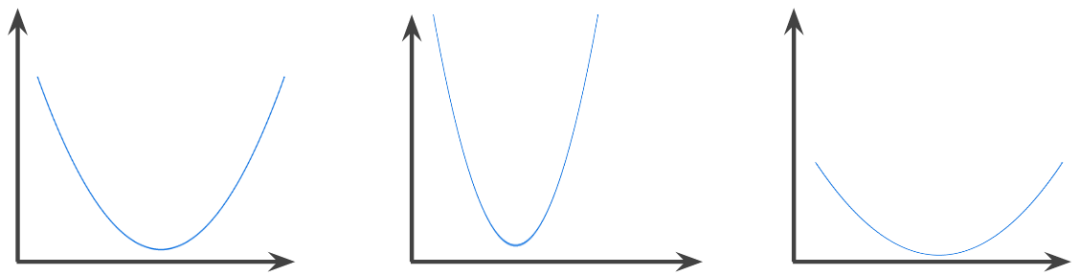

凸函数 (convex function)

U。

形函数都是严格凸函数。不过,有些凸函数(例如直线)则不是这样。

损失函数 对数损失函数 正则化 正则化

凸优化 (convex optimization)

Optimization(《凸优化》)。

凸集 (convex set)

卷积 (convolution)

2K x 2K 图像训练的机器学习算法将被迫找出 400

万个单独的权重。而使用卷积,机器学习算法只需在卷积过滤器中找出每个单元格的权重,大大减少了训练模型所需的内存。在应用卷积过滤器后,它只需跨单元格进行复制,每个单元格都会与过滤器相乘。

卷积过滤器 (convolutional filter)

28×28 的输入矩阵为例,过滤器可以是小于 28×28 的任何二维矩阵。

0。在机器学习中,卷积过滤器通常先选择随机数字,然后由网络训练出理想值。

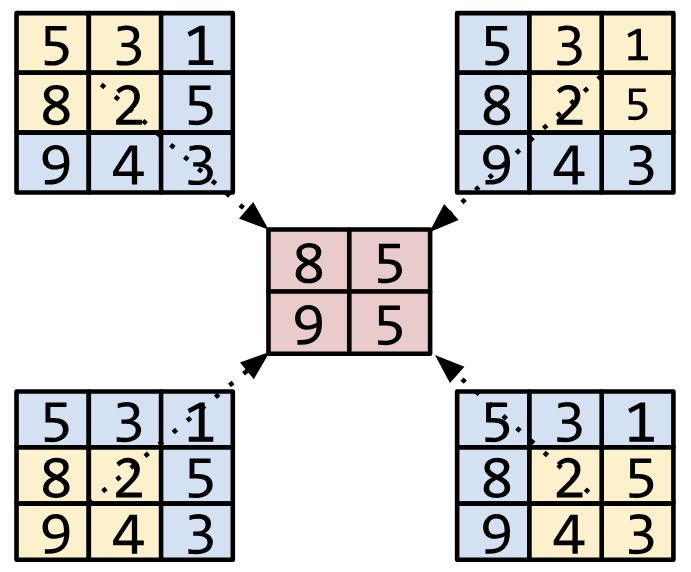

卷积层 (convolutional layer)

3x3 卷积过滤器为例:

输入矩阵)组成的卷积层。请注意,每个卷积运算都涉及一个不同的 3x3

输入矩阵切片。由此产生的 3×3 矩阵(右侧)就包含 9 个卷积运算的结果:

卷积神经网络 (convolutional neural network)

卷积层 池化层 密集层

卷积运算 (convolutional operation)

对卷积过滤器和输入矩阵切片执行元素级乘法。(输入矩阵切片与卷积过滤器具有相同的等级和大小。) 对生成的积矩阵中的所有值求和。

输入矩阵切片。例如,假设我们使用输入矩阵左上角的 2x2

切片。这样一来,对此切片进行卷积运算将如下所示:

成本 (cost)

交叉熵 (cross-entropy)

自定义 Estimator (custom Estimator)

4D

数据分析 (data analysis)

DataFrame

类似于表格。DataFrame

的每一列都有一个名称(标题),每一行都由一个数字标识。

数据集 (data set)

Dataset API (tf.data)

API,用于读取数据并将其转换为机器学习算法所需的格式。

tf.data.Dataset对象表示一系列元素,其中每个元素都包含一个或多个张量。tf.data.Iterator对象可获取 Dataset 中的元素。编程人员指南》中的导入数据[4]。

决策边界 (decision boundary)

密集层 (dense layer)

深度模型 (deep model)

密集特征 (dense feature)

设备 (device)

离散特征 (discrete feature)

丢弃正则化 (dropout regularization)

Overfitting(《丢弃:一种防止神经网络过拟合的简单方法》)。

动态模型 (dynamic model)

5E

早停法 (early stopping)

嵌套 (embeddings)

表示成包含百万个元素(高维度)的稀疏向量,其中所有元素都是整数。向量中的每个单元格都表示一个单独的英文单词,单元格中的值表示相应单词在句子中出现的次数。由于单个英文句子包含的单词不太可能超过

50 个,因此向量中几乎每个单元格都包含 0。少数非 0

的单元格中将包含一个非常小的整数(通常为

1),该整数表示相应单词在句子中出现的次数。表示成包含数百个元素(低维度)的密集向量,其中每个元素都存储一个介于

0 到 1 之间的浮点值。这就是一种嵌套。

中,会按反向传播损失训练嵌套,和训练神经网络中的任何其他参数一样。

经验风险最小化 (ERM, empirical risk minimization)

集成学习 (ensemble)

不同的初始化 不同的超参数 不同的整体结构

周期 (epoch)

N/批次大小)次训练迭代,其中N 是样本总数。Estimator

tf.Estimator 类的一个实例,用于封装负责构建 TensorFlow 图并运行TensorFlow 会话的逻辑。您可以创建自定义

Estimator(如需相关介绍,请点击此处[6]),也可以实例化其他人预创建的

Estimator。

样本 (example)

6F

假负例 (FN, false negative)

假正例 (FP, false positive)

假正例率(false positive rate, 简称 FP 率)

特征 (feature)

特征列 (tf.feature_column)

tf.feature_column函数,模型可对输入特征的不同表示法轻松进行实验。有关详情,请参阅《TensorFlow编程人员指南》中的特征列[7]一章。

特征组合 (feature cross)

特征工程 (feature engineering)

TensorFlow 中,特征工程通常是指将原始日志文件条目转换为tf.Example 协议缓冲区。另请参阅tf.Transform[10]。

特征集 (feature set)

特征规范 (feature spec)

协议缓冲区只是一个数据容器,因此您必须指定以下内容:

要提取的数据(即特征的键) 数据类型(例如 float 或 int) 长度(固定或可变)

少量样本学习 (few-shot learning)

完整 softmax (full softmax)

全连接层 (fully connected layer)

7G

泛化 (generalization)

广义线性模型 (generalized linear model)

逻辑回归 多类别回归 最小二乘回归

最优的最小二乘回归模型的平均预测结果等于训练数据的平均标签。 最优的逻辑回归模型预测的平均概率等于训练数据的平均标签。

梯度 (gradient)

梯度裁剪 (gradient clipping)

梯度下降法 (gradient descent)

图 (graph)

中的一种计算规范。图中的节点表示操作。边缘具有方向,表示将某项操作的结果(一个张量[15])作为一个操作数传递给另一项操作。可以使用TensorBoard 直观呈现图。

8H

启发法 (heuristic)

隐藏层 (hidden layer)

合页损失函数 (hinge loss)

维持数据 (holdout data)

超参数 (hyperparameter)

超平面 (hyperplane)

9I

独立同等分布 (i.i.d, independently and identically distributed)

是机器学习的理想气体[16] -

一种实用的数学结构,但在现实世界中几乎从未发现过。例如,某个网页的访问者在短时间内的分布可能为

i.i.d.,即分布在该短时间内没有变化,且一位用户的访问行为通常与另一位用户的访问行为无关。不过,如果将时间窗口扩大,网页访问者的分布可能呈现出季节性变化。

推断 (inference)

输入函数 (input function)

输入层 (input layer)

实例 (instance)

可解释性 (interpretability)

评分者间一致性信度 (inter-rater agreement)

kappa(最热门的评分者间一致性信度衡量指标之一)。

迭代 (iteration)

10K

k-means

算法基本上会执行以下操作:

以迭代方式确定最佳的 k 中心点(称为形心)。 将每个样本分配到最近的形心。与同一个形心距离最近的样本属于同一个组。

算法会挑选形心位置,以最大限度地减小每个样本与其最接近形心之间的距离的累积平方。

算法会确定三个形心。每个样本都被分配到与其最接近的形心,最终产生三个组:

应用于仅具有两个特征(高度和宽度)的样本。请注意,k-means

可以跨多个特征为样本分组。

k-median

对于

k-means,确定形心的方法是,最大限度地减小候选形心与它的每个样本之间的距离平方和。对于

k-median,确定形心的方法是,最大限度地减小候选形心与它的每个样本之间的距离总和。

k-means

采用从形心到样本的欧几里得距离[18]。(在二维空间中,欧几里得距离即使用勾股定理来计算斜边。)例如,(2,2)

与 (5,-2) 之间的 k-means 距离为:

k-median

采用从形心到样本的曼哈顿距离[19]。这个距离是每个维度中绝对差异值的总和。例如,(2,2)

与 (5,-2) 之间的 k-median 距离为:

Keras

作为tf.keras[21]提供)。

核支持向量机 (KSVM, Kernel Support Vector Machines)

可以在内部将这些特征映射到百万维度的空间。KSVM

使用合页损失函数。

11L

损失函数 ( loss)

正则化 ( regularization)

0,从而将这些特征从模型中移除。与 正则化相对。

损失函数 ( loss)

正则化 ( regularization)

0。(与 L1 正则化相对。)在线性模型中, 正则化始终可以改进泛化。

标签 (label)

有标签样本 (labeled example)

lambda

层 (layer)

函数,以张量和配置选项作为输入,然后生成其他张量作为输出。当必要的张量组合起来后,用户便可以通过模型函数将结果转换为Estimator。

Layers API (tf.layers)

API,用于以层组合的方式构建深度神经网络。通过 Layers

API,您可以构建不同类型的层,例如:

通过 tf.layers.Dense构建全连接层。通过 tf.layers.Conv2D构建卷积层。

规范。也就是说,除了前缀不同以外,Layers API 中的所有函数均与 Keras

layers API 中的对应函数具有相同的名称和签名。

学习速率 (learning rate)

最小二乘回归 (least squares regression)

线性回归 (linear regression)

逻辑回归 (logistic regression)

型函数应用于线性预测,生成分类问题中每个可能的离散标签值的概率。虽然逻辑回归经常用于二元分类问题,但也可用于多类别分类问题(其叫法变为多类别逻辑回归或多项回归)。

对数 (logits)

函数的输入。之后,softmax

函数会生成一个(标准化)概率向量,对应于每个可能的类别。

型函数的元素级反函数。如需了解详细信息,请参阅sigmoid cross entropy with logits[22]。

对数损失函数 (Log Loss)

对数几率 (log-odds)

之比。例如,假设某个给定事件的成功概率为 90%,失败概率为

10%。在这种情况下,几率的计算公式如下:

1 的数。若遵循惯例,上述示例的对数几率应为:

损失 (Loss)

12M

机器学习 (machine learning)

均方误差 (MSE, Mean Squared Error)

的计算方法是平方损失除以样本数。TensorFlow

Playground显示的"训练损失"值和"测试损失"值都是 MSE。

指标 (metric)

Metrics API (tf.metrics)

tf.metrics.accuracy用于确定模型的预测与标签匹配的频率。在编写自定义Estimator 时,您可以调用 Metrics API

函数来指定应如何评估您的模型。

小批次 (mini-batch)

10 到 1000

之间。与基于完整的训练数据计算损失相比,基于小批次数据计算损失要高效得多。

小批次随机梯度下降法 (SGD, mini-batch stochastic gradient descent)

SGD 会根据一小部分训练数据来估算梯度。Vanilla SGD使用的小批次的大小为 1。

ML

模型 (model)

一种 TensorFlow 图,用于表示预测的计算结构。 该 TensorFlow

图的特定权重和偏差,通过训练决定。

模型函数 (model function)

Estimator,则有人已为您编写了模型函数。如果使用自定义

Estimator,则必须自行编写模型函数。

Estimator。

模型训练 (model training)

动量 (Momentum)

多类别分类 (multi-class classification)

种,因此,确定枫树种类的模型就属于多类别模型。反之,仅将电子邮件分为两类("垃圾邮件"和"非垃圾邮件")的模型属于二元分类模型。

多项分类 (multinomial classification)

13N

NaN 陷阱 (NaN trap)

NaN。

负类别 (negative class)

神经网络 (neural network)

神经元 (neuron)

节点 (node)

隐藏层中的神经元。 TensorFlow 图中的操作。

标准化 (normalization)

1)的过程。例如,假设某个特征的自然区间是 800 到

6000。通过减法和除法运算,您可以将这些值标准化为位于 -1 到 +1 区间内。

数值数据 (numerical data)

200 平方米的房子是面积为 100

平方米的房子的两倍。此外,房子面积的平方米数可能与房价存在一定的数学关系。

20000 在效力上并不是邮政编码 10000的两倍(或一半)。此外,虽然不同的邮政编码确实与不同的房地产价值有关,但我们也不能假设邮政编码为

20000 的房地产在价值上是邮政编码为 10000

的房地产的两倍。邮政编码应表示成分类数据。

Numpy

中提供高效的数组操作。Pandas 建立在 Numpy 之上。

14O

目标 (objective)

离线推断 (offline inference)

独热编码 (one-hot encoding)

一个元素设为 1。 所有其他元素均设为 0。

15000

个不同的物种,其中每个物种都用独一无二的字符串标识符来表示。在特征工程过程中,您可能需要将这些字符串标识符编码为独热向量,向量的大小为

15000。

单样本学习(one-shot learning,通常用于对象分类)

一对多 (one-vs.-all)

个单独的二元分类器 -

一个二元分类器对应一种可能的结果。例如,假设某个模型用于区分样本属于动物、蔬菜还是矿物,一对多解决方案将提供下列三个单独的二元分类器:

动物和非动物 蔬菜和非蔬菜 矿物和非矿物

在线推断 (online inference)

操作 (op, Operation)

中,任何创建、操纵或销毁张量的过程都属于操作。例如,矩阵相乘就是一种操作,该操作以两个张量作为输入,并生成一个张量作为输出。

优化器 (optimizer)

的优化器基类是tf.train.Optimizer[25]。不同的优化器可能会利用以下一个或多个概念来增强梯度下降法在指定训练集中的效果:

动量[26](Momentum) 更新频率(AdaGrad[27]= ADAptive GRADient

descent;Adam[28]= ADAptive with Momentum;RMSProp)稀疏性/正则化

(Ftrl[29])更复杂的数学方法(Proximal[30],等等)

离群值 (outlier)

绝对值很高的权重。 与实际值相差很大的预测值。 值比平均值高大约 3 个标准偏差的输入数据。

输出层 (output layer)

过拟合 (overfitting)

15P

Pandas

数据结构作为输入。请参阅 Pandas 文档[32]。

参数 (parameter)

参数服务器 (PS, Parameter Server)

参数更新 (parameter update)

偏导数 (partial derivative)

划分策略 (partitioning strategy)

性能 (performance)

在软件工程中的传统含义。即:相应软件的运行速度有多快(或有多高效)? 在机器学习中的含义。在机器学习领域,性能旨在回答以下问题:相应模型的准确度有多高?即模型在预测方面的表现有多好?

困惑度 (perplexity)

(P)

是:为了使列出的字词中包含用户尝试输入的实际字词,您需要提供的猜测项的个数。

流水线 (pipeline)

池化 (pooling)

3x3 矩阵为例:

1x1 步长将卷积矩阵分割为 2x2

个切片。如下图所示,进行了四个池化运算。假设每个池化运算都选择该切片中四个值的最大值:

正类别 (positive class)

精确率 (precision)

预测 (prediction)

预测偏差 (prediction bias)

预创建的 Estimator (pre-made Estimator)

提供了一些预创建的 Estimator,包括

DNNClassifier、DNNRegressor 和LinearClassifier。您可以按照这些说明[33]构建自己预创建的Estimator。

预训练模型 (pre-trained model)

先验信念 (prior belief)

0 为中心呈正态分布。

16Q

队列 (queue)

I/O 中。

17R

等级 (rank)

张量中的维数。例如,标量等级为 0,向量等级为

1,矩阵等级为 2。在将类别从最高到最低进行排序的机器学习问题中,类别的顺序位置。例如,行为排序系统可以将狗狗的奖励从最高(牛排)到最低(枯萎的羽衣甘蓝)进行排序。

评分者 (rater)

召回率 (recall)

修正线性单元 (ReLU, Rectified Linear Unit)

如果输入为负数或 0,则输出 0。 如果输入为正数,则输出等于输入。

回归模型 (regression model)

正则化 (regularization)

正则化 正则化 丢弃正则化 早停法(这不是正式的正则化方法,但可以有效限制过拟合)

正则化率 (regularization rate)

表示,用于指定正则化函数的相对重要性。从下面简化的损失公式中可以看出正则化率的影响:

表示法 (representation)

受试者工作特征曲线(receiver operating characteristic,简称 ROC 曲线)

根目录 (root directory)

均方根误差 (RMSE, Root Mean Squared Error)

旋转不变性 (rotational invariance)

18S

SavedModel

是一种独立于语言且可恢复的序列化格式,使较高级别的系统和工具可以创建、使用和转换

TensorFlow 模型。

编程人员指南》中的保存和恢复[34]。

Saver

对象,负责保存模型检查点。

缩放 (scaling)

0 到 1 区间内,如果某个特征的值位于 0 到 500

区间内,您就可以通过将每个值除以 500 来缩放该特征。

scikit-learn

半监督式学习 (semi-supervised learning)

序列模型 (sequence model)

会话 (tf.session)

运行时状态的对象,用于运行全部或部分图。在使用底层

TensorFlow API 时,您可以直接创建并管理一个或多个

tf.session对象。在使用 Estimator API 时,Estimator 会为您创建会话对象。S 型函数 (sigmoid function)

0 到 1 之间的值。S 型函数的公式如下:

型函数可作为激活函数使用。

大小不变性 (size invariance)

200 万像素还是 20

万像素呈现,该算法仍然可以识别它。请注意,即使是最好的图像分类算法,在大小不变性方面仍然会存在切实的限制。例如,对于仅以

20 像素呈现的猫图像,算法(或人)不可能正确对其进行分类。

softmax

1.0。例如,softmax 可能会得出某个图像是狗、猫和马的概率分别是 0.9、0.08

和 0.02。(也称为完整 softmax。)

稀疏特征 (sparse feature)

或为空。例如,某个向量包含一个为 1 的值和一百万个为 0

的值,则该向量就属于稀疏向量。再举一个例子,搜索查询中的单词也可能属于稀疏特征

在某种指定语言中有很多可能的单词,但在某个指定的查询中仅包含其中几个。

稀疏表示法 (sparse representation)

要采用密集表示法来表示此句子,则必须为所有一百万个单元格设置一个整数,然后在大部分单元格中放入

0,在少数单元格中放入一个非常小的整数。要采用稀疏表示法来表示此句子,则仅存储象征句子中实际存在的单词的单元格。因此,如果句子只包含

20 个独一无二的单词,那么该句子的稀疏表示法将仅在 20

个单元格中存储一个整数。

tails."。如下表所示,密集表示法将使用约一百万个单元格;稀疏表示法则只使用

3 个单元格:

稀疏性 (sparsity)

10x10 矩阵(其中 98 个单元格都包含 0)为例。稀疏性的计算方法如下:

空间池化 (spatial pooling)

平方合页损失函数 (squared hinge loss)

平方损失函数 (squared loss)

静态模型 (static model)

平稳性 (stationarity)

9 月到 12 月,表明平稳性的数据没有发生变化。

步 (step)

步长 (step size)

随机梯度下降法 (SGD, stochastic gradient descent)

依赖于从数据集中随机均匀选择的单个样本来计算每步的梯度估算值。

结构风险最小化 (SRM, structural risk minimization)

期望构建最具预测性的模型(例如损失最低)。 期望使模型尽可能简单(例如强大的正则化)。

步长 (stride)

(1,1)

步长。因此,下一个输入切片是从上一个输入切片向右移动一个步长的位置开始。当运算到达右侧边缘时,下一个切片将回到最左边,但是下移一个位置。

下采样 (subsampling)

总结 (summary)

中的某一步计算出的一个值或一组值,通常用于在训练期间跟踪模型指标。

监督式机器学习 (supervised machine learning)

合成特征 (synthetic feature)

对连续特征进行分桶,以分为多个区间分箱。 将一个特征值与其他特征值或其本身相乘(或相除)。 创建一个特征组合。

19T

目标 (target)

时态数据 (temporal data)

张量 (Tensor)

可能非常大)数据结构,最常见的是标量、向量或矩阵。张量的元素可以包含整数值、浮点值或字符串值。

张量处理单元 (TPU, Tensor Processing Unit)

张量等级 (Tensor rank)

张量形状 (Tensor shape)

在一个维度中的形状为 5,在另一个维度中的形状为 10。

张量大小 (Tensor size)

TensorBoard

程序期间保存的摘要信息。

TensorFlow

层,该层支持对数据流图进行一般计算。

主要应用于机器学习领域,但也可用于需要使用数据流图进行数值计算的非机器学习任务。

TensorFlow Playground

TensorFlow Playground,请前往

TensorFlow Serving

测试集 (test set)

tf.Example

时间序列分析 (time series analysis)

训练 (training)

训练集 (training set)

迁移学习 (transfer learning)

平移不变性 (translational invariance)

负例 (TN, true negative)

正例 (TP, true positive)

正例率(true positive rate, 简称 TP 率)

20U

无标签样本 (unlabeled example)

非监督式机器学习 (unsupervised machine learning)

(PCA)。例如,通过对包含数百万购物车中物品的数据集进行主成分分析,可能会发现有柠檬的购物车中往往也有抗酸药。

21V

验证集 (validation set)

22W

权重 (weight)

0,则相应的特征对模型来说没有任何贡献。

宽度模型 (wide model)

[3] 自定义 estimator 说明: https://www.tensorflow.org/extend/estimators?hl=zh-CN

[4] 导入数据: https://www.tensorflow.org/programmers_guide/datasets?hl=zh-CN

[5] 深度模型和宽度模型: https://www.tensorflow.org/tutorials/wide_and_deep?hl=zh-CN

[6] 自定义 estimator 说明: https://www.tensorflow.org/extend/estimators?hl=zh-CN

[7] 特征列: https://www.tensorflow.org/get_started/feature_columns?hl=zh-CN

[8] VW: https://en.wikipedia.org/wiki/Vowpal_Wabbit

[9] 场: https://www.csie.ntu.edu.tw/~cjlin/libffm/

[10] tf.Transform: https://github.com/tensorflow/transform

[11] 高斯噪声: https://en.wikipedia.org/wiki/Gaussian_noise

[12] 泊松噪声: https://en.wikipedia.org/wiki/Shot_noise

[13] 凸优化: https://en.wikipedia.org/wiki/Convex_optimization

[14] 梯度爆炸: http://www.cs.toronto.edu/~rgrosse/courses/csc321_2017/readings/L15%20Exploding%20and%20Vanishing%20Gradients.pdf

[15] 张量: https://www.tensorflow.org/api_docs/python/tf/Tensor?hl=zh-CN

[16] 理想气体: https://en.wikipedia.org/wiki/Ideal_gas

[17] 统计学推断: https://en.wikipedia.org/wiki/Statistical_inference

[18] 欧几里得距离: https://en.wikipedia.org/wiki/Euclidean_distance

[19] 曼哈顿距离: https://en.wikipedia.org/wiki/Taxicab_geometry

[20] Keras: https://keras.io

[21] tf.keras: https://www.tensorflow.org/api_docs/python/tf/keras?hl=zh-CN

[22] sigmoid cross entropy: https://www.tensorflow.org/api_docs/python/tf/nn/sigmoid_cross_entropy_with_logits?hl=zh-CN

[23] NaN: https://en.wikipedia.org/wiki/NaN

[24] 开放源代码数学库: http://www.numpy.org/

[25] tf.train.Optimizer: https://www.tensorflow.org/api_docs/python/tf/train/Optimizer?hl=zh-CN

[26] 动量: https://www.tensorflow.org/api_docs/python/tf/train/MomentumOptimizer?hl=zh-CN

[27] AdaGrad: https://www.tensorflow.org/api_docs/python/tf/train/AdagradOptimizer?hl=zh-CN

[28] Adam: https://www.tensorflow.org/api_docs/python/tf/train/AdamOptimizer?hl=zh-CN

[29] Ftrl: https://www.tensorflow.org/api_docs/python/tf/train/FtrlOptimizer?hl=zh-CN

[30] Proximal: https://www.tensorflow.org/api_docs/python/tf/train/ProximalGradientDescentOptimizer?hl=zh-CN

[31] NN 驱动的优化器: https://arxiv.org/abs/1606.04474

[32] Pandas 文档: http://pandas.pydata.org/

[33] 自定义Estimator说明: https://www.tensorflow.org/extend/estimators?hl=zh-CN

[34] 保存和恢复: https://www.tensorflow.org/programmers_guide/saved_model?hl=zh-CN

[35] www.scikit-learn.org: http://www.scikit-learn.org/

[36] http://playground.tensorflow.org: http://playground.tensorflow.org?hl=zh-CN

[37] 协议缓冲区: https://developers.google.com/protocol-buffers/?hl=zh-CN

[38] 原文链接: https://developers.google.com/machine-learning/glossary/?hl=zh-CN

评论