让AI做决策,我们的社会准备好了吗?

大数据文摘授权转载自学术头条

随着技术的加速发展,人工智能(AI)在决策过程中发挥着越来越重要的作用。人类越来越依赖算法来处理信息、推荐某些行为,甚至代表他们采取行动。

但是,如果真的让 AI 帮助、甚至代替我们来做决策,尤其是涉及主观的、道德伦理相关的决策,你能接受吗?

近日,一个来自广岛大学的研究小组探究了人类对引入人工智能决策的反应。具体来说,他们通过研究人类与自动驾驶汽车的互动,探讨了一个问题:“社会准备好接受人工智能道德决策了吗?”

该团队于 2022 年 5 月 6 日在 Journal of Behavioral and Experimental Economics 上发表了他们的发现。

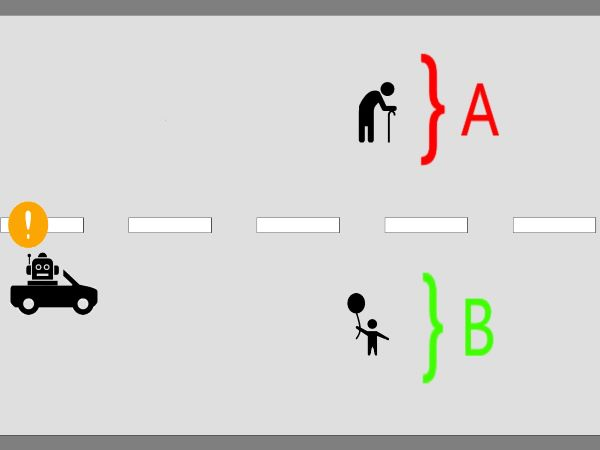

在第一个实验中,研究人员向 529 名人类受试者展示了驾驶员可能面临的道德困境。在研究人员创建的场景中,汽车驾驶员必须决定是将汽车撞向一群人还是另一群人,而且碰撞是不可避免的。也就是说,事故将对一组人造成严重伤害,但会挽救另一组人的生命。

实验中的人类受试者必须对汽车驾驶员的决定进行评分,驾驶员有可能是人类,也有可能是人工智能。以此,研究人员旨在衡量人们可能对人工智能道德决策产生的偏见。

(来源:广岛大学)

(来源:广岛大学)

在他们的第二个实验中,563 名人类受试者回答了研究人员提出的一些相关问题,以确定人们对AI在成为社会的一部分后,对人工智能伦理决策有何反应。

在这个实验中,有两种情况。其中一个涉及一个假设的政府,该政府已经决定允许自动驾驶汽车做出道德决定;另一个场景允许受试者“投票”是否允许自动驾驶汽车做出道德决定。在这两种情况下,受试者都可以选择支持或反对技术做出的决定。

第二个实验旨在测试将人工智能引入社会的两种替代方式的效果。

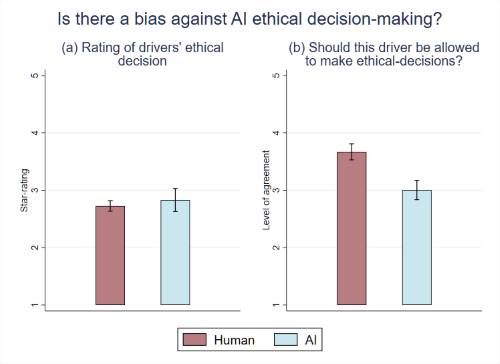

研究人员观察到,当受试者被要求评估人类或人工智能驾驶员的道德决定时,他们对两者都没有明确的偏好。然而,当受试者被问及是否应该允许人工智能在道路上做出道德决定的明确意见时,受试者对人工智能驾驶的汽车有更强烈的意见。

研究人员认为,这两个结果之间的差异是由两种因素共同造成的。

第一个要素是,很多人认为整个社会不希望人工智能做与伦理道德相关的决策,因此当被问及对此事的看法时,他们会被自己的观念所影响。

“事实上,当参与者被明确要求将他们的答案与社会的答案区分开来时,人工智能和人类司机之间的差异就会消失。”广岛大学人文社会科学研究生院助理教授 Johann Caro-Burnett 说。

第二个要素是,在将这项新技术引入社会时,是否允许讨论该相关话题的结果,因国家而异。“在人们信任政府并拥有强大政府机构的地区,信息和决策权有助于受试者评估人工智能道德决策的方式。相比之下,在人们不信任政府且制度薄弱的地区,决策能力恶化了受试者评估人工智能道德决策的方式。”Caro-Burnett 说。

“我们发现,社会对 AI 道德决策存在恐惧。然而,这种恐惧的根源并不是个人所固有的。事实上,这种对人工智能的拒绝来自个人认为是社会的看法。”广岛大学人文社会科学研究生院教授 Shinji Kaneko 说。

图 | 平均而言,人们对 AI 驾驶员的道德决策的评价与人类驾驶员的评价没有区别。但是,人们并不想让人工智能在路上做出道德决定(来源:广岛大学)

图 | 平均而言,人们对 AI 驾驶员的道德决策的评价与人类驾驶员的评价没有区别。但是,人们并不想让人工智能在路上做出道德决定(来源:广岛大学)

因此,当没有被明确询问时,人们不会表现出任何对人工智能道德决策有偏见的迹象。然而,当被明确询问时,人们表现出对人工智能的厌恶。此外,在增加了关于该主题的讨论和信息的情况下,人工智能的接受度在发达国家有所提高,而在发展中国家则恶化。

研究人员认为,这种对新技术的拒绝,主要是由于个人对社会意见的信念,很可能适用于其他机器和机器人。“因此,重要的是要确定个人偏好如何汇总为一种社会偏好。此外,正如我们的结果所表明的那样,这类结论在各国之间也必须有所不同。”Kaneko 说。

参考资料:

https://www.hiroshima-u.ac.jp/en/news/71302

https://linkinghub.elsevier.com/retrieve/pii/S2214804322000556