棉花识别定位 | 中国智能识别棉花采摘,支持新疆棉

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文转自 | 计算机视觉研究院

近期国外BCI都在抵制我国新疆棉,这是一个不正确的举措,中国现在农业很多都是智能化,比如机器化采摘棉花,今天我们一起来分享其中的一些小知识。

支持新疆棉,期待中国AI农业智能发展!

前言

摘要

针对采棉机械手棉花识别定位难的问题,提出一种基于机器视觉的棉花识别与定位方法,搭建出双目立体视觉系统,在此基础上通过相机标定、图像采集、图像处理、特征提取等过程,计算得出棉株的深度信息以及其成熟棉 花的三维信息,其深度平均误差值为2.55mm,单位坐标误差均值为(2.8mm,-1.4mm,-1.35mm)。结果表明,基 于双目立体视觉对棉株上的成熟棉花进行三维空间上的识别定位是可行的。

背景

棉花是我国重要的工业基础及战略物资,也是广大棉农 脱贫致富的重要作物,在农业生产中占有重要的经济地位。新疆由于具备独特的光热资源,已成为全国最大的商品棉生 产基地。新疆棉花总产量、国内销售量以及出口量连续 多年位居全国之首,已经成为当地的支柱产业。新疆与国 外的棉花种植模式差别较大,棉花品种不同,且国产采棉机的 采摘效率不太理想,而由于进口采棉机价格成本太高、零配件 价格高、维修费用高、服务不及时等因素的影响,农民接受不 了,难以推广,因此棉花采收一直是制约新疆棉花发展和 经济效益提高的重要因素之一。

根据目前情况,亟需研究出 机械化、智能化的棉花采摘机器人,新疆的棉花种植区域比较 集中,具有农业机械化、智能化的发展优势,因此充分利用先 进技术和装备并结合人工采摘和机械化采摘的优点,开发一 种新型的棉花收获智能机已成为当前的紧迫任务。其中视觉 系统主要解决的是棉花自动识别与定位,也是机械化、智能化 棉花采摘机器人的关键难题。目前,在果蔬收获机器人工作方面已有多国展开了研究, 美国学者 Schertz和Brown 于1968年首次提出使用机器人来 完成一些采摘作业的思想,Takahashi等依据苹果在双目立 体视觉系统中左右图像对中的视差,利用三维空间分割将2幅图像合成1幅中心图像。Kondo等用4个光源以及3个摄像机组成了草莓采摘机器人,虽然国内在农业采摘机 器人领域开展研究比较晚,但发展速度快,目前已获得很多研 究成果。刘兆祥等根据苹果树的反射光谱特性,利用激光的 反射差异和三角测量原理实现苹果的识别与定位。刘坤 等为准确识别自然环境中被遮挡的棉花,提出了使用随机Hough变换来识别棉花的方法。赵杰文等选取HIS色彩 空间的H通道对田间的番茄采用阈值分割的方法进行识别。徐惠荣等利用颜色信息差来进行识别柑橘,同时在顺 光、逆光的情况下进行了柑橘的识别研究。在棉花图像分 割方面,王勇等分析了棉田环境中不同对象在几种常用色彩 空间下的颜色特征,提出了一种采用R-B色差模型的分割 策略。韦皆顶等选取HSV色彩空间中的S通道对棉花进 行阈值分割。本研究基于机械视觉对成熟棉花进行识别 定位,以期为实现成熟棉花的机械手采摘提供参考。

双目立体视觉

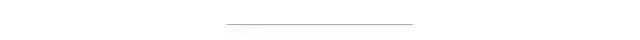

双目立体视觉指的是仿照人类双眼感知距离的方法,以 实现机械视觉对三维信息的感知,通常基于三角测量的方法, 利用2个或多个摄像头对同一景物从不同位置形成图像,从而通过视差恢复距离信息。双目立体视觉模型一般可分为汇 聚式立体视觉模型和平行式立体视觉模型。由于平行式立体 视觉模型需要相机与其光轴绝对平行,而这在实验室条件下 很难实现,所以一般多采用汇聚式立体视觉模型进行立体视 觉的运用。在该模型下空间内的任意一点 P(X,Y,Z)过 C1、 C2 摄像头拍摄图像的投影点像素坐标分别为 P1(u1,v1)、 P2(u2,v2),假设 P1、P2 的坐标点已知,则可以利用摄像头的 内部参数和外部参数反求出 P点的世界坐标,即为 P= M1 -1 P1和 P=M2 -1 P2。M1、M2 的计算公式分别为:

式中:ax1、ay1、ax2、ay2分别为摄像头 C1、C2 在 x轴和 y轴上的 焦距;γ1、γ2 分别为摄像头 C1、C2 的不垂直因子;(uo1,vo1)、 (uo2,vo2)分别为摄像头 C1、C2 光轴像素坐标;R、T分别为旋 转矩阵和平移矩阵。

相机标定

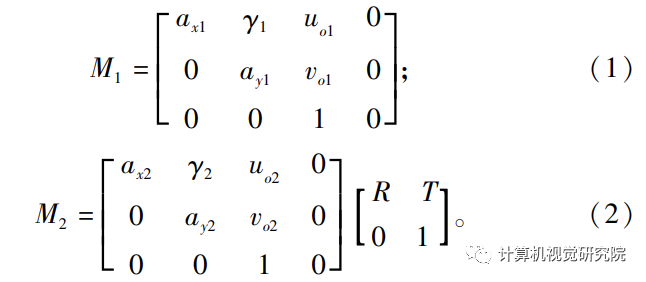

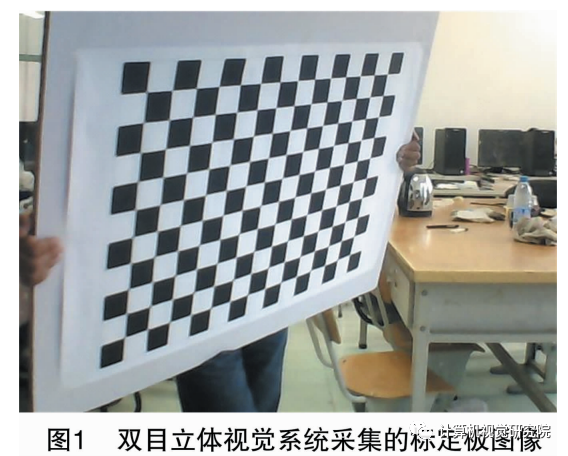

相机标定在于获取精确的相机内部参数(焦距、失真系数、不垂直因子)以及外部参数(旋转矩阵、平移矩阵)。本次标定试验采用Jean-YvesBouguet的Camera Calibration Toolbox-StandardVersion和StereoCameraCalibrationToolbox摄像机标定工具箱进行双目摄像头标定,先用左右2个CCD摄像机从不同位置采集10对标定板图像;然后利用Camera CalibrationToolbox-Standard工具箱分别读入左右CCD摄像机采集的标定板图像(上图);最后采用交互式的角点区域提取方法,利用Matlab软件对标定板图像进行自动角点检测,得到左/右摄像头内部参数,并通过Camera Calibration Toolbox-Standard工具箱得到校正后的左/右摄像头外部参数(下表)。

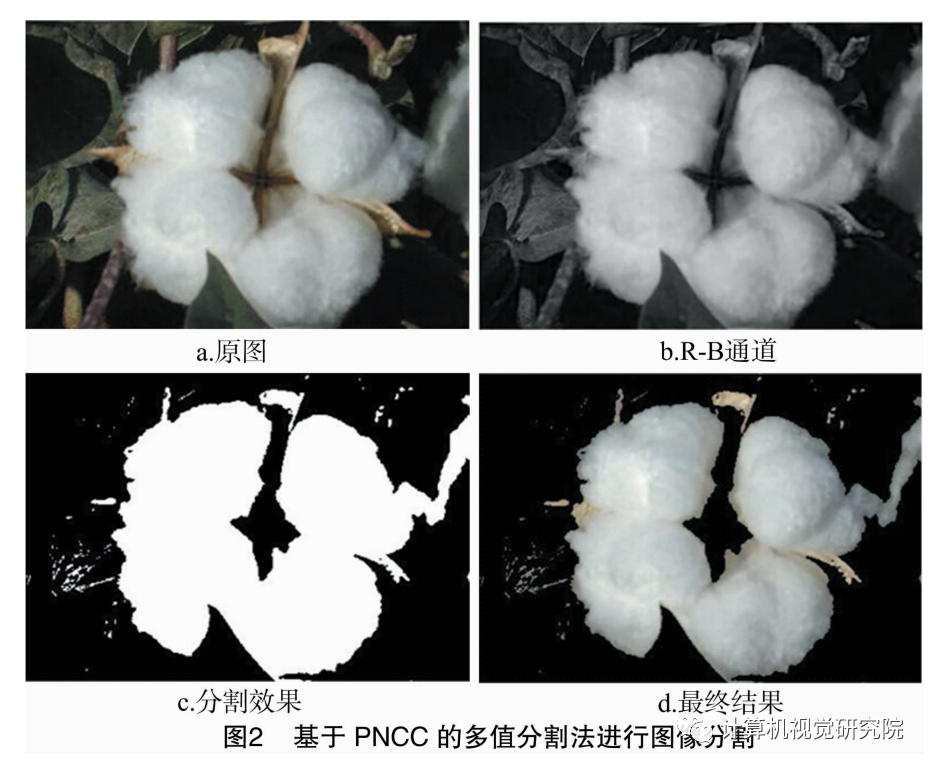

基于PNCC的多值分割法对R-B灰度图进行分割试 验,图像分割结果如下图所示。通过大量的试验可以看出,采用基于PNCC的多值分割法,图像分割的分割率≥91.68%, 并且有效保留了图像的层次性。

成熟棉花目标的特征点匹配

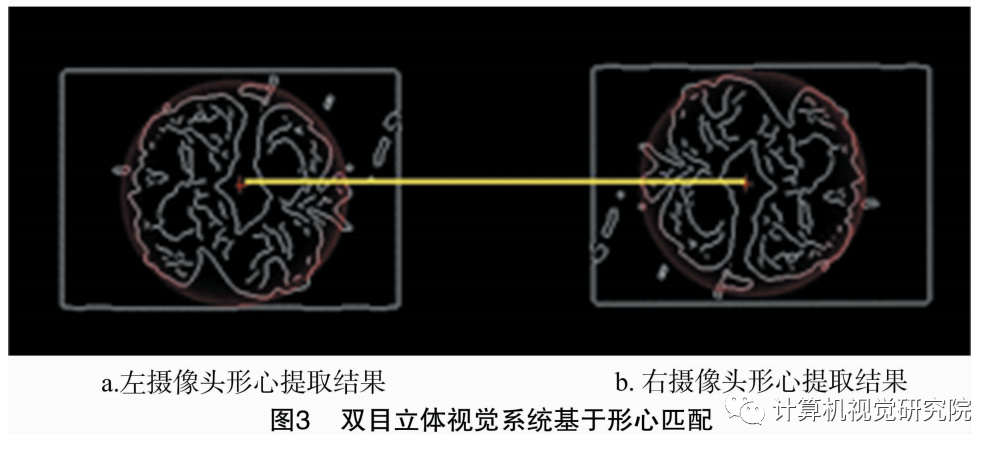

立体匹配即在左图像和右图像中分别找出真实世界中的某一点在2个摄像机成像平面上的匹配投影点。主要方法是依据目标物体的颜色,几何形状等特征,从立体视觉系统左,右摄像机同时拍摄的一组图像中通过某个特征从一副图像的某点搜素另一幅图像的匹配点。为了使匹配的过程达到一定的抗噪能力同时减少歧义性,提出了特征匹配。由于不受灰度的影响,所以抗干扰性较强,同时计算量小、速度快,满足了相同的实时性。特征点的选取和匹配,是利用双目立体视觉技术获得目标物体三维信息的关键。成熟棉花在摄像机成像的投影近似一个标准的圆形,所以其在二维图像的形心基本是在摄像机平面上投影所形成的标准圆形的圆心,因此左右图像上的圆心是一对最佳的匹配点,同时也是棉花采摘过程中理想的采摘点,因此可以直接提取并用于三维信息的计算。利用左,右摄像机采集图像中成熟棉花投影圆心的提取结果如图3所示。

成熟棉花的定位

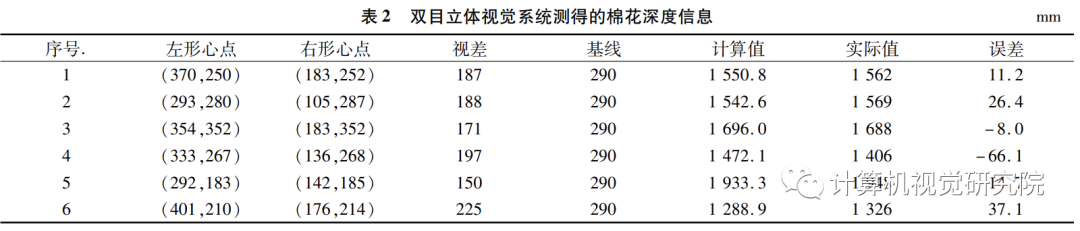

棉株深度信息

对分割好的图像进行进行特征点匹配,等距的3组6幅图像的特征点坐标取均值,以减小偶然误差,处理完成得到6组不同距离的成熟棉花特征点数据。现取每个特征点的1对左右匹配点P1、P2数据,利用相机标定得到的投影矩阵M1、M2,反求出特征点的世界坐标(X,Y,Z),Z即为棉株的深度信息。试验数据见下表,计算出来的深度误差值平均为2.55毫米,可以满足采棉机械手对不同棉株深度精确的要求。

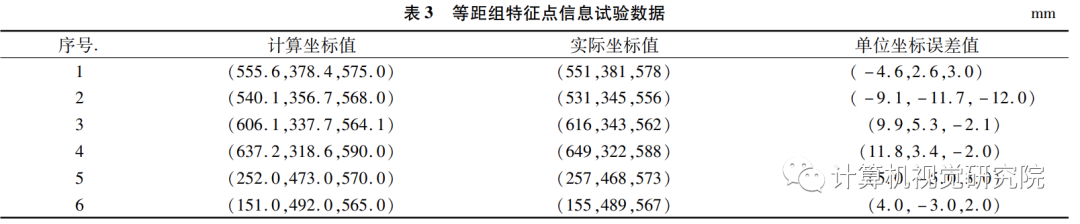

同一棉株不同位置成熟棉花的定位识别

由于棉株上存在多个棉桃,因而采棉机械手须要知晓棉株上对应成熟棉花的多个特征点的坐标,其精准度直接由机械视觉机构给定的匹配点空间坐标的误差值决定。本研究对同一棉株不同位置的成熟棉花定位识别,任取一个等距的组,其特征点的计算坐标与实际坐标如下表示,得到其平均坐标误差值为(2.8mm,-1.4mm,-1.35mm),表明满足同一棉株不同位置的棉花识别定位的精确度要求。

© THE END

下载1:OpenCV-Contrib扩展模块中文版教程

在「小白学视觉」公众号后台回复:扩展模块中文教程,即可下载全网第一份OpenCV扩展模块教程中文版,涵盖扩展模块安装、SFM算法、立体视觉、目标跟踪、生物视觉、超分辨率处理等二十多章内容。

下载2:Python视觉实战项目52讲

在「小白学视觉」公众号后台回复:Python视觉实战项目,即可下载包括图像分割、口罩检测、车道线检测、车辆计数、添加眼线、车牌识别、字符识别、情绪检测、文本内容提取、面部识别等31个视觉实战项目,助力快速学校计算机视觉。

下载3:OpenCV实战项目20讲

在「小白学视觉」公众号后台回复:OpenCV实战项目20讲,即可下载含有20个基于OpenCV实现20个实战项目,实现OpenCV学习进阶。

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~