GAN、DCGAN、WGAN、SRGAN 演变与改进

来源:信息网络工程研究中心 本文共1000字,建议阅读5分钟 本文带你了解GAN、DCGAN、WGAN、SRGAN。

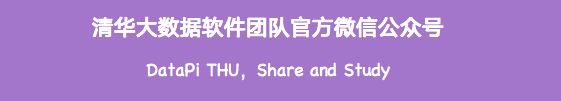

GAN

DCGAN

1.取消Pooling层,改用加入stride的卷积代替。同时用卷积替代了全连接层。

2. 在D和G网络中均加入BN层。

3. G网络使用ReLU作为激活函数,最后一层使用tanh。

4. D网络中使用LeakyReLU作为激活函数

5. 使用adam优化器训练

WGAN

1. 解决了GAN训练不稳定的问题,不再需要小心平衡生成器和判别器的训练程度;

2. 几乎解决了mode collapse(模式崩溃)问题,保证生成样本的多样性;

3. 提供了具有意义的价值函数,可以分别判断判别器和生成器是否已经收敛。(原始GAN中如果D的效果不好,我们不知道是G生成的好,还是D判别的不好)

1. 去掉最后一层的sigmoid

2. 生成器和判别器的loss不取log

3. 限制更新后的权重的绝对值到一定范围内

4. 使用RMSprop或SGD优化,不建议使用基于动量或Adam的优化算法

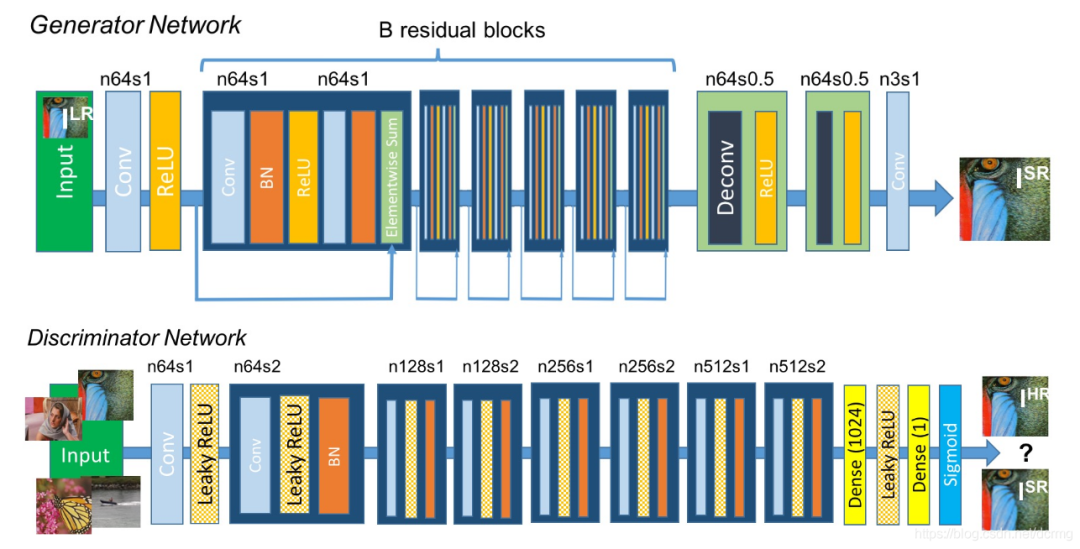

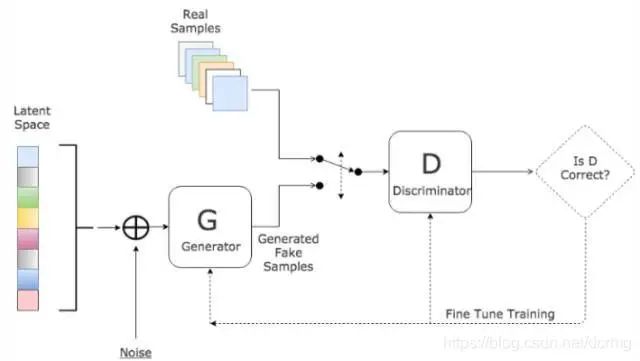

SRGAN

评论